一、介绍

1.1、 Nginx

Nginx (engine x) 是一个高性能的HTTP和反向代理web服务器,同时也提供了IMAP/POP3/SMTP服务。Nginx是由伊戈尔·赛索耶夫为俄罗斯访问量第二的Rambler.ru站点(俄文:Рамблер)开发的,第一个公开版本0.1.0发布于2004年10月4日。

反向代理服务器位于用户与目标服务器之间,但是对于用户而言,反向代理服务器就相当于目标服务器,即用户直接访问反向代理服务器就可以获得目标服务器的资源。同时,用户不需要知道目标服务器的地址,也无须在用户端作任何设定。反向代理服务器通常可用来作为Web加速,即使用反向代理作为Web服务器的前置机来降低网络和服务器的负载,提高访问效率。

1.2、 Nginx的特点

-

稳定性极强,7*24小时不间断运行(就是一直运行)

-

Nginx提供了非常丰富的配置实例

-

占用内存小,并发能力强(随便配置一下就是5w+,而tomcat的默认线程池是150)

二、Liunx (Docker) 中安装 Nginx

2.1、 安装Nginx (使用 docker-compose 命令)

docker-compose 介绍:Compose项目是Docker官方的开源项目,负责实现对Docker容器集群的快速编排。它是一个定义和运行多容器的 docker应用工具。使用compose,你能通过YMAL文件配置你自己的服务,然后通过一个命令,你能使用配置文件 创建和运行所有的服务。重点可以启动多个容器!

docker-compose:找不到命令 解决:

cd /usr/local/bin/

wget https://github.com/docker/compose/releases/download/1.14.0-rc2/docker-compose-Linux-x86_64

rename docker-compose-Linux-x86_64 docker-compose docker-compose-Linux-x86_64

chmod +x /usr/local/bin/docker-compose

在/opt目录下创建docker_nginx目录

/opt 目录作用: 安装附加软件包,是用户级的程序目录,可以理解为 D:/Software

mkdir docker_nginx

在docker_nginx中创建 docker-compose.yml 配置文件

version: '3.1'

services:

nginx:

restart: always

image: daocloud.io/library/nginx:latest # 拉取镜像地址

container_name: nginx

ports:

- 80:80

镜像市场: DaoCloud Hub

执行配置文件

docker-compose up -d

访问80端口,如果能看到下图所示则说明nginx安装启动成功!

2.2、 Nginx 配置文件

查看当前nginx的配置需要进入docker容器中

关于Nginx 的核心配置文件 nginx.conf 内容如下:

user nginx;

worker_processes 1;

error_log /var/log/nginx/error.log warn;

pid /var/run/nginx.pid;

#------------------------------------------------------------------------------

# 以上统称为全局块

# worker_processes 数值越大,Nginx的并发能力越强 (这个不是随便写的,需要根据服务器配置来写)

# error_log 代表Nginx的错误日志存放位置

# pid Nginx 运行标识

#------------------------------------------------------------------------------

events {

worker_connections 1024;

}

#------------------------------------------------------------------------------

# events

# worker—connection 他的数值越大, Nginx 并发能力越强

#------------------------------------------------------------------------------

http {

include /etc/nginx/mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log /var/log/nginx/access.log main;

sendfile on;

#tcp_nopush on;

keepalive_timeout 65;

#gzip on;

include /etc/nginx/conf.d/*.conf;

}

#------------------------------------------------------------------

# http块

# include代表引入一个外部文件

# include /etc/nginx/mime.types; mime.types中存放着大量媒体类型

# include /etc/nginx/conf.d/*.conf; 引入了conf.d下以.conf为结尾的配置文件

#-------------------------------------------------------------------

conf.d目录下只有一个default.conf文件,内容如下

server {

listen 80;

listen [::]:80;

server_name localhost;

#-------------------------------------------------------

# listen代表Nginx监听的端口号

# server_name代表Nginx接受请求的IP

#-------------------------------------------------------

#charset koi8-r;

#access_log /var/log/nginx/host.access.log main;

location / {

root /usr/share/nginx/html;

index index.html index.htm;

}

#-------------------------------------------------------

# location块

# root: 将接受到的请求根据/usr/share/nginx/html去查找静态资源

# index: 默认去上述的路径中找到index.html或index.htm

#-------------------------------------------------------

#error_page 404 /404.html;

# redirect server error pages to the static page /50x.html

#

error_page 500 502 503 504 /50x.html;

location = /50x.html {

root /usr/share/nginx/html;

}

# proxy the PHP scripts to Apache listening on 127.0.0.1:80

#

#location ~ \.php$ {

# proxy_pass http://127.0.0.1;

#}

# pass the PHP scripts to FastCGI server listening on 127.0.0.1:9000

#

#location ~ \.php$ {

# root html;

# fastcgi_pass 127.0.0.1:9000;

# fastcgi_index index.php;

# fastcgi_param SCRIPT_FILENAME /scripts$fastcgi_script_name;

# include fastcgi_params;

#}

# deny access to .htaccess files, if Apache's document root

# concurs with nginx's one

#

#location ~ /\.ht {

# deny all;

#}

}

#---------------------------------------------------------

# 后期主要修改的就是 server 块, 重点关注 conf.d 这个目录中的配置文件

#---------------------------------------------------------

2.3、 修改 docker-compose.yml 文件

version: '3.1'

services:

nginx:

restart: always

image: daocloud.io/library/nginx:latest # 拉取镜像地址

container_name: nginx

ports:

- 80:80

volumes:

- /opt/docker_nginx/conf.d/:/etc/nginx/conf.d

# 使 /opt/docker_nginx/conf.d/ 中的配置文件映射到 nginx 镜像的 /etc/nginx/conf.d 目录中

# 编辑配置文件的时候就不需要在进入镜像中去更改

重构容器,并启动

此时我们再次访问 nginx 页面, 发现无法访问,这是因为我们映射了数据卷之后还没有编写server块中的内容

在/opt/docker_nginx/conf.d下新建default.conf,并插入如下内容

server {

listen 80;

listen [::]:80;

server_name localhost;

location / {

root /usr/share/nginx/html;

index index.html index.htm;

}

}

#重启nginx

docker-compose restart

三、Nginx 的反向代理

3.1、正向代理和反向代理介绍

正向代理:

- 正向代理服务是由客户端设立的

- 客户端了解代理服务器和目标服务器都是谁

- 帮助咱们实现突破访问权限,提高访问的速度,对目标服务器隐藏客户端的ip地址

典型应用就是我们使用的 * * 软件: “微屁恩”, 客户端发送请求给 “微屁恩”(这里的 “微屁恩” 有点像服务器),通过 “微屁恩” 发送请求给最终的服务器,最终服务器返回数据给 “微屁恩”, “微屁恩”再把数据发给客户端,并且服务器只知道取数据的是 “微屁恩”,而不知道真正需要数据的是客户端。(服了,这审核太严过不了,只能用谐音字了 😓 😓)

反向代理:

-

反向代理服务器是配置在服务端的

-

客户端不知道访问的到底是哪一台服务器

-

达到负载均衡,并且可以隐藏服务器真正的ip地址

客户端发送请求,反向代理接受客户端的请求,并分配给服务器处理,最后返回结果给客户端.

3.2、基于Nginx实现反向代理

准备一台tomcat服务器,使用docker-compose 搭建,docker-compose.yml 的编写如下:

version: '3.1' # docker-compose 版本 services: tomcat: restart: always # docker 启动时自启 image: daocloud.io/library/tomcat:8.5.15-jre8 # 镜像地址 container_name: tomcat8 # 容器名称 ports: # 端口映射 - 8080:8080 environment: # 环境变量 TZ: Asia/Shanghai volumes: # 目录挂载 - /opt/docker_tomcat/tomcat_webapps:/usr/local/tomcat/webapps - /opt/docker_tomcat/tomcat_logs:/usr/local/tomcat/logs

执行命令: docker-compose up -d 启动构建并运行tomcat, 在 /opt/docker_tomcat/tomcat_webapps 目录里创建 ROOT 目录,并编写一个 index.html文件。

在 nginx 目录挂载的 conf.d 里新建一个default.conf 文件,编写反向代理配置:

server {

listen 80;

listen [::]:80;

server_name localhost;

location / {

proxy_pass http://192.168.179.110:8080/; # 反向代理地址

}

}

重启 nginx,并访问 80 端口查看是否代理了 tomcat 服务器

docker restart nginx

3.3、关于Nginx的location路径映射

优先级关系:(location = ) > (location /xxx/yyy/zzz) > (location ^~) > (location ~ , ~*) > (location /起始路径) > (location /)

# 1. = 匹配

location / {

#精准匹配,主机名后面不能带能和字符串

#例如 www.baidu.com 不能是 www.baidu.com/id=xxx

}

# 2. 通用匹配

location /xxx {

#匹配所有以/xxx 开头的路径

#例如127.0.0.1:8080/xxx xxx可以为空,为空则和 = 匹配一样

}

# 3. 正则匹配

location ~ /xxx {

#匹配所有以/xxx 开头的路径

}

# 4. 匹配开头路径 ^~

location ^~ /xxx/xx {

#匹配所有以 /xxx/xx 开头的路径

}

# 5. 匹配结尾路径 ~*

location ~* \.(gif/jpg/png)$ {

#匹配以.gif、.jpg、.png结尾的路径

}

案例: 再创建一个tomcat服务器(端口 8081),部署ssm项目,把ssm打包成war包,放在宿主机目录挂载的位置 tomcat_webapps, 启动tomcat容器。nginx 代理配置如下:

server {

listen 80;

listen [::]:80;

server_name localhost;

location ^~ /ssm { # 反向代理 ssm 项目, 匹配开头路径

proxy_pass http://192.168.179.110:8081/ssm/;

}

location / {

proxy_pass http://192.168.179.110:8080/; # 反向代理地址

}

}

四、Nginx 负载均衡策略

Nginx为我们默认提供了三种负载均衡的策略:

- 轮询: 将客户端发起的请求,平均分配给每一台服务器。

- 权重: 会将客户端的请求,根据服务器的权重值不同,分配不同的数量。

- ip_hash: 基于发起请求的客户端的ip地址不同,他始终会将请求发送到指定的服务器上 就是说如果这个客户端的请求的ip地址不变,那么处理请求的服务器将一直是同一个。

4.1、 轮询策略

实现轮询的方式:是Nginx负载均衡默认策略,配置如下:

default.conf 编写

# upstream 写在 server 块外

upstream my-server{

server 192.168.179.110:8080;

server 192.168.179.110:8081;

}

server {

listen 80;

listen [::]:80;

server_name localhost;

location / {

proxy_pass http://my-server/;

}

}

重启 nginx 访问 80 端口,重复刷新,效果如下:

小贴士: 轮询策略有时并不一定是交替访问,属于正常现象。

4.2、 权重策略

实现权重的方式:在配置文件中upstream块中加上weight, weight 值越大,被分配的请求也越多,配置如下:

default.conf 编写

# upstream 写在 server 块外

upstream my-server{

server 192.168.179.110:8080 weight=10; # 8080端口被分配的请求比8081端口多

server 192.168.179.110:8081 weight=2;

}

server {

listen 80;

listen [::]:80;

server_name localhost;

location / {

proxy_pass http://my-server/;

}

}

重启 nginx 访问 80 端口,重复刷新,效果如下:

显而易见 8080 端口被访问的次数明显增多~

4.3、 ip_hash策略

实现 ip_hash 的方式: 在配置文件中upstream块中加上

ip_hash;即可, 配置如下:

# upstream 写在 server 块外

upstream my-server{

ip_hash;

server 192.168.179.110:8080;

server 192.168.179.110:8081;

}

server {

listen 80;

listen [::]:80;

server_name localhost;

location / {

proxy_pass http://my-server/;

}

}

重启 nginx 访问 80 端口,重复刷新,效果如下:

可见一个 ip 不变访问的端口也不会发生变化,一直是 192.168.179.110:8080

五、Nginx 动静分离

Nginx的并发能力公式:

worker_processes * worker_connections / 4|2 = Nginx最终的并发能力动态资源需要/4,静态资源需要/2 , Nginx通过动静分离来提升Nginx的并发能力,更快的给用户响应。

5.1、动态资源代理

# 配置如下

location / {

proxy_pass 路径;

}

5.2、静态资源代理

# 停掉 nginx

docker-compose down

docker-compose.yml 文件中添加静态资源数据卷挂载,不同版本的静态资源位置可能不同,可以在 上述 2.2、Nginx 配置文件 中查看默认的位置( location块中root后的路径 )。

version: '3.1'

services:

nginx:

restart: always

image: daocloud.io/library/nginx:latest

container_name: nginx

ports:

- 80:80

volumes:

- /opt/docker_nginx/conf.d/:/etc/nginx/conf.d

- /opt/docker_nginx/html/:/usr/share/nginx/html

在 /opt/docker_nginx/html 和 /opt/docker_nginx/img下新建一个 index.html(随便写点东西) 和 一张图片, 修改nginx 的default.conf配置文件

server {

listen 80;

listen [::]:80;

server_name localhost;

# 代理静态 html 资源

location /html {

root /usr/share/nginx/; # 静态资源路径

index index.html; # 默认访问路径下的什么资源;

}

# 代理静态 img 资源

location /img {

root /usr/share/nginx/; # 静态资源路径

autoindex on; # 代表展示静态资源的全部内容,以列表的形式展开

}

}

在docker_nginx目录下执行docker-compose restart ,重启nginx, 并访问静态资源

静态 html 页面访问成功。

由于配置了

autoindex on所以访问目录会全部列出静态资源。

静态资源图片访问成功。

5.3、 静态资源代理注意事项

① 反向代理路径别写错,location 后面写了路径(如:location /html {}), 则 root 后面接的路径不能有 /html,否则访问为404,查看nginx错误日志(/var/log/nginx/error.log)如下:

可以看出访问路径出现了重复。

② 在 nginx 的 docker-compose.yml 构建文件中再加一个目录挂载:

-v /usr/local/docker_nginx/logs/:/var/log/nginx

以便 nginx 代理出现问题后查看 log 日志找出问题。

六、Nginx 集群

6.1、前言

如果只有一台 Nginx 的话,当出现故障时,会导致整个程序的崩溃,产生严重后果。使用多台Nginx搭建成一个集群,当其中某一个Nginx宕机,并不会影响整个程序的正常运行。

6.2、Nginx集群工作原理

准备多台Nginx, 准备 keepalived ,监听nginx的健康情况 ;准备 haproxy,提供一个虚拟的路径,统一的去接收用户的请求。当有一台 nginx服务器出现故障,keepalived 检测到了故障后,会及时通知 haproxy 切换到正常nginx服务器,保证程序不受影响。

6.3、准备工作

① 创建一个放置集群配置文件的文件夹:docker_nginx_cluster

mkdir /opt/docker_nginx_cluster

② 在 docker_nginx_cluster 目录中编写 Dockerfile 镜像构建文件

FROM nginx:1.13.5-alpine # 导入镜像,如果本地有则从本地获取,反之去远程仓库拉取

RUN apk update && apk upgrade # 更新 apk

# 下载软件包: ipvsadm,iproute2,openrc,keepalived

RUN apk add --no-cache bash curl ipvsadm iproute2 openrc keepalived

COPY entrypoint.sh /entrypoint.sh

RUN chmod +x /entrypoint.sh # 执行脚本

CMD ["/entrypoint.sh"]

Dockerfile 使用的是 apk 包管理工具,如果把 apk 改成 yum 会报没有 yum 这个指令

③ 在 docker_nginx_cluster 目录中编写 entrypoint.sh 脚本

/usr/sbin/keepalived -D -f /etc/keepalived/keepalived.conf # 启动 keepalived

nginx -g "daemon off;"

④ 在 docker_nginx_cluster 目录中编写 docker-compose.yml 模板文件

version: "3.1"

services:

nginx_master:

build:

context: ./ # 上下文

dockerfile: ./Dockerfile # 引入构建文件

ports:

- 8081:80 # 端口映射

volumes:

- ./index-master.html:/usr/share/nginx/html/index.html

- ./favicon.ico:/usr/share/nginx/html/favicon.ico

- ./keepalived-master.conf:/etc/keepalived/keepalived.conf

networks:

static-network:

ipv4_address: 172.30.128.2 # 必须与下面 subnet设置的ip 前16位相同

cap_add:

- NET_ADMIN # 增加权限

nginx_slave:

build:

context: ./

dockerfile: ./Dockerfile

ports:

- 8082:80

volumes:

- ./index-slave.html:/usr/share/nginx/html/index.html

- ./favicon.ico:/usr/share/nginx/html/favicon.ico

- ./keepalived-slave.conf:/etc/keepalived/keepalived.conf

networks:

static-network:

ipv4_address: 172.30.128.3 # 必须与下面 subnet设置的ip 前16位相同

cap_add:

- NET_ADMIN

proxy:

image: haproxy:1.7-alpine

ports:

- 80:6301

volumes:

- ./haproxy.cfg:/usr/local/etc/haproxy/haproxy.cfg

networks:

- static-network

networks:

static-network:

ipam:

config:

- subnet: 172.30.0.0/16

- 上面的 ip地址必须是没有被占用的, 执行 ifconfig 查看已被使用的 ip 地址,我上面写的 172.30.xxx.xxx 没有被占用的所以可以使用,并且映射出的端口号也不能使用已被占用的!!

- 必须写死 nginx 的 ip(如:nginx_master -> 172.30.128.2 ),否则是ip随机的,haproxy 无法确定发送给哪个nginx服务器。

⑤ 在 docker_nginx_cluster 目录中编写 keepalived 对 nginx_master 和 nginx_slave 的监听配置文件

- keepalived-master.conf

vrrp_script chk_nginx {

# 配置多久检测一次 nginx 是否存活

script "pidof nginx"

interval 2

}

vrrp_instance VI_1 {

state MASTER

interface eth0 # nginx容器内部网卡的名称, 一般是eth0

virtual_router_id 33 # 路由Id, 默认33

priority 200 # 优先级,优先级越高就先访问哪个 nginx

advert_int 1

# 授权

authentication {

auth_type PASS

auth_pass letmein

}

virtual_ipaddress {

172.30.128.50 # 指定用户统一访问的虚拟路径

}

track_script {

chk_nginx # 指定脚本文件,默认即可。

}

}

- keepalived-slave.conf ( 配置和keepalived-master.conf基本一样)

vrrp_script chk_nginx {

script "pidof nginx"

interval 2

}

vrrp_instance VI_1 {

state BACKUP

interface eth0 # 容器内部网卡的名称

virtual_router_id 33

priority 100 # 优先级

advert_int 1

# 授权

authentication {

auth_type PASS

auth_pass letmein

}

virtual_ipaddress {

172.30.128.50# 指定用户统一访问的虚拟路径

}

track_script {

chk_nginx # 指定脚本文件,默认即可。

}

}

⑥ 在 docker_nginx_cluster 目录中编写 haproxy 的配置文件 haproxy.cfg

# global: 全局配置区域参数是进程级的,通常是和操作系统相关。这些参数一般只设置一次,如果配置无误,就不需要再次进行修改。

global

log 127.0.0.1 local0 # 全局的日志配置,使用log关键字,指定使用127.0.0.1上的syslog服务中的local0日志设备,记录日志等级为info的日志

maxconn 4096 # 最大连接数

daemon # 以守护进程方式运行haproxy

nbproc 4 # 指定后台的进程数量

# defaults:配置默认参数,这些参数可以被用到 frontend,backend,Listen组件

defaults

log 127.0.0.1 local3

mode http # 默认的模式 mode { tcp|http|health }

option dontlognull

option redispatch

retries 2 # 定义连接后端服务器的失败重连次数,连接失败次数超过此值后将会将对应后端服务器标记为不可用

maxconn 2000 # 最大连接数

balance roundrobin # 负载均衡算法-轮询

# 最大超时时间设置

timeout connect 5000ms # 最大连接

timeout client 5000ms # 客户端

timeout server 5000ms # 服务端

# frontend: 处理请求的虚拟节点,Frontend可以将匹配到本地区域的请求交给下边的backend

frontend main

bind *:6301 # 监听地址为 6301

default_backend webserver # 此处将对应的请求转发给后端

# 定义一个名为 webserver 后端部分(webserver 是自定义名称,但是需要与frontend里面的配置项default_backend值相一致)

backend webserver

server nginx_master 172.30.128.50:80 check inter 2000 rise 2 fall 5

# 这里的 ip 要和 keepalived-master.conf 和 keepalived-slave.conf 里面的写的虚拟ip对应上,端口映射为 80

- option dontlognull : 启用该项,日志中将不会记录空连接。所谓空连接就是在上游的负载均衡器或者监控系统为了探测该 服务是否存活可用时,需要定期的连接或者获取某一固定的组件或页面,或者探测扫描端口是否在监 听或开放等动作被称为空连接;官方文档中标注,如果该服务上游没有其他的负载均衡器的话,建议不要使用该参数,因为互联网上的恶意扫描或其他动作就不会被记录下来。

- option redispatch:当使用了cookie时,haproxy将会将其请求的后端服务器的serverID插入到cookie中,以保证会话的SESSION持久性;而此时,如果后端的服务器宕掉了, 但是客户端的cookie是不会刷新 的,如果设置此参数,将会将客户的请求强制定向到另外一个后端server上,以保证服务的正常。

6.4、构建启动集群

在 docker_nginx_cluster 目录下执行:

docker-compose up -d

构建运行成功!

如果出现如下情况:

IPv4 forwarding is disabled. Networking will not work.

解决方法:

① 执行以下命令:vi /usr/lib/sysctl.d/00-system.conf② 在最下面添加如下代码: net.ipv4.ip_forward=1

③ 重启 network 服务: systemctl restart network

④ 再次构建启动集群: docker-compose up -d

6.5、 访问测试

haproxy 默认访问优先级高的,nginx_master 服务器设置的优先级更高,所以先访问 master

如果nginx_master主机宕机,那么haproxy把请求发给从机 nginx_slave服务器

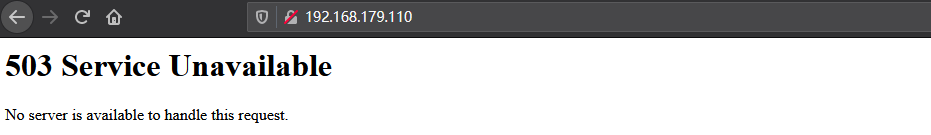

如果出现访问 80端口出现下图所示:

解决办法: 仔细检查配置文件是否配置错误,有些地方的配置在不同的主机上配置是不同的,不能直接照抄,仔细看我写的注释!!!

完结 ~ ~

ε=(´ο`*)))唉,变懒了,几个月前学的东西,现在才把笔记写上,欠的总得一点一点还啦~~

4751

4751

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?