🖥️ UI 匹配 ChatGPT,包括深色模式、流媒体和 11-2023 更新

💬 多模式聊天:

使用 GPT-4 和 Gemini Vision 上传和分析图像 📸

Active Development 中的更多文件类型和 Assistant API 集成 🚧

🌎 多语言用户界面:

英语、中文、德语、西班牙语、法语、意大利语、波兰语、巴西葡萄牙语、Русский

日本语、Svenska、한국어、Tiếng Việt、繁体中文、土耳其语、荷兰语

🤖 AI 模型选择:OpenAI API、Azure、BingAI、ChatGPT、Google Vertex AI、Anthropic(Claude)、插件

💾 创建、保存和共享自定义预设

🔄 通过对话分支编辑、重新提交和继续消息

📤 将对话导出为屏幕截图、markdown、文本、json。

🔍 搜索所有消息 / 对话

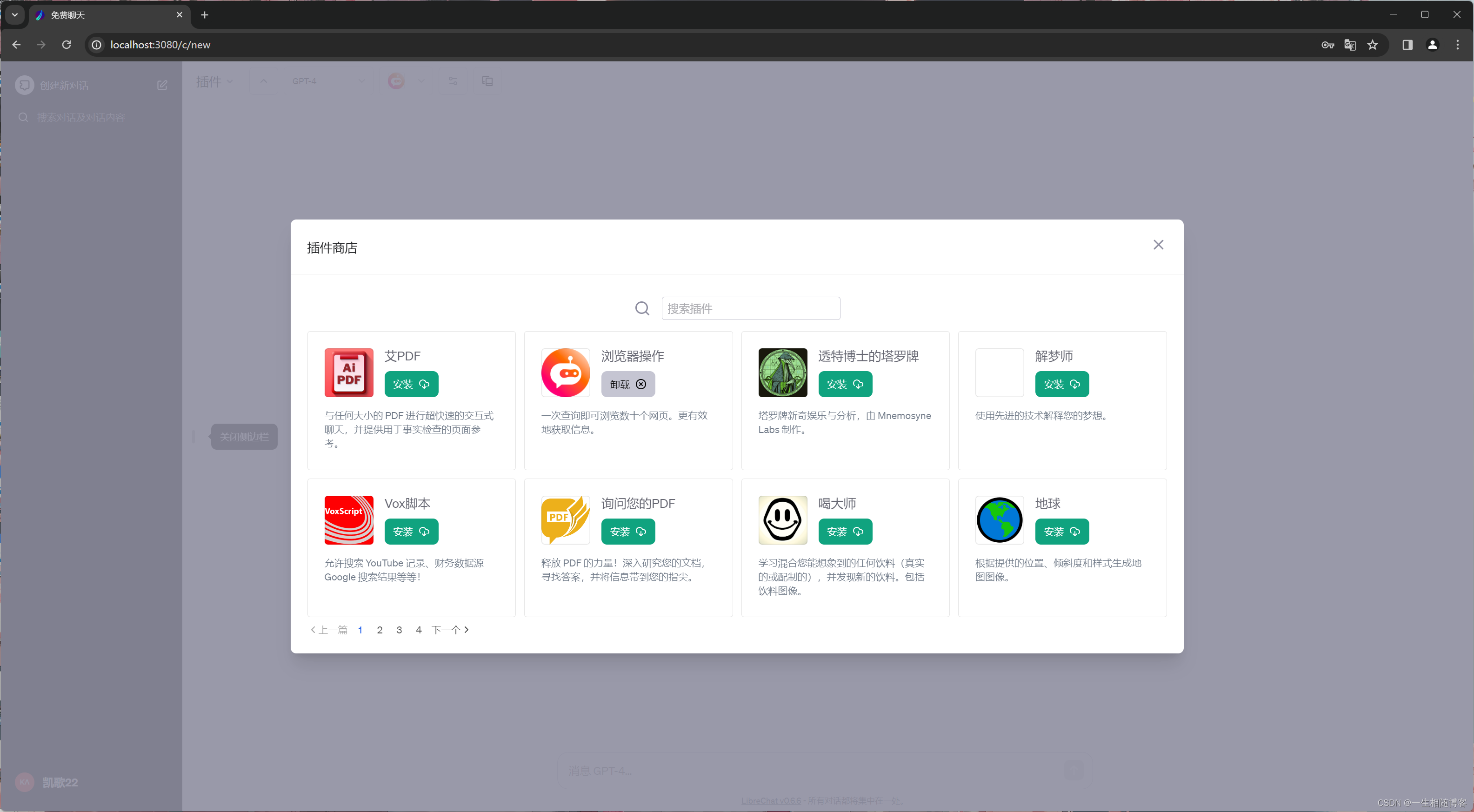

🔌 插件,包括网络访问、使用 DALL-E-3 生成图像等

👥 具有审核和令牌支出工具的多用户、安全身份验证

⚙️ 配置代理、反向代理、Docker、许多部署选项,并且完全开源

源码获取请自行百度:一生相随博客

一生相随博客致力于分享全网优质资源,包括网站源码、游戏源码、主题模板、插件、电脑软件、手机软件、技术教程等等,欢迎收藏网站链接

1497

1497

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?