IP_LAP:革新性的身份保持说话人脸生成技术

在计算机视觉和人工智能领域,说话人脸生成一直是一个充满挑战性的研究方向。近日,一项名为IP_LAP(Identity-Preserving Talking Face Generation with Landmark and Appearance Priors)的创新技术在CVPR 2023会议上引起了广泛关注。这项由钟伟志等人提出的方法,通过巧妙结合地标和外观先验信息,成功解决了传统方法在身份保持方面的不足,为说话人脸生成领域带来了新的突破。

IP_LAP的核心创新

IP_LAP的核心创新在于其独特的技术架构和算法设计。研究团队提出了一种基于地标和外观先验的生成方法,有效提高了生成人脸的身份保持能力和真实感。

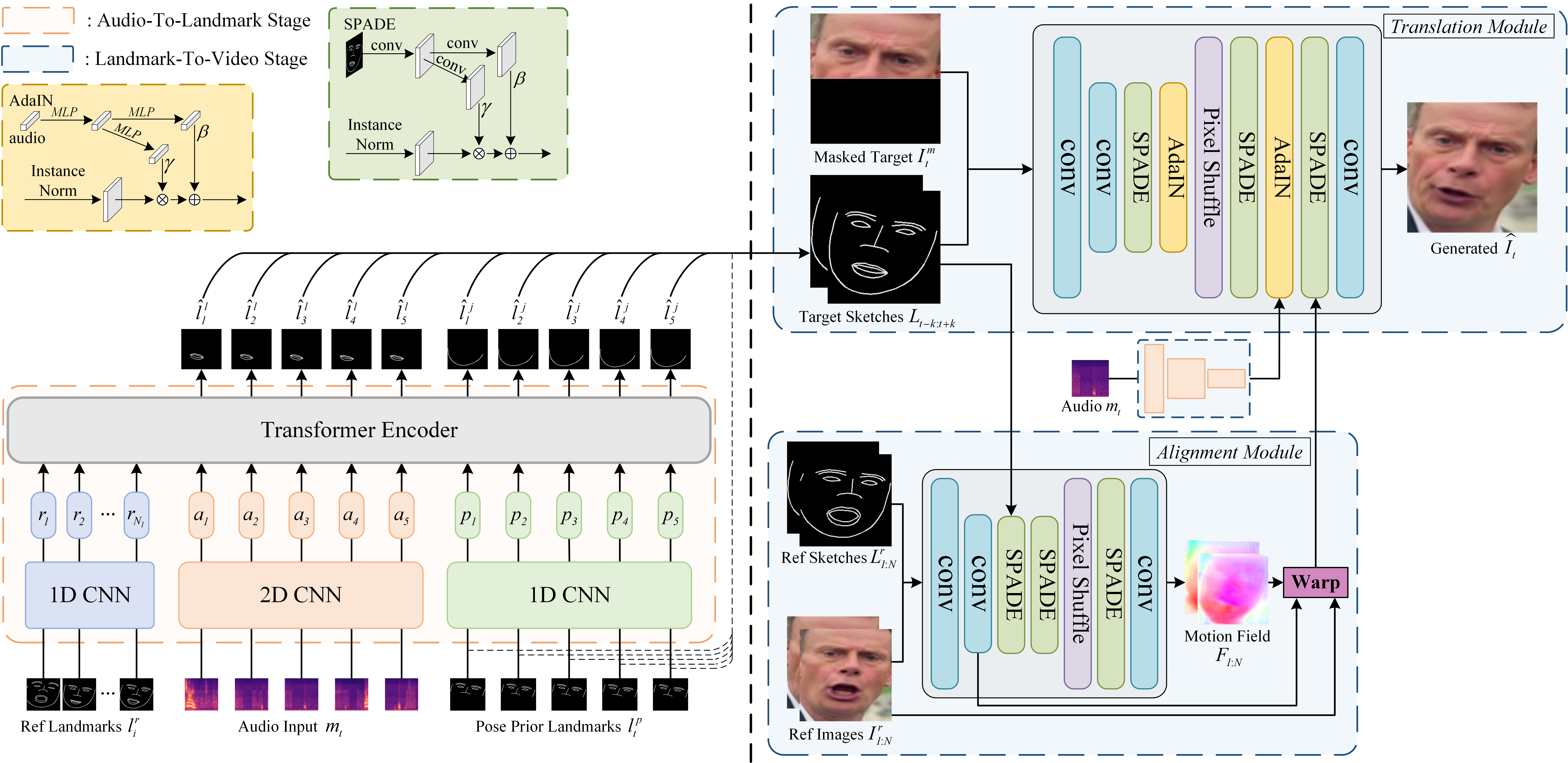

如上图所示,IP_LAP的系统框架主要包含以下几个关键组件:

- 地标生成器:基于音频输入生成面部关键点序列。

- 外观编码器:提取目标人物的外观特征。

- 视频渲染器:结合地标和外观信息生成最终的说话人脸视频。

这种设计巧妙地将人脸动作和身份特征分离,使得系统能够在保持身份的同时,准确地模拟说话时的口型和表情变化。

技术实现细节

IP_LAP的实现过程涉及多个复杂的技术环节。以下是一些关键步骤的详细说明:

数据预处理

IP_LAP使用LRS2数据集进行训练。研究人员开发了一系列预处理脚本,用于提取音频特征、人脸图像、地标和素描等关键信息。这些预处理步骤包括:

- 音频提取:使用

preprocess_audio.py脚本从视频中提取原始音频和梅尔频谱特征。 - 视频处理:通过

preprocess_video.py脚本提取裁剪后的人脸、地标和素描信息。

这些预处理步骤为后续的模型训练奠定了基础,确保了输入数据的质量和一致性。

模型训练

IP_LAP的训练过程分为两个主要阶段:

-

地标生成器训练:

python train_landmarks_generator.py --pre_audio_root ..../lrs2_audio --landmarks_root ..../lrs2_landmarks地标生成器的训练目标是最小化L1损失,通常在损失值降至约6e-3时停止。

-

视频渲染器训练:

python train_video_renderer.py --sketch_root ..../lrs2_sketch --face_img_root ..../lrs2_face --audio_root ..../lrs2_audio视频渲染器的训练过程更为复杂,涉及多个损失函数的平衡。研究者们采用了FID (Fréchet Inception Distance)作为主要的评估指标。

值得注意的是,视频渲染器中的平移模块在训练的前25个epoch是不参与更新的,这种策略有助于模型的稳定收敛。

应用示例与效果展示

IP_LAP在实际应用中展现出了优秀的性能。研究团队提供了一个简单的推理脚本inference_single.py,使用者可以通过以下命令轻松生成说话人脸视频:

CUDA_VISIBLE_DEVICES=0 python inference_single.py

为了直观展示IP_LAP的效果,研究团队发布了一个演示视频。视频中,IP_LAP生成的说话人脸在保持原始身份特征的同时,展现出流畅自然的唇形同步和面部表情变化,充分体现了该技术的先进性。

IP_LAP的潜在应用

IP_LAP的出现为多个领域带来了新的可能性:

-

虚拟主播与数字人:IP_LAP可用于创建高度逼真的虚拟主播,为新闻播报、在线教育等领域提供新的解决方案。

-

电影与动画制作:该技术可以大大简化电影后期制作中的配音和唇形同步工作,提高制作效率。

-

远程通信:在视频会议系统中,IP_LAP可以用于改善低带宽条件下的视频质量,实现更流畅的交流体验。

-

辅助交流工具:对于语言障碍者,IP_LAP可以帮助他们通过文字或音频输入生成对应的说话视频,促进沟通。

-

虚拟现实(VR)和增强现实(AR):在虚拟环境中,IP_LAP可以为虚拟角色赋予更真实的表情和口型,提升用户体验。

技术展望与挑战

尽管IP_LAP在身份保持和唇形同步方面取得了显著进展,但该领域仍面临一些挑战和发展方向:

-

实时性能优化:目前IP_LAP的生成过程仍需要一定的计算时间,如何在保证质量的同时提高生成速度,是未来研究的重点之一。

-

多样性表现:如何使生成的表情和动作更加丰富多样,避免出现单一或重复的模式,也是值得探索的方向。

-

跨域适应性:提高模型在不同数据集、不同语言甚至不同种族人群中的泛化能力,是推广应用的关键。

-

伦理与隐私考虑:随着技术的发展,如何防止IP_LAP被滥用于制作深度伪造(Deepfake)视频,保护个人隐私,也是研究者们需要考虑的重要问题。

结语

IP_LAP作为一项突破性的身份保持说话人脸生成技术,不仅在学术界引起了广泛关注,也为相关产业带来了新的机遇。随着技术的不断完善和应用场景的拓展,我们有理由相信,IP_LAP将在不久的将来为我们的日常生活和工作带来更多创新和便利。

研究团队已经在GitHub上开源了IP_LAP的代码实现,这无疑将加速该技术的发展和应用。对于有兴趣深入了解或尝试使用IP_LAP的读者,可以访问项目仓库,查看详细的使用说明和训练指南。

最后,让我们期待IP_LAP及其衍生技术在未来能够为人机交互、数字娱乐、远程通信等领域带来更多令人兴奋的创新和突破。

文章链接:www.dongaigc.com/a/ip-lap-identity-preserving-tts

https://www.dongaigc.com/a/ip-lap-identity-preserving-tts

738

738

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?