1.防火墙关闭

systemctl stop firewalld

systemctl disable firewalld

2.主机映射

vi /etc/hosts

一、zookeeper配置

1、创建文件software 和module

mkdri /opt/software module

2、解压zookeeper压缩包到module里面

[root@hadoop101 software]# tar -xvf zookeeper-3.4.7.tar.gz -C /opt/module/

3、进入conf,然后cp zoo_sample.cfg zoo.cfg

[root@hadoop101 software]# cd /opt/module/zookeeper-3.4.7/conf

[root@hadoop101 conf]# cp zoo_sample.cfg zoo.cfg

[root@hadoop101 conf]# vi zoo.cfg

配置内容如下:

dataDir=/opt/module/zookeeper-3.4.7/DataZK

server.1=hadoop101:2888:3888

server.2=hadoop102:2888:3888

server.3=hadoop103:2888:3888

4、创建mkdir /opt/module/zookeeper-3.4.7/DataZK

5、进入DataZK

[root@hadoop101 DataZK]# echo 1 > myid

6、复制到另外两个节点

[root@hadoop101 DataZK]# scp -r /opt/module/zookeeper-3.4.7 root@hadoop102:/opt/module/

[root@hadoop101 DataZK]# scp -r /opt/module/zookeeper-3.4.7 root@hadoop103:/opt/module/

7、修改hadoop102 和 hadoop103的myid,分别为2和3

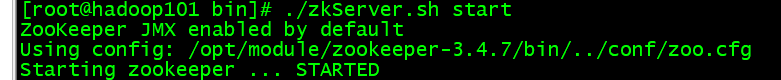

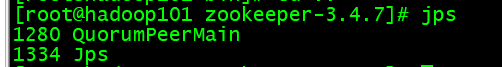

8、启动zookeeper,到bin目录下./zkServer.sh start (每一台都要)

[root@hadoop101 zookeeper-3.4.7]# cd bin/

[root@hadoop101 bin]# ./zkServer.sh start

成功效果:

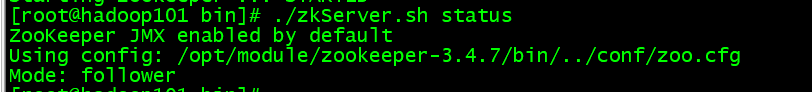

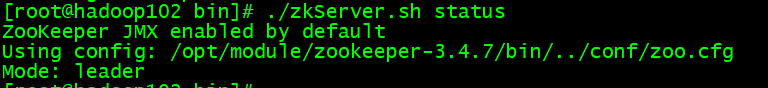

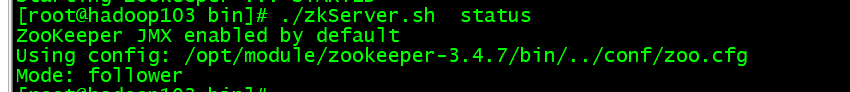

9、查看状态,到bin目录下./zkServer.sh status(每一台),成功效果:

9、查看状态,到bin目录下./zkServer.sh status(每一台),成功效果:

二、hadoop配置

1、解压hadoop到文件module里面

[root@hadoop101 software]# tar -xvf hadoop-2.9.2.tar.gz -C /opt/module/

2、进入hadoop的etc/hadoop目录下面

[root@hadoop101 software]# cd /opt/module/hadoop-2.9.2/etc/hadoop/

3、修改文件hadoop-env.sh

export HADOOP_IDENT_STRING=$USER

export JAVA_HOME=/opt/module/jdk1.8.0_221

export HADOOP_HOME=/opt/module/hadoop-2.9.2

export HADOOP_CONF_DIR=${HADOOP_HOME}/etc/hadoop

export HADOOP_OPTS="-Djava.library.path=${HADOOP_HOME}/lib/native"

4、配置core-site.xml

<configuration>

<!--用来指定hdfs的老大:ns (namespace)-->

<property>

<name>fs.defaultFS</name>

<value>hdfs://ns</value>

</property>

<!--执行zookeeper地址-->

<property>

<name>ha.zookeeper.quorum</name>

<value>hadoop101:2181,hadoop102:2181,hadoop103:2181</value>

</property>

<!--用来指定hadoop运行时产生文件的存放目录-->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-2.9.2/tmp</value>

</property>

</configuration>

5、配置hdfs-site.xml

<configuration>

<!--执行hdfs的nameservice为ns,和core-site.xml的fs.defaultFS值保持一致-->

<property>

<name>dfs.nameservices</name>

<value>ns</value>

</property>

<!--ns下有两个namenode,分别是nn1、nn2-->

<property>

<name>dfs.ha.namenodes.ns</name>

<value>nn1,nn2</value>

</property>

<!--nn1的RPC通信地址-->

<property>

<name>dfs.namenode.rpc-address.ns.nn1</name>

<value>hadoop101:9000</value>

</property>

<!--nn1的http通信地址-->

<property>

<name>dfs.namenode.http-address.ns.nn1</name>

<value>hadoop101:50070</value>

</property>

<!--nn2的RPC通信地址-->

<property>

<name>dfs.namenode.rpc-address.ns.nn2</name>

<value>hadoop102:9000</value>

</property>

<!--nn2的http通信地址-->

<property>

<name>dfs.namenode.http-address.ns.nn2</name>

<value>hadoop102:50070</value>

</property>

<!--指定namenode的元数据在JournalNode上的存放位置,这样,namenode2可以从jn集群里获取最新的namenode的信息,达到热备的效果-->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://hadoop101:8485;hadoop102:8485;hadoop103:8485/ns</value>

</property>

<!--指定JournalNode存放数据的位置-->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/opt/module/hadoop-2.9.2/journal</value>

</property>

<!--开启namenode故障时自动切换-->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!--配置切换的实现方式,客户端故障转移代理提供者-->

<property>

<name>dfs.client.failover.proxy.provider.ns</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!--配置隔离机制:通过秘钥隔离机制-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<!--配置隔离机制的ssh登录秘钥所在的位置-->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/root/.ssh/id_rsa</value>

</property>

<!--配置namenode数据存放的位置,可以不配置,如果不配置,默认用的是

core-site.xml里配置的hadoop.tmp.dir的路径-->

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///opt/module/hadoop-2.9.2/tmp/namenode</value>

</property>

<!--配置datanode数据存放的位置,可以不配置,如果不配置,默认用的是

core-site.xml里配置的hadoop.tmp.dir的路径-->

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///opt/module/hadoop-2.9.2/tmp/datanode</value>

</property>

<!--配置block副本数量-->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<!--设置hdfs的操作权限,false表示任何用户都可以在hdfs上操作文件-->

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configurationi>

6、配置mapred-site.xml

[root@hadoop101 hadoop]# cp mapred-site.xml.template mapred-site.xml

<property>

<!--指定mapreduce运行在yarn上-->

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

7、配置yarn-site.xml

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!--指定两个resourcemanager的名称-->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!--配置rm1,rm2的主机-->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>hadoop101</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>hadoop102</value>

</property>

<!--开启yarn恢复机制-->

<property>

<name>yarn.resourcemanager.recovery.enabled</name>

<value>true</value>

</property>

<!--执行rm恢复机制实现类-->

<property>

<name>yarn.resourcemanager.store.class</name>

<value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value>

</property>

<!--配置zookeeper的地址-->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>hadoop101:2181,hadoop102:2181,hadoop103:2181</value>

<description>For multiple zk services, separate them with comma</description>

</property>

<!--指定YARN HA的名称-->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>yarn-ha</value>

</property>

<property>

<!--指定yarn的老大resoucemanager的地址-->

<name>yarn.resourcemanager.hostname</name>

<value>imaster</value>

</property>

<property>

<!--NodeManager获取数据的方式-->

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

8、再hadoop-2.9.2创建tmp和journal

[root@hadoop101 hadoop-2.9.2]# mkdir journal

[root@hadoop101 hadoop-2.9.2]# mkdir tmp

9、进入tmp创建namenode和datanode

[root@hadoop101 hadoop-2.9.2]# cd tmp/

[root@hadoop101 tmp]# mkdir namenode datanode

10、修改slaves

[root@hadoop101 hadoop-2.9.2]# cd etc/hadoop/

[root@hadoop101 hadoop]# pwd

/opt/module/hadoop-2.9.2/etc/hadoop

[root@hadoop101 hadoop]# vi slaves

内容如下:

hadoop101

hadoop102

hadoop103

11、环境变量

[root@hadoop101 hadoop-2.9.2]# cd /opt/module/hadoop-2.9.2/etc/hadoop

[root@hadoop101 hadoop-2.9.2]# vi ~/.bash_profile

JAVA_HOME=/opt/module/jdk1.8.0_221

HADOOP_HOME=/opt/module/hadoop-2.9.2

SPARK_HOME=/opt/module/spark-2.4.4-hadoop2.7

HIVE_HOME=/opt/module/apache-hive-2.3.6-bin

export HBASE_HOME=/opt/module/hbase-0.98.17-hadoop2

CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

PATH=$PATH:$HOME/bin:$ZK_HOME/bin:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$HBASE_HOME/bin:$SPARK_HOME/bin

export PATH JAVA_HOME HIVE_HOME CLASSPATH HADOOP_HOME ZK_HOME SPARK_HOME

ZK_HOME=/opt/module/zookeeper-3.4.7

12、拷贝

[root@hadoop101 hadoop-2.9.2]# scp -r /opt/module/hadoop-2.9.2/ root@hadoop102:/opt/module/

[root@hadoop101 hadoop-2.9.2]# scp -r /opt/module/hadoop-2.9.2/ root@hadoop103:/opt/module/

13、生效,让配置生效----3台

[root@hadoop101 hadoop-2.9.2]# cd etc/hadoop/

[root@hadoop101 hadoop]# source hadoop-env.sh

三、综合

1、再hadoop101中格式化zookeeper

[root@hadoop101 hadoop]# hdfs zkfc -formatZK

2、启动journalNode集群(三个节点都要输入)

2、启动journalNode集群(三个节点都要输入)

hadoop-daemon.sh start journalnode

3、再hadoop101中启动namenode(第一次启动的时候执行)

hadoop namenode -format

4、在hadoop101上启动namenode(active)

4、在hadoop101上启动namenode(active)

hadoop-daemon.sh start namenode

5、将hadoop102设置为备用节点,在其上面输入

hdfs namenode -bootstrapStandby

6、启动hadoop102的namenode(备用),在hadoop102上输入

hadoop-daemon.sh start namenode

7、启动datanode,在hadoop101上

hadoop-daemons.sh start datanode

8、在hadoop101和hadoop102上分别启动zkfc

hadoop-daemon.sh start zkfc

9、启动yarn,在hadoop101和hadoop102上输入

start-yarn.sh

10、在本地电脑上做映射C:\Windows\System32\drivers\etc

250

250

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?