1、查看python当前工作目录

import os

>>>os.getcwd()2、更改当前工作目录

os.chdir('要设置的目录')//同样要导入import模块第一个Scrapy项目:

1、创建项目:

进入您打算存储代码的目录中,运行下列命令:

scrapy startproject tutorial该命令将会创建包含下列目录的tutorial目录:

tutorial/

scrapy.cfg

tutorial/

__init__.py

items.py

pipelines.py

settings.py

spiders/

__init__.py

...这些文件分别是:

- scrapy.cfg:项目的配置文件。

- tutorial/:该项目的python模块。之后您将在此加入代码。

- tutorial/items.py:项目中的item文件。

- tutorial/pipelines.py:项目中的pipelines文件。

- tutorial/settings.py:项目的设置文件。

- tutorial/spiders/:放置spider代码的目录。

2、定义Item

Item是保存爬取道德数据的容器,使用方法和python字典类似,并且提供了额外保护机制来避免拼写错误导致的未定义字段错误。

类似在ORM中做的一样,你可以通过创建一个scrapy.Item 类,并且定义类型为scrapy.Field 的类属性来定义一个Item。

首先根据需要从dmoz.org获取到的数据对item进行建模。我们需要从dmoz中获取名字,url,以及网站的描述。对此,在item中定义相应的字段。编辑第二个tutorial目录中的items.py文件(添加下列代码):

import scrapy

class DmozItem(scrapy.Item):

title=scrapy.Field()

link=scrapy.Field()

desc=scrapy.Field()通过定义item,你可以很方便的使用scrapy的其他方法。而这些方法需要知道你的item的定义。

3、编写第一个爬虫

Spider是用户编写用于从单个网站(或者一些网站)爬取数据的类。

其包含了一个用于下载的初始URL,如何跟进网页中的链接以及如何分析页面中的内容,提取生成item的方法。

为了创建一个Spider,你必须继承scrapy.Spider类,且定义以下三个属性:

- name:用于区别Spider。该名字必须是唯一的,你不可以为不同的Spider设定相同的名字。

- strat_urls:包含了Spider在启动时进行爬取的url列表。因此,第一个被获取到页面将是其中之一。后续的URL则从初始的URL获取到的数据中提取。

- parse():是spider的一个方法。被调用时,每个初始URL完成下载后生成的Response对象将会作为唯一的参数传递给该函数,该方法负责解析返回的数据(response data),提取数据(生成item)以及需要进一步处理的URL的Request对象。

以下为我们的第一个Spider代码,保存在tutorial/tutorial/spiders目录下的dmoz_spider.py文件中:

from scrapy.spider import Spider

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

filename = response.url.split("/")[-2]

with open(filename, 'wb') as f:

f.write(response.body)4、爬取

进入项目的根目录,执行下列命令启动spider:

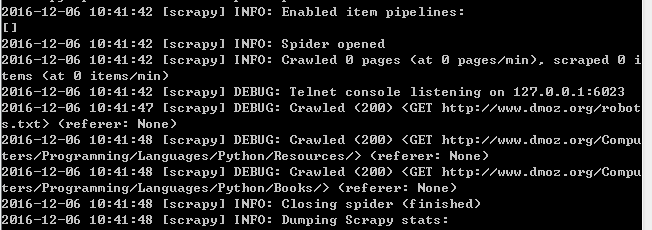

scrapy crawl dmozcrawl dmoz启动用于爬取dmoz.org的spider,你将得到类似的输出:

可以看到,有两条输出的log中包含定义在start_urls中的初始URL,并且与spider中是一一对应的。在log中可以看到其没有指向其他页面(referer:None)。

除此之外,就像我们在parse方法中指定的那样,有两个包含url所对应的内容的文件被创建了:Book和Resources。

刚刚发生了什么?

scrapy为Spider的start_urls属性中的每个URL创建了scrapy.Request对象,并将parse方法作为回调函数(callback)赋值给了Request。

Request对象经过调度,执行生成scrapy.http.Request对象并送回给spider的parse()方法。

5、提取Item

Selector选择器简介

从网页中提取数据有很多方法。Scrapy使用了一种基于XPath和CSS表达式机制:Scrapy Selectors。关于selector和其他提取机制的信息请参考Selector文档。

这里给出XPath表达式的例子及对应的含义:

- /html/head/title:选择HTML文档中< head >标签内的< title >元素。

- /html/head/title/text():选择上面提到的< title >元素的文字。

- //td:选择所有的< td >元素。

- //div[@class=”mine”]:选择所有具有class=”mine”属性的div元素。

上面仅仅是几个简单的XPath例子,XPath实际上要比这远远强大的多。如果你想了解的更多,可以参考这篇XPath教程。

为了配合XPath,Scrapy除了提供了Selector之外,还提供了方法来避免每次从response中提取数据时生成selector的麻烦。

Seletor有四个基本的方法(相应的方法可以看到详细的API文档):

- xpath():传入xpath表达式,返回该表达式所对应的所有节点的selector list列表。

- css():传入CSS表达式,返回该表达式所对应的所有节点的selector list列表。

- extract():序列化该节点为unicode字符串并返回list。

- re():根据传入的正则表达式对数据进行提取,返回unicode字符串list列表。

在Shell中尝试Selector选择器

为了介绍Selector的使用方法,接下来我们将要使用内置的Scrapy shell。Scrapy Shell需要你预装好IPython(一个扩展的Python终端)。

你需要进入项目的根目录,执行下列命令来启动shell:

scrapy shell "http://www.dmoz.org/Computers/Programming/Languages/Python/Books/"注意:当你在终端运行Scrapy时,请一定记得给url地址加上引号,否则包含参数的url(例如&字符)会导致Scrapy运行失败。

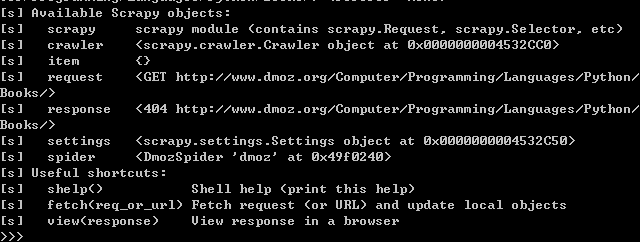

shell输出类似:

当shell载入后,你将得到一个包含response数据的本地response变量。输入response.body将输出response的包体,输出response.headers可以看到response的包头。

更为重要的是,当输入response.selector时,你将获取到一个可以用于查询返回数据的selector(选择器),以及映射到response.selector.xpath()、response.selector.css()的快捷方法(shortcut):response.xpath()和response.css()。

同时,shell根据response提前初始化了变量sel。该selector根据response的类型自动选择最合适的分析规则(XML vs HTML)。

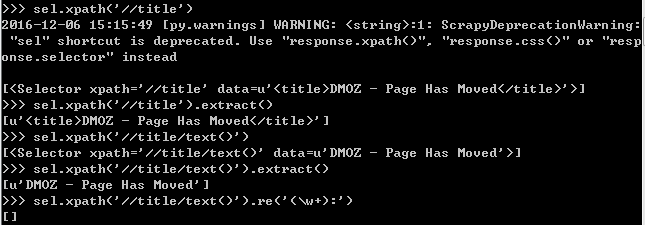

让我们来试试:

提取数据

现在,我们来尝试从页面中提取有用的数据。

你可以在终端中输入response.body来观察HTML源码并确定合适的XPath表达式。不过,这任务非常无聊且不易。你可以考虑使用Firefox的Firebug扩展来使得工作更为轻松。

在查看了网页的源码后,你会发现网站的信息是被包含在第二个< ul >元素中。

我们可以通过这段代码选择该页面中网站列表里所有< li >元素:

sel.xpath('//ul/li')网站的描述:

sel.xpath('//ul/li/text()').extract()网站的标题:

sel.xpath('//ul/li/a/text()').extract()以及网站的链接:

sel.xpath('//ul/li/a/@href').extract()之前提到过,每个.xpath()调用返回selector组成的list,因此我们可以拼接更多的.xpath()来进一步获取某个节点。我们将在下边使用这样的特性:

for sel in response.xpath('//ul/li'):

title = sel.xpath('a/text()').extract()

link = sel.xpath('a/@href').extract()

desc = sel.xpath('text()').extract()

print title, link, desc在我们的spider中加入这段代码:

from scrapy.spider import Spider

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

for sel in response.xpath('//ul/li'):

title = sel.xpath('a/text()').extract()

link = sel.xpath('a/@href').extract()

desc = sel.xpath('text()').extract()

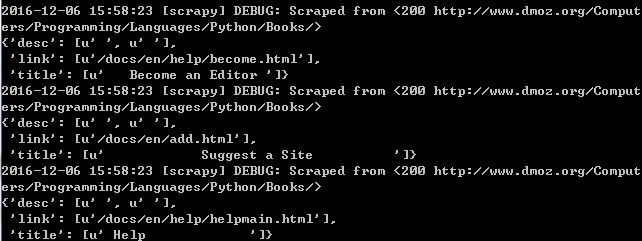

print title, link, desc现在尝试再次爬取dmoz.org,你将看到爬取到的网站信息被成功输出:

scrapy crawl dmoz使用item

Item对象是自定义的python字典。你可以使用标准的字典语法来获取到其每个字段的值。(字段即是我们之前用Field赋值的属性):

>>>item = DmozItem()

>>>item['title']= 'Example title'

>>>item['title']

'Example title'一般来说,Spider会将爬取到的数据以Item对象返回。所以为了将爬取的数据返回,我们最终的代码是:

from scrapy.spider import Spider

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

for sel in response.xpath('//ul/li'):

item = DmozItem()

item['title'] = sel.xpath('a/text()').extract()

item['link'] = sel.xpath('a/@href').extract()

item['desc'] = sel.xpath('text()').extract()

yield item现在对dmoz.org进行爬取将会产生DmozItem对象:

保存爬取到的数据

最简单存储爬取的数据的方式是使用Feed exports:

scrapy crawl dmoz -o items.json该命令将采用JSON格式对爬取的数据进行序列化,生成items.json文件。

在类似本篇教程中这样小规模的项目中,这种存储方式已经足够。如果需要对爬取到的item做更多更为复杂的操作,你可以编写Item Pipeline。类似于我们在创建项目时对Item做的,用于你编写自己的tutorial/pipeline.py也被创建。不过如果你仅仅想要保存item,你不需要实现任何的pipeline。

1883

1883

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?