现场没法还原了,当时5月18日凌晨报错,事后看应用日志,发现凌晨开始有大量sql报错,异常信息如下:

Caused by: org.apache.ibatis.exceptions.PersistenceException:

### Error querying database. Cause: org.springframework.jdbc.CannotGetJdbcConnectionException: Failed to obtain JDBC Connection;

nested exception is com.alibaba.druid.pool.GetConnectionTimeoutException: wait millis 20000, active 20, maxActive 1500

但分析报错的sql发现都是操作的同一个表,有定时任务对表的删除,有新请求对表的写入、更新

这个表的数据量也比较大,删除任务针对13天前的数据进行删除 (有时20-50w左右的数据量)。

如果是因为定时任务锁表,那可能后面几天 (19号,20号...)都应该报错才是,但只有18日报错,不能理解。

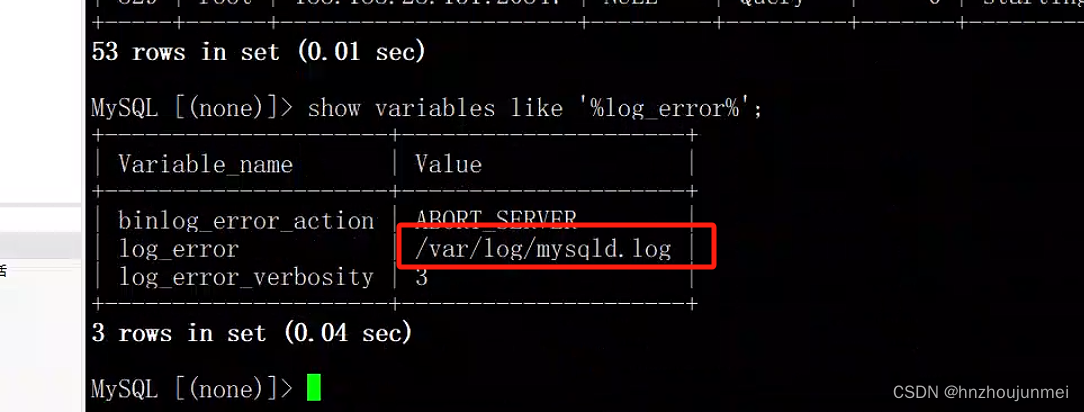

在看数据库服务器上的mysql日志,先show variables like '%log_error%'; 看日志的目录

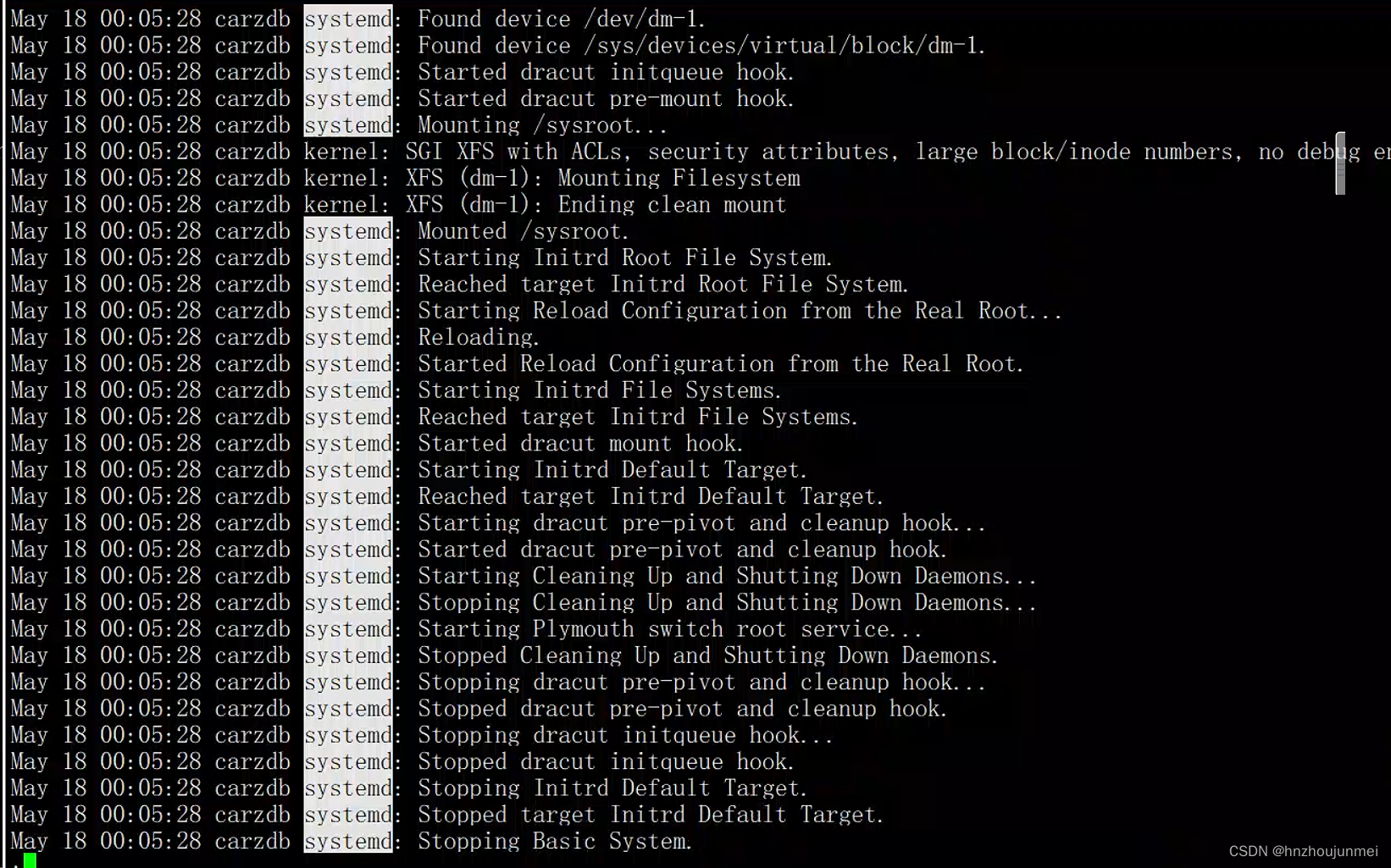

在看对应目录下的日志文件,发现5月18日凌晨有异常关闭mysql服务,为什么关闭了?是人为、服务器断电?还是其他啥原因?

预知后事,还需要再看下linux操作系统日志 (/var/log/message或/var/log/syslog)

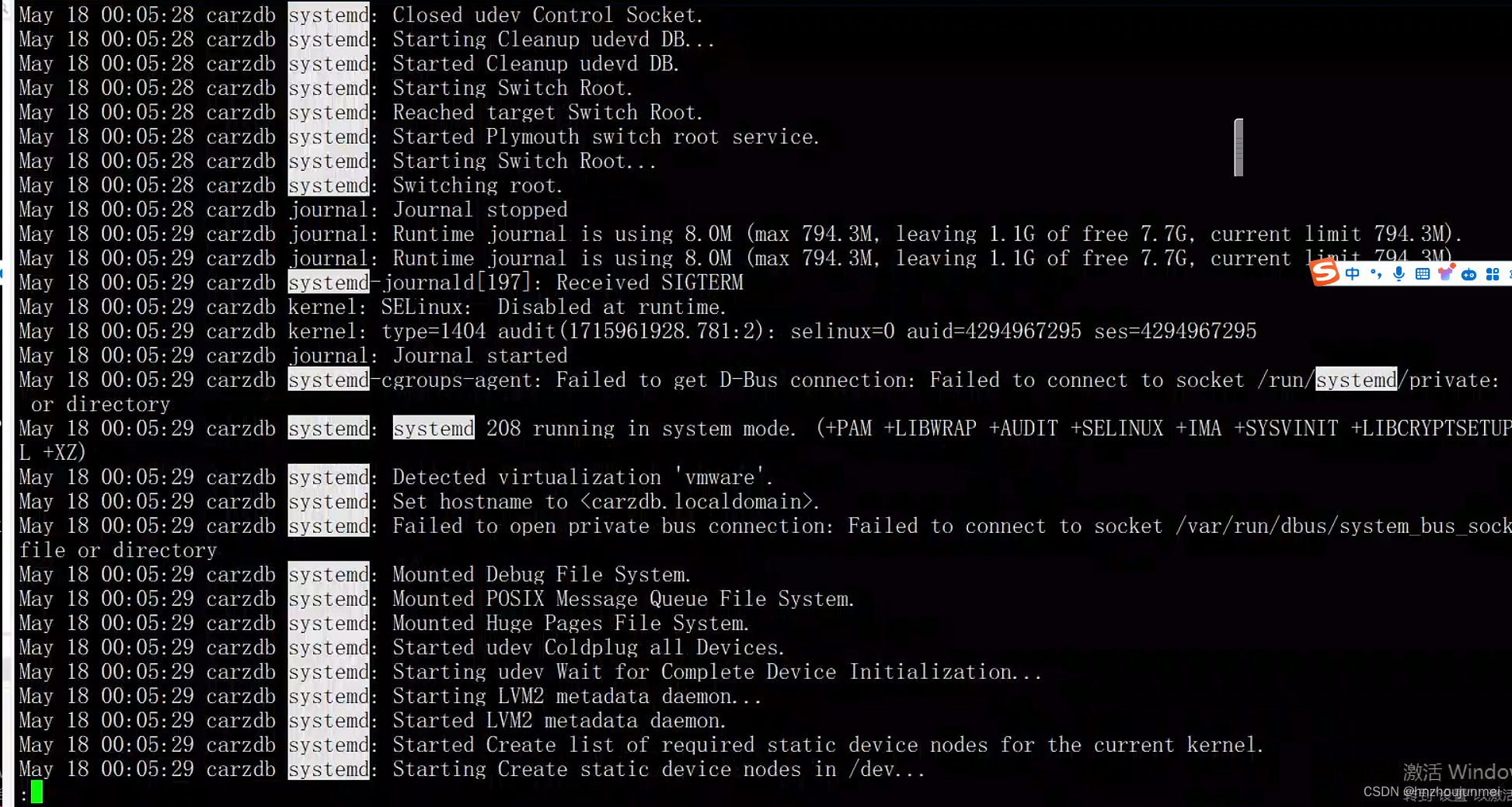

小白表示看不懂....搜了些fail error也的确有,但还是无法定位具体原因....

于是找来运维大哥帮忙一起看,大哥提示是否当时内存使用较高,发现数据库服务器的内存用完了!

最后决定先升级数据库服务器内存 ,由16G升级到32G再观察后续表现

应用层面待改造:

删除数据时不要根据条件一次性删除,先根据条件分页查出待删除数据,然后一条条根据主键删除,这样避免一次删除过多数据而锁表!

7万+

7万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?