1、概述

实际的数据库极易受噪声、缺失值和不一致数据的侵扰,因为数据库太大,并且多半来自多个异种数据源。低质量的数据将会导致低质量的挖掘结果。有大量的数据预处理技术:

- - 数据清理:可以用来清楚数据中的噪声,纠正不一致。

- - 数据集成:将数据由多个数据源合并成一个一致的数据存储,如数据仓库。

- - 数据归约:可以通过如聚集、删除冗余特征或聚类来降低数据的规模。

- - 数据变换:(例如,规范化)可以用来把数据压缩到较小的区间,如0.0到1.0。这可以提高设计距离度量的挖掘算法的准确率和效率。这些技术不是排斥的,可以一起使用。

1.1、数据质量 数据如果能满足其应用的要求,那么它是高质量的。数据质量涉及许多因素,包括:准确率、完整性、一致性、时效性、可信性和可解释性。

2、数据清理

现实世界的数据一般是不完整的、有噪声的和不一致的。数据清理例程试图填充缺失的值、光滑噪声并识别离群点、纠正数据中的不一致。

2.1、缺失值

如何处理缺失的属性?我们来看看下面的方法:

1- - - 忽略元组:当缺少类标号时通常这样做(假设挖掘任务设计分类)。除非元组有多个属性缺少值,否则更改方法不是很有效。当每个属性缺失值的百分比变化很大时,他的性能特别差。采用忽略元组,你不能使用该元组的剩余属性值。这些数据可能对手头的任务是有用的。

2- - - 人工填写缺失值:一般来说,该方法很费事,并且当数据集很大、缺失很多值时该方法可能行不通。

3- - - 使用一个全局填充缺失值:将缺失的属性值用同一个常量(如:“Unknow”或-∞)替换。如果确实的值都如“Unknow”替换,则挖掘程序可能误认为他们形成了一个有趣的概念,因为他们都具有相同的值 – “Unknow”。因此,尽管该方法简单,但是并不十分可靠。

4- - - 使用属性的中心度量(如均值或中位数)填充缺失值:对于正常的(对称的)数据分布而言,可以使用均值,而倾斜数据分布应该使用中位数。

5- - - 使用与给定元组属同一类的所有样本的属性均值或中位数:

6- - - 使用最可靠的值填充缺失值:可以用回归、贝叶斯形式化方法的基于推理的工具或决策树归纳确定。

方法3~方法6使数据有偏,可能填入的数据不准确。然而,方法6是最流行的策略。与其他方法(可能方法2除外)相比,它使用已有数据的大部分信息来预测缺失值。

需要注意的是,在某些情况下,缺失值并不意味着数据有错误。理想情况下,每个属性都应当有一个或多个空值条件的规则。这些规则可以说明是否允许空值,并且/或者说明这样的空值应该如何处理或转换。如果在业务处理的稍后步骤提供值,字段也可能故意留下空白。因此,尽管在得到数据后,我们可以尽我们所能来清理数据,但好的数据库和数据输入设计将有助于在第一现场把缺失值或者错误的数量降至最低。

2.2、噪声数据

噪声(noise)是被测量的变量的随机误差或方差。我们可以使用基本的数据统计描述技术(例如,盒图或者散点图)和数据可视化方法来识别可能代表噪声的离群点。

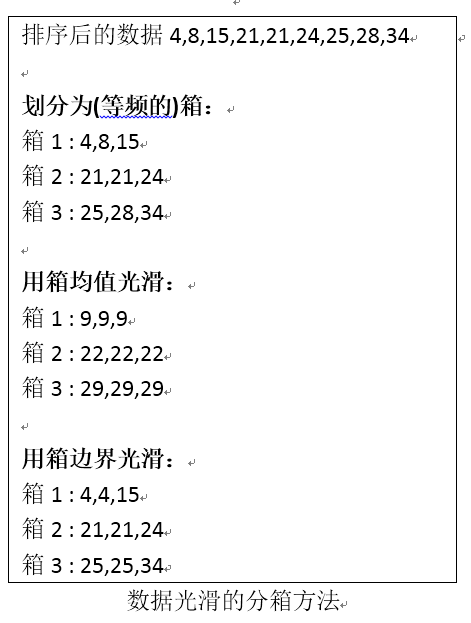

1- - - 分箱(bining):分箱方法通过考察数据的“近邻”(即周围的值)来光滑有序的数据值。这些有序的值被分布到一些“捅”或箱中。由于分箱方法考察近邻的值,因此它进行局部的光滑。

如上图所示,数据首先排序并被划分到大小为3的等频的箱中。对于用箱均值光滑,箱中每一个值都被替换为箱中的均值。类似的,可以使用用箱中位数光滑或者用箱边界光滑等等。

2- - - 回归(regression):可以用一个函数拟合数据来光滑数据。这种技术称之为回归。线性回归涉及找出拟合两个属性(或变量)的“最佳”直线,使得一个属性可以用来预测另一个。多元线性回归是线性回归的扩充,其中涉及的属性多余两个,并且数据拟合到一个多维曲面。

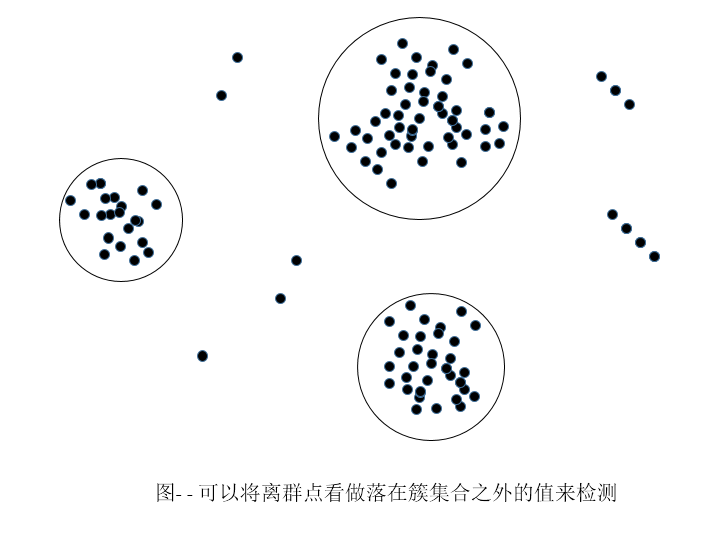

3- - - 离群点分析(outlier analysis):可以通过如聚类来检测离群点。聚类将类似的值组织成群或“簇”。直观地,落在簇集合之外的值被视为离群点。

2.3、数据清理作为一个过程

数据清理过程第一步是偏差检测(discrepancy detection)。导致偏差的因素可能有多种,包括具有很多可选字段的设计糟糕的输入表单、人为的输入错误、有意的错误(例如,不愿意泄露个人隐私),以及数据退化(例如,过时的地址)。偏差也可能源于不一致的数据表示和编码的不一致使用。记录数据的设备的错误和系统错误是另一种偏差源。当数据(不适当地)用于不同于当初的目的时,也可能出现错误。数据集成也可能导致不一致(例如,当给定的属性在不同的数据库中具有不同的名称时)。

那么,如何进行偏差检测呢?首先,我们明确一个概念,”关于数据的数据“称作元数据。例如,每个属性的数据类型是定义域是什么?每个属性可接受的值是什么?对于把握数据趋势和识别异常,数据的基本统计描述是有用的。例如,找出均值、中位数和众数。数据是对称的还是倾斜的?值域是什么?所有的值都在期望的区间内吗?每个属性的标准差是多少?远离给定属性均值超过两个标准差的值可能标记为可能的离群点。属性之间存在已知的依赖吗?在这一步,可以编写程序或使用稍后我们讨论到的工具。由此,你可能发现噪声、离群点和需要考察的不寻常的值。

1- - - 编码格式:警惕编码使用的不一致和数据表示的不一致问题(例如,日期“2015/12/08”和”08/12/2015”);

2- - - 字段过载:开发者将新属性的定义挤进已经定义的属性的未使用(位)部分(例如,使用一个属性未使用的位,该属性取值已经使用了32位中的31位)。

1- - - :唯一性规则:给定属性的每个值都必须不同于该属性的其他值。

2- - - :连续性规则:属性的最低值和最高值之间没有缺失的值,并且所有的值还必须是唯一的(例如,检验数).

3- - - :空值规则:说明空白、问号、特殊符号或指示空值条件的其他串的使用(例如,一个给定属性的值何处不能用),以及如何处理这样的值。

1- - - 数据清洗工具(data scrubbing tools):使用简单的领域知识(邮政地址知识和拼写检查),检查并纠正数据中的错误。在清理多个数据源的数据时,这些工具依赖分析和模糊匹配技术。

2- - - 数据审计工具(data auditing tools):通过分析数据发现规则和联系,并检测违反这些条件的数据来发现偏差。

3- - - 数据迁移工具(data migration tools):允许说明简单的变换,如将串”gender”用“sex”替换。

4- - -ETL(extraction/transformation/loading,提取/变换/装入)工具:允许用户通过图形用户界面说明变换。

通常,这些工具只支持有限的变换,因此我们可能需要为数据清理过程的这一步编写定制的程序。

偏差检测和数据变换(纠正偏差) 迭代执行这两步过程。通常,需要多次迭代才能使用户满意。

新的数据清理方法强调加强交互性。例如,Potter’s Wheel是一种公开的数据清理工具,它集成了偏差检测和数据变换。

- 以业务知识或经验推测填充缺失值

- 以同一指标的计算结果(均值、中位数、众数等)填充缺失值

- 以不同指标的计算结果填充缺失值

- 把看上去不需要但实际上对业务很重要的字段删了;

- 某个字段觉得有用,但又没想好怎么用,不知道是否该删;

- 一时看走眼,删错字段了。

二、数据分析之前的各项准备工作

数据分析团队各成员确定之后,将进行下一项工作,就是找到有价值的数据进行分析了。数据是分析的基础,因此数据的质量、数据的相关度、数据的维度等会影响数据分析的结果影,其中GIGO(垃圾进垃圾出)对于数据分析结果影响最大。

1数据源选择

数据分析团队面对大量的数据源,各个数据源之间交叉联系,各个数据域之间具有逻辑关系,各个产品统计口径不同,不同的时间段数值不同等。这一系列问题多会影响数据分析结果,因此确定数据源选择和数据整理至关重要。

DBA可以基于数据分析需要,找到相关数据,建立一张数据宽表,将数据仓库的数据引入到这张宽表当中,基于一定的逻辑关系进行汇总计算。这张宽表作为数据分析的基础,然后再依据数据分析需要衍生出一些不同的表单,为数据分析提供干净全面的数据源。宽表一方面是用于集中相关分析数据,一方面是提高效率,不需要每次分析时都查询其他的数据表,影响数据仓库效率。

2数据抽样选择

简单的数据分析可以调用全体数据进行分析,数据抽样主要用于建模分析,抽样需考虑样本具有代表性,覆盖各种客户类型,抽样的时间也很重要,越近的时间窗口越有利于分析和预测。在进行分层抽样时,需要保证分成出来的样本比例同原始数据基本一致。

3数据类型选择

数据类型分为连续型和离散型,建模分析时需要确定数据类型。进行业务收入趋势分析、销售额预测分析、RFM分析时,一般采用连续型变量。信用评级、分类预测时一般采用离散变量。

4缺失值处理

数据分析过程中会面对很多缺失值,其产生原因不同,有的是由于隐私的原因,故意隐去。有的是变量本身就没有数值,有的是数据合并时不当操作产生的数据缺失。

缺失值处理可以采用替代法(估值法),利用已知经验值代替缺失值,维持缺失值不变和删除缺失值等方法。具体方法将参考变量和自变量的关系以及样本量的多少来决定。

5异常值检测和处理

异常值对于某些数据分析结果影响很大,例如聚类分析、线性回归(逻辑回归)。但是对决策树、神经网络、SVM支持向量机影响较小。

一般异常值是指明显偏离观测值的平均值,例如年龄为200岁,平均收入为10万元时,有个异常值为300万元。第一个异常值为无效异常值,需要删掉,但是第二个异常值可能属于有效异常值,可以根据经验来决定是否保留或删掉。

6数据标准化

数据标准化的目的是将不同性质、不同量级的数据进行指数化处理,调整到可以类比的范围。例如在建立逻辑回归模型时,性别的取值是0或以,但是收入取值可能就是0-100万,跨度较大,需要进行标准化。

一般可以采用最佳/最大标准化(Min-Max标准化法)将数值定在0和1之间,便于计算。Z分数法和小数定标标准化法也可以采用。

7数据粗分类(Categorization)处理

归类和分类的目的是减少样本的变量,常有的方法由等间距分类,等频数分类。可以依据经验将自变量分成几类,分类的方法可以不同,建议采用卡方检验来决定采用哪种分类方法。连续型变量可以用WOE变化方法来简化模型,但降低了模型的可解释性。

8变量选择

数据分析过程中会面对成百上千的变量,一般情况下只有少数变量同目标变量有关,有助于提高预测精度。通常建模分析时,有意义的变量不会超过10-15个,称他们为强相关变量(聪明变量)。可以利用变量过滤器的方法来选择变量。常见的变量过滤器应用场景如下。

|

三、数据分析过程

1向业务部门进行调研,了解业务需要解决的问题,将业务问题映射成数据分析工作和任务

2调研企业内外部数据,找到分析需要的数据,将数据汇聚到一个特定的区域,数据集市或数据仓库,探索性分析

3数据清洗,包括检查数据的一致性,处理异常值和缺失值,删除重复数据等

4数据转换,例如数据分箱(Binning),将字符型变量转化为数字型变量,按照数据所需维度进行汇总

5建立模型,按照业务需求建立不同模型(例如客户流失预警、欺诈检测、购物篮分析、营销响应等)

6模型结果解释和评估,业务专家进行业务解释和结果评价

四、大数据分析场景和模型应用

数据分析建模需要先明确业务需求,然后选择是描述型分析还是预测型分析。如果分析的目的是描述客户行为模式,就采用描述型数据分析,描述型分析就考虑关联规则、序列规则、聚类等模型。

预测型数据分析就是量化未来一段时间内,某个事件的发生概率。有两大预测分析模型,分类预测和回归预测。常见的分类预测模型中,目标变量通常都是二元分类变量例如欺诈与否,流失与否,信用好坏等。回归预测模型中,目标变量通常都是连续型变量,常见的有股票价格预测、违约损失率预测(LGD)等。

生存分析聚焦于将事件的结果和出现这一结果所经历的时间进行分析,源于医疗领域,研究患者治疗后的存活时间。生存分析可也可以用于预测客户流失时间,客户下次购买时间,客户违约时间,客户提前偿还贷款时间,客户下次访问网站时间等。

常见的数据分析应用场景如下

1市场营销

营销响应分析建模(逻辑回归,决策树)

净提升度分析建模(关联规则)

客户保有分析建模(卡普兰梅尔分析,神经网络)

购物蓝分析(关联分析Apriori)

自动推荐系统(协同过滤推荐,基于内容推荐,基于人口统计推荐,基于知识推荐,组合推荐,关联规则)

客户细分(聚类)

流失预测(逻辑回归)

2风险管理

客户信用风险评分(SVM,决策树,神经网络)

市场风险评分建模(逻辑回归和决策树)

运营风险评分建模(SVM)

欺诈检测(决策树,聚类,社交网络)

五、数据模型评价的方法

1AUC值判别法

|

AUC小于0.7识别能力很弱

AUC在0.7-0.8之间识别能力可接受

AUC在0.8-0.9之间识别能力卓越

AUC大于0.9模型出现意外

2KS判别法

KS值大于0.2就表示具有较好的可预测性

本文大部分内容来源于BartBaesens所著《AnalysisinaBigDataWorld:TheEssentialGuidetoDataScienceanditsApplications》。中文书名为《大数据分析数据科学应用场景与实践精髓》柯晓燕张纪元翻译

701

701

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?