一旦卡超过10秒通常来讲是属于网络问题,

于是写了如下一段程序进行调试

public static void main( String[] args ) throws Exception {

Configuration configuration = new Configuration();

configuration.addResource("core-site.xml");

configuration.addResource("hdfs-site.xml");

int res = ToolRunner.run(configuration, new org.apache.hadoop.fs.FsShell(), new String[]{"-ls", "/hbase"});

System.out.println(res);

}在打印出标题中的那一行时暂停程序,发现程序停在了对 fs.defaultFS的DNS解析上面。

尝试修改主机的hosts文件,这个问题可以解决。

另外尝试将配置成与hdfs-site.xml中dfs.nameservices不一致,这个问题也可以解决,

网上搜索这两个配置要求一致,但实测NameNode可以正常运行,跑MapReduce也没啥问题,所以不知道后续还有没有坑。

-------------------------------------------------------------后续--------------------------------------------------------------------------

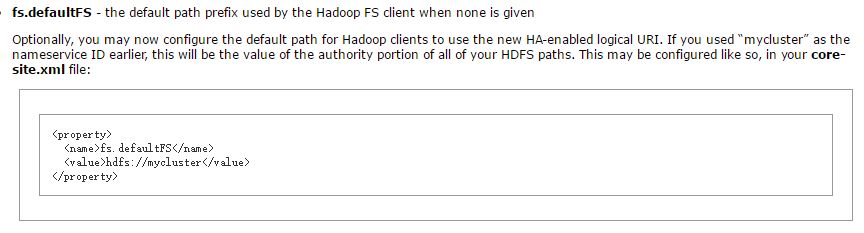

果然还是不放心,搜到Hadoop的官方帮助文档里面找到了必须一致的原因。

而Hadoop会去DNS服务器解析 fs.defaultFS 的authority是不是一个主机,

所以最终是修改hosts使 fs.defaultFS 的authority指向0.0.0.0来加速这个问题,还要同步各个机器上的hosts文件。

当然如果有内网DNS服务器就不用这么麻烦了。

995

995

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?