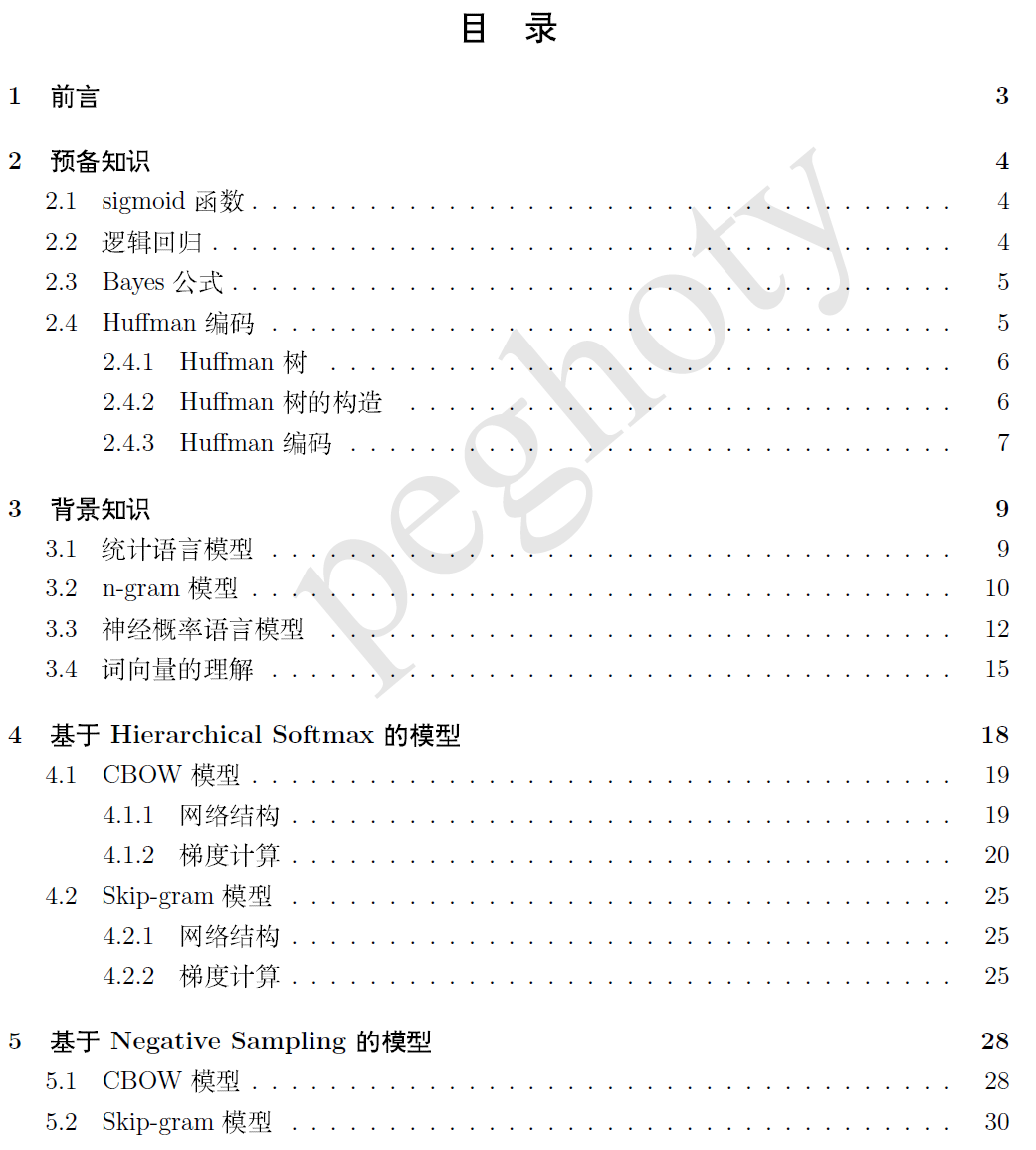

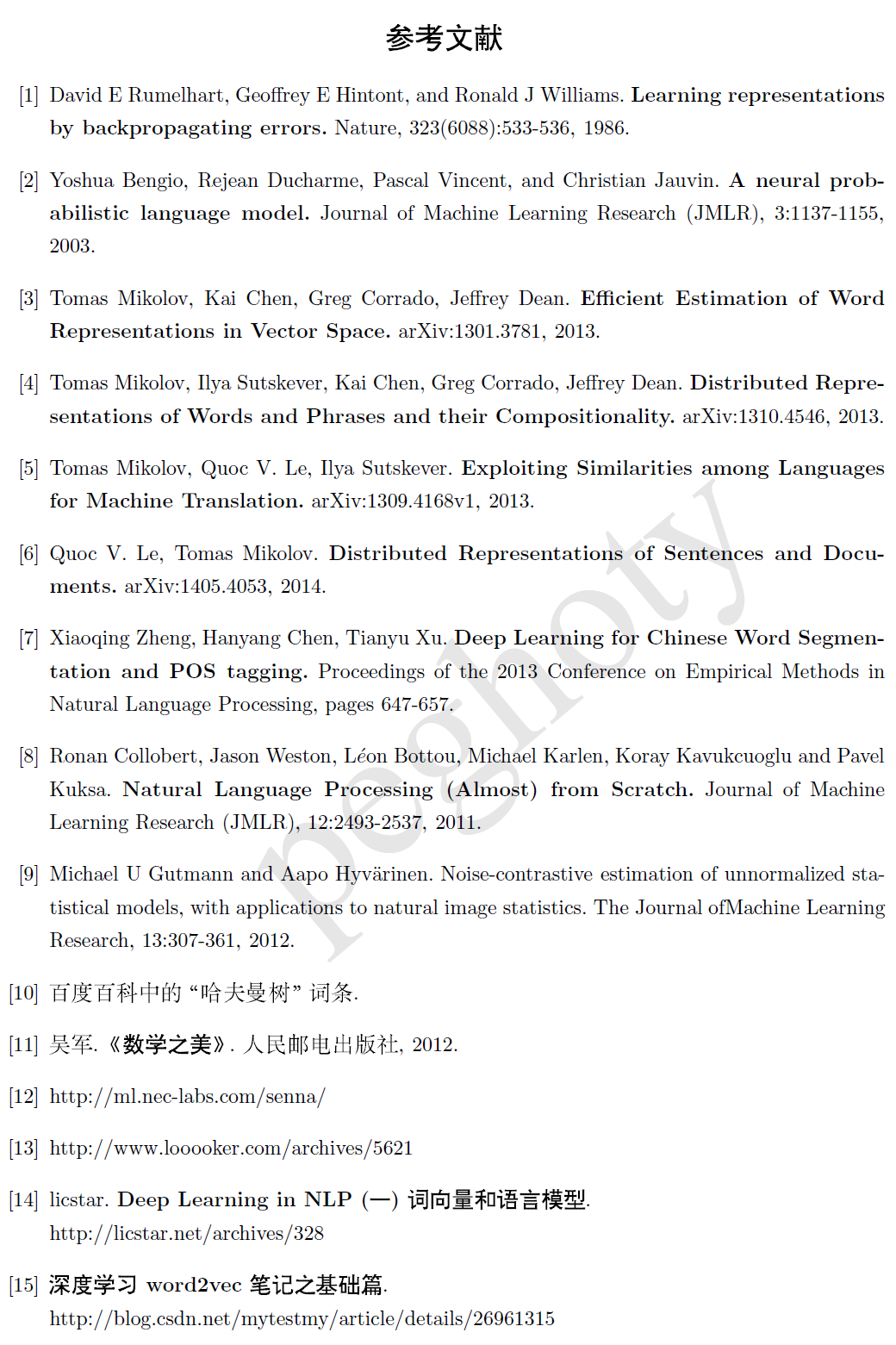

(一)目录和前言

(二)预备知识

(三)背景知识

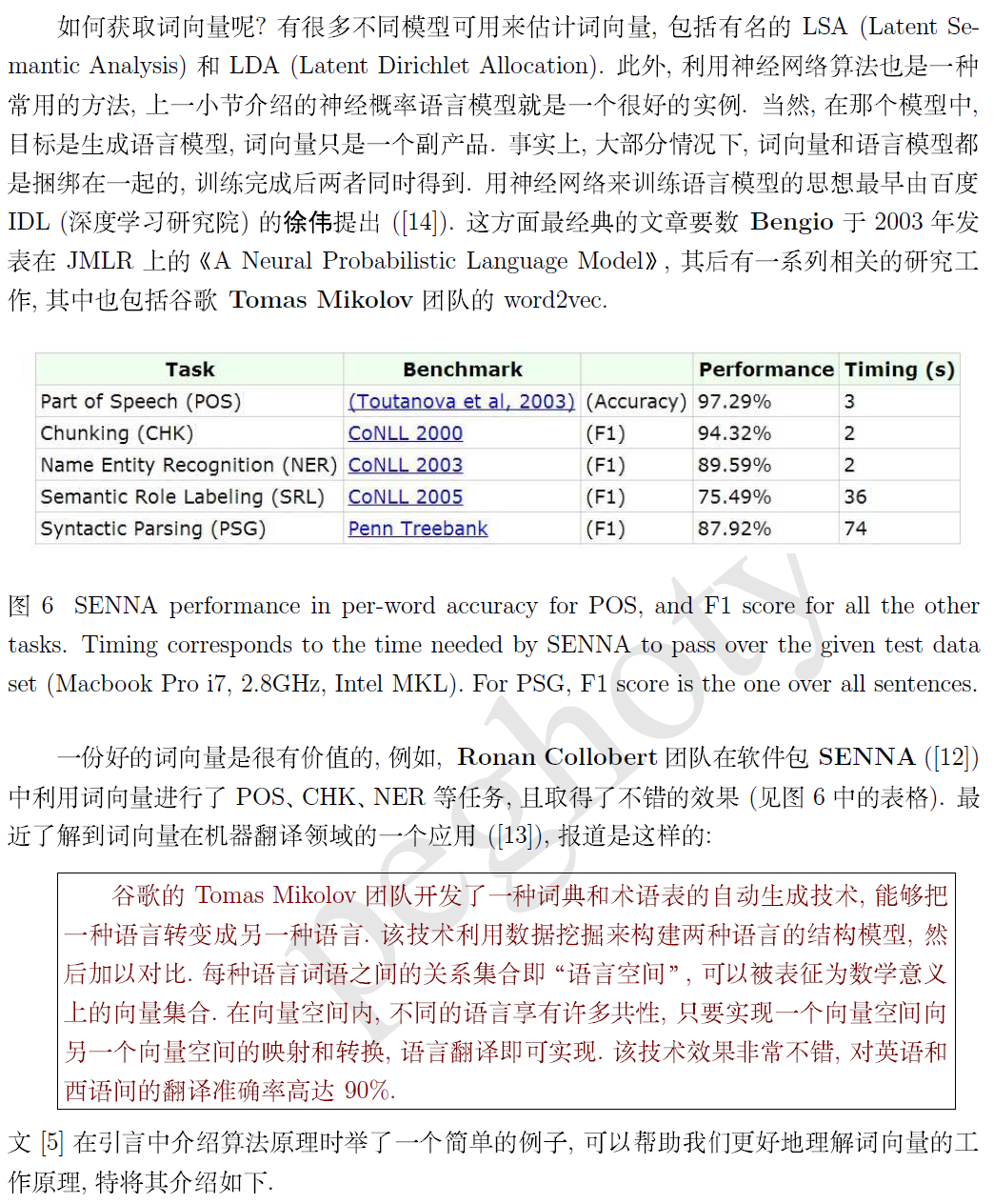

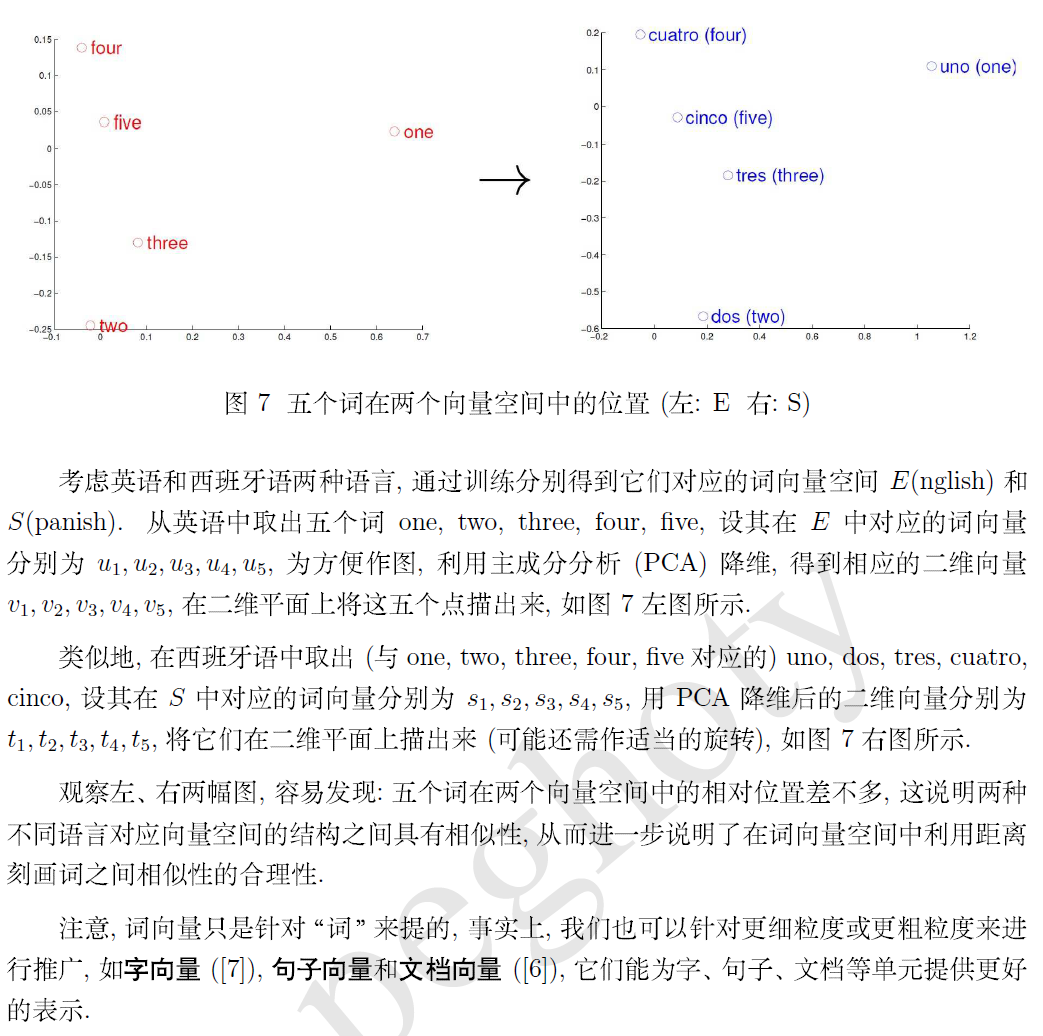

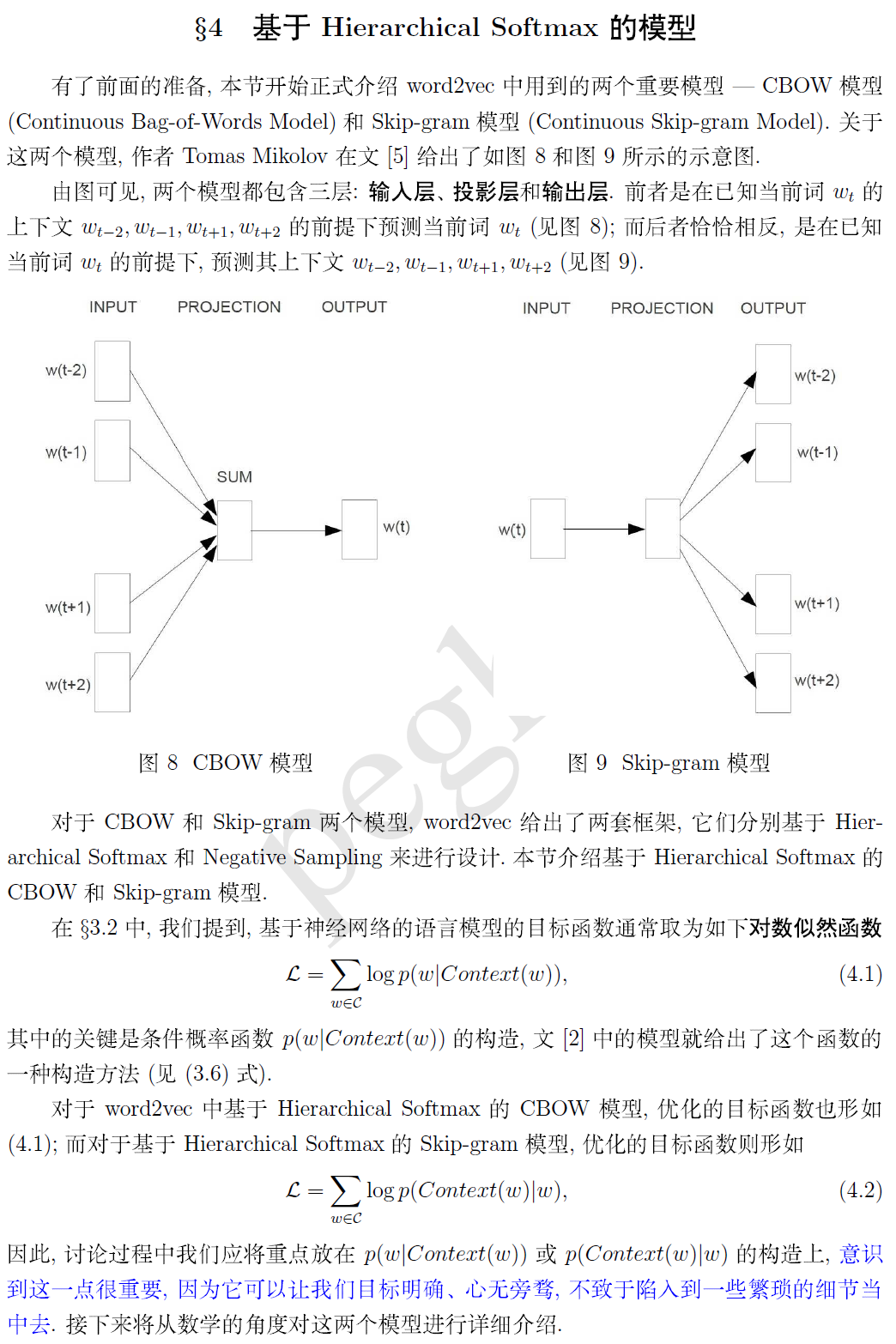

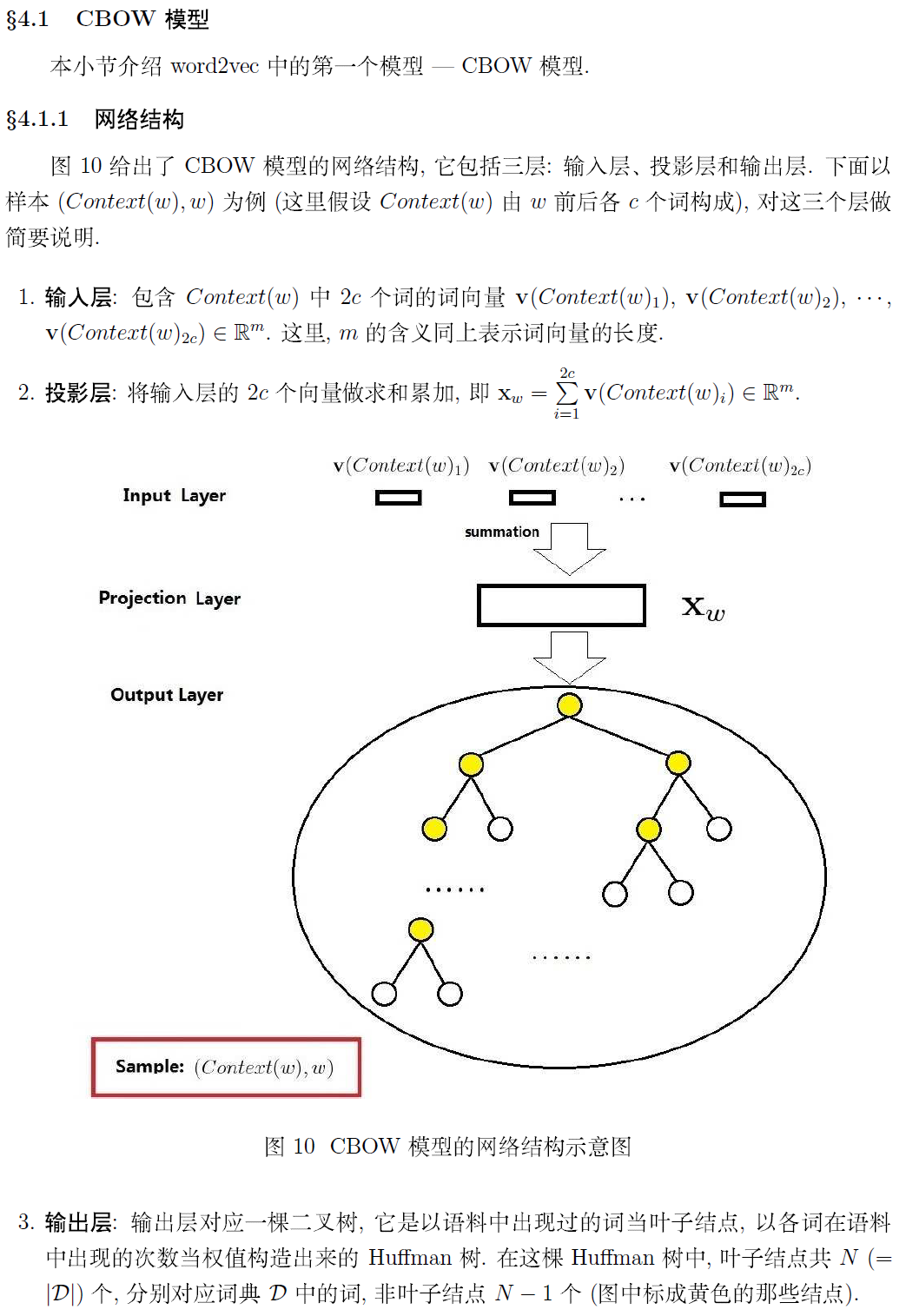

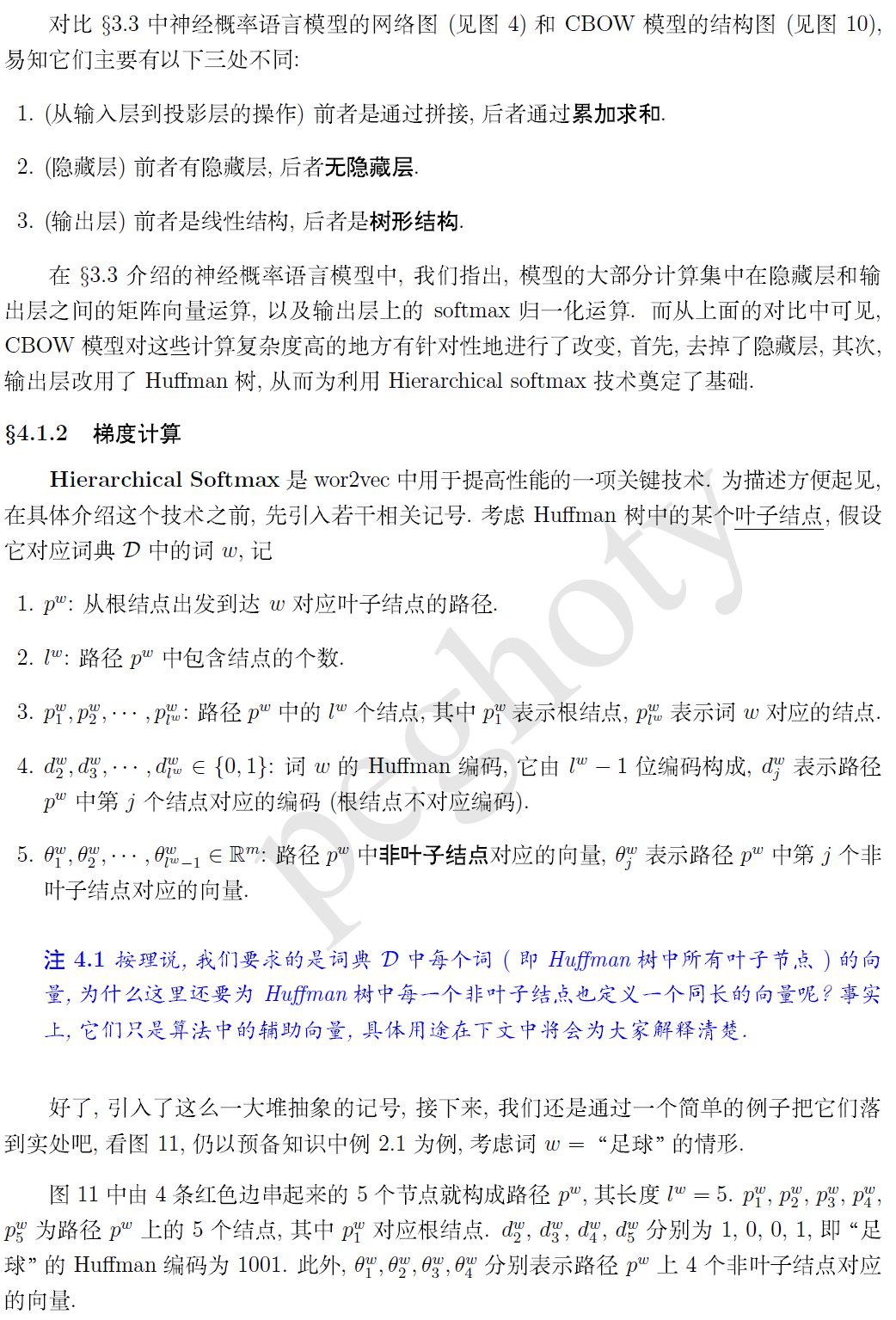

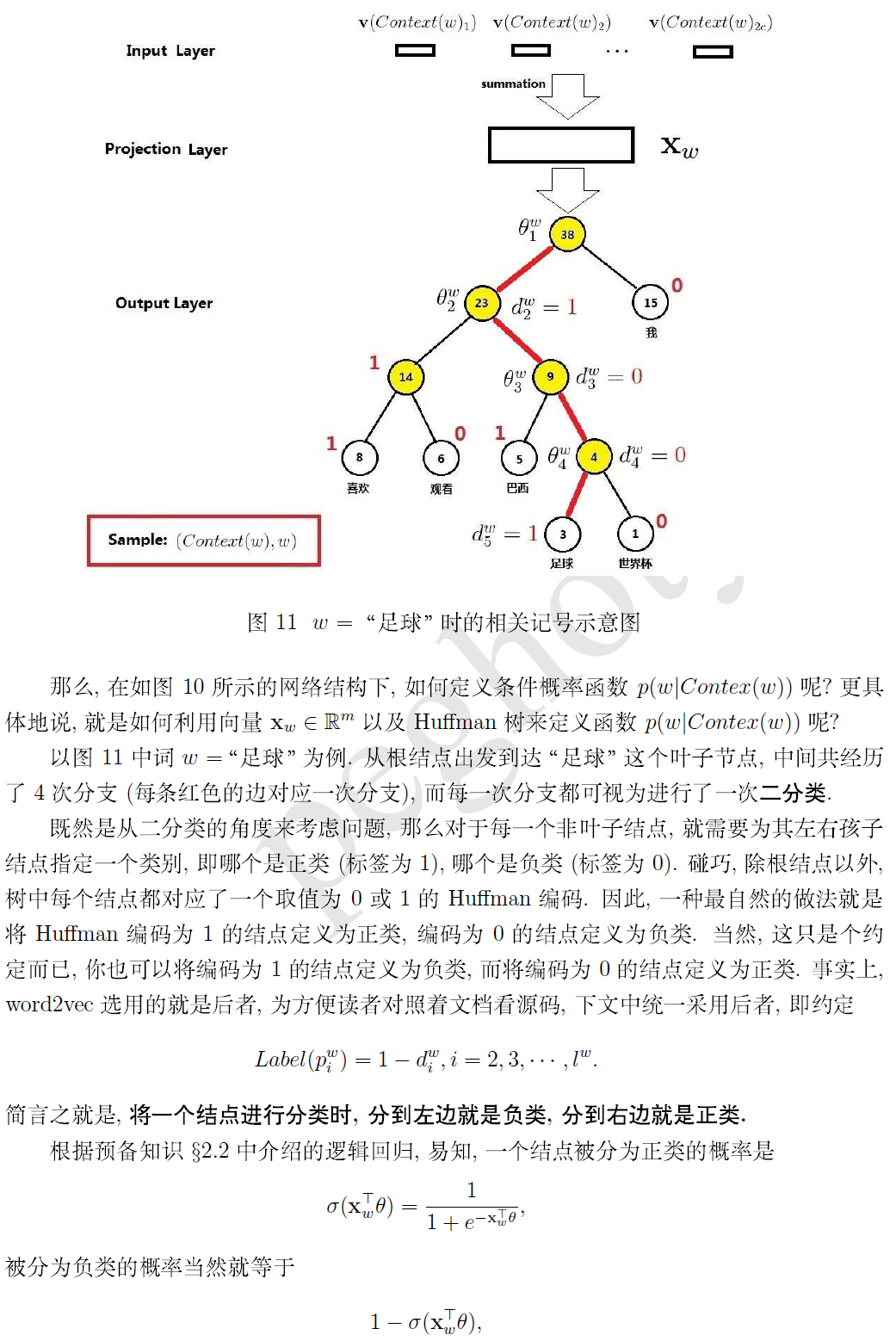

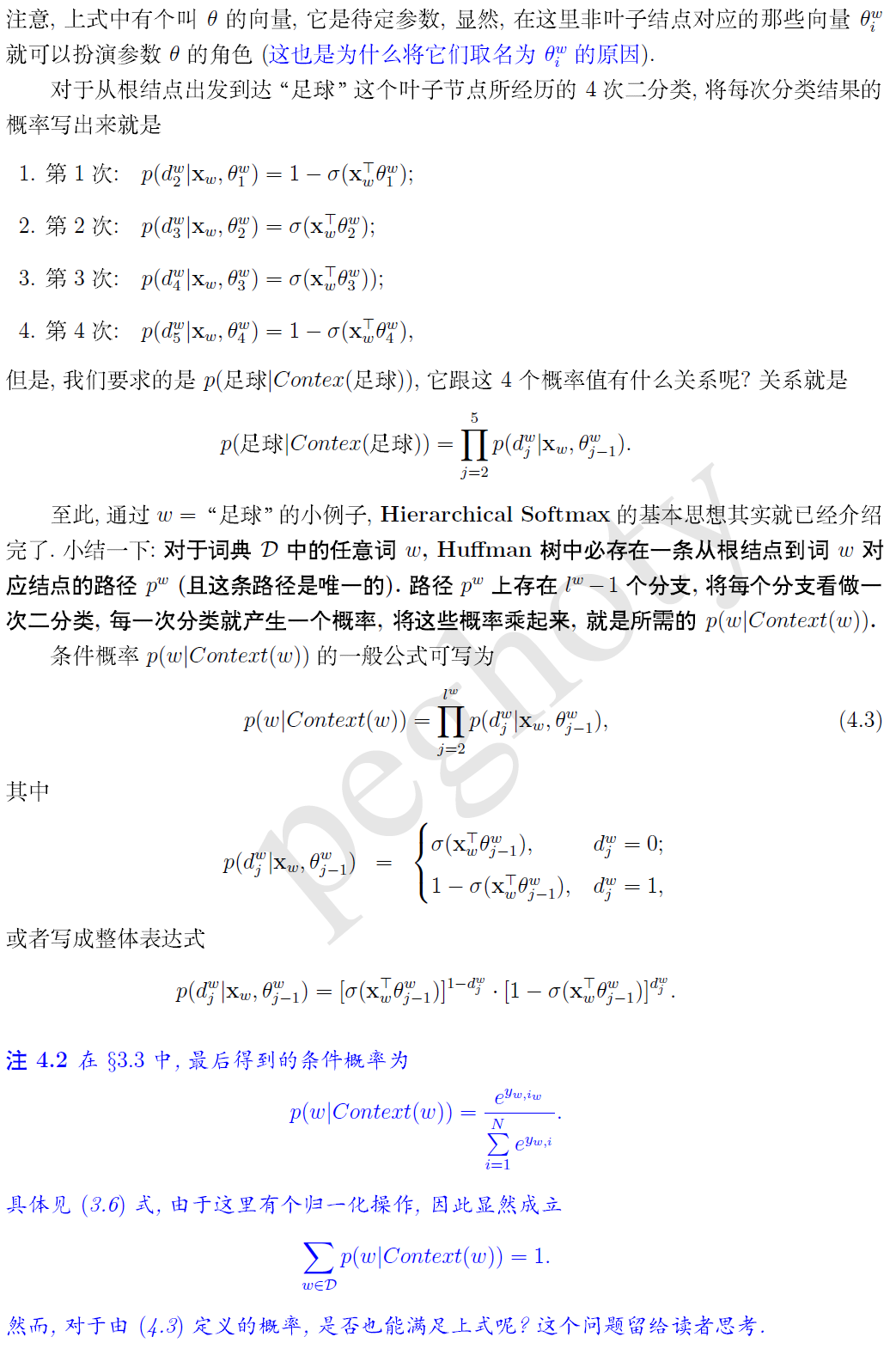

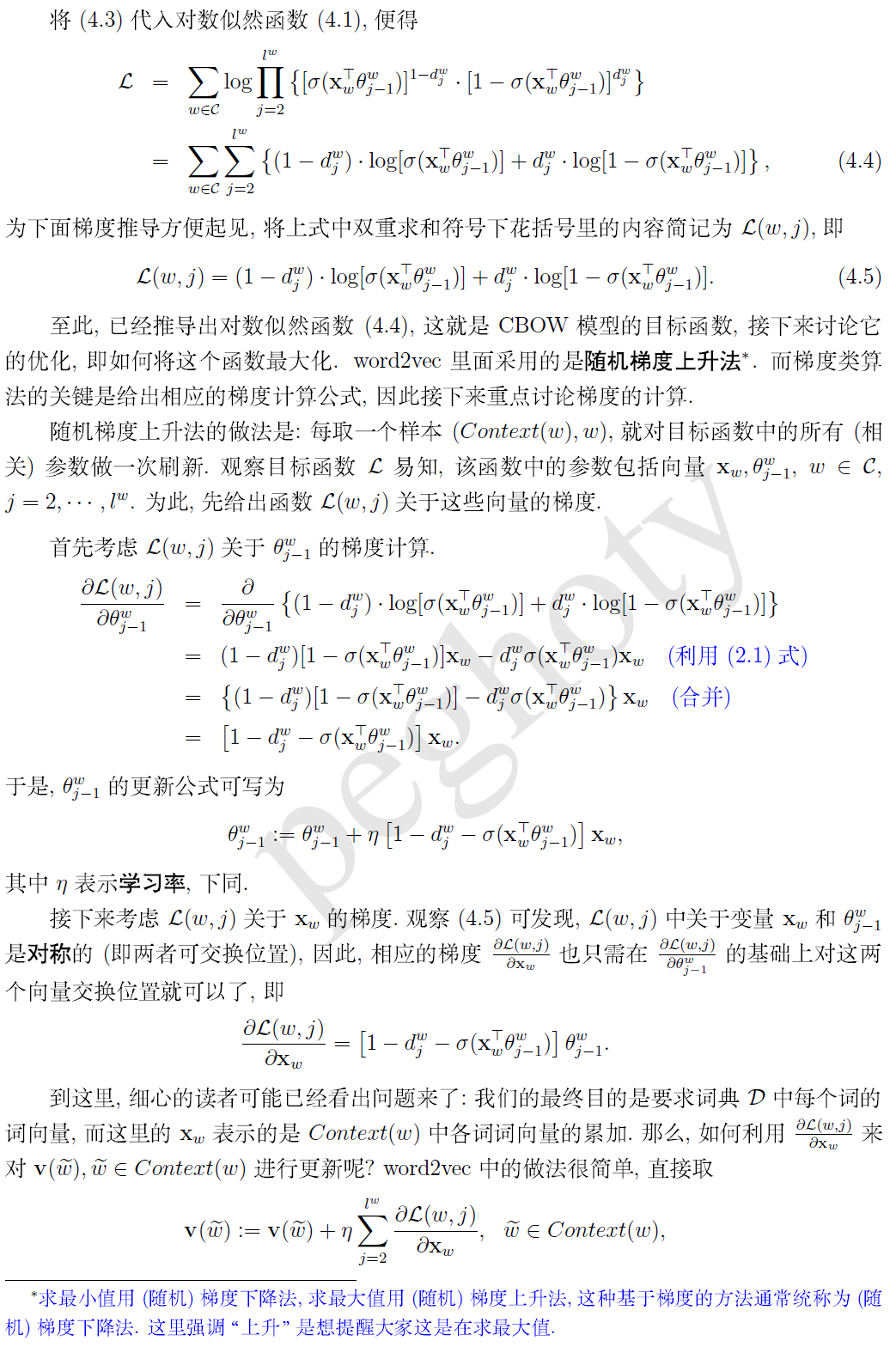

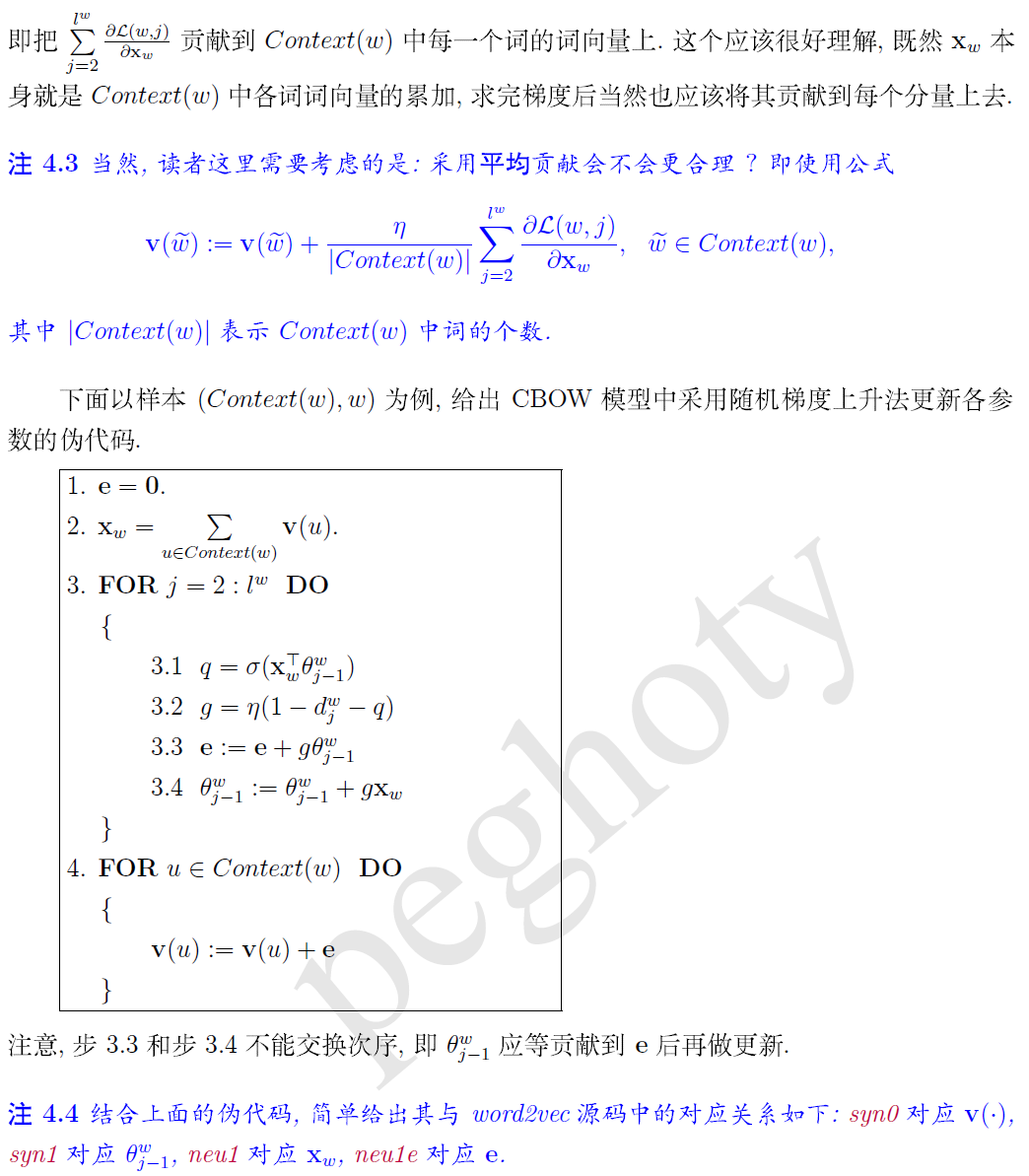

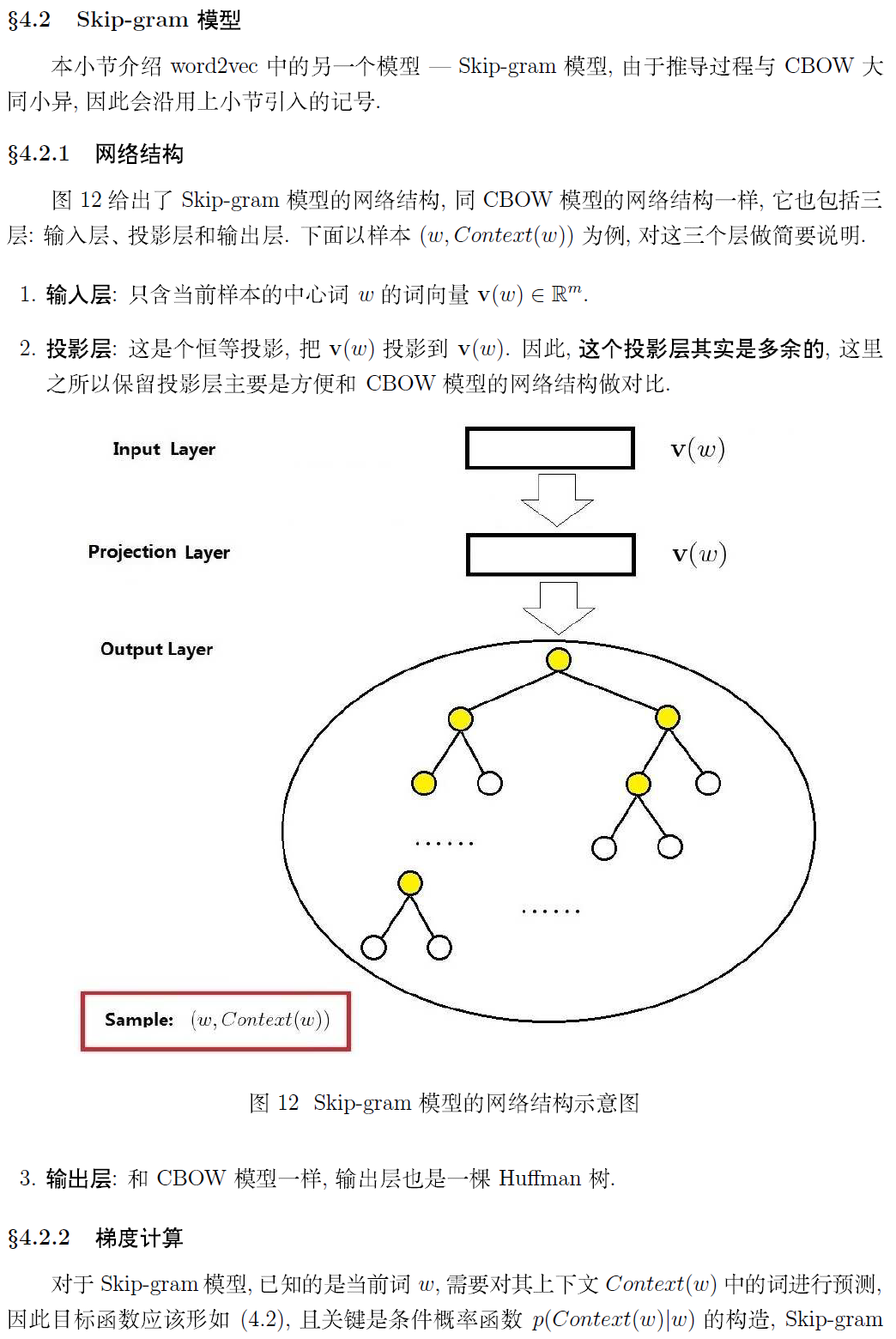

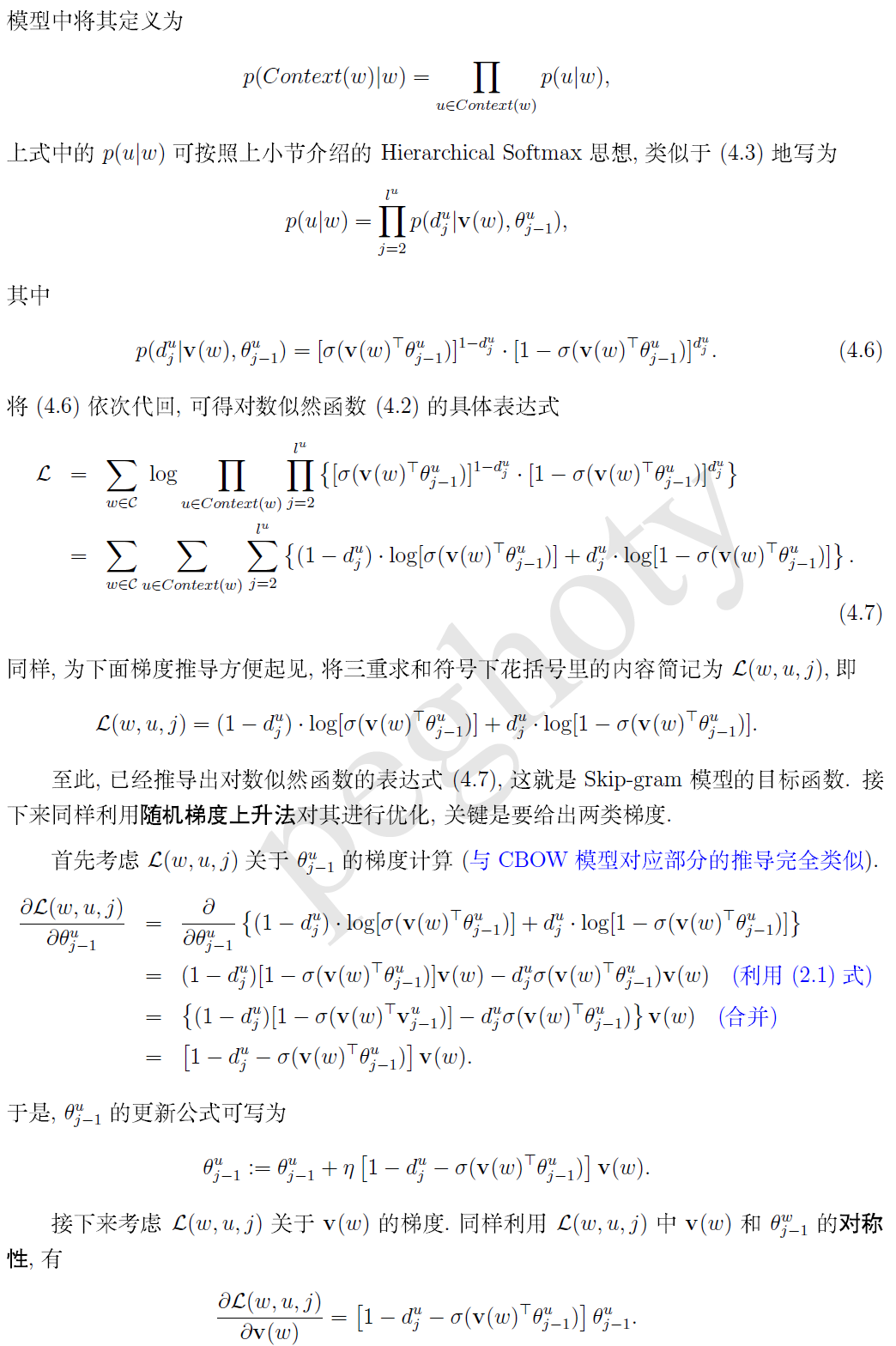

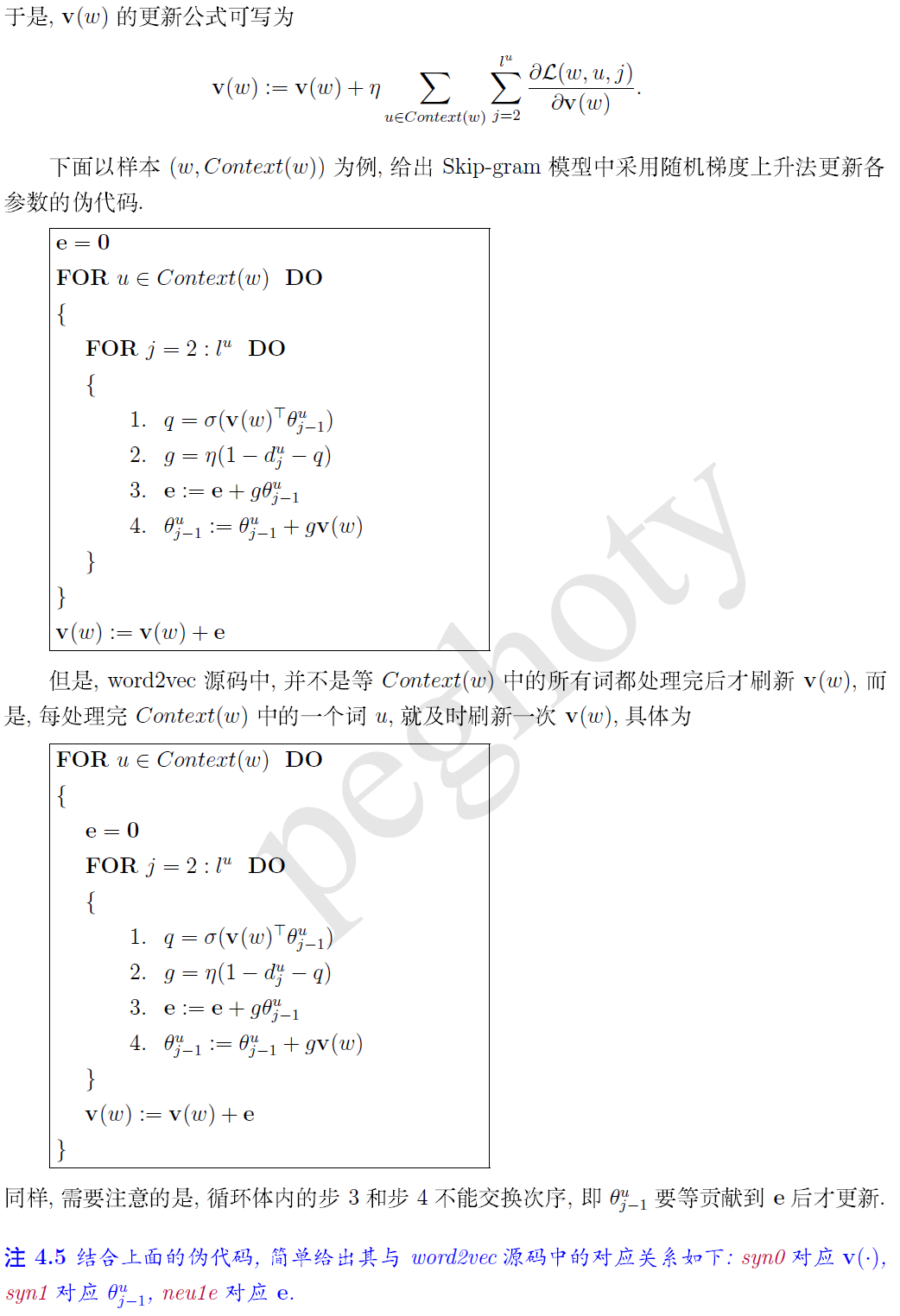

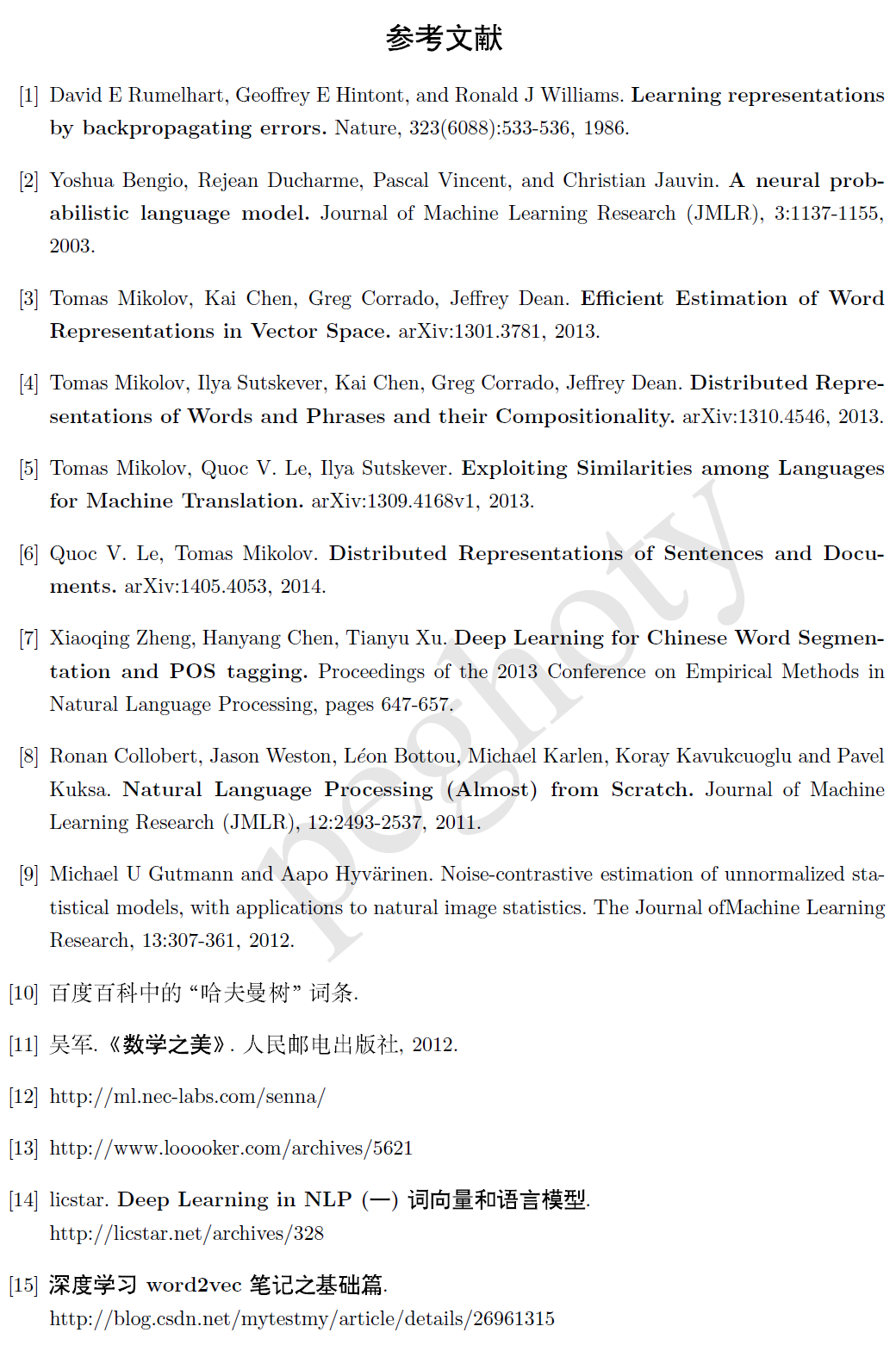

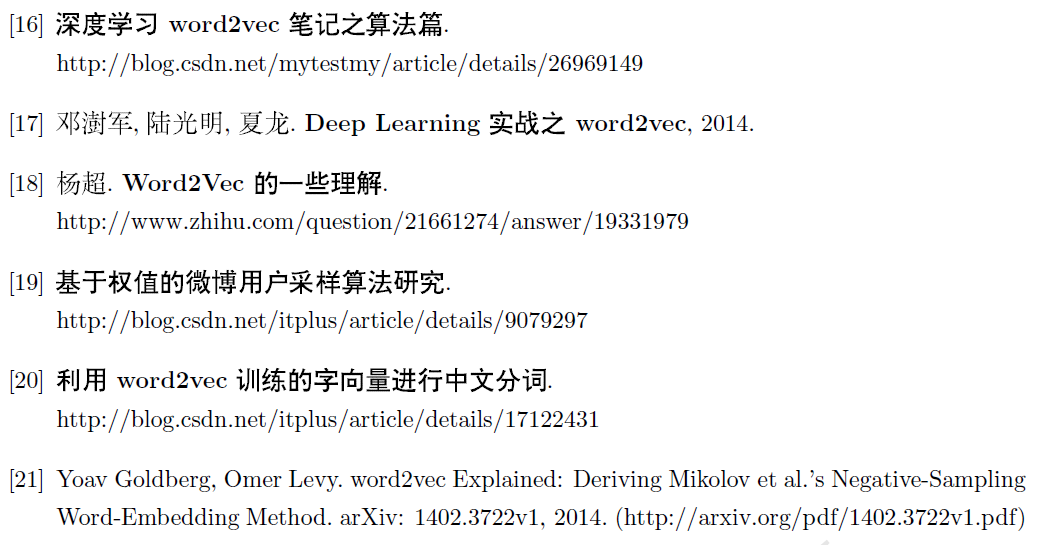

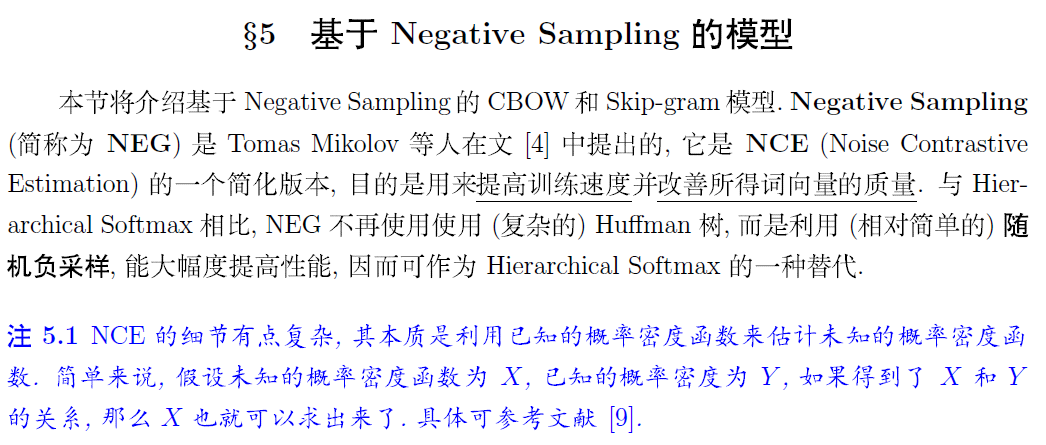

(四)基于 Hierarchical Softmax 的模型

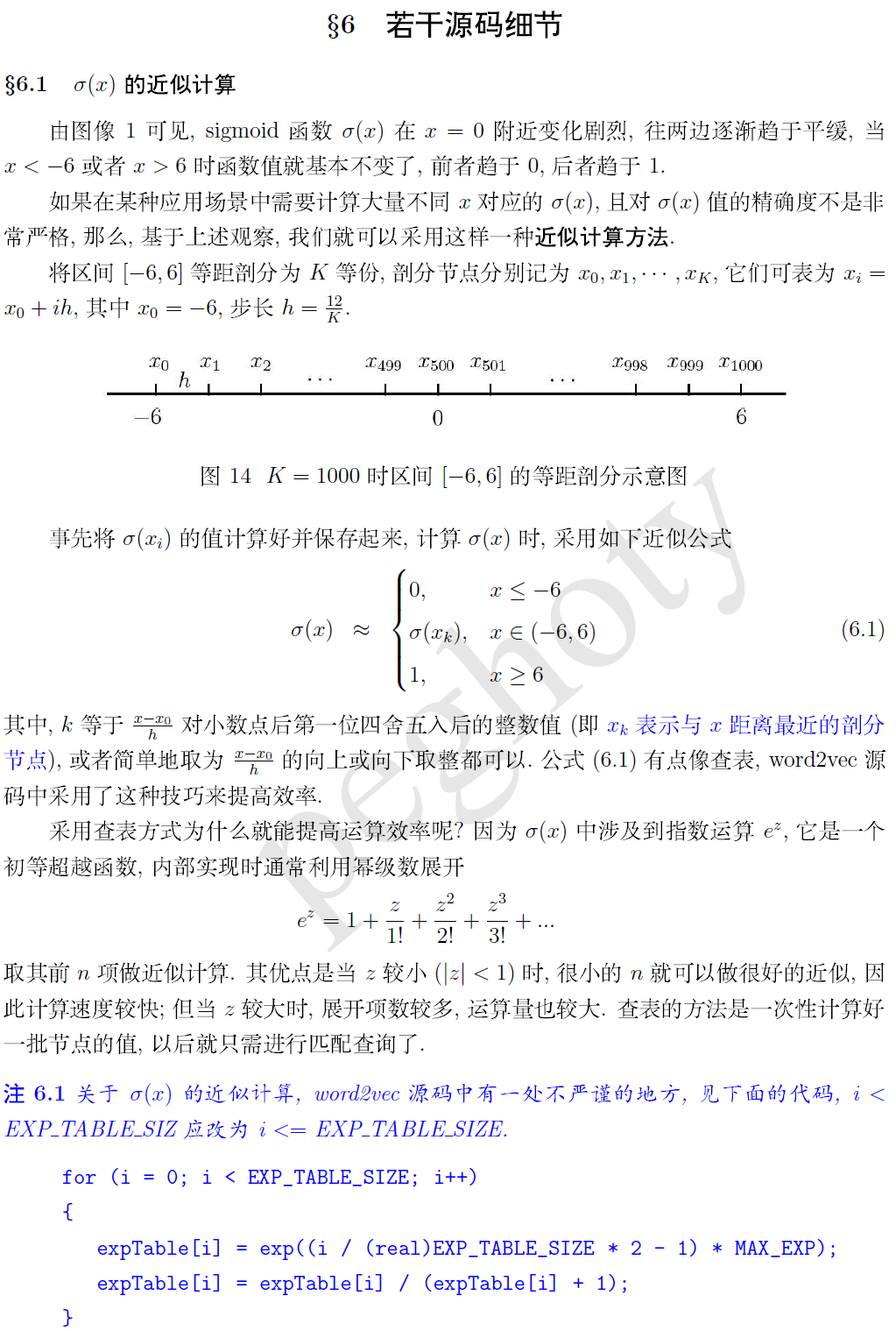

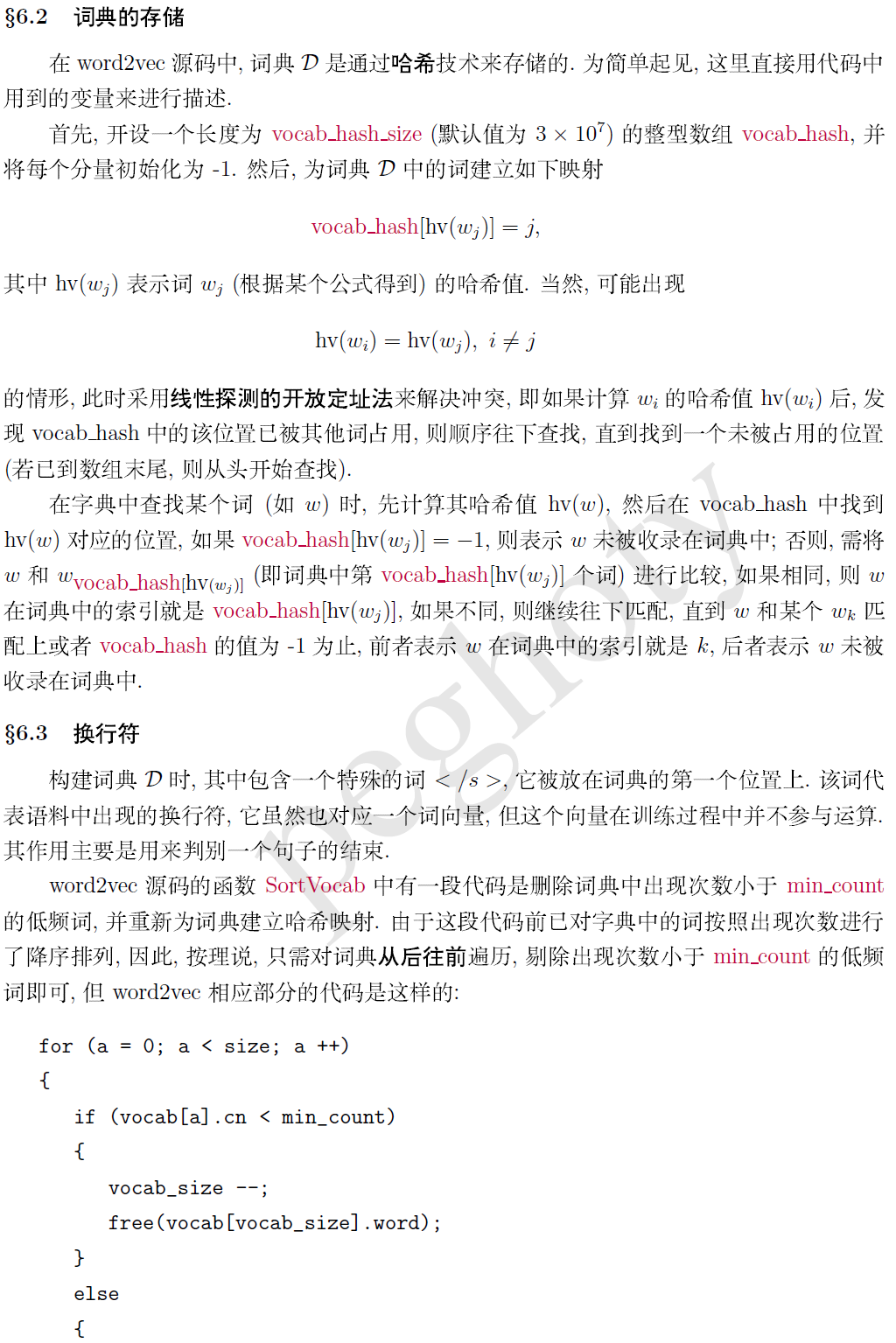

(六)若干源码细节

作者: peghoty

出处: http://blog.csdn.net/itplus/article/details/37969519

欢迎转载/分享, 但请务必声明文章出处.

作者: peghoty

出处: http://blog.csdn.net/itplus/article/details/37969635

欢迎转载/分享, 但请务必声明文章出处.

作者: peghoty

出处: http://blog.csdn.net/itplus/article/details/37969817

欢迎转载/分享, 但请务必声明文章出处.

作者: peghoty

出处: http://blog.csdn.net/itplus/article/details/37969979

欢迎转载/分享, 但请务必声明文章出处.

作者: peghoty

出处: http://blog.csdn.net/itplus/article/details/37998797

欢迎转载/分享, 但请务必声明文章出处.

作者: peghoty

出处: http://blog.csdn.net/itplus/article/details/37999613

欢迎转载/分享, 但请务必声明文章出处.

本文详细介绍了基于HierarchicalSoftmax和NegativeSampling两种模型在自然语言处理中的应用原理及其实现细节,包括模型背景、核心算法介绍以及具体的源码分析。

本文详细介绍了基于HierarchicalSoftmax和NegativeSampling两种模型在自然语言处理中的应用原理及其实现细节,包括模型背景、核心算法介绍以及具体的源码分析。

26万+

26万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?