- 引言

近年来,人工智能(AI)领域取得了突破性进展,尤其是以GPT、BERT、PaLM等为代表的大规模预训练模型(Large Language Models, LLMs)在自然语言处理(NLP)、计算机视觉(CV)和多模态任务中展现出惊人的能力。这些大模型不仅能够理解和生成高质量的自然语言文本,还能适应多种下游任务,极大地推动了AI技术的落地应用。

然而,大模型的训练和微调涉及复杂的算法、庞大的计算资源和精细的优化策略。本文将从大模型的基本原理出发,深入剖析其核心算法,并探讨如何在实际业务中进行训练和微调,最终实现AI大模型的落地应用。

- 大模型的核心原理

2.1 预训练与微调范式

大模型的核心思想是“预训练+微调”(Pre-training + Fine-tuning)。预训练阶段,模型通过海量无监督或自监督数据学习通用的语言或视觉表示;微调阶段,模型在特定任务的小规模标注数据上进行优化,使其适应具体应用场景。

预训练(Pre-training):

大模型通常采用Transformer架构,通过自回归(如GPT)或自编码(如BERT)方式在大规模语料上进行训练。例如:

GPT系列(Generative Pre-trained Transformer)采用自回归(Auto-Regressive)方式,逐词预测下一个token。

BERT(Bidirectional Encoder Representations from Transformers)采用掩码语言建模(MLM),通过上下文预测被遮蔽的单词。

微调(Fine-tuning):

在预训练模型的基础上,使用特定任务(如文本分类、机器翻译)的标注数据进行有监督训练,调整模型参数以适应目标场景。

2.2 Transformer架构

Transformer是当前大模型的基石,其核心组件包括:

自注意力机制(Self-Attention):计算输入序列中每个token与其他token的相关性,捕捉长距离依赖关系。

多头注意力(Multi-Head Attention):并行运行多组自注意力机制,增强模型的表达能力。

位置编码(Positional Encoding):为输入序列添加位置信息,弥补Transformer本身不具备顺序感知的缺陷。

前馈神经网络(Feed-Forward Network, FFN):对每个token进行非线性变换,增强模型的表示能力。

2.3 大模型的优化策略

由于大模型的参数量巨大(如GPT-3有1750亿参数),训练过程面临计算资源、内存和优化效率的挑战。常见的优化方法包括:

混合精度训练(Mixed Precision Training):结合FP16和FP32计算,减少显存占用并加速训练。

梯度检查点(Gradient Checkpointing):通过牺牲计算时间换取显存优化,使大模型能在有限GPU上训练。

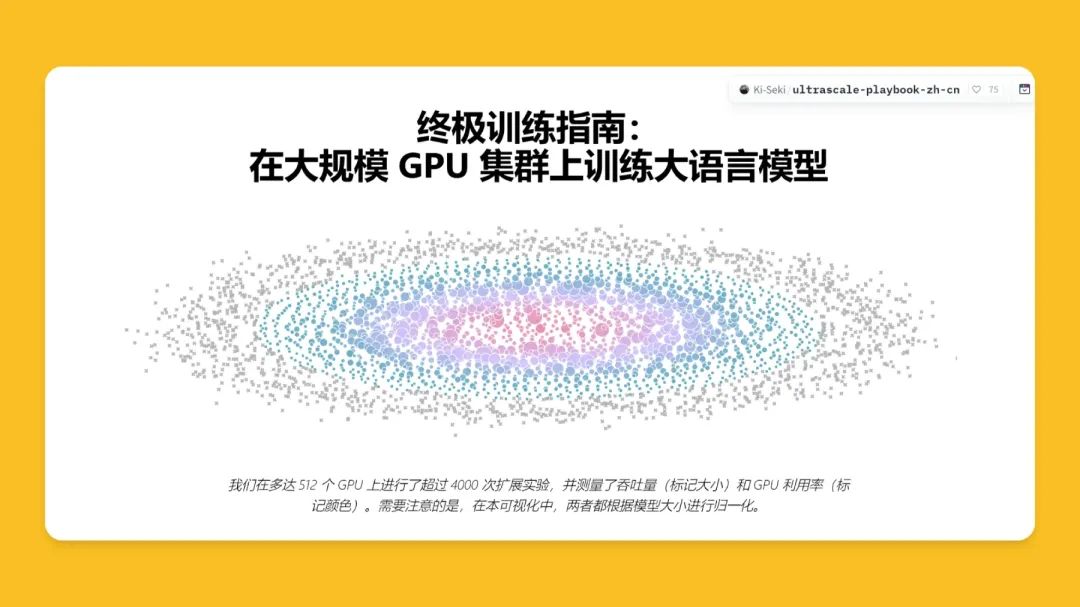

分布式训练(Distributed Training):采用数据并行(Data Parallelism)、模型并行(Model Parallelism)或流水线并行(Pipeline Parallelism)加速训练。

- 大模型的训练与微调实战

3.1 数据准备

大模型的训练依赖高质量数据,通常需要:

大规模无监督数据(如Common Crawl、Wikipedia)用于预训练。

高质量标注数据(如GLUE、SuperGLUE)用于微调。

数据预处理步骤包括:

数据清洗:去除噪声、重复和低质量样本。

分词(Tokenization):使用Byte Pair Encoding(BPE)或WordPiece将文本转换为模型可处理的token。

数据增强(可选):通过回译(Back Translation)、同义词替换等方法扩充训练数据。

3.2 预训练流程

以GPT-3为例,其训练流程包括:

模型初始化:随机初始化或加载预训练权重。

批量训练:使用大规模语料,通过自回归损失(Cross-Entropy)优化模型。

学习率调度:采用余弦退火(Cosine Annealing)或线性预热(Linear Warmup)策略调整学习率。

模型评估:在验证集上监控困惑度(Perplexity)等指标。

3.3 微调策略

微调的目标是让大模型适应特定任务,常见方法包括:

全参数微调(Full Fine-tuning):更新所有模型参数,适用于数据量较大的场景。

参数高效微调(Parameter-Efficient Fine-tuning, PEFT):仅调整部分参数,如:

Adapter:在Transformer层中插入小型网络模块。

Lora(Low-Rank Adaptation):通过低秩矩阵分解优化权重更新。

Prompt Tuning:通过学习软提示(Soft Prompts)调整模型行为。

3.4 模型评估与优化

微调后,需在测试集上评估模型性能,常见指标包括:

NLP任务:准确率(Accuracy)、F1分数、BLEU(机器翻译)、ROUGE(文本摘要)。

CV任务:Top-1/Top-5准确率、mAP(目标检测)。

若模型表现不佳,可尝试:

调整超参数(如学习率、批量大小)。

数据增强或引入更多标注数据。

模型蒸馏(Knowledge Distillation):用大模型训练轻量级模型,提升推理效率。

- 大模型的落地挑战与解决方案

4.1 计算资源限制

大模型的推理成本高昂,解决方法包括:

模型量化(Quantization):将FP32模型转换为INT8或INT4,减少计算开销。

模型剪枝(Pruning):移除冗余参数,降低模型复杂度。

使用专用推理框架(如TensorRT、ONNX Runtime)加速推理。

4.2 领域适应问题

大模型在通用数据上表现良好,但在垂直领域(如医疗、金融)可能效果不佳。解决方案:

领域自适应预训练(Domain-Adaptive Pre-training):在领域数据上继续预训练。

Few-shot/Zero-shot Learning:利用提示工程(Prompt Engineering)减少对标注数据的依赖。

4.3 伦理与安全风险

大模型可能生成有害内容或存在偏见,需采取:

内容过滤:部署敏感词检测模块。

RLHF(Reinforcement Learning from Human Feedback):通过人类反馈优化模型输出。

- 未来展望

随着AI技术的演进,大模型的发展趋势包括:

多模态大模型(如GPT-4V、PaLM-E)融合文本、图像、视频等多种模态。

更高效的训练方法(如MoE架构、稀疏训练)降低计算成本。

AI民主化:开源社区(如LLaMA、Falcon)推动大模型普及。

- 结论

AI大模型正在重塑人工智能的应用范式,从原理到落地涉及算法、数据、计算资源等多方面挑战。通过深入理解Transformer架构、优化训练策略,并结合高效的微调方法,我们可以更好地利用大模型推动产业智能化。未来,随着技术的进步,大模型将在更多领域发挥巨大潜力。

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?