idea中执行spark sql代码:

spark.sql(“show tables”).show()

spark.sql(“create table user3(id int, name string)”)

。。。。

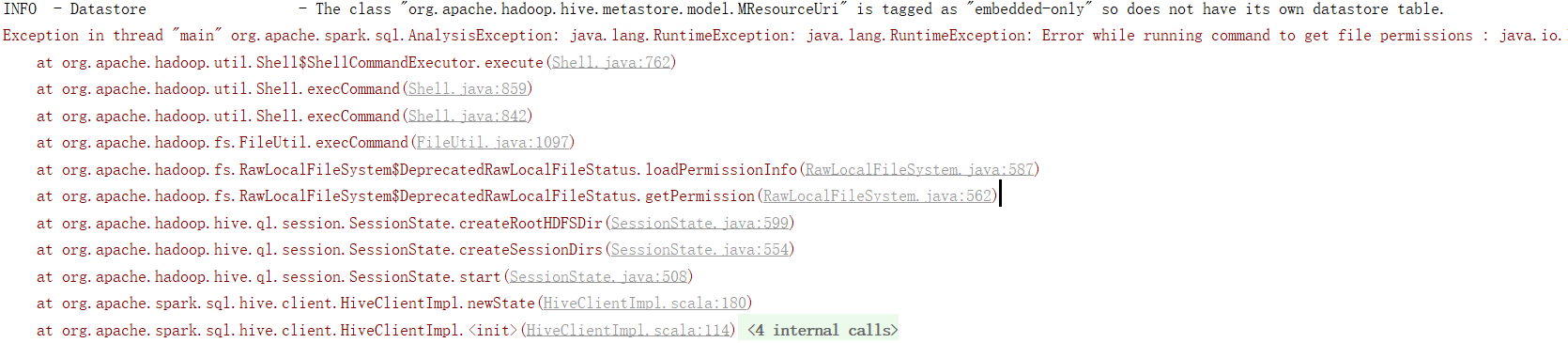

报错:

原因:

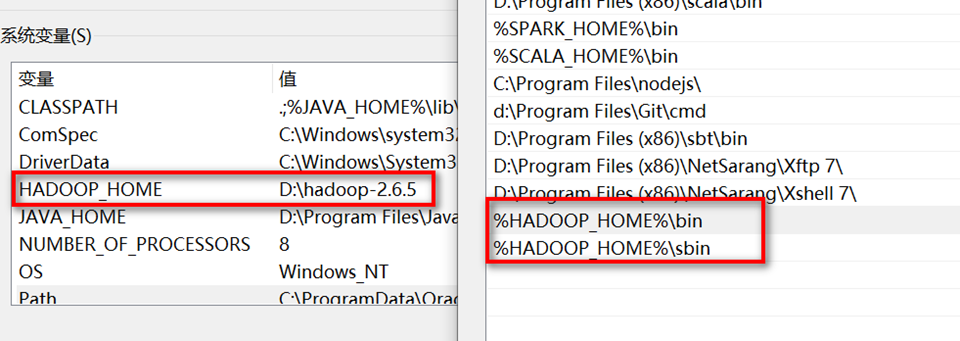

1、Window没有Hadoop的解压文件,更没有配置环境变量

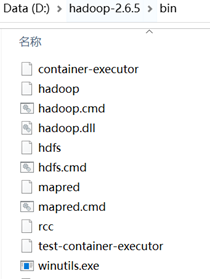

2、缺少winutils.exe和hadoop.dll文件

3、权限没设置

解决:

1、将winutils.exe和hadoop.dll文件拷贝到windows下解压后的hadoop的bin文件夹下

(在Window/System32 下面也copy一份,不是必须)

2、配置环境变量

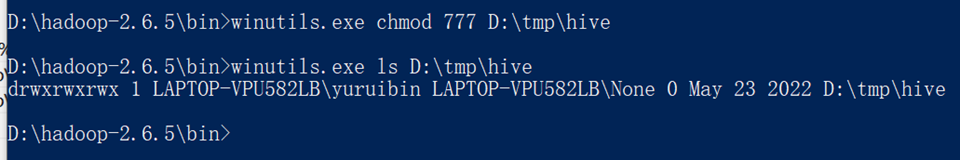

3、打开dos,进入winutils.exe所在目录,修改权限

D:\hadoop-2.6.5\bin>winutils.exe chmod 777 D:\tmp\hive 修改权限

D:\hadoop-2.6.5\bin>winutils.exe ls D:\tmp\hive 查看权限

4、重启idea

5046

5046

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?