视频转绘这么火的赛道下,老铁们怎么能不会呢。下面我们一起来看一看。

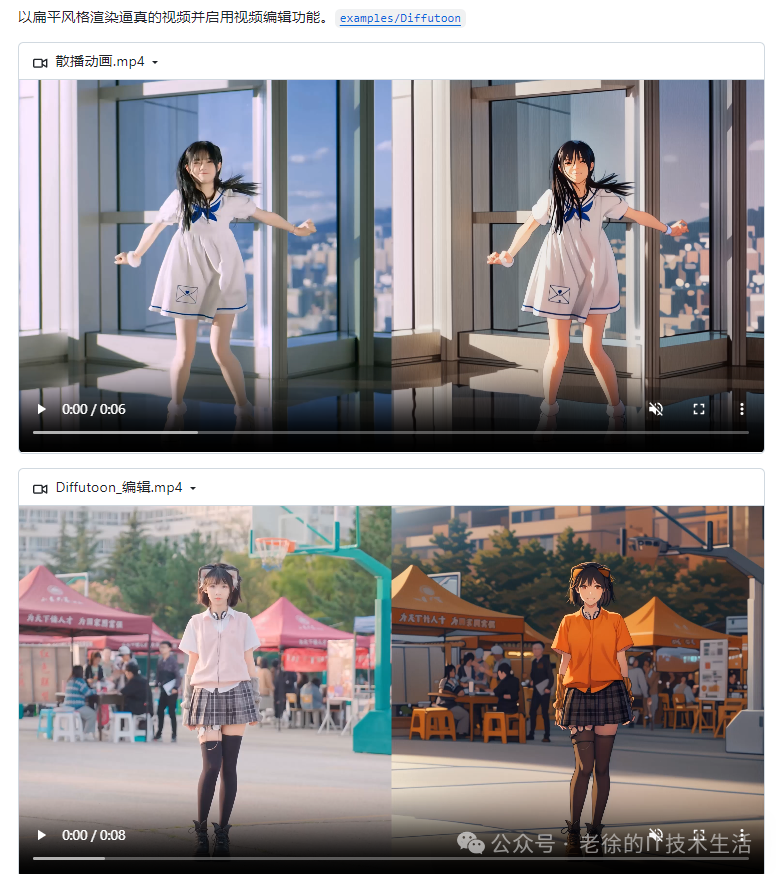

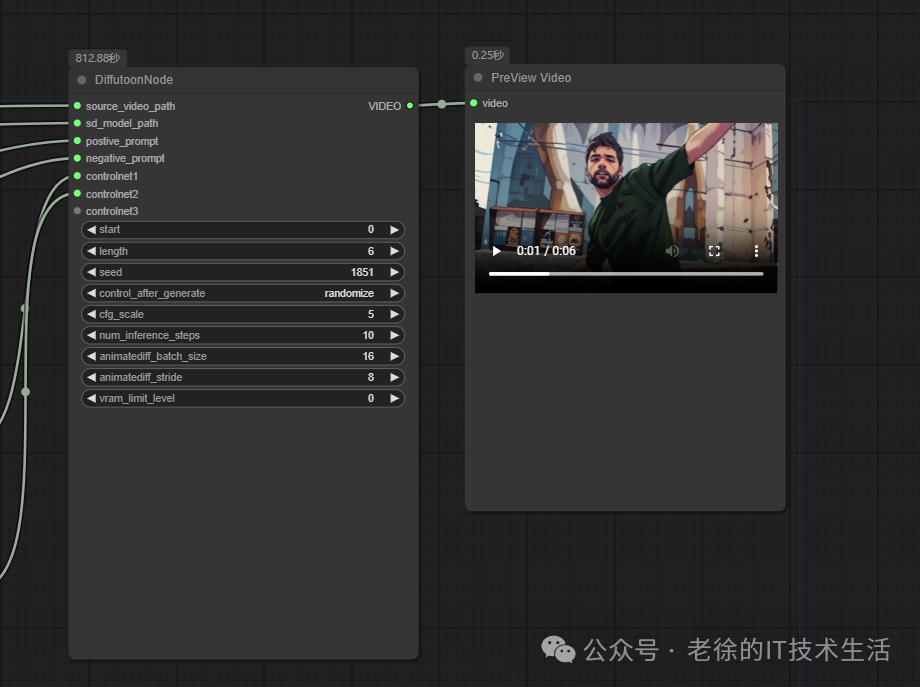

先看下简单转绘的6秒视频,整体耗时大概在10分钟左右,视频的转绘效果及流畅度个人还是比较满意的。

DiffSynth-Studio介绍

**项目地址:

**

https://github.com/modelscope/DiffSynth-Studio

DiffSynth Studio 是一款 Diffusion 引擎。它重构了包括 Text Encoder、UNet、VAE 等在内的架构,在增强计算性能的同时保持了与开源社区模型的兼容性。并且提供了许多有趣的功能。

到目前为止,DiffSynth Studio 支持以下模型:

CogVideo、FLUX、ExVideo、Kolors、Stable Diffusion 3、Stable Video Diffusion、Hunyuan-DiT、RIFE、ESRGAN、Ip-Adapter、AnimateDiff、ControlNet、Stable Diffusion XL、Stable Diffusion

是的你没看错,连目前很火的Flux以及CogVideoX-5b也都是支持的。

视频合成:

这份完整版的AIGC全套学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

长视频合成:

卡通着色:

视频风格化:

图像合成:

生成高分辨率图像,突破扩散模型的限制!支持Lora 微调。

好了,关于DiffSynth-Studio就简单介绍这么多,想了解更多详细的内容请访问上面的项目地址。

接下来我们看看基于DiffSynth-Studio的视频转动漫工作流。

工作流介绍

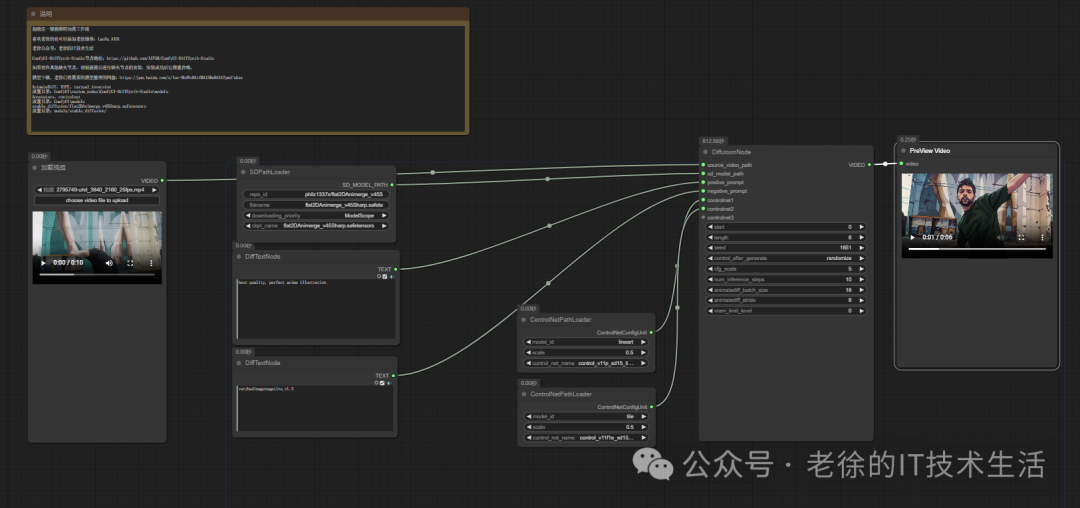

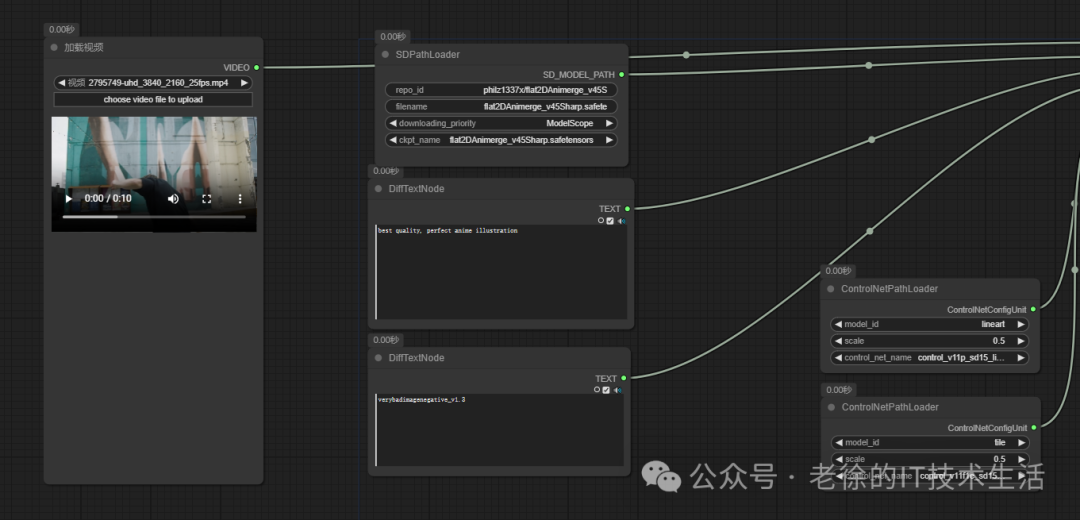

工作流下载后导入到ComfyUI中,如果存在缺失节点,请根据提示进行缺失节点的安装,安装成功后记得重启哦。

ComfyUI-DiffSynth-Studio节点地址:

https://github.com/AIFSH/ComfyUI-DiffSynth-Studio

本工作流涉及到以下模型(已将需要的模型整理到了网盘,可文末获取):

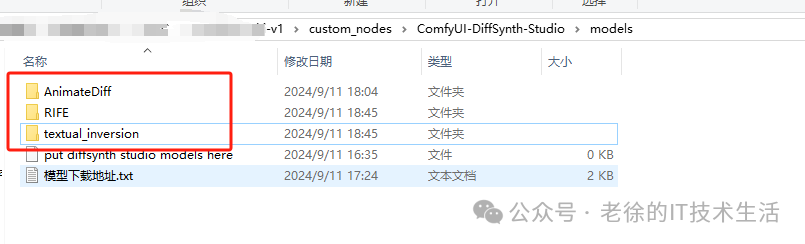

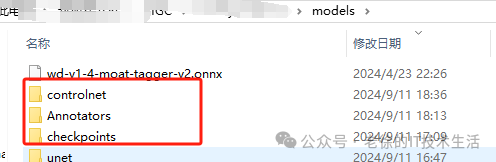

AnimateDiff、RIFE、textual_inversion、Annotators、controlnet、stable_diffusion/flat2DAnimerge_v45Sharp.safetensors

模型放置位置:

AnimateDiff、RIFE、textual_inversion放置目录:

ComfyUI\custom_nodes\ComfyUI-DiffSynth-Studio\models

Annotators、controlnet放置目录:

ComfyUI\models

stable_diffusion/flat2DAnimerge_v45Sharp.safetensors放置目录:

models/stable_diffusion/

整个工作流相对也比较简单,前半部分是需要转换视频的上传及模型、ControlNet控制节点。

后面两个节点分别是视频转绘处理Diffutoon节点和视频预览节点。在Diffutoon节点中可以调整生成视频的参数。这里通过start参数可以控制从视频的哪一秒开始着色转换,length可调整视频的生成长度。如果您的本地配置不高可以尝试降低animatediff_batch_size和animatediff_stride的值。

好了,今天的分享就到这里了,感兴趣的赶快下载试玩吧~~

这份完整版的AIGC全套学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?