实现NLP与CV大模型的流程指南

在当今的科技领域,NLP(自然语言处理)和CV(计算机视觉)大模型成为了热门话题。这两种技术结合在一起,可以为我们带来更强大的应用能力,例如图像语义理解和多模态搜索等。本文将为刚入行的小白开发者提供一个清晰的实现流程,以及每一步的代码示例和解释。

流程概述

以下是实现NLP与CV大模型的步骤概述:

| 步骤 | 描述 |

|---|---|

| 1 | 数据准备,包括数据清洗和格式化 |

| 2 | 选择合适的模型架构 |

| 3 | 模型训练 |

| 4 | 模型评估 |

| 5 | 部署模型 |

| 6 | 应用模型 |

详细步骤

1. 数据准备

首先,我们需要收集和清理我们的数据。假设我们有一组图像与其对应的文本描述。

import pandas as pd

from PIL import Image

import os

# 加载数据

data_path = 'data/images_and_captions.csv' # 数据路径

data = pd.read_csv(data_path) # 读取CSV文件

# 清洗数据

data.dropna(inplace=True) # 删除缺失值

data.reset_index(drop=True, inplace=True) # 重置索引

# 加载图像数据

images = []

for img_name in data['image_name']: # 遍历每个图片名称

img_path = os.path.join('data/images/', img_name) # 获取图像路径

images.append(Image.open(img_path)) # 打开图像并添加到列表

上述代码展示了如何读取并清洗CSV中的图像及其描述数据。

2. 选择合适的模型架构

选择一个适合的NLP与CV结合的模型架构是非常重要的。我们可以采用Transformer和CNN的结合。

from transformers import BertModel

import torch.nn as nn

class MultiModalModel(nn.Module):

def __init__(self):

super(MultiModalModel, self).__init__()

self.bert = BertModel.from_pretrained("bert-base-uncased") # NLP部分

# CV部分,这里简化为一个线性层

self.fc = nn.Linear(512, 256)

def forward(self, text, image_features):

text_features = self.bert(text) # 获取文本特征

combined_features = text_features.last_hidden_state + image_features # 特征结合

output = self.fc(combined_features) # 线性变换

return output

以上代码定义了一个简单的多模态模型,其中NLP部分使用了BERT模型。

3. 模型训练

模型训练需要定义损失函数和优化器,并进行训练迭代。

import torch.optim as optim

# 初始化模型

model = MultiModalModel()

criterion = nn.CrossEntropyLoss() # 损失函数

optimizer = optim.Adam(model.parameters(), lr=0.001) # 优化器

# 训练过程

for epoch in range(10): # 迭代10次

model.train()

for i, (text, image_features, labels) in enumerate(train_loader): # 遍历训练数据

optimizer.zero_grad() # 清空梯度

outputs = model(text, image_features) # 模型前向传播

loss = criterion(outputs, labels) # 计算损失

loss.backward() # 反向传播

optimizer.step() # 更新参数

print(f'Epoch [{epoch + 1}/10], Step [{i + 1}/{len(train_loader)}], Loss: {loss.item()}')

此代码负责模型的训练,每个epoch都会对数据进行遍历并优化模型。

4. 模型评估

评估模型的性能需要使用一组测试数据集。

model.eval() # 设置模型为评估模式

total, correct = 0, 0

with torch.no_grad(): # 不计算梯度

for text, image_features, labels in test_loader:

outputs = model(text, image_features) # 前向传播

_, predicted = torch.max(outputs.data, 1) # 取最大值

total += labels.size(0) # 总样本数

correct += (predicted == labels).sum().item() # 预测正确的数量

print(f'Accuracy: {100 * correct / total:.2f}%') # 打印准确率

在评估阶段,我们使用测试集来检查模型的性能。

5. 部署模型

将模型部署到线上环境通常需要保存模型和加载。

# 保存模型

torch.save(model.state_dict(), 'multi_modal_model.pth')

# 加载模型

loaded_model = MultiModalModel()

loaded_model.load_state_dict(torch.load('multi_modal_model.pth'))

这段代码负责将训练好的模型进行保存和加载。

6. 应用模型

在应用模型时,我们输入新的数据进行推测。

# 新数据预测

model.eval()

with torch.no_grad():

new_text = "A cat on a roof."

new_image_features = extract_image_features(new_image) # 提取图像特征

prediction = model(new_text, new_image_features)

print(f'Predicted label: {prediction.argmax()}') # 输出预测结果

以上代码展示如何将模型应用于实际数据。

序列图

sequenceDiagram

participant D as 数据准备

participant M as 模型选择

participant T as 模型训练

participant E as 模型评估

participant DP as 模型部署

participant A as 模型应用

D->>M: 数据处理完毕

M->>T: 选择好模型架构

T->>E: 模型训练完成

E->>DP: 性能评估良好

DP->>A: 模型部署成功

结论

通过上述步骤,我们可以构建一个简单的NLP与CV大模型。本文从数据准备开始,逐步引导你走过模型选择、训练、评估、部署及应用的各个阶段。尽管实现一个大模型的过程中会遇到许多挑战,但随着经验的积累,你会逐渐熟悉并掌握这些方法。希望这篇指南能够帮助你在NLP与CV的结合应用中找到方向与信心!

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

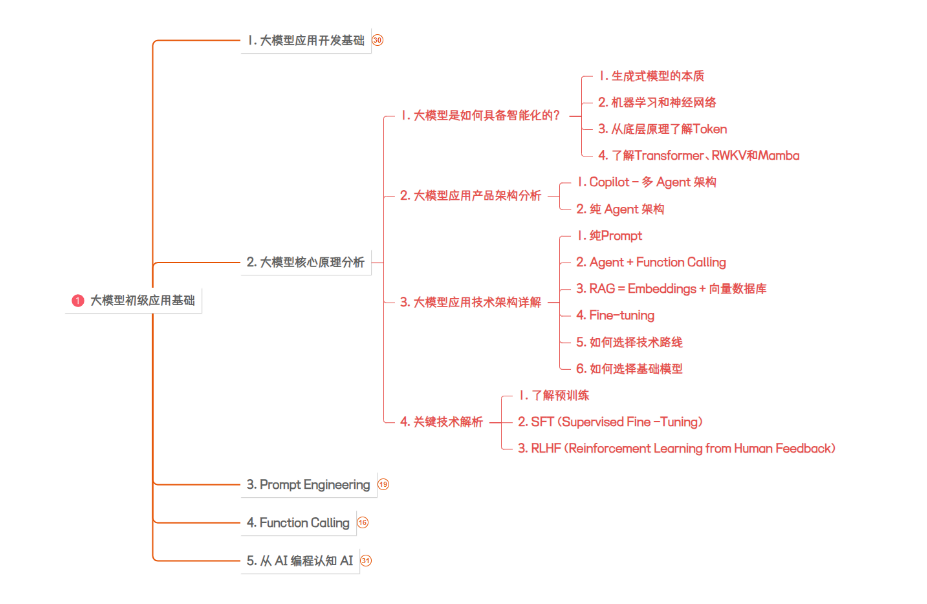

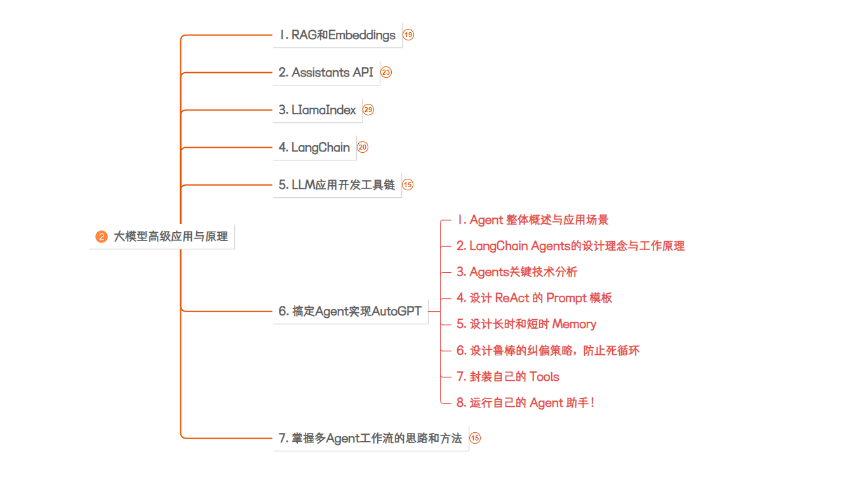

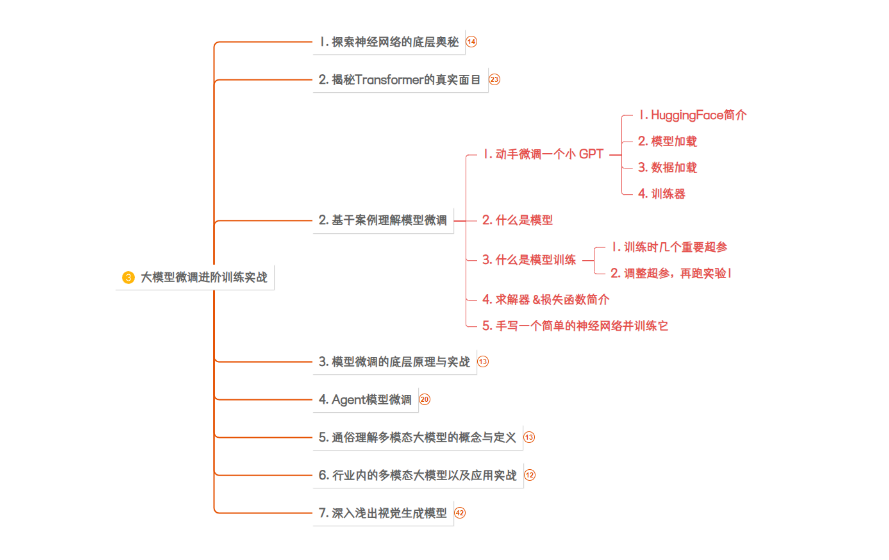

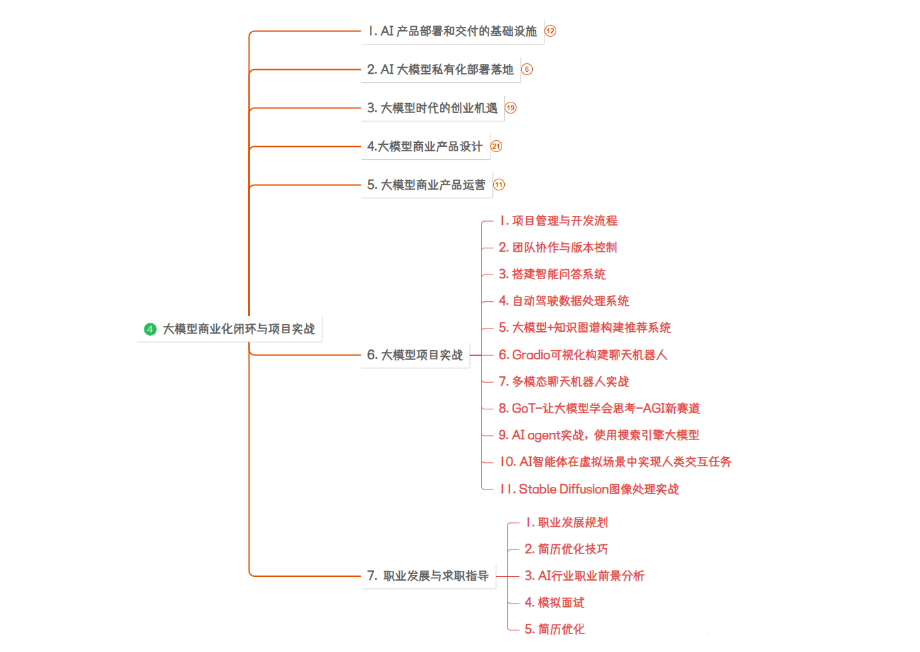

零基础入门AI大模型

今天贴心为大家准备好了一系列AI大模型资源,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

1.学习路线图

如果大家想领取完整的学习路线及大模型学习资料包,可以扫下方二维码获取

👉2.大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。(篇幅有限,仅展示部分)

大模型教程

👉3.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(篇幅有限,仅展示部分,公众号内领取)

电子书

👉4.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(篇幅有限,仅展示部分,公众号内领取)

大模型面试

**因篇幅有限,仅展示部分资料,**有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

**或扫描下方二维码领取 **

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?