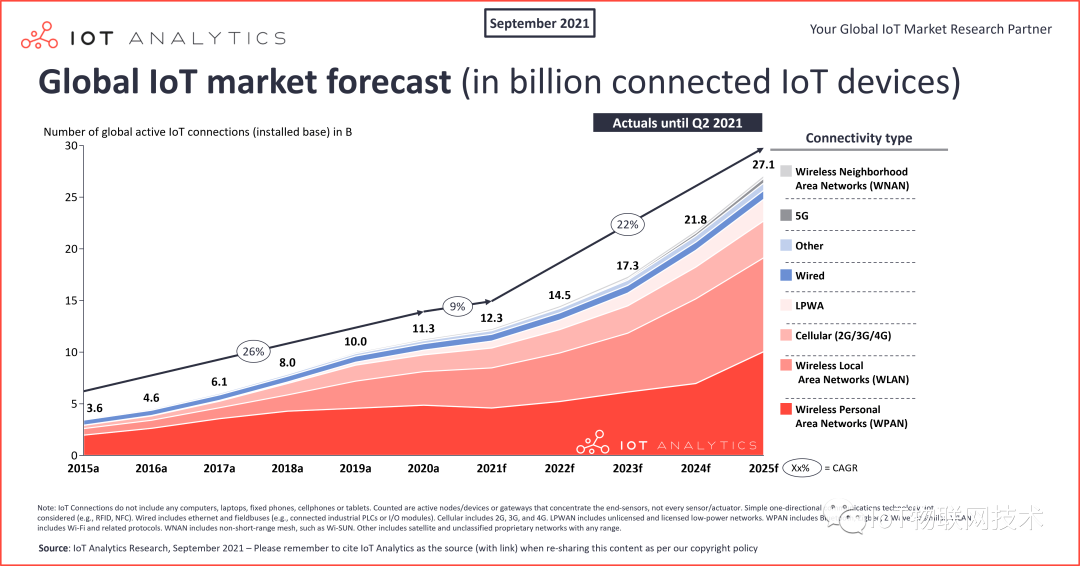

尽管芯片短缺和 COVID-19 对供应链的影响扩大,物联网市场仍在继续增长。到 2021 年,IoT Analytics 预计全球联网的 IoT 设备数量将增长 9%,达到 123 亿个活动终端,蜂窝物联网现已超过 20 亿。到 2025 年,物联网连接数可能会超过 270 亿。

两个关键因素导致增长曲线出现凹痕:

COVID-19 大流行:

受疫情生产有时会停止,供应链和原材料供应不完整。许多物联网计划在 2020 年停止或被取消。2021 年,疫情的影响继续对某些地区产生重大影响,导致更多供应链问题,例如缺乏船只和集装箱以及港口拥堵。

芯片短缺:

受疫情影响,芯片供应能力无法满足全球芯片需求,预计将成为未来两年的一个持续因素。芯片短缺首先影响了汽车行业,然后扩展到其他领域,如智能手机、电视、游戏和物联网。

从连接的角度来看,5G、Wi-Fi 6 和 LPWA 等新技术标准正在推动设备连接。

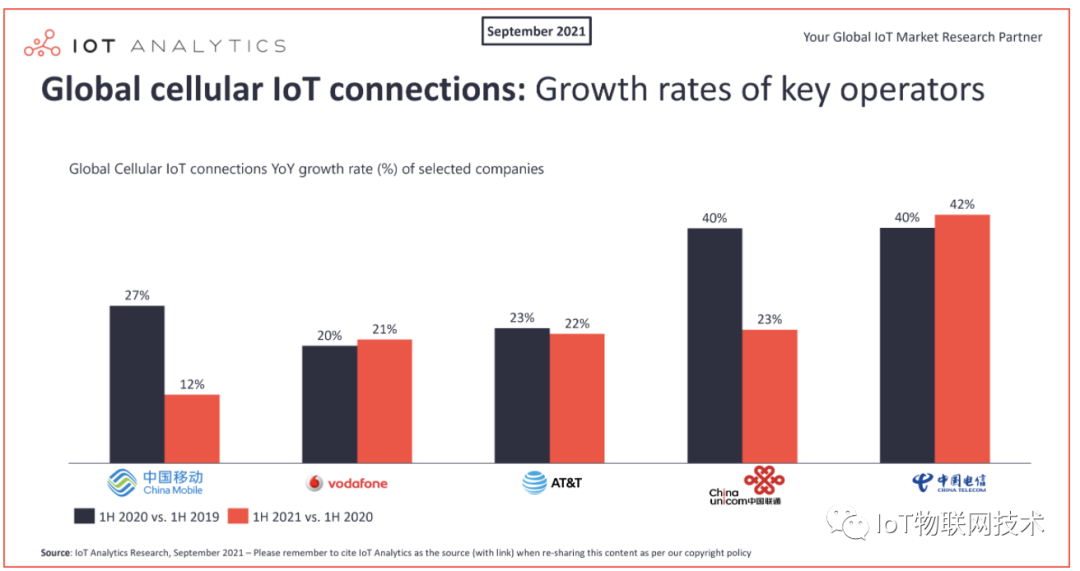

蜂窝物联网市场深度挖掘:到 2021 年Q2将达到 20 亿个活跃连接

2021 年上半年,使用蜂窝技术的联网物联网设备数量同比增长 18%,达到 20 亿台。中国移动、中国电信和中国联通联手几乎占到了3/4的市场。

在蜂窝技术方面,2G 和 3G 物联网连接的下降仍在继续,而 5G 连接的大规模部署预计将于今年开始。由于LTE-Cat.1在细分市场的采用率更高,4G LTE连接同比增长 25%。

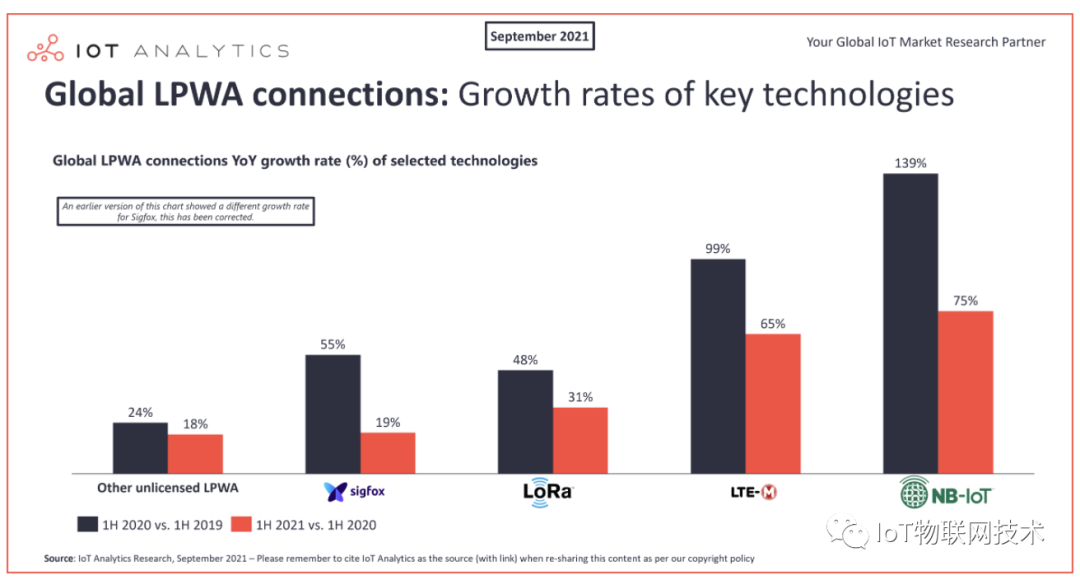

授权 LPWA 市场超过 非授权 LPWA,成为大趋势

2021年,授权的 LPWA 以 54% 的份额领先,而非授权 LPWA 仅有 46% 的份额。一个关键原因是 NB-IoT 连接在 2021 年上半年同比增长 75%。NB-IoT 作为单一技术现在以 44% 的市场份额主导 LPWA 连接市场,而 LoRa 以 37% 的全球份额下滑至第2位连接。

2021年,资产跟踪和监控是非授权 LPWA 增长的关键应用,而智能电表、建筑和基础设施行业垂直应用推动了 NB-IoT 的增长。

IoT Analytics 预计,NB-IoT 和 LoRa/LoRaWAN 将在未来五年内继续主导市场,LTE-M 和 Sigfox 分别排在第三和第四位。虽然其他技术将继续存在,但它们似乎不会在整个全球市场中发挥重要作用,尽管它们对某些利基应用仍然具有吸引力。

往期推荐

尽管面临芯片短缺和COVID-19的挑战,物联网市场持续增长,2021年全球IoT设备数量预估达123亿,蜂窝物联网超过20亿连接。到2025年,物联网连接数可能超过270亿。5G、Wi-Fi6和LPWA等新技术推动设备连接,授权LPWA超越非授权LPWA。2021年上半年,NB-IoT连接增长显著,成为LPWA市场主导。主要应用包括资产跟踪、监控和智能电表。

尽管面临芯片短缺和COVID-19的挑战,物联网市场持续增长,2021年全球IoT设备数量预估达123亿,蜂窝物联网超过20亿连接。到2025年,物联网连接数可能超过270亿。5G、Wi-Fi6和LPWA等新技术推动设备连接,授权LPWA超越非授权LPWA。2021年上半年,NB-IoT连接增长显著,成为LPWA市场主导。主要应用包括资产跟踪、监控和智能电表。

206

206

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?