Mapreduce排序介绍

1. 排序概述

排序是Mapreduce中重要的一步,MapTask和ReduceTask均会对数据按照key进行排序,该操作属于

Hadoop的默认行为。任何应用程序中的数据均会被排序,而不管逻辑上是否需要。

默认排序是按照字典顺序排序,且实现该排序的方法是快速排序。

-

对于MapTask,它会将处理的结果暂时放到环形缓冲区中,当环形缓冲区使用率达到一定阈值后(一般是达到80%时),再对缓冲区中的数据进行一次快速排序,并将这些有序数据溢写到磁盘上,而当数据处理完毕后,它会对磁盘上所有文件进行归并排序。

-

对于ReduceTask,它从每个MapTask上远程拷贝相应的数据文件,如果文件大小超过一定阈值,则溢写到磁盘上,否则存储在内存中。如果磁盘上文件数目达到一定阈值,则进行一次归并排序以生成一个更大文件,如果内存中文件大小或者数目超过一定阈值,则进行一次合并后将数据溢写到磁盘上。当所有数据拷贝完毕后,ReduceTask统一对内存和磁盘上的所有数据进行一次归并排序。

-

排序分类:

-

部分排序

MapReduce根据输入记录的键对数据集排序。保证输出的每个文件内部有序。 -

全排序

最终输出结果只有一个文件,且文件内部有序。实现方式是只设置一个ReduceTask。 但该方法在处理大型文件时效率极低,因为一台机器处理所有文件,完全丧失了MapReduce所提供的并行架构。 -

辅助排序: (GroupingComparator分组)

在Reduce端对key进行分组。应用于:在接收的key为bean对象时,想让一个或几个字段相同(全部字段比较不相同)的key进入到同一个reduce方法时,可以采用分组排序。 -

二次排序

在自定义排序过程中,如果compareTo中的判断条件为两个即为二次排序。

-

-

自定义排序WritableComparable步骤:需要实现WritableComparable接口,重写compareTo方法,就可以实现排序。

2. 全排序案例

-

需求分析:

在前面的自定义序列化案例中,我们统计了手机号的总流量,但最终的结果没有对总流量的大小进行一定的排序,现在需要对总流量进行倒序排序,使输出文件中的总流量按降序排列 -

输入数据格式

-

编写FlowBean 增加比较功能

package com.atguigu.mapreduce.sort;

import org.apache.hadoop.io.WritableComparable;

import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

public class FlowBean implements WritableComparable<FlowBean> {

private long upFlow;

private long downFlow;

private long sumFlow;

public FlowBean() {

super();

}

public FlowBean(long upFlow,long downFlow) {

this.upFlow = upFlow;

this.downFlow = downFlow;

sumFlow = upFlow + downFlow;

}

//序列化

@Override

public void write(DataOutput dataOutput) throws IOException {

dataOutput.writeLong(upFlow);

dataOutput.writeLong(downFlow);

dataOutput.writeLong(sumFlow);

}

//反序列化

@Override

public void readFields(DataInput dataInput) throws IOException {

upFlow = dataInput.readLong();

downFlow = dataInput.readLong();

sumFlow = dataInput.readLong();

}

//比较

@Override

public int compareTo(FlowBean bean) {

int result;

//比较操作

if(sumFlow > bean.getSumFlow()){

result = -1;

}else if(sumFlow < bean.getSumFlow()){

result = 1;

}else{

result = 0;

}

return result;

}

public long getUpFlow() {

return upFlow;

}

public void setUpFlow(long upFlow) {

this.upFlow = upFlow;

}

public long getDownFlow() {

return downFlow;

}

public void setDownFlow(long downFlow) {

this.downFlow = downFlow;

}

public long getSumFlow() {

return sumFlow;

}

public void setSumFlow(long sumFlow) {

this.sumFlow = sumFlow;

}

@Override

public String toString() {

return upFlow + "\t" + downFlow + "\t" + sumFlow;

}

}

- 编写Mapper类

package com.atguigu.mapreduce.sort;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

public class FlowCountSortMapper extends Mapper<LongWritable, Text,FlowBean,Text> {

FlowBean k = new FlowBean();

Text v = new Text();

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

//13560436666 1116 954 2070

//1 获取一行

String line = value.toString();

//2 切割

String[] fields = line.split("\t");

//3 封装

String phonenum = fields[0];

long upFlow = Long.parseLong(fields[1]);

long downFlow = Long.parseLong(fields[2]);

long sumFlow = Long.parseLong(fields[3]);

k.setUpFlow(upFlow);

k.setDownFlow(downFlow);

k.setSumFlow(sumFlow);

v.set(phonenum);

//4 写出

context.write(k,v);

}

}

- 编写Reducer类

package com.atguigu.mapreduce.sort;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

public class FlowCountSortReducer extends Reducer<FlowBean, Text,Text,FlowBean> {

@Override

protected void reduce(FlowBean key, Iterable<Text> values, Context context) throws IOException, InterruptedException {

for(Text value:values){

context.write(value,key);

}

}

}

- 编写Driver驱动类

package com.atguigu.mapreduce.sort;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class FlowCountSortDriver {

public static void main(String[] args) throws ClassNotFoundException, IOException, InterruptedException {

// 输入输出路径需要根据自己电脑上实际的输入输出路径设置

args = new String[]{"D:\\idea project\\MapReduce\\phone_data.txt","D:\\idea project\\MapReduce\\output8"};

// 1 获取配置信息,或者job对象实例

Configuration configuration = new Configuration();

Job job = Job.getInstance(configuration);

// 2 指定本程序的jar包所在的本地路径

job.setJarByClass(FlowCountSortDriver.class);

// 3 指定本业务job要使用的mapper/Reducer业务类

job.setMapperClass(FlowCountSortMapper.class);

job.setReducerClass(FlowCountSortReducer.class);

// 4 指定mapper输出数据的kv类型

job.setMapOutputKeyClass(FlowBean.class);

job.setMapOutputValueClass(Text.class);

// 5 指定最终输出的数据的kv类型

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(FlowBean.class);

// 6 指定job的输入原始文件所在目录

FileInputFormat.setInputPaths(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

// 7 将job中配置的相关参数,以及job所用的java类所在的jar包, 提交给yarn去运行

boolean result = job.waitForCompletion(true);

System.exit(result ? 0 : 1);

}

}

- 输出文件

3. 区内排序案例

- 需求分析:

如果需要将统计结果按照手机归属地不同省份输出到不同文件中(分区),并按一定的排序输出需要怎么做呢,在前面分区案例中,我们将手机号按归属地的不同输出到不同的文件中,如果需要实现每个文件的输出都是降序的呢 - 增加自定义分区类

package com.atguigu.mapreduce.sort;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner;

public class ProvincePartitioner extends Partitioner<FlowBean, Text> {

@Override

public int getPartition(FlowBean bean, Text text, int i) {

// 1 获取手机号码前三位

String preNum = text.toString().substring(0, 3);

int partition = 4;

// 2 根据手机号归属地设置分区

if ("136".equals(preNum)) {

partition = 0;

}else if ("137".equals(preNum)) {

partition = 1;

}else if ("138".equals(preNum)) {

partition = 2;

}else if ("139".equals(preNum)) {

partition = 3;

}

return partition;

}

}

- 在驱动类中添加分区类

// 加载自定义分区类

job.setPartitionerClass(ProvincePartitioner.class);

// 设置Reducetask个数

job.setNumReduceTasks(5);

- 查看结果

4. GroupingComparator分组案例

- 需求分析:

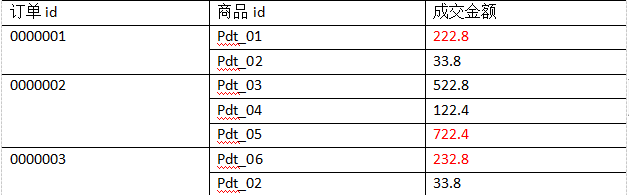

假如我们有如下订单数据,现在需要求出每一个订单里最贵的商品

我们可以利用订单id和成交金额作为key,将Map阶段读取到的所有订单数据按照id升序排序,如果id相同再按照金额降序排序,发送到Reduce。

在Reduce端利用groupingComparator将订单id相同的kv聚合成组,然后取第一个即是该订单中最贵商品。

- 输入数据格式

- 定义订单信息OrderBean类

package com.atguigu.mr.order;

import org.apache.hadoop.io.WritableComparable;

import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

public class OrderBean implements WritableComparable<OrderBean> {

private int order_id; //订单id

private double price; //订单价格

public OrderBean() {

super();

}

public OrderBean(int order_id) {

super();

this.order_id = order_id;

this.price = price;

}

//二次排序

@Override

public int compareTo(OrderBean o) {

//先按照订单id排序 如果相同按照价格降序

int result;

if(order_id > o.getOrder_id()){

result = 1; //升序为1

}else if(order_id < o.getOrder_id()){

result = -1;

}else{

if(price > o.getPrice()){

result = -1;

}else if(price < o.getPrice()){

result = 1;

}else{

result = 0;

}

}

return result;

}

@Override

public void write(DataOutput dataOutput) throws IOException {

dataOutput.writeInt(order_id);

dataOutput.writeDouble(price);

}

@Override

public void readFields(DataInput dataInput) throws IOException {

order_id = dataInput.readInt();

price = dataInput.readDouble();

}

public int getOrder_id() {

return order_id;

}

public void setOrder_id(int order_id) {

this.order_id = order_id;

}

public double getPrice() {

return price;

}

public void setPrice(double price) {

this.price = price;

}

@Override

public String toString() {

return order_id + "\t" + price;

}

}

- 编写Mapper类

package com.atguigu.mr.order;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

public class OrderMapper extends Mapper<LongWritable, Text, OrderBean, NullWritable> {

OrderBean k = new OrderBean();

@Override

protected void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

//1 获取一行

String line = value.toString();

//2 切割

String[] fields = line.split("\t");

//3 封装对象

k.setOrder_id(Integer.parseInt(fields[0]));

k.setPrice(Double.parseDouble(fields[2]));

//4 写出

context.write(k,NullWritable.get());

}

}

- 编写GroupingComparator类

package com.atguigu.mr.order;

import org.apache.hadoop.io.WritableComparable;

import org.apache.hadoop.io.WritableComparator;

public class OrderGroupingComparator extends WritableComparator {

protected OrderGroupingComparator() {

super(OrderBean.class, true);

}

@Override

public int compare(WritableComparable a, WritableComparable b) {

OrderBean aBean = (OrderBean) a;

OrderBean bBean = (OrderBean) b;

int result;

if (aBean.getOrder_id() > bBean.getOrder_id()) {

result = 1;

} else if (aBean.getOrder_id() < bBean.getOrder_id()) {

result = -1;

} else {

result = 0;

}

return result;

}

}

- 编写Reducer类

package com.atguigu.mr.order;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

public class OrderReducer extends Reducer<OrderBean, NullWritable,OrderBean,NullWritable> {

@Override

protected void reduce(OrderBean key, Iterable<NullWritable> values, Context context) throws IOException, InterruptedException {

context.write(key,NullWritable.get());

}

}

- 编写Driver类

package com.atguigu.mr.order;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class OrderDriver {

public static void main(String[] args) throws Exception, IOException {

//1 获取job对象

Configuration conf = new Configuration();

Job job = Job.getInstance(conf);

//2 设置jar

job.setJarByClass(OrderDriver.class);

//3 关联map和reduce

job.setMapperClass(OrderMapper.class);

job.setReducerClass(OrderReducer.class);

//4 设置map输出数据格式

job.setMapOutputKeyClass(OrderBean.class);

job.setMapOutputValueClass(NullWritable.class);

//5 设置最终输出数据格式

job.setOutputKeyClass(OrderBean.class);

job.setOutputValueClass(NullWritable.class);

//6 设置输入输出文件路径

FileInputFormat.setInputPaths(job,new Path("D:\\idea project\\MapReduce\\order.txt"));

FileOutputFormat.setOutputPath(job,new Path("D:\\idea project\\MapReduce\\output4"));

//7 设置reduce端的分组

job.setGroupingComparatorClass(OrderGroupingComparator.class);

//8 提交

boolean result = job.waitForCompletion(true);

System.exit(result ? 0 : 1);

}

}

- 查看结果

814

814

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?