文章目录

前言

上一篇文章,我们了解到Python多进程是一种并行处理数据的方法,说到多进程,那肯定绕不开的话题就是如何进程间通信和事件传递来实现不同进程之间的数据交互和任务调度,不同语言有不同的实现方法

在Python中,multiprocessing库也提供了一些用于进程间通信和事件传递的工具,如Queue和Event。

下面的例子是直接仿造langchain-chatchat的setup.py里创建子进程的方式写的,目的是帮大家学完本文之后能很快看明白相关的代码

一、直接看例子

以下是一个使用Python多进程进行进程间通信和事件传递的例子。

1. 首先,我们需要引入必要的库:

import time

from multiprocessing import Process

from time import sleep

import multiprocessing as mp

import uvicorn

from fastapi import FastAPI

import asyncio

import signal

2. 定义一个任务函数

这里的任务我们只是简单的写一个函数,参数是任务名和一个停止事件参数

def task(name, stop_event):

print(name + ' start')

while not stop_event.is_set():

currentTime = str(time.strftime('%H:%M:%S', time.localtime()))

print(name + ' running ' + currentTime)

sleep(2)

print(name + ' end')

3. 定义一个Web服务函数

接下来,定义一个Web服务函数,我们创建两个网页接口用于控制任务的开始、停止和列出当前正在运行的子进程:

def webService(queue):

app = FastAPI()

@app.get("/start")

async def startTask():

queue.put('start')

return "start!"

@app.get("/stop")

async def stopTask():

queue.put('stop')

return "stop!"

uvicorn.run(app, host="0.0.0.0", port=8000)

4. 定义一个任务管理函数

接着,定义一个任务管理函数,该函数会创建一个Web服务进程和一个停止事件,然后通过一个无限循环来监听命令队列中的命令,并根据不同的命令来执行相应的操作:

async def taskManager(queue):

w = Process(target=webService, args=(queue,))

w.start()

stop_event = mp.Event()

processList = {}

while True:

if queue.empty():

sleep(1)

continue

else:

cmd = getCmd(queue)

if cmd == 'start':

#必须要清理下,否则再次start的时候,子进程stop_event是is_set,然后直接停止

stop_event.clear()

if 'Job1' not in processList or processList['Job1'].is_alive() is False:

processList['Job1'] = Process(target=task, args=('Job1', stop_event))

processList['Job1'].start()

else:

print('任务已经在运行')

if 'Job2' not in processList or processList['Job2'].is_alive() is False:

processList['Job2'] = Process(target=task, args=('Job2', stop_event))

processList['Job2'].start()

else:

print('任务已经在运行')

elif cmd == 'stop':

stop_event.set()

#给10秒的时间,如果还不停下来,那就强制停止子进程了

sleep(10)

processList['Job1'].terminate()

processList['Job2'].terminate()

processList['Job1'].join()

processList['Job2'].join()

stop_event.clear()

这里要注意一点,就是如下几句话,因为getCmd(queue)在没有任何数据的时候,它会阻塞当前进程,如果不判断queue.empty(),那么代码执行就会停留在getCmd(queue)这句话上

if queue.empty():

sleep(1)

continue

else:

cmd = getCmd(queue)

5. 创建主程序

最后,在主程序中创建一个命令队列和一个事件循环,并执行任务管理函数:

if __name__ == '__main__':

manager = mp.Manager()

queue = manager.Queue()

loop = asyncio.get_event_loop()

loop.run_until_complete(taskManager(queue))

二、看效果

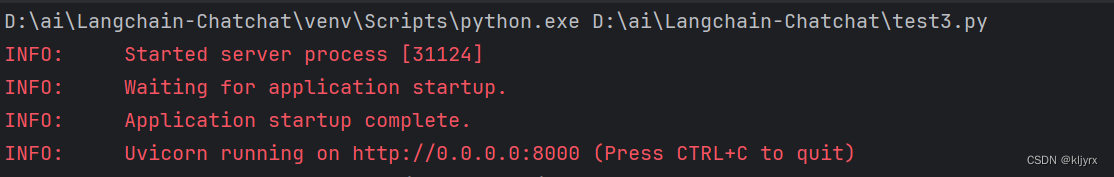

1. 启动python脚本

在命令行里执行 python test3.py , 看到如下画面之后,就可以在浏览器里访问了。

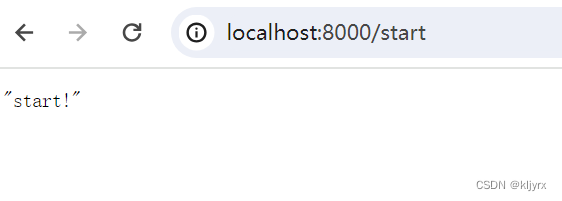

2. 启动子任务

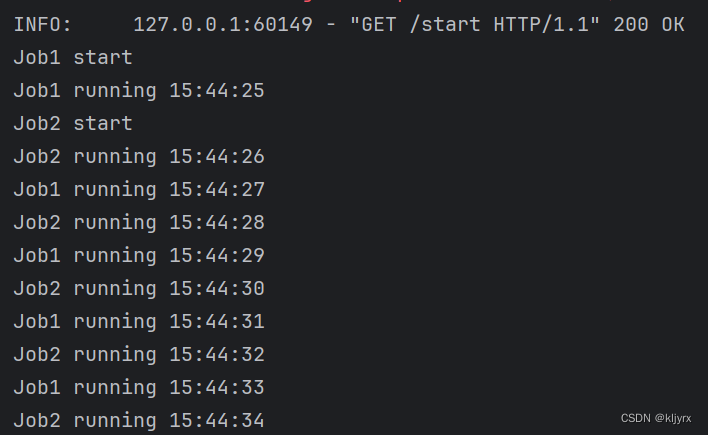

当我们在浏览器里访问http://localhost:8000/start 的时候

项目运行并交替打印任务执行情况

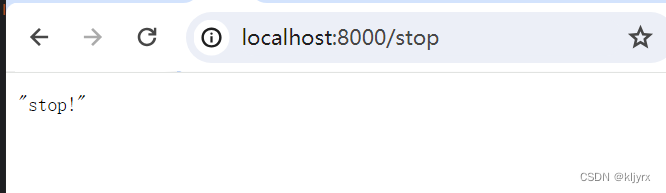

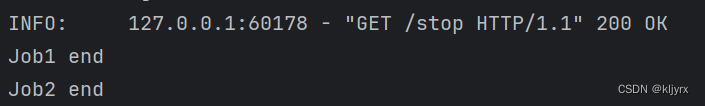

3. 停止子任务

当我们在浏览器里访问http://localhost:8000/end 的时候,python 命令行界面 里能看见如下结果,输出了end之后,没有新的任务输出

总结

两篇文章简单的介绍了Python的多进程,相信大家在看langchain 和langchain-chatchat的时候能看见很多这样的异步程序,有了相应的知识看起来就更简单了。完整代码如下:

import time

from multiprocessing import Process

from time import sleep

import multiprocessing as mp

import uvicorn

from fastapi import FastAPI

import asyncio

def task(name, stop_event):

print(name + ' start')

while not stop_event.is_set():

currentTime = str(time.strftime('%H:%M:%S', time.localtime()))

print(name + ' running ' + currentTime)

sleep(2)

print(name + ' end')

def webService(queue):

app = FastAPI()

@app.get("/start")

async def startTask():

queue.put('start')

return "start!"

@app.get("/stop")

async def stopTask():

queue.put('stop')

return "stop!"

uvicorn.run(app, host="0.0.0.0", port=8000)

async def taskManager(queue):

w = Process(target=webService, args=(queue,))

w.start()

stop_event = mp.Event()

processList = {}

while True:

if queue.empty():

sleep(1)

continue

else:

cmd = getCmd(queue)

if cmd == 'start':

stop_event.clear()

if 'Job1' not in processList or processList['Job1'].is_alive() is False:

processList['Job1'] = Process(target=task, args=('Job1', stop_event))

processList['Job1'].start()

else:

print('任务已经在运行')

if 'Job2' not in processList or processList['Job2'].is_alive() is False:

processList['Job2'] = Process(target=task, args=('Job2', stop_event))

processList['Job2'].start()

else:

print('任务已经在运行')

elif cmd == 'stop':

stop_event.set()

#给10秒的时间,如果还不停下来,那就强制停止子进程了

sleep(10)

processList['Job1'].terminate()

processList['Job2'].terminate()

processList['Job1'].join()

processList['Job2'].join()

stop_event.clear()

if __name__ == '__main__':

manager = mp.Manager()

queue = manager.Queue()

loop = asyncio.get_event_loop()

loop.run_until_complete(taskManager(queue))

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?