朴素贝叶斯与逻辑回归有什么异同

1、上述链接大佬详细的介绍了朴素贝叶斯、逻辑回归的由来。

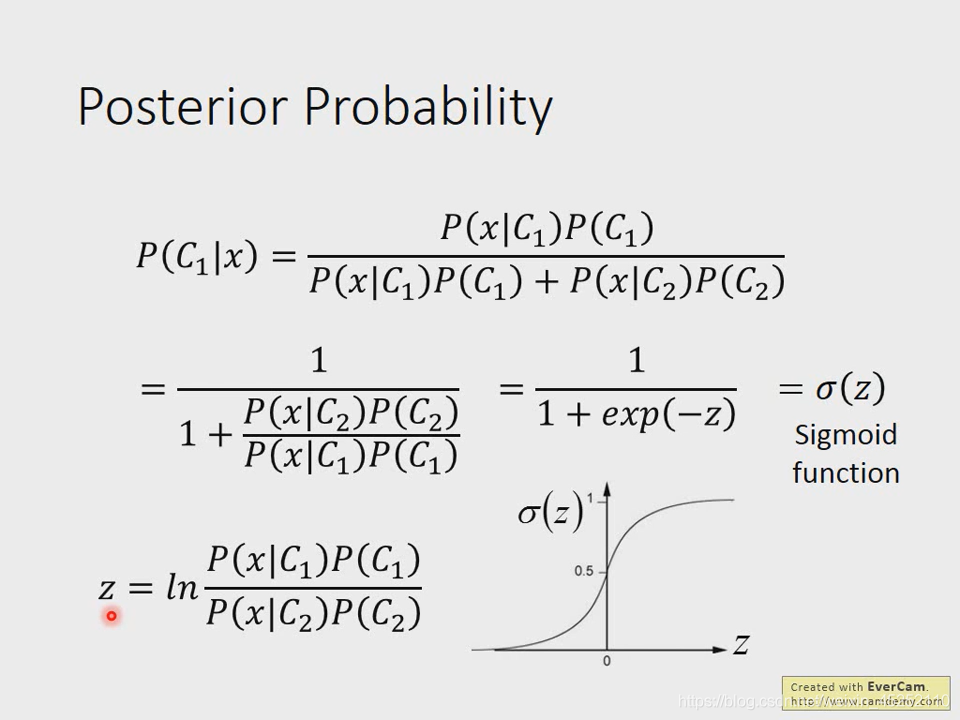

2、在B站李宏毅老师机器学习课中第4讲Classification中提到了从贝叶斯公式推导出逻辑函数的激活函数Sigmoid函数

3、区别

朴素贝叶斯:

条件独立性假设: 特征之间互相独立,没有耦合,互不干扰。

因为有条件独立假设,朴素贝叶斯可以不使用梯度下降,而直接通过统计每个特征的逻辑发生比来当做权重。

逻辑回归(Logistic Regression):

逻辑回归(Logistic Regression)与线性回归(Linear Regression)都是一种广义线性模型(generalized linear model)因此与线性回归有很多相同之处,去除Sigmoid映射函数的话,逻辑回归就是一个线性回归。可以说,逻辑回归是以线性回归为理论支持的,但是逻辑回归通过Sigmoid函数引入了非线性因素,因此可以轻松处理0/1分类问题。

注意逻辑回归和线性回归都是回归,但是线性回归就是用来回归,而是逻辑回归回归的是概率,是用来分类的,这是因为由于条件之间不独立,不能求出联合概率分布,只能回归后验概率,大于0.5即为yes,所以是判别模型 。

4、

逻辑回归实际上是用线性回归模型的预测结果去逼近后验概率的逻辑发生比。

贝叶斯分类还可以用来为不直接使用贝叶斯定理的其他分类法提供理论判定。例如,在某种假定下,可以证明:与朴素贝叶斯分类法一样,许多神经网络和曲线拟合算法都是输出最大的后验假定。

——韩家炜:《数据挖掘:概念与技术(第三版)》,p.228

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?