前些天被Boss批评,后来好好想了一下,觉得很有道理,很多看似基本的东西,还是得自己推一遍啊,mark一下,以后要注意,切勿眼高手低。

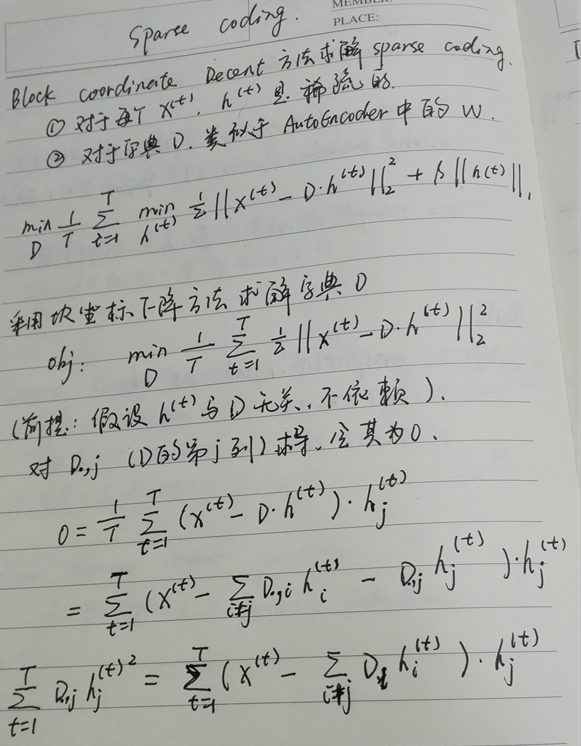

1. 采用Block Coordinate Decent方法求解Sparse Coding

Sparse coding在吴恩达老师UFLDL上面有详细的讲解,后来在CVPR2012,百度于凯老师的报告sparse coding加深了很多理解。这里引用姜文晖的一段关于稀疏的说明。

3、Sparse activations vs. sparse models

现在可以用a=f(x)表示稀疏编码的问题了。它可以分解成两种情况:

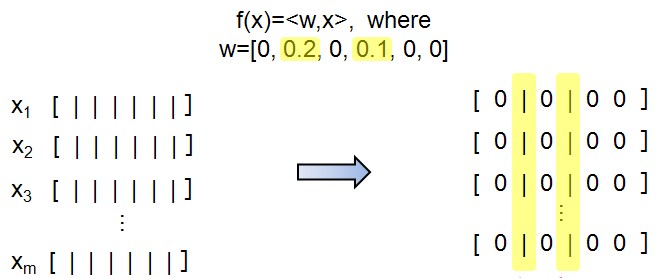

1)sparse model:f(x)的参数是稀疏的

--例如:LASSO f(x)=(w,x),其中w要求是稀疏的。(jiang1st2010注:这个例子中f(x)也是线性的!)

--这是一个特征选择的问题:所有的x都挑选相同的特征子集。

--hot topic.

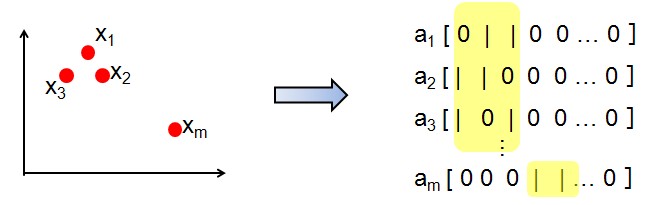

2)sparse activation:f(x)的输出是稀疏的

--就是说a是稀疏的。

--这是特征学习的问题:不同的x会激活不懂的特征子集。

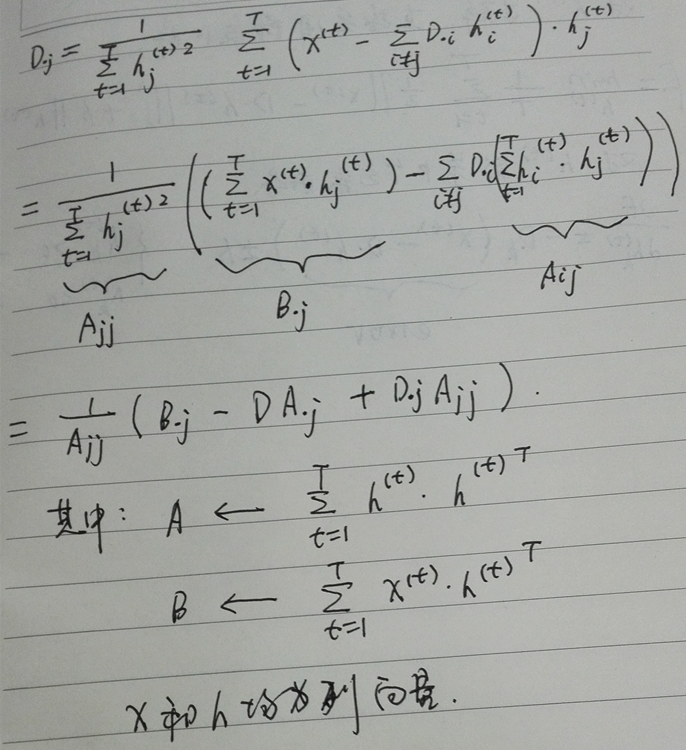

迭代求解字典D

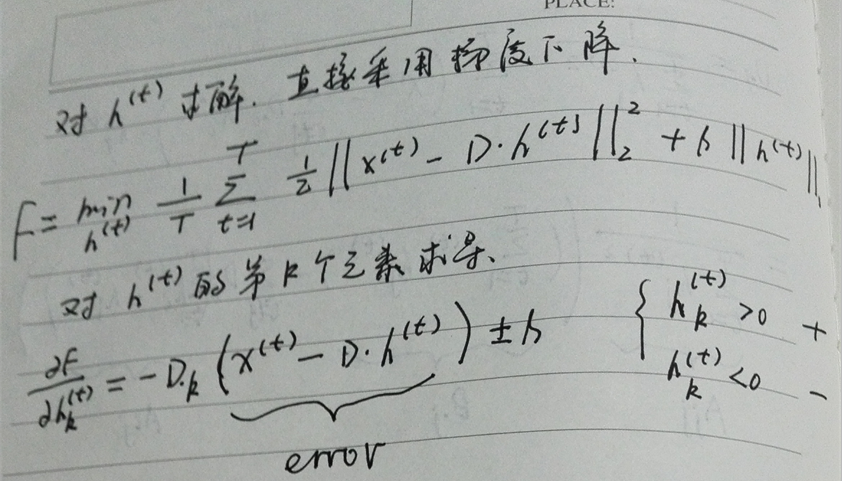

迭代求解表示h

引用:

1. 理解sparse coding

未完待续。。。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?