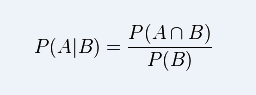

条件概率

B已经发生的情况下A发生的概率:

逻辑回归( Logistic Regression):

例子;

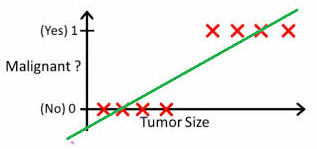

结果的分界:h(x)=0.5,数值算出来大于0.5就认为结果是1,反之为0

但是如下图肿瘤尺寸极大时,还以0.5为分界线时就不太合理,容易把良性误判为恶性,所以可以设置小一点的数字为分界线。

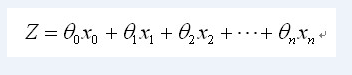

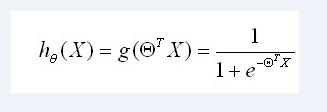

基本模型

测试数据为X(x1,x2,…xn) 列

要学习的参数为θ(θ1,θ2,θ3…θn) 列,转置之后变行

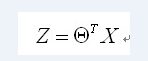

向量表示:

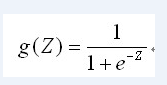

logistic regression 要求y的值处于0到1之间,所以要处理二值数据,引入sigmoid函数使曲线更平滑,使数值处于0和1之间

g(Z)的图像:

预测函数:

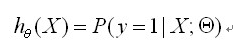

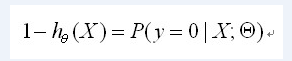

也可以用概率表示:

正例:(y=1)

对于给定的X和参数θ,y=1的概率为hθ(x)

反例:(y=0)

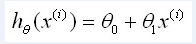

Cost函数

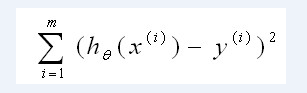

线性回归:

偏差的平方和:表示的是每个实例的误差

找到合适的θ0和θ1使偏差的平方和最小

对应与非线性回归:

Cots函数:

非线性回归目标:找到合适的一组θ值使 J 最小

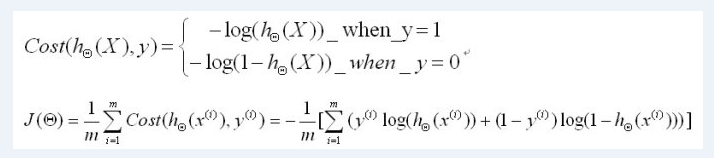

解法:梯度下降(gradient decent)

要找到最低点:

alpha相当于学习率,一个更新的步伐大小

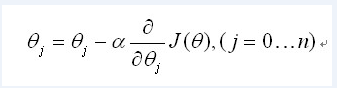

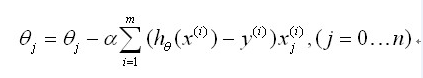

更新法则:不停地对进行θ j 进行更新

学习率α对所有θ进行更新,直到收敛

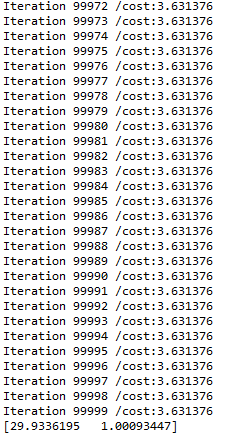

使用梯度下降法求出最好的theta值python代码:

结果:cost最小到3.6,因为测试的数据集x只是二维的,所以theta有两个

线性模型和非线性模型的区别在于,线性模型是参数和特征值的点乘即为预测值,非线性模型对点乘结果还要进行一个非线性函数的处理

9393

9393

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?