众所周知,google谷歌有一个名为TensorFlow的开源库,可用来在Android中实现机器学习。

TensorFlow是一个由google谷歌提供的机器智能开源软件库。我在网上搜索了很多关于在Android端 构建 TensorFlow的简单简单方法和简单demo,都一无所获。在阅读了众多资源后,我总算可以构建成功了。然后我决定写下这篇博客,以便其他人不用花费太多时间。

本篇Demo——图像分类器,是取材于google谷歌官方的TensorFlow的Demo。

阅读这篇文章,你需要已经熟悉机器学习,并且知道如何为机器学习构建相关的模型(在这个Demo里我暂时用一套预训练模型)。不久之后,我将要写下关于机器学习的一系列文章,以便所有人都可以学习如何来为机器学习构建模型。

开启Android机器学习 构建之门

你需要了解一些重要的点:

* TensorFlow的核心是用C++编写的。

* 为了在Android中构建,我们不得不使用JNI(Java Native Interface)来调用C++函数,例如loadModel, getPredictions等等。

* 我们将使用一个jar包和一个.so动态链接库文件,前者里面由调用native C++的JAVA API构成,后者是C++编译的so文件。然后我们可以仅通过调用JAVA API来把事情搞定。

* 因此,请注意,我们需要一个jar文件(JAVA API)和一个.so文件(C++编译好)

* 我们必须还有2个东西:提前训练的模型文件(.pb),用来分类的标签文件(.txt)。

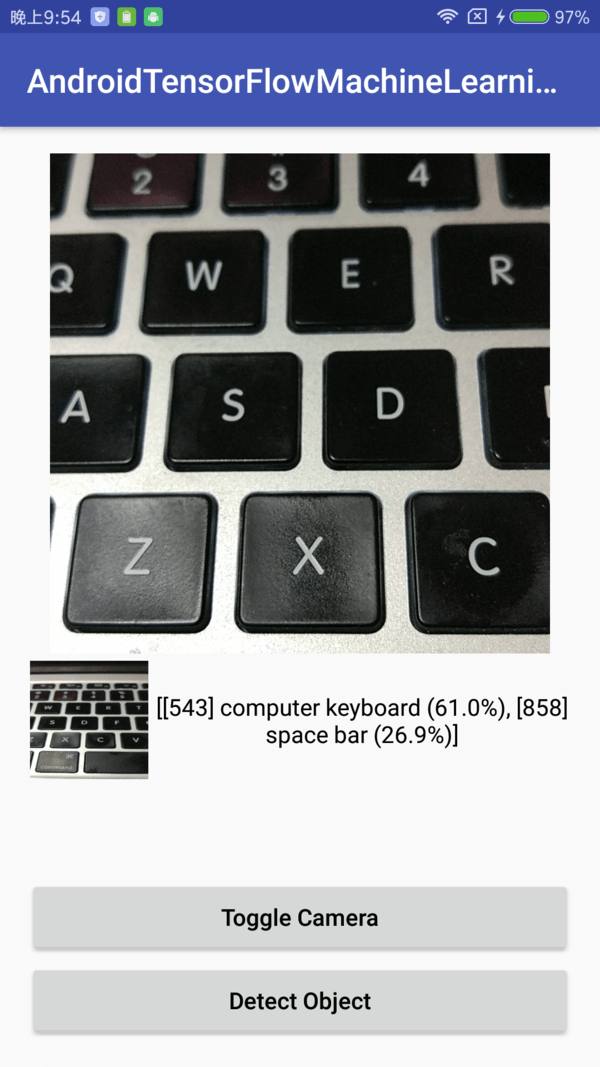

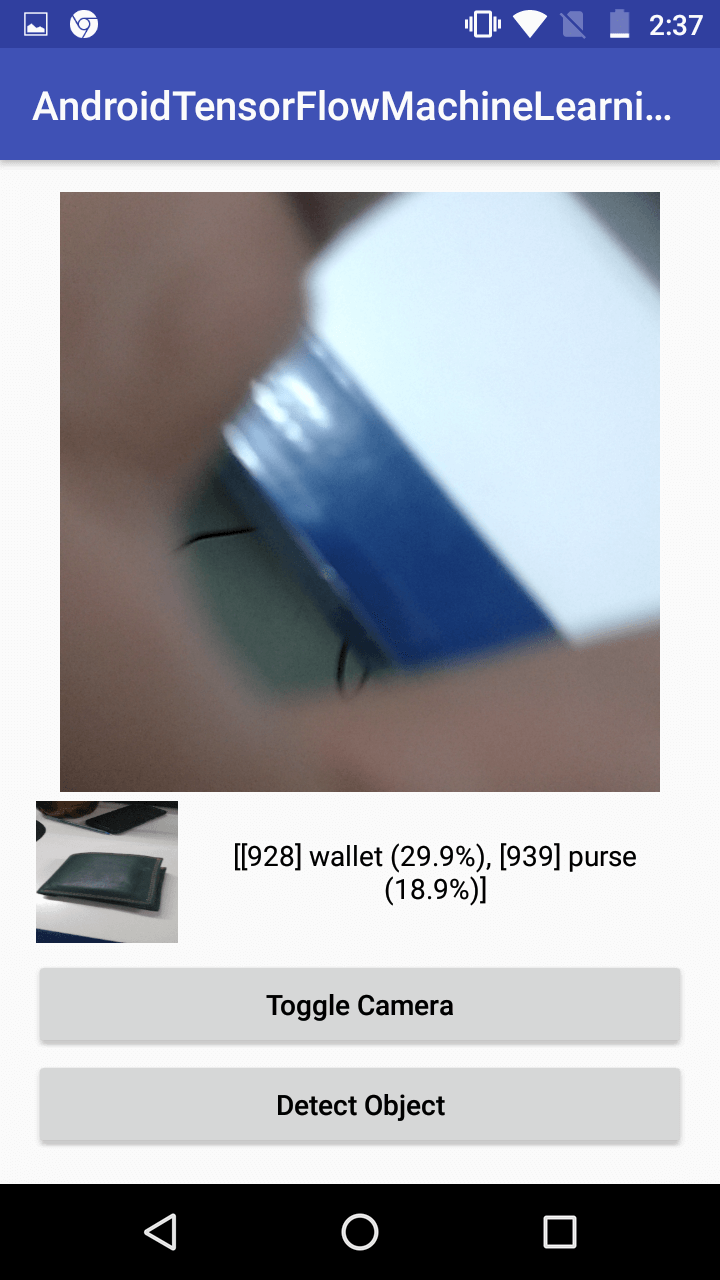

我们将构建一个如下图的物体探测器:

接下来,让我们构建jar文件和.so文件

执行如下命令:

git clone --recurse-submodules https://github.com/tensorflow/tensorflow.git注意:–recurse-submodules 非常重要,用来下拉子模块的代码。

需要使用官方推荐的NDK r12b来构建so, 太新或太旧的版本都会有问题,如果你没有NDK r12b,请在这里下载.

如果你不用r12b编译,你就会遇到各种各样的错误。

如果你是全新玩家,那么你当然还需要下载Android SDK了,或者采用Android Studio 下载的Android SDK也可以,后面我们需要的是SDK的路径。

你需要了解谷歌的构建工具Bazel,它是TensorFlow的首席构建工具。你可以在这里安装Bazel。

当你对Bazel有所了解之后:

现在,编辑WORKSPACE文件,我们可以在之前clone下来的TensorFlow的根路径里找到WORKSPACE文件。

# Uncomment and update the paths in these entries to build the Android demo.

#android_sdk_repository(

# name = "androidsdk",

# api_level = 23,

# build_tools_version = "25.0.1",

# # Replace with path to Android SDK on your system

# path = "<PATH_TO_SDK>",

#)

#

#android_ndk_repository(

# name="androidndk",

# path="<PATH_TO_NDK>",

# api_level=14)将以上文件内容改为我们自己的sdk、ndk的路径:

android_sdk_repository(

name = "androidsdk",

api_level = 23,

build_tools_version = "25.0.1",

# Replace with path to Android SDK on your system

path = "/Users/xxx/Library/Android/sdk/",

)

android_ndk_repository(

name="androidndk",

path="/Users/xxx/Downloads/android-ndk-r13/",

api_level=14)下一步,构建.so文件,执行如下命令:

bazel build -c opt //tensorflow/contrib/android:libtensorflow_inference.so \

--crosstool_top=//external:android/crosstool \

--host_crosstool_top=@bazel_tools//tools/cpp:toolchain \

--cpu=armeabi-v7a其中的armeabi-v7a参数可以换成你所需的目标cpu架构。

构建完成后,.so文件将在如下路径生成:

bazel-bin/tensorflow/contrib/android/libtensorflow_inference.so接着构建JAVA jar文件:

bazel build //tensorflow/contrib/android:android_tensorflow_inference_javajar文件在如下路径生成:

bazel-bin/tensorflow/contrib/android/libandroid_tensorflow_inference_java.jar现在我们同时拥有了jar文件和.so文件了。

如果你构建失败了,可以直接从这里可以下载demo工程,里面都有构建好的文件。

但是我们还需要预训练模型文件和标签文件。

在这个demo里,我们使用Google提供的预训练模型文件,这个文件用来从已有的图片中检测物体(图像识别)。

在这里下载模型文件。

下载完zip包解压缩,得到2个文件:

* imagenet_comp_graph_label_strings.txt(物体的标签文件)

* tensorflow_inception_graph.pb (预训练模型文件).

现在我们使用Android Studio来创建一个样例工程。把.pb、.txt这2个文件放入assets文件夹。

将生成的jar包,放入libs文件,在build.gradle中加入:

compile files('libs/libandroid_tensorflow_inference_java.jar')在main目录创建jniLibs文件夹,把编译好的.so文件放进jniLibs/armeabi-v7a/路径

到现在为止,我们就可以调用TensorFlow的JAVA API了。

TensorFlow的JAVA层API通过TensorFlowInferenceInterface来暴露所有需要的方法。

我们需要先通过模型路径装载模型,才能进一步调用这些JAVA API。

并且,我们可以提供输入图像,来得到识别的结果。

上面已经说过了,想图省事,直接clone现成的项目,看看代码,编译运行即可。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?