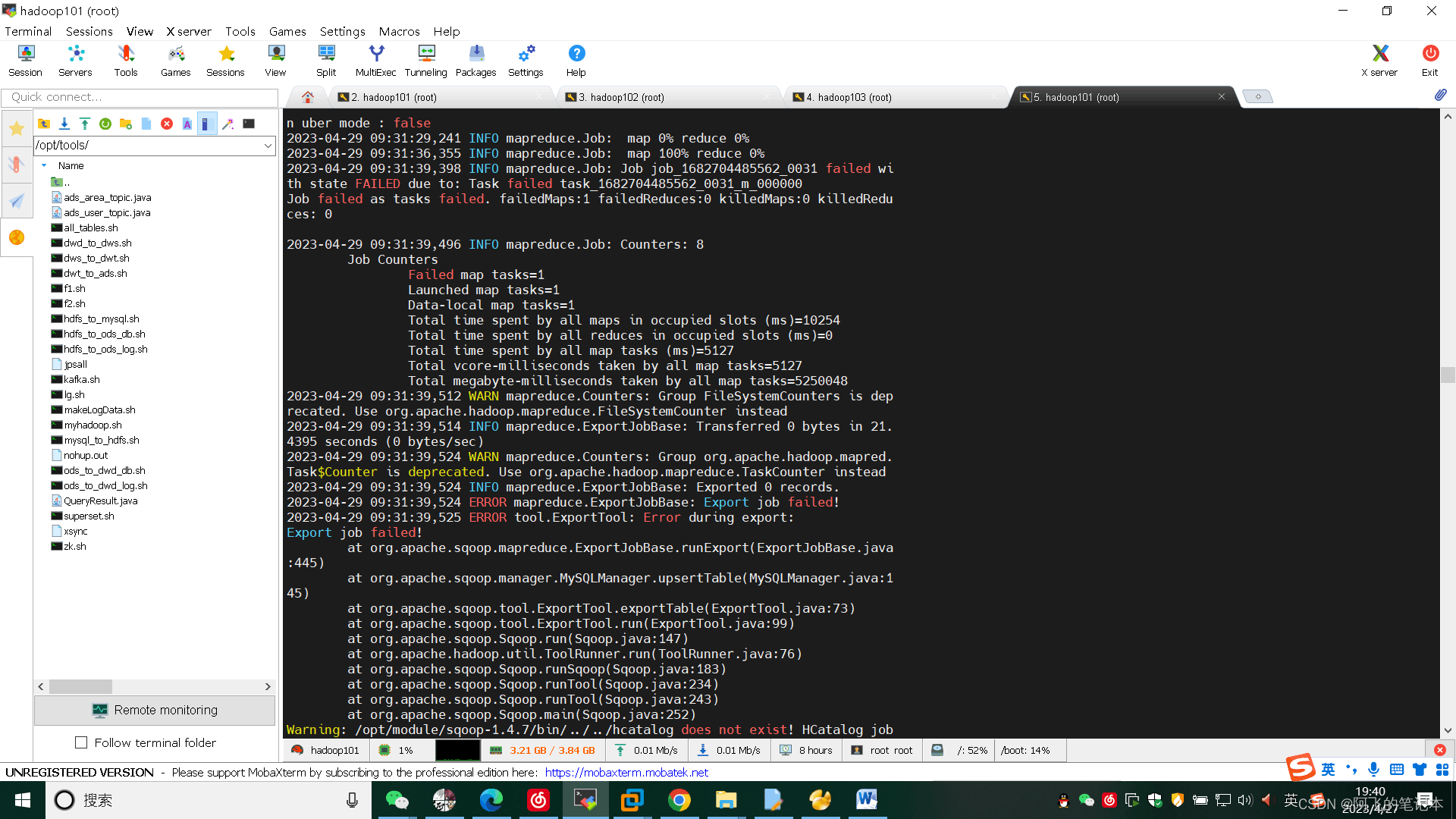

org.apache.hadoop.hive.ql.parse.SemanticException:Failed to get a spark session: org.apache.hadoop.hive.ql.metadata.HiveException: Failed to create Spark client for Spark session

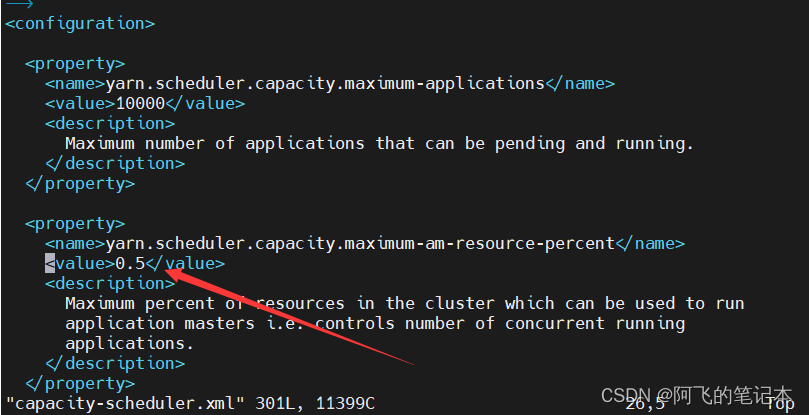

编辑虚拟机中hadoop-3.1.3/etc/hadoop目录下的capacity-scheduler.xml文件

这里更改为0.5,默认是0.1

这个配置是用于设置集群中可用于运行的最大资源百分比应用程序主机,控制并发运行的数量应用

可以理解为集群资源不够了,这里把整个集群资源中用于运行的上限值调高,就ok了

org.apache.hadoop.hive.ql.parse.SemanticException:Failed to get a spark session: org.apache.hadoop.h

最新推荐文章于 2024-02-22 16:41:48 发布

1612

1612

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?