测试内容

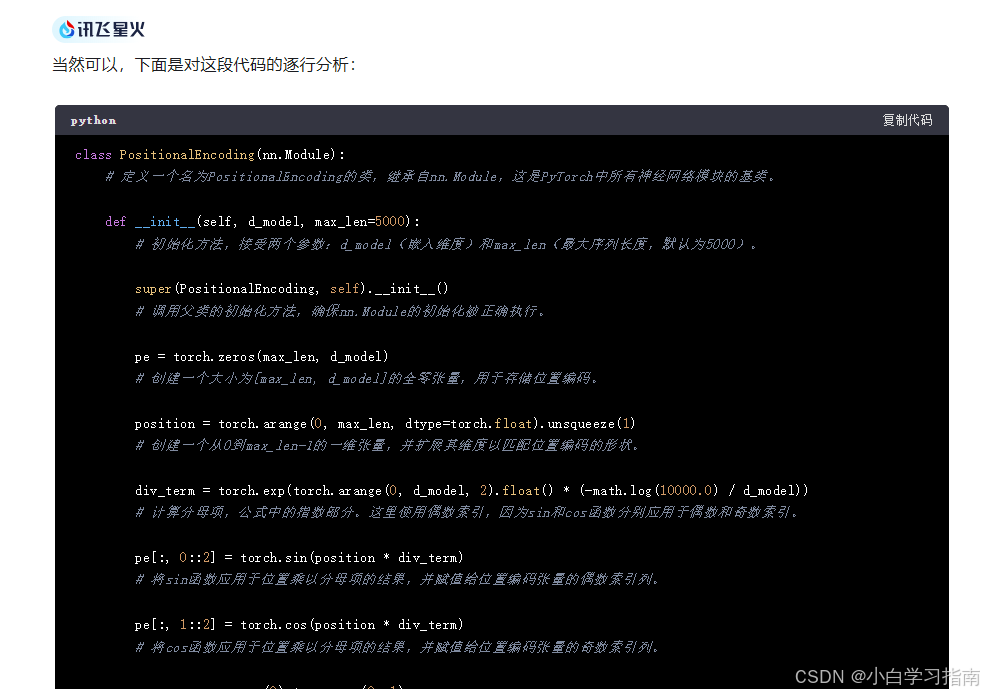

class PositionalEncoding(nn.Module): def __init__(self, d_model, max_len=5000): super(PositionalEncoding, self).__init__() pe = torch.zeros(max_len, d_model) position = torch.arange(0, max_len, dtype=torch.float).unsqueeze(1) div_term = torch.exp(torch.arange(0, d_model, 2).float() * (-math.log(10000.0) / d_model)) pe[:, 0::2] = torch.sin(position * div_term) pe[:, 1::2] = torch.cos(position * div_term) pe = pe.unsqueeze(0).transpose(0, 1) self.register_buffer('pe', pe) def forward(self, x): return x + self.pe[:x.size(0), :] # [seq_length, batch_size, d_model] 麻烦您帮我对这段代码进行逐行分析

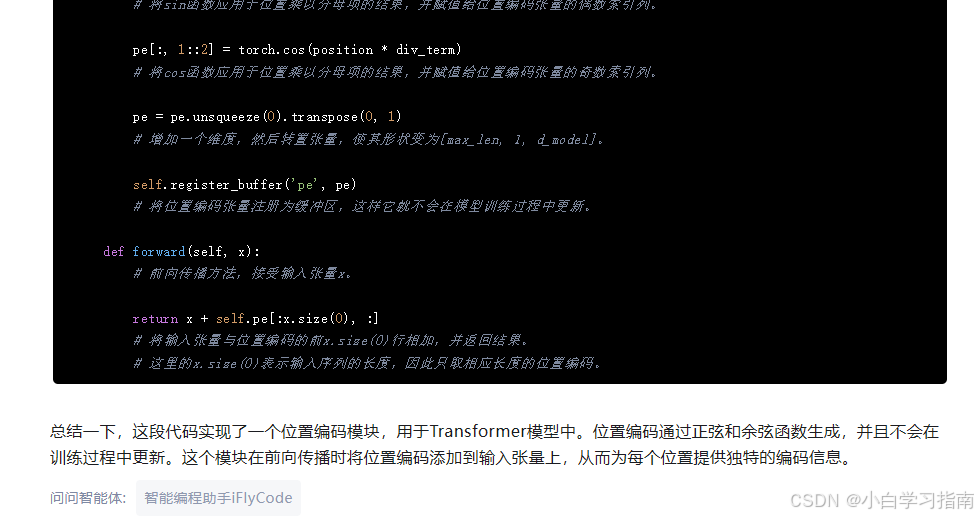

讯飞星火:

DeepSeek:

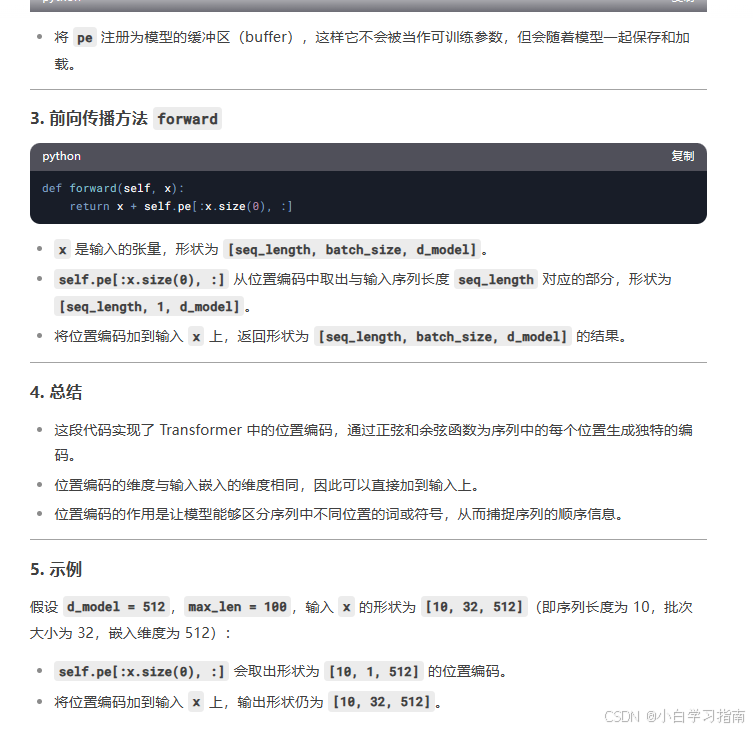

这段代码实现了一个用于Transformer模型中的**位置编码(Positional Encoding)**模块。位置编码的作用是为序列中的每个位置添加一个独特的编码,以便模型能够区分不同位置的词或符号。以下是对代码的逐行分析:

两者对比结论:

1.从输出形式上来看,讯飞星火更有好一些。把注释嵌入到代码中。DeepSeek逐行分析。

2.从输出内容上,1)DeepSeek更详细,在文章结尾,给出一个实例,让初学者更明白模型的原理。2)DeepSeek深入到代码中,解释具体代码的含义这一点对初学者很友好。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?