近日,OpenAI首席技术官米拉·穆拉蒂表示GPT-将在一年半后发布,并称GPT-4到GPT-5的飞跃将是高中生到博士生的成长。毫无疑问,GPT-5将进一步提高生产力,增强人机交互,推动行业变革。进一步拓宽应用场景,包括高级研究助手、个性化教育、医疗诊断和辅助、内容创作和生成。截至目前,GPT模型已经发展了四代,分别是GPT-1、GPT-2、GPT-3和GPT-4。以下是每一代模型的一些主要特点:

| 模型 | 模型参数 | 创新能力 | 评价 |

| GPT1 | 1.17亿参数 | 预训练+微调 | 创新点在于Task-specific input transformations |

| GPT2 | 15亿参数 | 预训练+Prompt+Predict | 创新点在于Zero-shot |

| GPT3 | 1750亿参数 | 预训练+Prompt+Predict | 创新点在于in-context learning |

| GPT4 | 1750-2800亿参数 | 使用多模态对话数据进行强化学习指令微调 | 初步实现多模态的统一 |

GPT-4o已经初步实现了多模态的统一,可以接受文本、音频、图像和视频的任意组合作为输入,并生成文本、音频和图像的任意组合输出。尽管 GPT-4o 还未能做到完美,但它在形态设计上已经走在正确的道路上。不久的将来,GPT-5的发布不仅仅是技术的进步,更是对我们生活和工作的深远影响的开始。为了迎接技术变革,我们要做好准备,例如,个人技能的提升、注重跨领域的合作、伦理和监管等。

本文是基于MindSpore通过GPT实现情感分类,使用MindSpore和MindNLP库进行GPT1模型在IMDB电影评论数据集上的微调和评估。具体步骤包括数据加载、数据处理、模型构建、训练和评估。

导入依赖模块

%%capture captured_output

!pip uninstall mindspore -y

!pip install -i https://pypi.mirrors.ustc.edu.cn/simple mindspore==2.2.14

!pip install mindnlp

!pip install jieba

%env HF_ENDPOINT=https://hf-mirror.com导入包

import os

import mindspore

from mindspore.dataset import text, GeneratorDataset, transforms

from mindspore import nn

from mindnlp.dataset import load_dataset

from mindnlp._legacy.engine import Trainer, Evaluator

from mindnlp._legacy.engine.callbacks import CheckpointCallback, BestModelCallback

from mindnlp._legacy.metrics import Accuracy加载数据

imdb_ds = load_dataset('imdb', split=['train', 'test'])

imdb_train = imdb_ds['train']

imdb_test = imdb_ds['test']数据处理

import numpy as np

def process_dataset(dataset, tokenizer, max_seq_len=512, batch_size=4, shuffle=False):

is_ascend = mindspore.get_context('device_target') == 'Ascend'

def tokenize(text):

if is_ascend:

tokenized = tokenizer(text, padding='max_length', truncation=True, max_length=max_seq_len)

else:

tokenized = tokenizer(text, truncation=True, max_length=max_seq_len)

return tokenized['input_ids'], tokenized['attention_mask']

if shuffle:

dataset = dataset.shuffle(batch_size)

# map dataset

dataset = dataset.map(operations=[tokenize], input_columns="text", output_columns=['input_ids', 'attention_mask'])

dataset = dataset.map(operations=transforms.TypeCast(mindspore.int32), input_columns="label", output_columns="labels")

# batch dataset

if is_ascend:

dataset = dataset.batch(batch_size)

else:

dataset = dataset.padded_batch(batch_size, pad_info={'input_ids': (None, tokenizer.pad_token_id),

'attention_mask': (None, 0)})

return datasetGPTtoken

from mindnlp.transformers import GPTTokenizer

# tokenizer

gpt_tokenizer = GPTTokenizer.from_pretrained('openai-gpt')

# add sepcial token: <PAD>

special_tokens_dict = {

"bos_token": "<bos>",

"eos_token": "<eos>",

"pad_token": "<pad>",

}

num_added_toks = gpt_tokenizer.add_special_tokens(special_tokens_dict)数据集划分

imdb_train, imdb_val = imdb_train.split([0.7, 0.3])

dataset_train = process_dataset(imdb_train, gpt_tokenizer, shuffle=True)

dataset_val = process_dataset(imdb_val, gpt_tokenizer)

dataset_test = process_dataset(imdb_test, gpt_tokenizer)模型构建

from mindnlp.transformers import GPTForSequenceClassification

from mindspore.experimental.optim import Adam

# set bert config and define parameters for training

model = GPTForSequenceClassification.from_pretrained('openai-gpt', num_labels=2)

model.config.pad_token_id = gpt_tokenizer.pad_token_id

model.resize_token_embeddings(model.config.vocab_size + 3)

optimizer = nn.Adam(model.trainable_params(), learning_rate=2e-5)

metric = Accuracy()

# define callbacks to save checkpoints

ckpoint_cb = CheckpointCallback(save_path='checkpoint', ckpt_name='gpt_imdb_finetune', epochs=1, keep_checkpoint_max=2)

best_model_cb = BestModelCallback(save_path='checkpoint', ckpt_name='gpt_imdb_finetune_best', auto_load=True)

trainer = Trainer(network=model, train_dataset=dataset_train,

eval_dataset=dataset_train, metrics=metric,

epochs=1, optimizer=optimizer, callbacks=[ckpoint_cb, best_model_cb],

jit=False)训练预测

trainer.run(tgt_columns="labels")

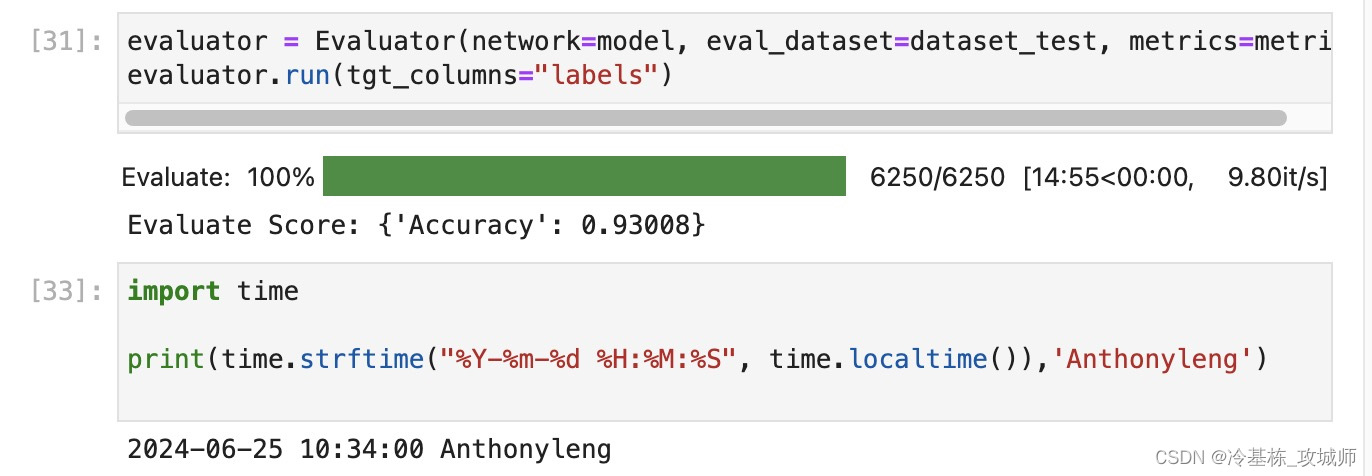

evaluator = Evaluator(network=model, eval_dataset=dataset_test, metrics=metric)

evaluator.run(tgt_columns="labels")结果

学习心得:AI技术的进步不仅仅体现在模型参数的增加和性能的提升,更重要的是其在各个领域中实际应用的广泛性和深度。随着GPT-5的即将发布,我们可以预见其在自然语言处理能力上的进一步提升。GPT-5不仅有望在生成文本的连贯性和准确性上达到新的高度,还可能在理解复杂指令和多任务处理上表现出色。这将使得AI在更多复杂的应用场景中发挥作用,如法律文书撰写、复杂数据分析报告生成等。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?