BP(Back Propagation)算法是一种常用的神经网络训练算法,主要用于识别分类和预测。常用于图像识别、语音识别、文本分类等场景。它的原理是通过对误差进行反向传播来更新网络的参数,使得模型的误差最小。BP算法最早于1986年由Rumelhart等人提出。BP算法适用于处理非线性问题,并且不需要对数据进行预处理。

BP算法具有以下优点:

- 简单易用:BP算法简单易于理解和实现,是神经网络训练算法中的经典算法。

- 适用广泛:BP算法适用于多种类型的神经网络,例如多层感知机、卷积神经网络等。

- 学习效率高:BP算法在反向传播中对误差进行计算,有效地减少了训练的时间。

- 具有收敛性:BP算法的误差逐渐减小,最终会收敛到最小误差。

- 具有泛化能力:BP算法训练出来的模型可以在未见过的数据上进行预测,具有较好的泛化能力。

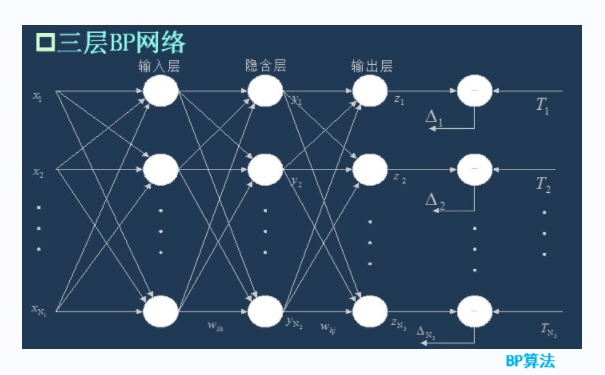

BP算法是一种误差逆传播算法。主要分为正向传播和反向传播两个部分。在正向传播中,通过神经元间的加权连接从输入层到输出层,逐层计算每一个神经元的输出,得到预测值。在反向传播中,根据预测值与真实值的差值,计算出每一层的误差,并通过梯度下降法对网络的参数进行调整,使得误差最小。这个过程重复多次,直到网络的误差小于一定阈值,或者满足其他终止条件。BP算法难以处理有噪声的数据,并且容易陷入局部最优解。

常见的BP算法开源库包括TensorFlow、PyTorch、Keras等。</

BP算法作为经典的神经网络训练方法,适用于图像识别、语音识别等多种场景。其优点包括简单易用、适用广泛、学习效率高、具有收敛性和泛化能力。通过正向传播和反向传播调整网络参数,降低误差。尽管存在处理噪声数据和局部最优解的问题,BP算法仍然是机器学习中的重要工具,常见于TensorFlow等开源库。

BP算法作为经典的神经网络训练方法,适用于图像识别、语音识别等多种场景。其优点包括简单易用、适用广泛、学习效率高、具有收敛性和泛化能力。通过正向传播和反向传播调整网络参数,降低误差。尽管存在处理噪声数据和局部最优解的问题,BP算法仍然是机器学习中的重要工具,常见于TensorFlow等开源库。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?