作者:周志湖

网名:摇摆少年梦

微信号:zhouzhihubeyond

本节主要内容

- Spark运行方式

- Spark运行原理解析

本节内容及部分图片来自:

http://blog.csdn.net/book_mmicky/article/details/25714419

http://blog.csdn.net/yirenboy/article/details/47441465

这两篇文件对Spark的运行架构原理进行了比较深入的讲解,写得非常好,建议大家认真看一下,在此向作者致敬!

1. Spark运行方式

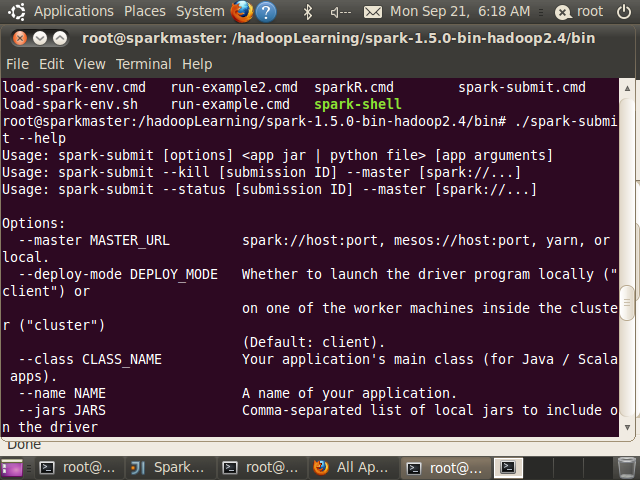

用户编写完Spark应用程序之后,需要将应用程序提交到集群中运行,提交时使用脚本spark-submit进行,spark-submit可以带多种参数,参数选项可以通过下列命令查看

root@sparkmaster:/hadoopLearning/spark-1.5.0-bin-hadoop2.4/bin# ./spark-submit --help

可以看到,spark-submit提交参数如下:

./bin/spark-submit \

--class <main-class>

--master <master-url> \

--deploy-mode <deploy-mode> \

--conf <key>=<value> \

... # other options

<application-jar> \

[application-arguments]下面介绍几种常用Spark应用程序提交方式:

(1)本地运行方式 –master local

//--master local,本地运行方式。读取文件可以采用本地文件系统也可采用HDFS,这里给出的例子是采用本地文件系统

//从本地文件系统读取文件file:/hadoopLearning/spark-1.5.0-bin-hadoop2.4/README.md

//生成的结果也保存到本地文件系统:file:/SparkWordCountResult

roo

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?