本文的前提是,已经在集群的一个节点配置好了hive,我的hive已经再Hadoop104节点配置完毕,并且可以正常启动和运行。

一.将hive-site.xml,复制到spark主节点的conf目录下

scp hive-site.xml LMK@hadoop102:/opt/module/spark-2.4.6/conf

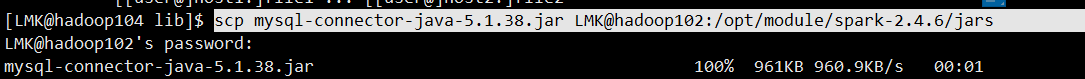

二.将jdbc的连接驱动放到spark的jars目录下

scp mysql-connector-java-5.1.38.jar LMK@hadoop102:/opt/module/spark-2.4.6/jars

三.启动spark-sql

做完前两部就可以去hadoop102节点启动spark-sql,测试是否整合好啦

241

241

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?