1、问题概述

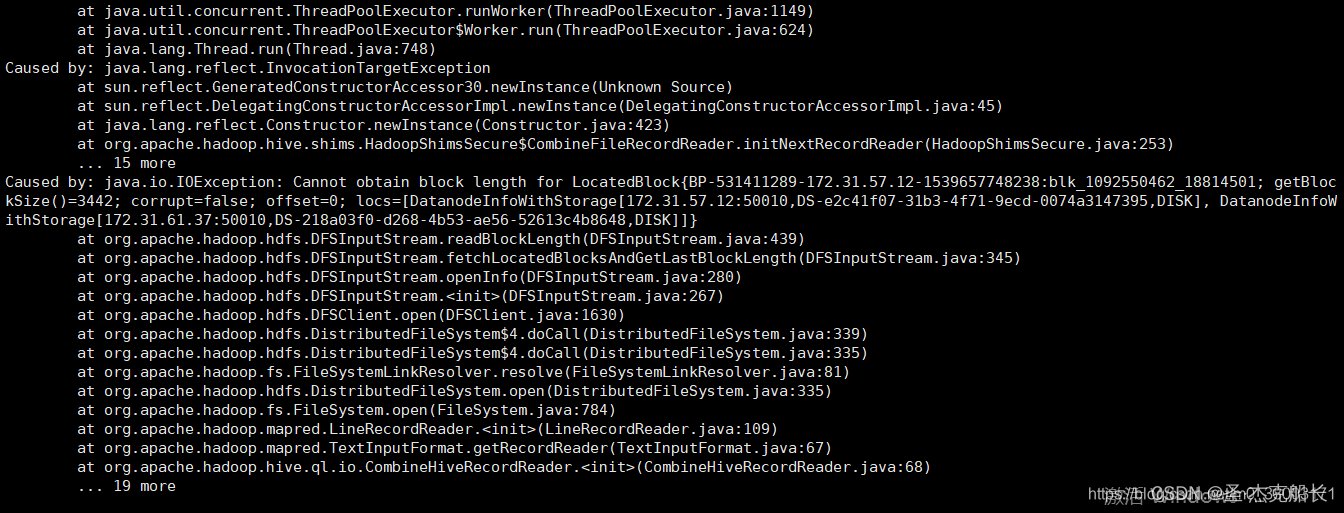

flume采集文本文件存储到hdfs中hive的ods层目录,并在hive中通过msck repair table刷新元数据,加载文本文件。报错如下:

2、问题分析

文件块BP-531411289-172.31.57.12-1539657748238出现了未知异常,导致namenode不能获取该文件块的信息,该文件块是由flume采集数据然后写入到hdfs的ods层,查询运维日志发现hdfs在此时有发生重启!

3、问题排查

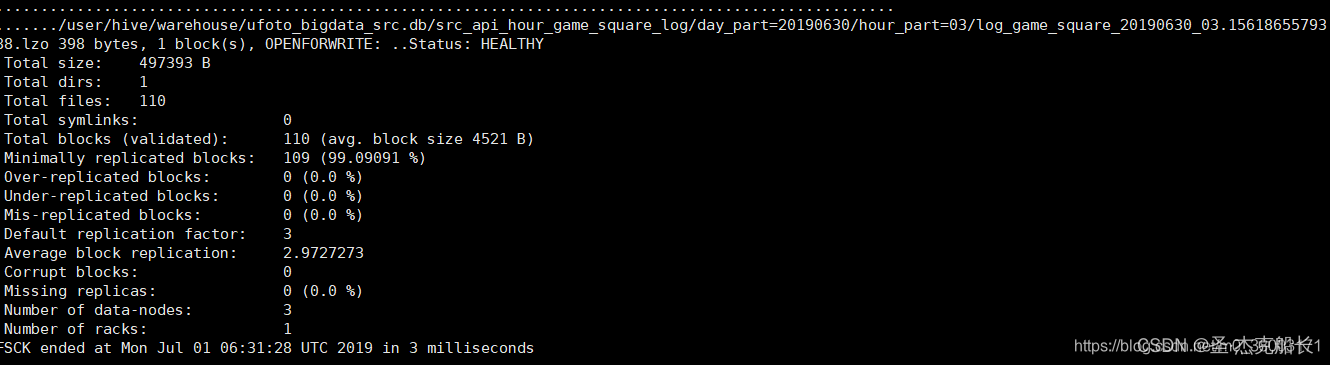

3.1、查看异常数据表block信息

hdfs fsck /user/hive/warehouse/ufoto_bigdata_src.db/src_api_hour_user_act_log/day_part=20190630/hour_part=03 -openforwrite

由以上检查结果发现:block平均副本数为2.9727273,正常block平均副本数为3,所以block确实发生异常。

3.2、修复损坏block

3.2.1、通过其他block自动修复

hdfs debug recoverLease -path /user/hive/warehouse/ufoto_bigdata_src.db/src_api_hour_game_square_log/day_part=20190630/hour_part=03/log_game_square_20190630_03.1561865579388.lzo -retries 13.2.2、手动修复损坏文件

如果方法1修复出现异常,可以通过该方法进行手动修复。

#删除无法修复的损坏文件和block(元数据层面的删除)

hdfs fsck -delete /user/hive/warehouse/ufoto_bigdata_src.db/src_api_hour_user_act_log/day_part=20190630/hour_part=03/file_name

#下载block(文件副本不足,可以读但是不可以写,因此下载文件block可以下载到正确的block)

hdfs dfs get /user/hive/warehouse/ufoto_bigdata_src.db/src_api_hour_user_act_log/day_part=20190630/hour_part=03/ <target_path>

#删除hdfs系统中损坏文件(物理层面的删除)

hdfs dfs -rm /user/hive/warehouse/ufoto_bigdata_src.db/src_api_hour_user_act_log/day_part=20190630/hour_part=03/*

#重新上传文件

hdfs dfs -put <target_path> /user/hive/warehouse/ufoto_bigdata_src.db/src_api_hour_user_act_log/day_part=20190630/hour_part=03

3226

3226

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?