文章目录

0. 前言

按照国际惯例,首先声明:本文只是我自己学习的理解,虽然参考了他人的宝贵见解及成果,但是内容可能存在不准确的地方。如果发现文中错误,希望批评指正,共同进步。

Attention is All You Need 这篇论文(以后称为“原文”)提出了一种新的神经网络架构——Transformer,它完全基于注意力机制,摒弃了传统的循环神经网络(RNN)和卷积神经网络(CNN)。

本文是这个系列的第一篇文章:

- 第一篇:提出背景、模型架构及推理过程(本篇)

- 第二篇:多头注意力机制

- 第三篇:位置编码

本篇将基于***Attention is All You Need***详细说明Transformer的提出背景、模型架构及推理过程。

1. Transformer的提出背景

传统的序列到序列(Seq2Seq)模型通常使用RNN或CNN来处理输入和输出序列。然而,这些模型在处理长距离依赖关系时存在困难,因为它们的计算复杂度随着序列长度的增加而增加。

- RNN:RNN通过逐步处理序列中的每个元素来捕捉序列中的依赖关系,但由于其顺序性,难以并行化,且在处理长序列时容易出现梯度消失或梯度爆炸问题。

- CNN:CNN通过卷积操作并行处理序列中的多个位置,但其计算复杂度仍然与序列长度相关,且需要多层卷积才能捕捉长距离依赖关系。

Transformer模型作为一种创新的解决方案,通过利用自注意力机制而非传统的递归网络,允许模型不考虑输入或输出序列中依赖关系的距离。克服了传统递归模型的局限性,从而实现了更高的效率和更好的性能。这对于需要处理大量数据和复杂模式识别的任务尤其重要,如自然语言处理中的文本生成、机器翻译等。

2. 模型架构概览

Transformer模型采用了经典的编码器-解码器(Encoder-Decoder)结构,但与传统的RNN或CNN不同,Transformer完全基于自注意力机制和前馈神经网络。

编码器-解码器的介绍可以参考此前文章:【单点知识】基于PyTorch讲解自动编码器(Autoencoder)。

3. Transformer的工作过程分解

Transformer的工作过程可以分为以下几个步骤:

-

输入嵌入(Input Embedding):词嵌入的作用是把每个单词(Token)转换成多维的连续的向量,关于词嵌入详细的说明可以参考此前文章【PyTorch单点知识】torch.nn.Embedding模块介绍:理解词向量与实现

-

位置编码(Positional Encoding):由于Transformer模型不使用传统的按顺序处理方式,它需要一种方法来理解单词(Token)在句子(Input)中的位置,位置编码就起到了这个作用。对于输入的 n n n个单词(Token)在词嵌入后,位置编码也会被添加到嵌入向量中,生成一个 ( n , d m o d e l ) (n, d_{model}) (n,dmodel)维的矩阵 X X X。

-

多头注意力机制(Multi-Head Attention):这是Transformer的核心部分。模型通过多头注意力机制来关注句子中的不同部分。例如,在处理“I love cats”时,模型可能会注意到“love”和“cats”之间的关系。详细原理可以参考此前文章【单点知识】多头注意力机制:torch.nn.MultiheadAttention的原理与实践

-

加法和归一化(Add & Norm):在多头注意力机制之后,模型的输出会与原始输入相加,并进行归一化处理。这有助于稳定训练过程。

-

前馈网络(Feed Forward):每个位置的向量会通过一个前馈神经网络进行进一步处理。这个网络通常由两层全连接层组成,中间有一个激活函数。

-

重复层(Nx):上述步骤(多头注意力、加法和归一化、前馈网络)会重复多次(N次),以提取更复杂的特征。

-

输出(Outputs):最终,模型的输出会被传递给一个线性层,然后通过Softmax函数生成概率分布。例如,在机器翻译任务中,这个概率分布可以用来预测下一个单词。

-

输出嵌入(Output Embedding):在生成任务中,输出序列通常需要被嵌入回词汇空间,以便生成最终的文本。

4. 举个例子

假设我们有一个简单的机器翻译任务:

-

输入序列(Inputs):英文句子“I ate chips”。

-

目标序列(Outputs):中文句子“我吃了薯片”。

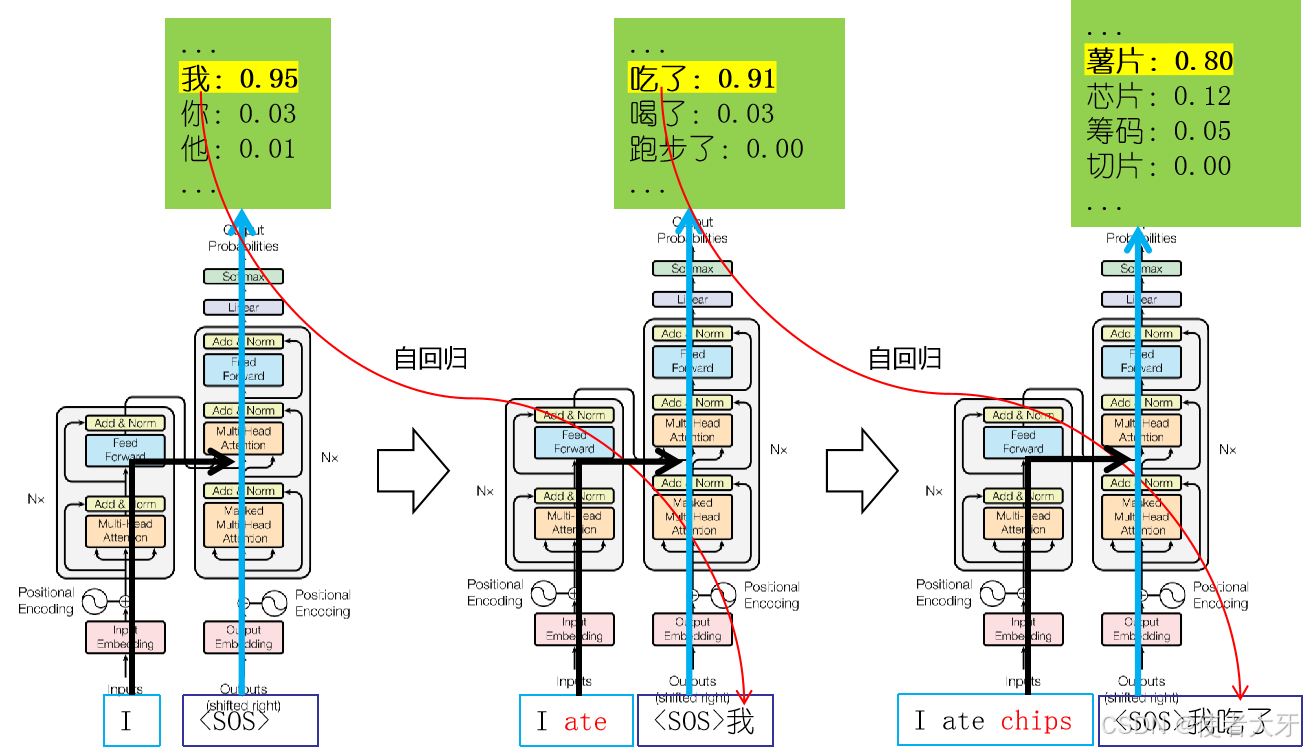

Transformer的整个推理过程可以用下图表示出来:

其中<SOS>是Start Of Sentence的意思,因为I是第一个输入,没有上一步的参考输出,只能用空位<SOS>填充。后续每一步的推理都会参考上一步的输出,即输出右移 (Outputs shifted right)。模型从 <SOS> 开始,逐步生成中文句子。具体推理步骤:

-

第一步:

- Inputs:

I - Output(shifted right):

<SOS> - 模型根据

I和<SOS>预测“我”是最佳的输出。

- Inputs:

-

第二步:

- Inputs:

ate - Output(shifted right):

<SOS>我 - 模型根据

ate和<SOS>我预测“吃了”是最佳的输出。

- Inputs:

-

第三步:

- Inputs:

chips - Output(shifted right):

<SOS>我吃了 - 模型根据

chips和<SOS>我吃了预测“薯片”是最佳的输出。

- Inputs:

而这里的翻译模型之所以能知道chips应该翻译成薯片而不是芯片或者是筹码,是因为前面的ate引起了chips的注意力,模型调整了chips的语义。

5. 编码器和解码器堆栈(Encoder and Decoder Stacks)

5.1 编码器

编码器由6个(Nx=6)相同的层堆叠而成,每层包含两个子层

- 多头自注意力(Multi-Head Self-Attention):允许模型在处理序列时同时关注序列中的不同位置。

- 前馈神经网络(Feed-Forward Network):一个简单的全连接网络,应用于每个位置。

每个子层(sub-layer)后面都使用了残差连接(Residual Connection)和层归一化(Layer Normalization),以帮助模型训练。为了把每个子层都链接起来,从嵌入层(Input Embedding和Output Embedding)开始(包括嵌入层),所有子层的维度 d m o d e l d_{model} dmodel都定为512(或者其他常数值)。

5.2 解码器

解码器也由6个(Nx=6)相同的层堆叠而成:

除了编码器中的两个子层外,解码器还增加了第三个子层Masked Multi-Head Attention,它是Transformer解码器中的一种特殊注意力机制,主要用于防止模型在生成序列时“偷看”未来的信息。在计算注意力分数时,未来的位置会被掩码(设置为一个极小的值,如负无穷)。这样,经过Softmax后,这些位置的注意力权重会变为0,模型无法关注未来的词。

6. 前馈神经网络(Position-wise Feed-Forward Networks)

在Transformer模型中,Position-wise Feed-Forward Networks(位置逐点前馈网络) 是每个编码器和解码器层中的一个重要组件。它的作用是对每个位置的表示进行非线性变换,进一步增强模型的表达能力。

6.1 前馈神经网络的作用

- 特征提取:对每个位置的表示(即每个词的向量)进行独立的非线性变换,提取更复杂的特征。

- 增强表达能力:通过多层感知机(MLP)结构,引入非线性激活函数(如ReLU),增强模型的表达能力。

- 位置独立性:每个位置的表示独立通过相同的全连接网络,因此称为“位置逐点”(Position-wise)。

6.2 前馈神经网络的结构

Position-wise Feed-Forward Networks 通常由两层全连接层组成:

1. 第一层:将输入从

d

model

d_{\text{model}}

dmodel(例如512)维映射到更高的维度(如

4

×

d

model

4 \times d_{\text{model}}

4×dmodel)。

2. 激活函数:在第一层之后应用非线性激活函数(如ReLU)。

3. 第二层:将高维表示映射回

d

model

d_{\text{model}}

dmodel维。

公式表示为:

FFN

(

x

)

=

max

(

0

,

x

W

1

+

b

1

)

W

2

+

b

2

\text{FFN}(x) = \max(0, x W_1 + b_1) W_2 + b_2

FFN(x)=max(0,xW1+b1)W2+b2

其中

W

1

W_1

W1、

W

2

W_2

W2 是可学习的权重矩阵,

b

1

b_1

b1、

b

2

b_2

b2是偏置项。

Position-wise Feed-Forward Networks 通常紧跟在多头注意力机制之后。注意力机制负责捕捉序列中词与词之间的关系,而Feed-Forward Networks 则对每个位置的表示进行进一步的非线性变换。两者结合,使得模型既能捕捉全局依赖关系,又能提取局部特征。

7. 总结

以上就是Transformer的整体架构介绍,通过举例说明了Transformer的具体推理过程。Transformer的另外两大重点:注意力和位置编码将在后面单独说明。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?