ftp写入hive时出现类型转换错误

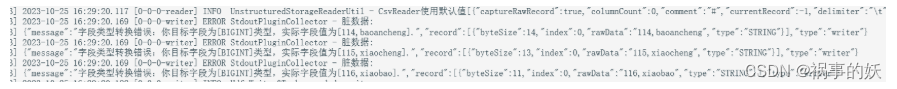

{"message":"字段类型转换错误:你目标字段为[BIGINT]类型,实际字段值为[114,baoancheng].","record":[{"byteSize":14,"index":0,"rawData":"114,baoancheng","type":"STRING"}],"type":"writer"}

如何解决?我把所有bigInt全部换成了string,为什么能行?这是由于datax把csv一行数据(114,xiaobao)识别为1列,所以才会出现类型转换异常,为什么会出现这个问题呢?

是由于ftpReader的 fieldDelimiter参数的值赋予错误,正确的应该是","而hiveWriter的fieldDelimiter参数的值取决于你在hive建表时的的 TERMINATED BY后的值,这样才能在hive中正确识别。还有一个现象就是ftp读csv文件不会读取第一行,这是由于把第一行认为是头如同名字一样

560

560

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?