目录

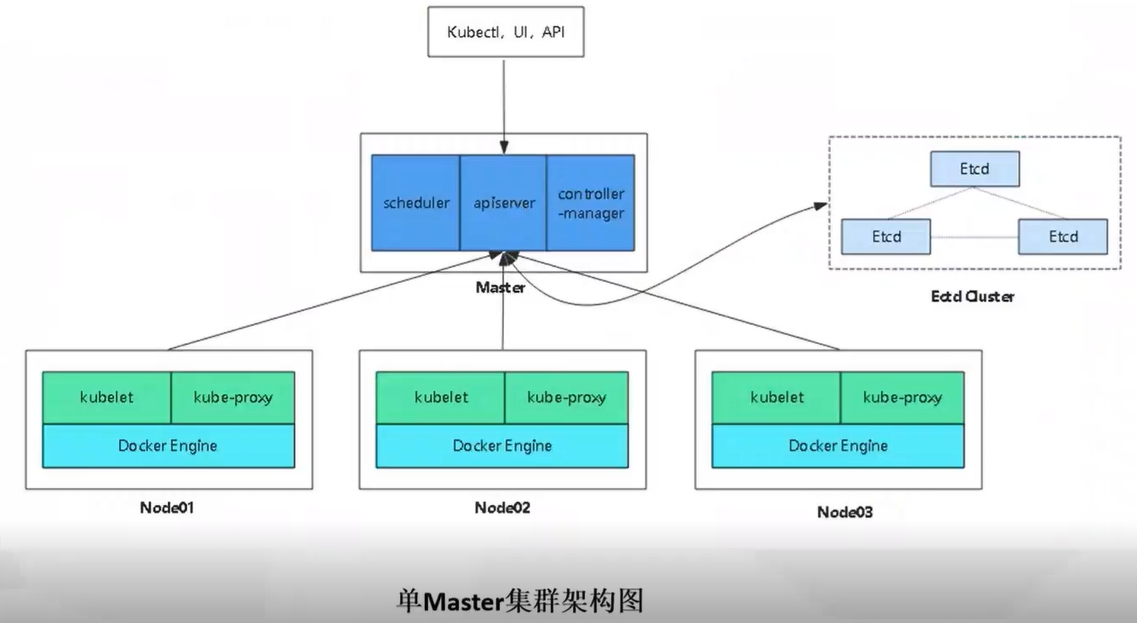

- 一、K8S 单 Master 节点二进制部署

- 1. 环境部署

- 2. 部署 etcd 集群

- 3. 部署 docker 引擎

- 4. 部署 flannel

- 5. 部署 master 组件

- 5.1 apiserver.sh

- 5.2 编写 scheduler.sh

- 5.3 编写 controller-manager.sh

- 5.4 编写 k8s-cert.sh

- 5.5 赋予权限

- 5.6 创建 kubernetes 工作目录

- 5.7 生成 CA 证书、相关组件的证书和私钥

- 5.8 复制 CA 证书、apiserver 相关证书和私钥到 kubernetes 工作目录的 ssl 子目录中

- 5.9 下载或上传 kubernetes 安装包到 /opt/k8s 目录,并解压

- 5.10 复制 master 组件的关键命令文件到 kubernetes 工作目录的 bin 子目录中

- 5.11 创建 bootstrap token 认证文件

- 5.12 二进制文件、token、证书都准备好后,开启 apiserver 服务

- 5.13 检查进程是否启动成功

- 5.14 检查 6443 端口

- 5.15 检查 8080 端口

- 5.16 查看版本信息

- 5.17 启动 scheduler 服务

- 5.18 启动 controller-manager 服务

- 5.19 查看 master 节点状态

- 6. 部署 Worker Node 组件

- 6.1 把 kubelet、kube-proxy 拷贝到 node 节点(master01 节点)

- 6.2 编写脚本

- 6.3 赋予脚本执行权限

- 6.4 master01 节点操作

- 6.5 生成 kubelet 的配置文件

- 6.6 把配置文件 bootstrap.kubeconfig、kube-proxy.kubeconfig 拷贝到 node 节点

- 6.7 RBAC 授权及相关说明

- 6.8 查看角色

- 6.9 查看已授权的角色

- 6.10 使用 kubelet.sh 脚本启动 kubelet 服务

- 6.11 检查 kubelet 服务启动

- 6.12 查看当前 ssl 目录

- 6.13 查看 CSR 请求

- 6.14 通过 CSR 请求

- 6.15 再次查看 CSR 请求状态

- 6.16 查看集群节点状态

- 6.17 node01 节点上操作

- 6.18 node02 节点部署

- 7. K8S 单节点测试

- 二、多 Master 节点二进制部署

一、K8S 单 Master 节点二进制部署

1. 环境部署

| 服务器 | 主机名 | IP地址 | 主要组件/说明 |

|---|---|---|---|

| master01 节点 + etcd01 节点 | master01 | 192.168.8.18 | kube-apiserver kube-controller-manager kube-schedular etcd |

| node01 节点 + etcd02 节点 | node01 | 192.168.8.19 | kubelet kube-proxy docker flannel |

| node02 节点 + etcd03 节点 | node02 | 192.168.8.20 | kubelet kube-proxy docker flannel |

- 关闭防火墙

systemctl stop firewalld && systemctl disable firewalld

setenforce 0

- 关闭 swap

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab

- 添加 hosts

cat >> /etc/hosts << EOF

192.168.8.18 master01

192.168.8.19 node01

192.168.8.20 node02

EOF

- 将桥接的 IPv4 流量传递到 iptables 的链

cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

sysctl --system

- 时间同步

yum install ntpdate -y

ntpdate time.windows.com

2. 部署 etcd 集群

- 下载证书制作工具

[root@master01 ~]# wget https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -O /usr/local/bin/cfssl

[root@master01 ~]# wget https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -O /usr/local/bin/cfssljson

[root@master01 ~]# wget https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -O /usr/local/bin/cfssl-certinfo

[root@master01 ~]# chmod +x /usr/local/bin/cfssl*

或

curl -L https://pkg.cfssl.org/R1.2/cfssl_linux-amd64 -o /usr/local/bin/cfssl

curl -L https://pkg.cfssl.org/R1.2/cfssljson_linux-amd64 -o /usr/local/bin/cfssljson

curl -L https://pkg.cfssl.org/R1.2/cfssl-certinfo_linux-amd64 -o /usr/local/bin/cfssl-certinfo

chmod +x /usr/local/bin/cfssl*

2.1 创建 k8s 工作目录

mkdir /opt/k8s

cd /opt/k8s

2.2 编写 etcd-cert.sh 和 etcd.sh 脚本

etcd-cert.sh

vim etcd-cert.sh

#!/bin/bash

#配置证书生成策略,让 CA 软件知道颁发有什么功能的证书,生成用来签发其他组件证书的根证书

cat > ca-config.json <<EOF

{

"signing": {

"default": {

"expiry": "87600h"

},

"profiles": {

"www": {

"expiry": "87600h",

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

]

}

}

}

}

EOF

#ca-config.json:可以定义多个 profiles,分别指定不同的过期时间、使用场景等参数;

#后续在签名证书时会使用某个 profile;此实例只有一个 www 模板。

#expiry:指定了证书的有效期,87600h 为10年,如果用默认值一年的话,证书到期后集群会立即宕掉

#signing:表示该证书可用于签名其它证书;生成的 ca.pem 证书中 CA=TRUE;

#key encipherment:表示使用非对称密钥加密,如 RSA 加密;

#server auth:表示client可以用该 CA 对 server 提供的证书进行验证;

#client auth:表示server可以用该 CA 对 client 提供的证书进行验证;

#注意标点符号,最后一个字段一般是没有逗号的。

----------------------------------------------------------------------------------------------

#生成CA证书和私钥(根证书和私钥)

#特别说明: cfssl和openssl有一些区别,openssl需要先生成私钥,然后用私钥生成请求文件,最后生成签名的证书和私钥等,但是cfssl可以直接得到请求文件。

cat > ca-csr.json <<EOF

{

"CN": "etcd",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "Beijing",

"ST": "Beijing"

}

]

}

EOF

#CN:Common Name,浏览器使用该字段验证网站或机构是否合法,一般写的是域名

#key:指定了加密算法,一般使用rsa(size:2048)

#C:Country,国家

#ST:State,州,省

#L:Locality,地区,城市

#O: Organization Name,组织名称,公司名称

#OU: Organization Unit Name,组织单位名称,公司部门

cfssl gencert -initca ca-csr.json | cfssljson -bare ca

#生成的文件:

#ca-key.pem:根证书私钥

#ca.pem:根证书

#ca.csr:根证书签发请求文件

#cfssl gencert -initca <CSRJSON>:使用 CSRJSON 文件生成生成新的证书和私钥。如果不添加管道符号,会直接把所有证书内容输出到屏幕。

#注意:CSRJSON 文件用的是相对路径,所以 cfssl 的时候需要 csr 文件的路径下执行,也可以指定为绝对路径。

#cfssljson 将 cfssl 生成的证书(json格式)变为文件承载式证书,-bare 用于命名生成的证书文件。

------------------------------------------------------------------------------------------------

#生成 etcd 服务器证书和私钥

cat > server-csr.json <<EOF

{

"CN": "etcd",

"hosts": [

"192.168.8.18",

"192.168.8.19",

"192.168.8.20"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing"

}

]

}

EOF

#hosts:将所有 etcd 集群节点添加到 host 列表,需要指定所有 etcd 集群的节点 ip 或主机名不能使用网段,新增 etcd 服务器需要重新签发证书。

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=www server-csr.json | cfssljson -bare server

#生成的文件:

#server.csr:服务器的证书请求文件

#server-key.pem:服务器的私钥

#server.pem:服务器的数字签名证书

#-config:引用证书生成策略文件 ca-config.json

#-profile:指定证书生成策略文件中的的使用场景,比如 ca-config.json 中的 www

chmod +x etcd-cert.sh

etcd.sh

vim etcd.sh

#!/bin/bash

# example: ./etcd.sh etcd01 192.168.8.18 etcd02=https://192.168.8.19:2380,etcd03=https://192.168.8.20:2380

#创建etcd配置文件/opt/etcd/cfg/etcd

ETCD_NAME=$1

ETCD_IP=$2

ETCD_CLUSTER=$3

WORK_DIR=/opt/etcd

cat > $WORK_DIR/cfg/etcd <<EOF

#[Member]

ETCD_NAME="${ETCD_NAME}"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://${ETCD_IP}:2380"

ETCD_LISTEN_CLIENT_URLS="https://${ETCD_IP}:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://${ETCD_IP}:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://${ETCD_IP}:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://${ETCD_IP}:2380,${ETCD_CLUSTER}"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

EOF

#Member:成员配置

#ETCD_NAME:节点名称,集群中唯一。成员名字,集群中必须具备唯一性,如etcd01

#ETCD_DATA_DIR:数据目录。指定节点的数据存储目录,这些数据包括节点ID,集群ID,集群初始化配置,Snapshot文件,若未指定-wal-dir,还会存储WAL文件;如果不指定会用缺省目录

#ETCD_LISTEN_PEER_URLS:集群通信监听地址。用于监听其他member发送信息的地址。ip为全0代表监听本机所有接口

#ETCD_LISTEN_CLIENT_URLS:客户端访问监听地址。用于监听etcd客户发送信息的地址。ip为全0代表监听本机所有接口

#Clustering:集群配置

#ETCD_INITIAL_ADVERTISE_PEER_URLS:集群通告地址。其他member使用,其他member通过该地址与本member交互信息。一定要保证从其他member能可访问该地址。静态配置方式下,该参数的value一定要同时在--initial-cluster参数中存在

#ETCD_ADVERTISE_CLIENT_URLS:客户端通告地址。etcd客户端使用,客户端通过该地址与本member交互信息。一定要保证从客户侧能可访问该地址

#ETCD_INITIAL_CLUSTER:集群节点地址。本member使用。描述集群中所有节点的信息,本member根据此信息去联系其他member

#ETCD_INITIAL_CLUSTER_TOKEN:集群Token。用于区分不同集群。本地如有多个集群要设为不同

#ETCD_INITIAL_CLUSTER_STATE:加入集群的当前状态,new是新集群,existing表示加入已有集群。

#创建etcd.service服务管理文件

cat > /usr/lib/systemd/system/etcd.service <<EOF

[Unit]

Description=Etcd Server

After=network.target

After=network-online.target

Wants=network-online.target

[Service]

Type=notify

EnvironmentFile=${WORK_DIR}/cfg/etcd

ExecStart=${WORK_DIR}/bin/etcd \

--name=\${ETCD_NAME} \

--data-dir=\${ETCD_DATA_DIR} \

--listen-peer-urls=\${ETCD_LISTEN_PEER_URLS} \

--listen-client-urls=\${ETCD_LISTEN_CLIENT_URLS},http://127.0.0.1:2379 \

--advertise-client-urls=\${ETCD_ADVERTISE_CLIENT_URLS} \

--initial-advertise-peer-urls=\${ETCD_INITIAL_ADVERTISE_PEER_URLS} \

--initial-cluster=\${ETCD_INITIAL_CLUSTER} \

--initial-cluster-token=\${ETCD_INITIAL_CLUSTER_TOKEN} \

--initial-cluster-state=new \

--cert-file=${WORK_DIR}/ssl/server.pem \

--key-file=${WORK_DIR}/ssl/server-key.pem \

--trusted-ca-file=${WORK_DIR}/ssl/ca.pem \

--peer-cert-file=${WORK_DIR}/ssl/server.pem \

--peer-key-file=${WORK_DIR}/ssl/server-key.pem \

--peer-trusted-ca-file=${WORK_DIR}/ssl/ca.pem

Restart=on-failure

LimitNOFILE=65536

[Install]

WantedBy=multi-user.target

EOF

#--listen-client-urls:用于指定etcd和客户端的连接端口

#--advertise-client-urls:用于指定etcd服务器之间通讯的端口,etcd有要求,如果--listen-client-urls被设置了,那么就必须同时设置--advertise-client-urls,所以即使设置和默认相同,也必须显式设置

#--peer开头的配置项用于指定集群内部TLS相关证书(peer 证书),这里全部都使用同一套证书认证

#不带--peer开头的的参数是指定 etcd 服务器TLS相关证书(server 证书),这里全部都使用同一套证书认证

systemctl daemon-reload

systemctl enable etcd

systemctl restart etcd

chmod +x etcd.sh

2.3 生成 CA 证书、etcd 服务器证书以及私钥

mkdir /opt/k8s/etcd-cert

mv etcd-cert.sh etcd-cert/

cd /opt/k8s/etcd-cert/

./etcd-cert.sh

#生成CA证书、etcd服务器证书以及私钥

2.4 启动 etcd 服务

- ① 安装 etcd 服务

cd /opt/k8s

#上传etcd安装包etcd-v3.3.10-linux-amd64.tar.gz

#https://github.com/etcd-io/etcd/releases/download/v3.3.10/

tar zxvf etcd-v3.3.10-linux-amd64.tar.gz

- ② 创建用于存放 etcd 配置文件、命令文件、证书的目录

mkdir -p /opt/etcd/{cfg,bin,ssl}

mv /opt/k8s/etcd-v3.3.10-linux-amd64/etcd /opt/k8s/etcd-v3.3.10-linux-amd64/etcdctl /opt/etcd/bin/

cp /opt/k8s/etcd-cert/*.pem /opt/etcd/ssl/

- ③ 启动 etcd.sh 脚本

[root@master01 k8s]# ls

etcd-cert etcd.sh etcd-v3.3.10-linux-amd64 etcd-v3.3.10-linux-amd64.tar.

[root@master01 /opt/k8s]# ./etcd.sh etcd01 192.168.8.18 etcd02=https://192.168.8.19:2380,etcd03=https://192.168.8.20:2380

Created symlink from /etc/systemd/system/multi-user.target.wants/etcd.service to /usr/lib/systemd/system/etcd.service.

......

进入卡住状态等待其他节点加入,这里需要三台 etcd 服务同时启动,如果只启动其中一台后,服务会卡在那里,直到集群中所有 etcd 节点都已启动 另外打开一个窗口查看 etcd 进程是否正常

-

重新开一个终端查看进程是否正常

-

④ 把 etcd 相关证书文件和命令文件全部拷贝到另外两个 etcd 集群节点

[root@master01 ~]# scp -r /opt/etcd/ root@192.168.8.19:/opt/etcd/

[root@master01 ~]# scp -r /opt/etcd/ root@192.168.8.20:/opt/etcd/

- ⑤ 把 etcd 服务管理文件拷贝到了另外两个 etcd 集群节点

[root@master01 ~]# scp /usr/lib/systemd/system/etcd.service root@192.168.8.19:/usr/lib/systemd/system/

[root@master01 ~]# scp /usr/lib/systemd/system/etcd.service root@192.168.8.20:/usr/lib/systemd/system/

- ⑥ 修改另外两个 etcd 集群节点的配置文件

node01 192.168.8.19

[root@node01 ~]# cd /opt/etcd/cfg/

[root@node01 cfg]# ls

etcd

[root@node01 cfg]# vim etcd

#[Member]

ETCD_NAME="etcd02"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.8.19:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.8.19:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.8.19:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.8.19:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.8.18:2380,etcd02=https://192.168.8.19:2380,etcd03=https://192.168.8.20:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

[root@node01 /opt/etcd/cfg]#systemctl daemon-reload

[root@node01 /opt/etcd/cfg]#systemctl enable --now etcd.service

Created symlink from /etc/systemd/system/multi-user.target.wants/etcd.service to /usr/lib/systemd/system/etcd.service.

[root@node01 /opt/etcd/cfg]#systemctl status etcd | grep Active

Active: active (running) since 三 2021-12-15 15:34:59 CST; 5s ago

node02 同上,需要修改节点名和 IP 地址

[root@node02 /opt]#cd etcd/cfg/

[root@node02 /opt/etcd/cfg]#ls

etcd

[root@node02 /opt/etcd/cfg]#vim etcd

[root@node02 /opt/etcd/cfg]#cat etcd

#[Member]

ETCD_NAME="etcd03"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.8.20:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.8.20:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.8.20:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.8.20:2379"

ETCD_INITIAL_CLUSTER="etcd01=https://192.168.8.18:2380,etcd02=https://192.168.8.19:2380,etcd03=https://192.168.8.20:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

[root@node02 /opt/etcd/cfg]#systemctl daemon-reload

[root@node02 /opt/etcd/cfg]#systemctl enable --now etcd.service

Created symlink from /etc/systemd/system/multi-user.target.wants/etcd.service to /usr/lib/systemd/system/etcd.service.

[root@node02 /opt/etcd/cfg]#systemctl status etcd | grep Active

Active: active (running) since 三 2021-12-15 15:40:07 CST; 13s ago

- ⑦ 检查集群状态 master01

v2版本查看(默认版本)

[root@master01 k8s]# ln -s /opt/etcd/bin/etcd* /usr/local/bin

#将etcd执行命令软链接到PATH路径

cd /opt/etcd/ssl/

etcdctl --ca-file=ca.pem --cert-file=server.pem --key-file=server-key.pem --endpoints="https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379" cluster-health

--cert-file:识别 HTTPS 端使用 SSL 证书文件

--key-file:使用此 SSL 密钥文件标识 HTTPS 客户端

--ca-file:使用此 CA 证书验证启用 https 的服务器的证书

--endpoints:集群中以逗号分隔的机器地址列表

cluster-health:检查 etcd 集群的运行状况

v3版本查看

切换到 etcd3 版本查看集群节点状态和成员列表

v2 和 v3 命令略有不同,etcd2 和 etcd3 也是不兼容的,默认版本是 v2 版本

[root@master01 /opt/etcd/ssl]#export ETCDCTL_API=3

[root@master01 /opt/etcd/ssl]#etcdctl --write-out=table endpoint status

+----------------+------------------+---------+---------+-----------+-----------+------------+

| ENDPOINT | ID | VERSION | DB SIZE | IS LEADER | RAFT TERM | RAFT INDEX |

+----------------+------------------+---------+---------+-----------+-----------+------------+

| 127.0.0.1:2379 | 6834637fe0d65123 | 3.3.10 | 20 kB | true | 758 | 12 |

+----------------+------------------+---------+---------+-----------+-----------+------------+

[root@master01 /opt/etcd/ssl]#etcdctl --write-out=table member list

+------------------+---------+--------+---------------------------+---------------------------+

| ID | STATUS | NAME | PEER ADDRS | CLIENT ADDRS |

+------------------+---------+--------+---------------------------+---------------------------+

| 8e2fad057749fb | started | etcd02 | https://192.168.8.19:2380 | https://192.168.8.19:2379 |

| 6834637fe0d65123 | started | etcd01 | https://192.168.8.18:2380 | https://192.168.8.18:2379 |

| e10b8b23f348890e | started | etcd03 | https://192.168.8.20:2380 | https://192.168.8.20:2379 |

+------------------+---------+--------+---------------------------+---------------------------+

[root@master01 /opt/etcd/ssl]#export ETCDCTL_API=2 #返回V2版本

3. 部署 docker 引擎

node01 192.168.8.19

node02 192.168.8.20

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

yum install -y docker-ce docker-ce-cli containerd.io

systemctl enable --now docker

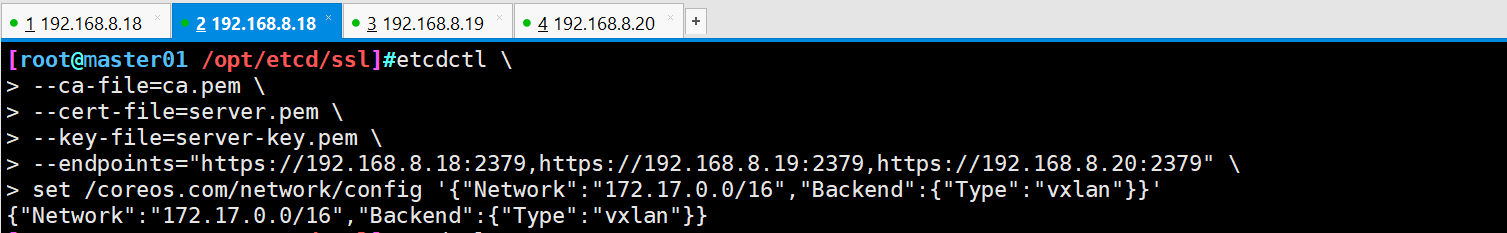

4. 部署 flannel

4.1 master01 节点操作

添加 flannel 网络配置信息,写入分配的子网段到 etcd 中,供 flannel 使用

etcdctl \

--ca-file=ca.pem \

--cert-file=server.pem \

--key-file=server-key.pem \

--endpoints="https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379" \

set /coreos.com/network/config '{"Network":"172.17.0.0/16","Backend":{"Type":"vxlan"}}'

set :给键赋值

set /coreos.com/network/config:添加一条网络配置记录,这个配置将用于 flannel 分配给每个 docker 的虚拟 IP 地址段

get :获取网络配置记录,后面不用再跟参数

Network:用于指定 Flannel 地址池

Backend:用于指定数据包以什么方式转发,默认为 udp 模式,Backend 为 vxlan 比起预设的 udp 性能相对好一些。

4.2 所有 node 节点操作

- ① 安装 flannel

#上传 flannel 安装包 flannel-v.0.10.0-linux-amd64.tar.gz 到 /opt 目录中

cd /opt/

rz -E #上传安装包

tar zxvf flannel-v0.10.0-linux-amd64.tar.gz

flanneld 为主要的执行文件

mk-docker-opts.sh 脚本用于生成 Docker 启动参数

- ② 编写 flannel.sh 脚本

vim flannel.sh

#!/bin/bash

#定义etcd集群的端点IP地址和对外提供服务的2379端口

#${var:-string}:若变量var为空,则用在命令行中用string来替换;否则变量var不为空时,则用变量var的值来替换,这里的1代表的是位置变量$1

ETCD_ENDPOINTS=${1:-"http://127.0.0.1:2379"}

#创建flanneld配置文件

cat > /opt/kubernetes/cfg/flanneld <<EOF

FLANNEL_OPTIONS="--etcd-endpoints=${ETCD_ENDPOINTS} \\

-etcd-cafile=/opt/etcd/ssl/ca.pem \\

-etcd-certfile=/opt/etcd/ssl/server.pem \\

-etcd-keyfile=/opt/etcd/ssl/server-key.pem"

EOF

#flanneld 本应使用 etcd 客户端TLS相关证书(client 证书),这里全部都使用同一套证书认证。

#创建flanneld.service服务管理文件

cat > /usr/lib/systemd/system/flanneld.service <<EOF

[Unit]

Description=Flanneld overlay address etcd agent

After=network-online.target network.target

Before=docker.service

[Service]

Type=notify

EnvironmentFile=/opt/kubernetes/cfg/flanneld

ExecStart=/opt/kubernetes/bin/flanneld --ip-masq \$FLANNEL_OPTIONS

ExecStartPost=/opt/kubernetes/bin/mk-docker-opts.sh -k DOCKER_NETWORK_OPTIONS -d /run/flannel/subnet.env

Restart=on-failure

[Install]

WantedBy=multi-user.target

EOF

#flanneld启动后会使用 mk-docker-opts.sh 脚本生成 docker 网络相关配置信息

#mk-docker-opts.sh -k DOCKER_NETWORK_OPTIONS:将组合选项键设置为环境变量DOCKER_NETWORK_OPTIONS,docker启动时将使用此变量

#mk-docker-opts.sh -d /run/flannel/subnet.env:指定要生成的docker网络相关信息配置文件的路径,docker启动时候引用此配置

systemctl daemon-reload

systemctl enable flanneld

systemctl restart flanneld

- ③ 创建 kubenetes 工作目录

mkdir -p /opt/kubernetes/{cfg,bin,ssl}

mv mk-docker-opts.sh flanneld /opt/kubernetes/bin/

- ④ 启动 flannel 服务,开启 flannel 网络功能

chmod +x flannel.sh

./flannel.sh https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379

systemctl status flanneld.service | grep Active

flannel 启动后会生成一个 docker 网络相关信息配置文件 /run/flannel/subnet.env,包含了 docker要使用 flannel 通讯的相关参数

node01

[root@node01 /opt]#cat /run/flannel/subnet.env

DOCKER_OPT_BIP="--bip=172.17.57.1/24"

DOCKER_OPT_IPMASQ="--ip-masq=false"

DOCKER_OPT_MTU="--mtu=1450"

DOCKER_NETWORK_OPTIONS=" --bip=172.17.57.1/24 --ip-masq=false --mtu=1450"

node02

[root@node02 /opt]#cat /run/flannel/subnet.env

DOCKER_OPT_BIP="--bip=172.17.73.1/24"

DOCKER_OPT_IPMASQ="--ip-masq=false"

DOCKER_OPT_MTU="--mtu=1450"

DOCKER_NETWORK_OPTIONS=" --bip=172.17.73.1/24 --ip-masq=false --mtu=1450"

–bip:指定 docker 启动时的子网

–ip-masq:设置 ipmasq=false 关闭 snat 伪装策略

–mtu=1450:mtu 要留出 50 字节给外层的 vxlan 封包的额外开销使用

- ⑤ 修改 docker0 网卡网段与 flannel 一致

添加 docker 环境变量

[root@node01 opt]# vim /lib/systemd/system/docker.service

#13行下插入环境文件

EnvironmentFile=/run/flannel/subnet.env

#13行,添加变量$DOCKER_NETWORK_OPTIONS

ExecStart=/usr/bin/dockerd $DOCKER_NETWORK_OPTIONS -H fd:// --containerd=/run/containerd/containerd.sock

systemctl daemon-reload

systemctl restart docker

node01

node02

- ⑥ 容器间跨网通信

node01

[root@node01 ~]# docker pull centos:7

[root@node01 ~]#docker run -itd centos:7 bash

5133f7d27376885d7612e9ae83016a86164ccd5fe2302119011f9f7ef7d30a16

[root@node01 ~]#docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

5133f7d27376 centos:7 "bash" 7 seconds ago Up 7 seconds great_snyder

[root@node01 ~]#docker exec -it 5133f7d27376 bash

[root@5133f7d27376 /]# yum -y install net-tools

[root@5133f7d27376 /]# ifconfig

eth0: flags=4163<UP,BROADCAST,RUNNING,MULTICAST> mtu 1450

inet 172.17.57.2 netmask 255.255.255.0 broadcast 172.17.57.255

ether 02:42:ac:11:39:02 txqueuelen 0 (Ethernet)

RX packets 27868 bytes 21477604 (20.4 MiB)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 13747 bytes 745713 (728.2 KiB)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

lo: flags=73<UP,LOOPBACK,RUNNING> mtu 65536

inet 127.0.0.1 netmask 255.0.0.0

loop txqueuelen 1 (Local Loopback)

RX packets 0 bytes 0 (0.0 B)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 0 bytes 0 (0.0 B)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

node02

[root@node02 ~]# docker pull centos:7

[root@node02 ~]#docker run -itd centos:7 bash

2e082bddc239fbdf5e730e0d7e3ed32fbf3f0a84b43b185a7510ef11a0d35d12

[root@node02 ~]#docker ps -a

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

2e082bddc239 centos:7 "bash" 4 seconds ago Up 3 seconds romantic_mayer

[root@node02 ~]#docker exec -it 2e082bddc239 bash

[root@2e082bddc239 /]#yum -y install net-tools

[root@2e082bddc239 /]# ifconfig

eth0: flags=4163<UP,BROADCAST,RUNNING,MULTICAST> mtu 1450

inet 172.17.73.2 netmask 255.255.255.0 broadcast 172.17.73.255

ether 02:42:ac:11:49:02 txqueuelen 0 (Ethernet)

RX packets 28071 bytes 21494118 (20.4 MiB)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 14105 bytes 764951 (747.0 KiB)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

lo: flags=73<UP,LOOPBACK,RUNNING> mtu 65536

inet 127.0.0.1 netmask 255.0.0.0

loop txqueuelen 1 (Local Loopback)

RX packets 0 bytes 0 (0.0 B)

RX errors 0 dropped 0 overruns 0 frame 0

TX packets 0 bytes 0 (0.0 B)

TX errors 0 dropped 0 overruns 0 carrier 0 collisions 0

- 检测是否互通

node02

[root@2e082bddc239 /]# ping -I 172.17.73.2 172.17.57.2

PING 172.17.57.2 (172.17.57.2) from 172.17.73.2 : 56(84) bytes of data.

64 bytes from 172.17.57.2: icmp_seq=1 ttl=62 time=0.424 ms

64 bytes from 172.17.57.2: icmp_seq=2 ttl=62 time=0.419 ms

64 bytes from 172.17.57.2: icmp_seq=3 ttl=62 time=0.512 ms

64 bytes from 172.17.57.2: icmp_seq=4 ttl=62 time=0.621 ms

64 bytes from 172.17.57.2: icmp_seq=5 ttl=62 time=0.274 ms

^C

--- 172.17.57.2 ping statistics ---

5 packets transmitted, 5 received, 0% packet loss, time 4001ms

rtt min/avg/max/mdev = 0.274/0.450/0.621/0.114 ms

node01

[root@5133f7d27376 /]# ping -I 172.17.57.2 172.17.73.2

PING 172.17.73.2 (172.17.73.2) from 172.17.57.2 : 56(84) bytes of data.

64 bytes from 172.17.73.2: icmp_seq=1 ttl=62 time=0.518 ms

64 bytes from 172.17.73.2: icmp_seq=2 ttl=62 time=0.342 ms

64 bytes from 172.17.73.2: icmp_seq=3 ttl=62 time=0.275 ms

64 bytes from 172.17.73.2: icmp_seq=4 ttl=62 time=0.496 ms

^C

--- 172.17.73.2 ping statistics ---

4 packets transmitted, 4 received, 0% packet loss, time 3003ms

rtt min/avg/max/mdev = 0.275/0.407/0.518/0.105 ms

5. 部署 master 组件

master01 节点

192.168.8.18

编写 apiserver.sh、scheduler.sh、controller-manager.sh

5.1 apiserver.sh

[root@master01 ~]# cd /opt/k8s

[root@master01 k8s]# vim apiserver.sh

#!/bin/bash

#example: apiserver.sh 192.168.8.18 https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379

#创建 kube-apiserver 启动参数配置文件

MASTER_ADDRESS=$1

ETCD_SERVERS=$2

cat >/opt/kubernetes/cfg/kube-apiserver <<EOF

KUBE_APISERVER_OPTS="--logtostderr=true \\

--v=4 \\

--etcd-servers=${ETCD_SERVERS} \\

--bind-address=${MASTER_ADDRESS} \\

--secure-port=6443 \\

--advertise-address=${MASTER_ADDRESS} \\

--allow-privileged=true \\

--service-cluster-ip-range=10.0.0.0/24 \\

--enable-admission-plugins=NamespaceLifecycle,LimitRanger,ServiceAccount,ResourceQuota,NodeRestriction \\

--authorization-mode=RBAC,Node \\

--kubelet-https=true \\

--enable-bootstrap-token-auth \\

--token-auth-file=/opt/kubernetes/cfg/token.csv \\

--service-node-port-range=30000-50000 \\

--tls-cert-file=/opt/kubernetes/ssl/apiserver.pem \\

--tls-private-key-file=/opt/kubernetes/ssl/apiserver-key.pem \\

--client-ca-file=/opt/kubernetes/ssl/ca.pem \\

--service-account-key-file=/opt/kubernetes/ssl/ca-key.pem \\

--etcd-cafile=/opt/etcd/ssl/ca.pem \\

--etcd-certfile=/opt/etcd/ssl/server.pem \\

--etcd-keyfile=/opt/etcd/ssl/server-key.pem"

EOF

#--logtostderr=true:输出日志到标准错误控制台,不输出到文件

#--v=4:指定输出日志的级别,v=4为调试级别详细输出

#--etcd-servers:指定etcd服务器列表(格式://ip:port),逗号分隔

#--bind-address:指定 HTTPS 安全接口的监听地址,默认值0.0.0.0

#--secure-port:指定 HTTPS 安全接口的监听端口,默认值6443

#--advertise-address:通过该 ip 地址向集群其他节点公布 api server 的信息,必须能够被其他节点访问

#--allow-privileged=true:允许拥有系统特权的容器运行,默认值false

#--service-cluster-ip-range:指定 Service Cluster IP 地址段

#--enable-admission-plugins:kuberneres集群的准入控制机制,各控制模块以插件的形式依次生效,集群时必须包含ServiceAccount,运行在认证(Authentication)、授权(Authorization)之后,Admission Control是权限认证链上的最后一环, 对请求API资源对象进行修改和校验

#--authorization-mode:在安全端口使用RBAC,Node授权模式,未通过授权的请求拒绝,默认值AlwaysAllow。RBAC是用户通过角色与权限进行关联的模式;Node模式(节点授权)是一种特殊用途的授权模式,专门授权由kubelet发出的API请求,在进行认证时,先通过用户名、用户分组验证是否是集群中的Node节点,只有是Node节点的请求才能使用Node模式授权

#--kubelet-https=true:kubelet通信使用https,默认值true

#--enable-bootstrap-token-auth:在apiserver上启用Bootstrap Token 认证

#--token-auth-file=/opt/kubernetes/cfg/token.csv:指定Token认证文件路径

#--service-node-port-range:指定 NodePort 的端口范围,默认值30000-32767

#创建 kube-apiserver.service 服务管理文件

cat >/usr/lib/systemd/system/kube-apiserver.service <<EOF

[Unit]

Description=Kubernetes API Server

Documentation=https://github.com/kubernetes/kubernetes

[Service]

EnvironmentFile=-/opt/kubernetes/cfg/kube-apiserver

ExecStart=/opt/kubernetes/bin/kube-apiserver \$KUBE_APISERVER_OPTS

Restart=on-failure

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

systemctl enable kube-apiserver

systemctl restart kube-apiserver

5.2 编写 scheduler.sh

[root@master01 k8s]# vim scheduler.sh

#!/bin/bash

#创建 kube-scheduler 启动参数配置文件

MASTER_ADDRESS=$1

cat >/opt/kubernetes/cfg/kube-scheduler <<EOF

KUBE_SCHEDULER_OPTS="--logtostderr=true \\

--v=4 \\

--master=${MASTER_ADDRESS}:8080 \\

--leader-elect=true"

EOF

#--master:监听 apiserver 的地址和8080端口

#--leader-elect=true:启动 leader 选举

#k8s中Controller-Manager和Scheduler的选主逻辑:k8s中的etcd是整个集群所有状态信息的存储,涉及数据的读写和多个etcd之间数据的同步,对数据的一致性要求严格,所以使用较复杂的 raft 算法来选择用于提交数据的主节点。而 apiserver 作为集群入口,本身是无状态的web服务器,多个 apiserver 服务之间直接负载请求并不需要做选主。Controller-Manager 和 Scheduler 作为任务类型的组件,比如 controller-manager 内置的 k8s 各种资源对象的控制器实时的 watch apiserver 获取对象最新的变化事件做期望状态和实际状态调整,调度器watch未绑定节点的pod做节点选择,显然多个这些任务同时工作是完全没有必要的,所以 controller-manager 和 scheduler 也是需要选主的,但是选主逻辑和 etcd 不一样的,这里只需要保证从多个 controller-manager 和 scheduler 之间选出一个 leader 进入工作状态即可,而无需考虑它们之间的数据一致和同步。

#创建 kube-scheduler.service 服务管理文件

cat >/usr/lib/systemd/system/kube-scheduler.service <<EOF

[Unit]

Description=Kubernetes Scheduler

Documentation=https://github.com/kubernetes/kubernetes

[Service]

EnvironmentFile=-/opt/kubernetes/cfg/kube-scheduler

ExecStart=/opt/kubernetes/bin/kube-scheduler \$KUBE_SCHEDULER_OPTS

Restart=on-failure

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

systemctl enable kube-scheduler

systemctl restart kube-scheduler

5.3 编写 controller-manager.sh

[root@master01 k8s]# vim controller-manager.sh

#!/bin/bash

#创建 kube-controller-manager 启动参数配置文件

MASTER_ADDRESS=$1

cat >/opt/kubernetes/cfg/kube-controller-manager <<EOF

KUBE_CONTROLLER_MANAGER_OPTS="--logtostderr=true \\

--v=4 \\

--master=${MASTER_ADDRESS}:8080 \\

--leader-elect=true \\

--address=127.0.0.1 \\

--service-cluster-ip-range=10.0.0.0/24 \\

--cluster-name=kubernetes \\

--cluster-signing-cert-file=/opt/kubernetes/ssl/ca.pem \\

--cluster-signing-key-file=/opt/kubernetes/ssl/ca-key.pem \\

--root-ca-file=/opt/kubernetes/ssl/ca.pem \\

--service-account-private-key-file=/opt/kubernetes/ssl/ca-key.pem \\

--experimental-cluster-signing-duration=87600h0m0s"

EOF

#--cluster-name=kubernetes:集群名称,与CA证书里的CN匹配

#--cluster-signing-cert-file:指定签名的CA机构根证书,用来签名为 TLS BootStrapping 创建的证书和私钥

#--root-ca-file:指定根CA证书文件路径,用来对 kube-apiserver 证书进行校验,指定该参数后,才会在 Pod 容器的 ServiceAccount 中放置该 CA 证书文件

#--experimental-cluster-signing-duration:设置为 TLS BootStrapping 签署的证书有效时间为10年,默认为1年

#创建 kube-controller-manager.service 服务管理文件

cat >/usr/lib/systemd/system/kube-controller-manager.service <<EOF

[Unit]

Description=Kubernetes Controller Manager

Documentation=https://github.com/kubernetes/kubernetes

[Service]

EnvironmentFile=-/opt/kubernetes/cfg/kube-controller-manager

ExecStart=/opt/kubernetes/bin/kube-controller-manager \$KUBE_CONTROLLER_MANAGER_OPTS

Restart=on-failure

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

systemctl enable kube-controller-manager

systemctl restart kube-controller-manager

5.4 编写 k8s-cert.sh

[root@master01 k8s]# vim k8s-cert.sh

#!/bin/bash

#配置证书生成策略,让 CA 软件知道颁发有什么功能的证书,生成用来签发其他组件证书的根证书

cat > ca-config.json <<EOF

{

"signing": {

"default": {

"expiry": "87600h"

},

"profiles": {

"kubernetes": {

"expiry": "87600h",

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

]

}

}

}

}

EOF

#生成CA证书和私钥(根证书和私钥)

cat > ca-csr.json <<EOF

{

"CN": "kubernetes",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "Beijing",

"ST": "Beijing",

"O": "k8s",

"OU": "System"

}

]

}

EOF

cfssl gencert -initca ca-csr.json | cfssljson -bare ca -

#生成 apiserver 的证书和私钥(apiserver和其它k8s组件通信使用)

#hosts中将所有可能作为 apiserver 的 ip 添加进去,后面 keepalived 使用的 VIP 也要加入

cat > apiserver-csr.json <<EOF

{

"CN": "kubernetes",

"hosts": [

"10.0.0.1",

"127.0.0.1",

"192.168.8.18",

"192.168.8.17",

"192.168.8.150",

"192.168.8.15",

"192.168.8.16",

"kubernetes",

"kubernetes.default",

"kubernetes.default.svc",

"kubernetes.default.svc.cluster",

"kubernetes.default.svc.cluster.local"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing",

"O": "k8s",

"OU": "System"

}

]

}

EOF

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=kubernetes apiserver-csr.json | cfssljson -bare apiserver

#生成 kubectl 的证书和私钥,具有admin权限

cat > admin-csr.json <<EOF

{

"CN": "admin",

"hosts": [],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing",

"O": "system:masters",

"OU": "System"

}

]

}

EOF

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=kubernetes admin-csr.json | cfssljson -bare admin

#生成 kube-proxy 的证书和私钥

cat > kube-proxy-csr.json <<EOF

{

"CN": "system:kube-proxy",

"hosts": [],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"L": "BeiJing",

"ST": "BeiJing",

"O": "k8s",

"OU": "System"

}

]

}

EOF

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=kubernetes kube-proxy-csr.json | cfssljson -bare kube-proxy

5.5 赋予权限

[root@master01 /opt/k8s]#chmod +x *.sh

5.6 创建 kubernetes 工作目录

[root@master01 k8s]# mkdir -p /opt/kubernetes/{cfg,bin,ssl}

5.7 生成 CA 证书、相关组件的证书和私钥

[root@master01 k8s]# mkdir /opt/k8s/k8s-cert

[root@master01 k8s]# mv /opt/k8s/k8s-cert.sh /opt/k8s/k8s-cert

[root@master01 k8s]# cd !$

cd /opt/k8s/k8s-cert

[root@master01 k8s-cert]# ./k8s-cert.sh

#生成CA证书、相关组件的证书和私钥

[root@master01 k8s-cert]# ls

admin.csr admin.pem apiserver-key.pem ca.csr ca.pem kube-proxy-csr.json

admin-csr.json apiserver.csr apiserver.pem ca-csr.json k8s-cert.sh kube-proxy-key.pem

admin-key.pem apiserver-csr.json ca-config.json ca-key.pem kube-proxy.csr kube-proxy.pem

controller-manager 和 kube-scheduler 设置为只调用当前几期的 apiserver,使用 127.0.0.1:8080 通信,因此不需要签发证书

5.8 复制 CA 证书、apiserver 相关证书和私钥到 kubernetes 工作目录的 ssl 子目录中

[root@master01 k8s-cert]# ls *.pem

admin-key.pem admin.pem apiserver-key.pem apiserver.pem ca-key.pem ca.pem kube-proxy-key.pem kube-proxy.pem

[root@master01 k8s-cert]# cp ca*pem apiserver*pem /opt/kubernetes/ssl/

5.9 下载或上传 kubernetes 安装包到 /opt/k8s 目录,并解压

[root@master01 k8s-cert]# cd /opt/k8s/

#上传k8s安装包kubernetes-server-linux-amd64.tar.gz

[root@master01 k8s]# tar zxvf kubernetes-server-linux-amd64.tar.gz

5.10 复制 master 组件的关键命令文件到 kubernetes 工作目录的 bin 子目录中

[root@master01 k8s]# cd /opt/k8s/kubernetes/server/bin/

[root@master01 bin]# cp kube-apiserver kubectl kube-controller-manager kube-scheduler /opt/kubernetes/bin/

[root@master01 bin]# ln -s /opt/kubernetes/bin/* /usr/local/bin/

5.11 创建 bootstrap token 认证文件

apiserver 启动时会调用,然后就相当于在集群内创建了一个这个用户,接下来就可以用 RBAC 给他授权

[root@master01 bin]# cd /opt/k8s/

[root@master01 k8s]# vim token.sh

#!/bin/bash

#获取随机数前16个字节内容,以十六进制格式输出,并删除其中空格

BOOTSTRAP_TOKEN=$(head -c 16 /dev/urandom | od -An -t x | tr -d ' ')

#生成token.csv文件,按照Token序列号,用户名,UID,用户组的格式生成

cat > /opt/kubernetes/cfg/token.csv <<EOF

${BOOTSTRAP_TOKEN},kubelet-bootstrap,10001,"sysytem:kubelet-bootstrap"

EOF

[root@master01 /opt/k8s]#chmod +x token.sh

[root@master01 /opt/k8s]#./token.sh

[root@master01 /opt/k8s]#cat /opt/kubernetes/cfg/token.csv

27d3f4b8518e85aa770589e07f548891,kubelet-bootstrap,10001,"sysytem:kubelet-bootstrap"

5.12 二进制文件、token、证书都准备好后,开启 apiserver 服务

[root@master01 /opt/k8s]#./apiserver.sh 192.168.8.18 https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379

5.13 检查进程是否启动成功

[root@master01 /opt/k8s]#ps aux | grep kube-apiserver

root 43048 3.3 4.0 408036 325276 ? Ssl 17:40 0:10 /opt/kubernetes/bin/kube-apiserver --logtostderr=true --v=4 --etcd-servers=https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379 --bind-address=192.168.8.18 --secure-port=6443 --advertise-address=192.168.8.18 --allow-privileged=true --service-cluster-ip-range=10.0.0.0/24 --enable-admission-plugins=NamespaceLifecycle,LimitRanger,ServiceAccount,ResourceQuota,NodeRestriction --authorization-mode=RBAC,Node --kubelet-https=true --enable-bootstrap-token-auth --token-auth-file=/opt/kubernetes/cfg/token.csv --service-node-port-range=30000-50000 --tls-cert-file=/opt/kubernetes/ssl/apiserver.pem --tls-private-key-file=/opt/kubernetes/ssl/apiserver-key.pem --client-ca-file=/opt/kubernetes/ssl/ca.pem --service-account-key-file=/opt/kubernetes/ssl/ca-key.pem --etcd-cafile=/opt/etcd/ssl/ca.pem --etcd-certfile=/opt/etcd/ssl/server.pem --etcd-keyfile=/opt/etcd/ssl/server-key.pem

root 43118 0.0 0.0 112676 984 pts/1 S+ 17:45 0:00 grep --color=auto kube-apiserver

k8s 通过 kube-apiserver 这个进程提供服务,该进程运行在单个 master 节点上。默认有两个端口 6443 和 8080(新版本为 58080)

5.14 检查 6443 端口

安全端口 6443 用于接收 HTTPS 请求,用于基于 Token 文件或客户端证书等认证

[root@master01 /opt/k8s]#netstat -natp | grep 6443

tcp 0 0 192.168.8.18:6443 0.0.0.0:* LISTEN 43048/kube-apiserve

tcp 0 0 192.168.8.18:40850 192.168.8.18:6443 ESTABLISHED 43048/kube-apiserve

tcp 0 0 192.168.8.18:6443 192.168.8.18:40850 ESTABLISHED 43048/kube-apiserve

5.15 检查 8080 端口

本地端口 8080 用于接收 HTTP 请求,非认证或授权的 HTTP 请求通过该端口访问 API Server

[root@master01 /opt/k8s]#netstat -natp | grep 8080

tcp 0 0 127.0.0.1:8080 0.0.0.0:* LISTEN 43048/kube-apiserve

5.16 查看版本信息

必须保证 apiserver 启动正常,不然无法查询到 server 的版本信息

[root@master01 /opt/k8s]#kubectl version

Client Version: version.Info{Major:"1", Minor:"12", GitVersion:"v1.12.3", GitCommit:"435f92c719f279a3a67808c80521ea17d5715c66", GitTreeState:"clean", BuildDate:"2018-11-26T12:57:14Z", GoVersion:"go1.10.4", Compiler:"gc", Platform:"linux/amd64"}

Server Version: version.Info{Major:"1", Minor:"12", GitVersion:"v1.12.3", GitCommit:"435f92c719f279a3a67808c80521ea17d5715c66", GitTreeState:"clean", BuildDate:"2018-11-26T12:46:57Z", GoVersion:"go1.10.4", Compiler:"gc", Platform:"linux/amd64"}

5.17 启动 scheduler 服务

[root@master01 /opt/k8s]#./scheduler.sh 127.0.0.1

Created symlink from /etc/systemd/system/multi-user.target.wants/kube-scheduler.service to /usr/lib/systemd/system/kube-scheduler.service.

[root@master01 /opt/k8s]#ps aux|grep kube-scheduler

root 43228 1.4 0.2 47952 19572 ? Ssl 17:49 0:00 /opt/kubernetes/bin/kube-scheduler --logtostderr=true --v=4 --master=127.0.0.1:8080 --leader-elect=true

root 43270 0.0 0.0 112676 984 pts/1 S+ 17:50 0:00 grep --color=auto kube-scheduler

5.18 启动 controller-manager 服务

[root@master01 /opt/k8s]#./controller-manager.sh 127.0.0.1

Created symlink from /etc/systemd/system/multi-user.target.wants/kube-controller-manager.service to /usr/lib/systemd/system/kube-controller-manager.service.

5.19 查看 master 节点状态

[root@master01 /opt/k8s]#kubectl get componentstatuses

NAME STATUS MESSAGE ERROR

controller-manager Healthy ok

scheduler Healthy ok

etcd-0 Healthy {"health":"true"}

etcd-2 Healthy {"health":"true"}

etcd-1 Healthy {"health":"true"}

或者

kubectl get cs

6. 部署 Worker Node 组件

6.1 把 kubelet、kube-proxy 拷贝到 node 节点(master01 节点)

[root@master01 k8s]# cd /opt/k8s/kubernetes/server/bin

[root@master01 bin]# scp kubelet kube-proxy root@192.168.8.19:/opt/kubernetes/bin/

kubelet

[root@master01 bin]# scp kubelet kube-proxy root@192.168.8.20:/opt/kubernetes/bin/

kubelet

6.2 编写脚本

node01 节点

192.168.8.19

- 编写 proxy.sh

[root@node01 opt]# vim proxy.sh

#!/bin/bash

NODE_ADDRESS=$1

#创建 kube-proxy 启动参数配置文件

cat >/opt/kubernetes/cfg/kube-proxy <<EOF

KUBE_PROXY_OPTS="--logtostderr=true \\

--v=4 \\

--hostname-override=${NODE_ADDRESS} \\

--cluster-cidr=172.17.0.0/16 \\

--proxy-mode=ipvs \\

--kubeconfig=/opt/kubernetes/cfg/kube-proxy.kubeconfig"

EOF

#--hostnameOverride: 参数值必须与 kubelet 的值一致,否则 kube-proxy 启动后会找不到该 Node,从而不会创建任何 ipvs 规则

#--cluster-cidr:指定 Pod 网络使用的聚合网段,Pod 使用的网段和 apiserver 中指定的 service 的 cluster ip 网段不是同一个网段。 kube-proxy 根据 --cluster-cidr 判断集群内部和外部流量,指定 --cluster-cidr 选项后 kube-proxy 才会对访问 Service IP 的请求做 SNAT,即来自非 Pod 网络的流量被当成外部流量,访问 Service 时需要做 SNAT。

#--proxy-mode:指定流量调度模式为 ipvs 模式

#--kubeconfig: 指定连接 apiserver 的 kubeconfig 文件

#创建 kube-proxy.service 服务管理文件

cat >/usr/lib/systemd/system/kube-proxy.service <<EOF

[Unit]

Description=Kubernetes Proxy

After=network.target

[Service]

EnvironmentFile=-/opt/kubernetes/cfg/kube-proxy

ExecStart=/opt/kubernetes/bin/kube-proxy \$KUBE_PROXY_OPTS

Restart=on-failure

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

systemctl enable kube-proxy

systemctl restart kube-proxy

- 编写 kubelet.sh

[root@node01 opt]# vim kubelet.sh

#!/bin/bash

NODE_ADDRESS=$1

DNS_SERVER_IP=${2:-"10.0.0.2"}

#创建 kubelet 启动参数配置文件

cat >/opt/kubernetes/cfg/kubelet <<EOF

KUBELET_OPTS="--logtostderr=true \\

--v=4 \\

--hostname-override=${NODE_ADDRESS} \\

--kubeconfig=/opt/kubernetes/cfg/kubelet.kubeconfig \\

--bootstrap-kubeconfig=/opt/kubernetes/cfg/bootstrap.kubeconfig \\

--config=/opt/kubernetes/cfg/kubelet.config \\

--cert-dir=/opt/kubernetes/ssl \\

--pod-infra-container-image=registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0"

EOF

#--hostname-override:指定kubelet节点在集群中显示的主机名或IP地址,默认使用主机hostname;kube-proxy和kubelet的此项参数设置必须完全一致

#--kubeconfig:指定kubelet.kubeconfig文件位置,用于如何连接到apiserver,里面含有kubelet证书,master授权完成后会在node节点上生成 kubelet.kubeconfig 文件

#--bootstrap-kubeconfig:指定连接 apiserver 的 bootstrap.kubeconfig 文件

#--config:指定kubelet配置文件的路径,启动kubelet时将从此文件加载其配置

#--cert-dir:指定master颁发的客户端证书和密钥保存位置

#--pod-infra-container-image:指定Pod基础容器(Pause容器)的镜像。Pod启动的时候都会启动一个这样的容器,每个pod之间相互通信需要Pause的支持,启动Pause需要Pause基础镜像

#创建kubelet配置文件(该文件实际上就是一个yml文件,语法非常严格,不能出现tab键,冒号后面必须要有空格,每行结尾也不能有空格)

cat >/opt/kubernetes/cfg/kubelet.config <<EOF

kind: KubeletConfiguration

apiVersion: kubelet.config.k8s.io/v1beta1

address: ${NODE_ADDRESS}

port: 10250

readOnlyPort: 10255

cgroupDriver: cgroupfs

clusterDNS:

- ${DNS_SERVER_IP}

clusterDomain: cluster.local.

failSwapOn: false

authentication:

anonymous:

enabled: true

EOF

#PS:当命令行参数与此配置文件(kubelet.config)有相同的值时,就会覆盖配置文件中的该值。

#创建 kubelet.service 服务管理文件

cat >/usr/lib/systemd/system/kubelet.service <<EOF

[Unit]

Description=Kubernetes Kubelet

After=docker.service

Requires=docker.service

[Service]

EnvironmentFile=/opt/kubernetes/cfg/kubelet

ExecStart=/opt/kubernetes/bin/kubelet \$KUBELET_OPTS

Restart=on-failure

KillMode=process

[Install]

WantedBy=multi-user.target

EOF

systemctl daemon-reload

systemctl enable kubelet

systemctl restart kubelet

6.3 赋予脚本执行权限

[root@node01 opt]# chmod +x *.sh

6.4 master01 节点操作

- ① 创建用于生成 kubelet 的配置文件的目录

[root@master01 ~]# mkdir /opt/k8s/kubeconfig

- ② 编写 kubeconfig.sh

kubeconfig.sh 文件包含集群参数(CA 证书、API Server 地址),客户端参数(上面生成的证书和私钥),集群context 上下文参数(集群名称、用户名)。

Kubenetes 组件(如 kubectl、kube-proxy)通过启动时指定不同的 kubeconfig 文件可以切换到不同的集群,连接到 apiserver。

[root@master01 ~]# cd /opt/k8s/kubeconfig

[root@master01 kubeconfig]# vim kubeconfig.sh

#!/bin/bash

#example: kubeconfig 192.168.8.18 /opt/k8s/k8s-cert/

#创建bootstrap.kubeconfig文件

#该文件中内置了 token.csv 中用户的 Token,以及 apiserver CA 证书;kubelet 首次启动会加载此文件,使用 apiserver CA 证书建立与 apiserver 的 TLS 通讯,使用其中的用户 Token 作为身份标识向 apiserver 发起 CSR 请求

BOOTSTRAP_TOKEN=$(awk -F ',' '{print $1}' /opt/kubernetes/cfg/token.csv)

APISERVER=$1

SSL_DIR=$2

export KUBE_APISERVER="https://$APISERVER:6443"

# 设置集群参数

kubectl config set-cluster kubernetes \

--certificate-authority=$SSL_DIR/ca.pem \

--embed-certs=true \

--server=${KUBE_APISERVER} \

--kubeconfig=bootstrap.kubeconfig

#--embed-certs=true:表示将ca.pem证书写入到生成的bootstrap.kubeconfig文件中

# 设置客户端认证参数,kubelet 使用 bootstrap token 认证

kubectl config set-credentials kubelet-bootstrap \

--token=${BOOTSTRAP_TOKEN} \

--kubeconfig=bootstrap.kubeconfig

# 设置上下文参数

kubectl config set-context default \

--cluster=kubernetes \

--user=kubelet-bootstrap \

--kubeconfig=bootstrap.kubeconfig

# 使用上下文参数生成 bootstrap.kubeconfig 文件

kubectl config use-context default --kubeconfig=bootstrap.kubeconfig

#----------------------

#创建kube-proxy.kubeconfig文件

# 设置集群参数

kubectl config set-cluster kubernetes \

--certificate-authority=$SSL_DIR/ca.pem \

--embed-certs=true \

--server=${KUBE_APISERVER} \

--kubeconfig=kube-proxy.kubeconfig

# 设置客户端认证参数,kube-proxy 使用 TLS 证书认证

kubectl config set-credentials kube-proxy \

--client-certificate=$SSL_DIR/kube-proxy.pem \

--client-key=$SSL_DIR/kube-proxy-key.pem \

--embed-certs=true \

--kubeconfig=kube-proxy.kubeconfig

# 设置上下文参数

kubectl config set-context default \

--cluster=kubernetes \

--user=kube-proxy \

--kubeconfig=kube-proxy.kubeconfig

# 使用上下文参数生成 kube-proxy.kubeconfig 文件

kubectl config use-context default --kubeconfig=kube-proxy.kubeconfig

[root@master01 kubeconfig]# chmod +x kubeconfig.sh

6.5 生成 kubelet 的配置文件

[root@master01 kubeconfig]# cd /opt/k8s/kubeconfig

[root@master01 kubeconfig]# chmod +x kubeconfig.sh

[root@master01 kubeconfig]# ./kubeconfig.sh 192.168.8.18 /opt/k8s/k8s-cert/

[root@master01 kubeconfig]# ls

bootstrap.kubeconfig kubeconfig.sh kube-proxy.kubeconfig

6.6 把配置文件 bootstrap.kubeconfig、kube-proxy.kubeconfig 拷贝到 node 节点

[root@master01 kubeconfig]# cd /opt/k8s/kubeconfig

[root@master01 kubeconfig]# scp bootstrap.kubeconfig kube-proxy.kubeconfig root@192.168.8.19:/opt/kubernetes/cfg/

[root@master01 kubeconfig]# scp bootstrap.kubeconfig kube-proxy.kubeconfig root@192.168.8.20:/opt/kubernetes/cfg/

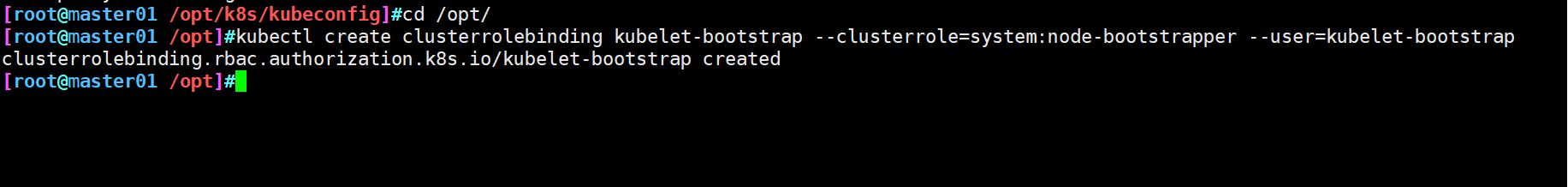

6.7 RBAC 授权及相关说明

将预设用户 kubelet-bootstrap 与内置的 ClusterRole system:node-bootstrapper 绑定到一起,使其能够发起 CSR 请求

[root@master01 /opt/k8s/kubeconfig]# cd /opt/

[root@master01 /opt]# kubectl create clusterrolebinding kubelet-bootstrap --clusterrole=system:node-bootstrapper --user=kubelet-bootstrap

clusterrolebinding.rbac.authorization.k8s.io/kubelet-bootstrap created

- kubelet 采用 TLS Bootstrapping 机制,自动完成到 kube-apiserver 的注册,在 node 节点量较大或者后期自动扩容时非常有用。

- Master apiserver 启用 TLS 认证后,node 节点 kubelet 组件想要加入集群,必须使用 CA 签发的有效证书才能与 apiserver 通信,当 node 节点很多时,前述证书是一件很繁琐的事情。因此 Kubernetes 引入了 TLS bootstrapping 机制来自动颁发客户端证书,kubelet 会以一个低权限用户自动向 apiserver 申请证书,kubelet 的证书由 apiserver 动态签署。

- kubelet 首次启动通过加载 bootstrap.kubeconfig 中的用户 Token 和 apiserver CA 证书发起首次 CSR 请求,这个 Token 被预先内置在 apiserver 节点的 token.csv 中,其身份为 kubelet=bootstrap 用户和 system:kubelet=bootstrap 用户组;想要首次 CSR 请求能成功(即不会被 apiserver 401 拒绝),则需要先创建一个 ClusterRoleBinding,将 kubelet-bootstrap 用户和 system:node-bootstrapper 内置 ClusterRole 绑定(通过 kubectl get clusterroles 可查询),使其能够发起 CSR 认证请求。

- TLS bootstrapping 时的证书实际是由 kube-controller-manager 组件来签署的,也就是说证书有效期是 kube-controller-manager 组件控制的;kube-controller-manager 组件提供一个 --experimental-cluster-signing-duration 参数来设置签署的证书有效时间:默认为 8760h0m0s,将其改为 87600h0m0s,即 10 年后再进行 TLS bootstrapping 签署证书即可。

- 也就是说 kubelet 首次访问 API Server 时,是使用 token 做认证,通过后,Controller Manager 会为 kubelet 生成一个证书,以后的访问都是用证书做认证了。

6.8 查看角色

[root@master01 /opt]#kubectl get clusterroles | grep system:node-bootstrapper

system:node-bootstrapper

6.9 查看已授权的角色

[root@master01 /opt]#kubectl get clusterrolebinding

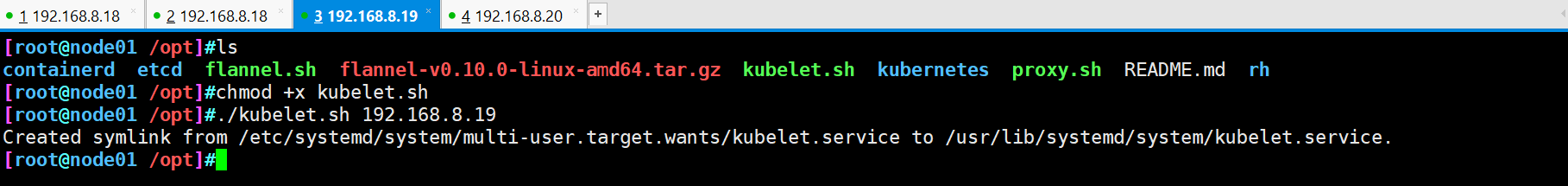

6.10 使用 kubelet.sh 脚本启动 kubelet 服务

node1 节点上操作

[root@node01 opt]# cd /opt

[root@node01 opt]# chmod +x kubelet.sh

[root@node01 opt]# ./kubelet.sh 192.168.8.19

Created symlink from /etc/systemd/system/multi-user.target.wants/kubelet.service to /usr/lib/systemd/system/kubelet.service.

6.11 检查 kubelet 服务启动

[root@node01 /opt]#ps aux | grep kubelet

root 53587 1.0 1.2 537424 46948 ? Ssl 18:33 0:00 /opt/kubernetes/bin/kubelet --logtostderr=true --v=4 --hostname-override=192.168.8.19 --kubeconfig=/opt/kubernetes/cfg/kubelet.kubeconfig --bootstrap-kubeconfig=/opt/kubernetes/cfg/bootstrap.kubeconfig --config=/opt/kubernetes/cfg/kubelet.config --cert-dir=/opt/kubernetes/ssl --pod-infra-container-image=registry.cn-hangzhou.aliyuncs.com/google-containers/pause-amd64:3.0

root 53658 0.0 0.0 112676 980 pts/0 S+ 18:34 0:00 grep --color=auto kubelet

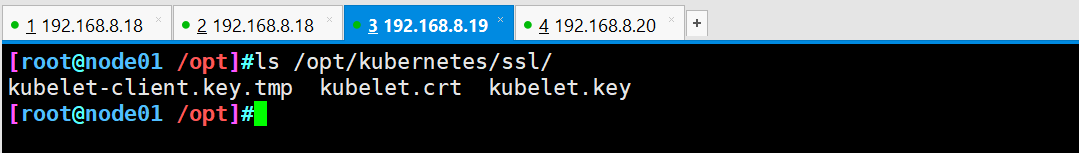

6.12 查看当前 ssl 目录

[root@node01 opt]# ls /opt/kubernetes/ssl/

kubelet-client.key.tmp kubelet.crt kubelet.key

此时还没有生成证书,因为 master 还未对此申请做批准操作

6.13 查看 CSR 请求

在 master01 节点上操作

192.168.8.18

[root@master01 /opt]#kubectl get csr

NAME AGE REQUESTOR CONDITION

node-csr-6w4sRl-oWwpzaOeWKHCcG2vrd4jN_ZbVhO0F7OG7Ud4 4m47s kubelet-bootstrap Pending

发现有来自于 kubelet-bootstrap 的申请,处于待办状态

6.14 通过 CSR 请求

[root@master01 ~]#kubectl certificate approve node-csr-6w4sRl-oWwpzaOeWKHCcG2vrd4jN_ZbVhO0F7OG7Ud4

certificatesigningrequest.certificates.k8s.io/node-csr-6w4sRl-oWwpzaOeWKHCcG2vrd4jN_ZbVhO0F7OG7Ud4 approved

6.15 再次查看 CSR 请求状态

[root@master01 ~]#kubectl get csr

NAME AGE REQUESTOR CONDITION

node-csr-6w4sRl-oWwpzaOeWKHCcG2vrd4jN_ZbVhO0F7OG7Ud4 12m kubelet-bootstrap Approved,Issued

Approved,Issued 表示已授权 CSR 请求并签发整数

6.16 查看集群节点状态

[root@master01 ~]#kubectl get nodes

NAME STATUS ROLES AGE VERSION

192.168.8.19 Ready <none> 3m44s v1.12.3

可以看到已成功接入node01节点

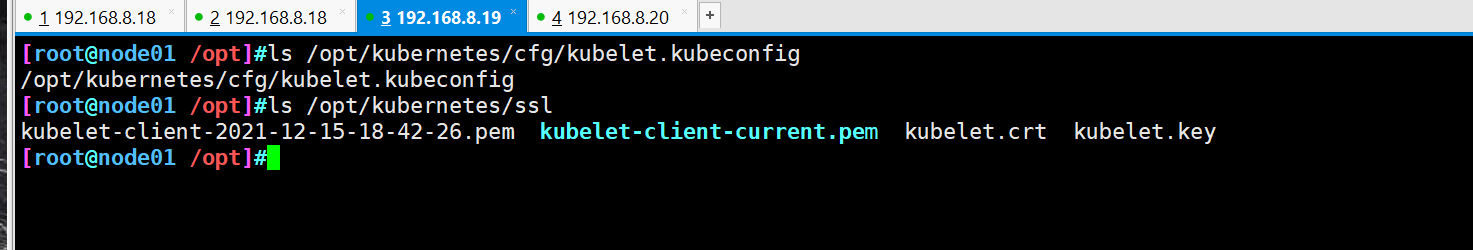

6.17 node01 节点上操作

- ① 已自动生成证书和 kubelet.kubeconfig 文件

[root@node01 /opt]#ls /opt/kubernetes/cfg/kubelet.kubeconfig

/opt/kubernetes/cfg/kubelet.kubeconfig

[root@node01 /opt]#ls /opt/kubernetes/ssl

kubelet-client-2021-12-15-18-42-26.pem kubelet-client-current.pem kubelet.crt kubelet.key

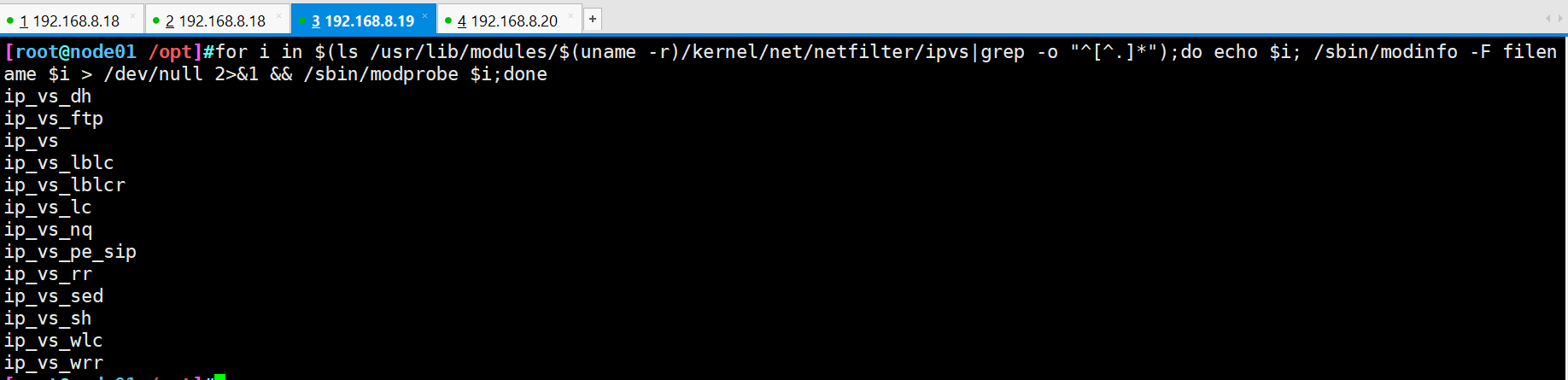

- ② 加载 ip_vs 模块

[root@node01 /opt]#for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i > /dev/null 2>&1 && /sbin/modprobe $i;done

ip_vs_dh

ip_vs_ftp

ip_vs

ip_vs_lblc

ip_vs_lblcr

ip_vs_lc

ip_vs_nq

ip_vs_pe_sip

ip_vs_rr

ip_vs_sed

ip_vs_sh

ip_vs_wlc

ip_vs_wrr

- ③ 使用 proxy.sh 脚本启动 proxy 服务

[root@node01 /opt]#chmod +x proxy.sh

[root@node01 /opt]#ls

containerd etcd flannel.sh flannel-v0.10.0-linux-amd64.tar.gz kubelet.sh kubernetes proxy.sh README.md rh

[root@node01 /opt]#./proxy.sh 192.168.8.19

Created symlink from /etc/systemd/system/multi-user.target.wants/kube-proxy.service to /usr/lib/systemd/system/kube-proxy.service.

[root@node01 /opt]#systemctl status kube-proxy.service

6.18 node02 节点部署

方法一

- ① 在 node01 节点操作

将 kubelet.sh、proxy.sh 文件拷贝到 node02 节点

[root@node01 opt]# cd /opt/

[root@node01 opt]# scp kubelet.sh proxy.sh root@192.168.8.20:`pwd`

- ② 在 node02 节点上操作

使用 kubelet.sh 脚本启动 kubelet 服务

[root@node02 ~]#cd /opt/

[root@node02 /opt]#chmod +x kubelet.sh

[root@node02 /opt]#./kubelet.sh 192.168.8.20

Created symlink from /etc/systemd/system/multi-user.target.wants/kubelet.service to /usr/lib/systemd/system/kubelet.service.

- ③ 在 master01 节点上操作

#查看 CSR 请求

[root@master01 ~]#kubectl get csr

NAME AGE REQUESTOR CONDITION

node-csr-6w4sRl-oWwpzaOeWKHCcG2vrd4jN_ZbVhO0F7OG7Ud4 28m kubelet-bootstrap Approved,Issued

node-csr-NctxQ1dE_NVPJldQGlWRYFS6A9ls2t-gfB1gvDL1TSg 2m17s kubelet-bootstrap Pending

#通过 CSR 请求

[root@master01 ~]#kubectl certificate approve node-csr-NctxQ1dE_NVPJldQGlWRYFS6A9ls2t-gfB1gvDL1TSg

certificatesigningrequest.certificates.k8s.io/node-csr-NctxQ1dE_NVPJldQGlWRYFS6A9ls2t-gfB1gvDL1TSg approved

#再次查看 CSR 请求

[root@master01 ~]#kubectl get csr

NAME AGE REQUESTOR CONDITION

node-csr-6w4sRl-oWwpzaOeWKHCcG2vrd4jN_ZbVhO0F7OG7Ud4 29m kubelet-bootstrap Approved,Issued

node-csr-NctxQ1dE_NVPJldQGlWRYFS6A9ls2t-gfB1gvDL1TSg 2m56s kubelet-bootstrap Approved,Issued

#查看集群状态

[root@master01 ~]#kubectl get nodes

NAME STATUS ROLES AGE VERSION

192.168.8.19 Ready <none> 22m v1.12.3

192.168.8.20 Ready <none> 2m8s v1.12.3

- ④ 加载 ipvs 模块(node02 操作)

[root@node02 /opt]#for i in $(ls /usr/lib/modules/$(uname -r)/kernel/net/netfilter/ipvs|grep -o "^[^.]*");do echo $i; /sbin/modinfo -F filename $i > /dev/null 2>&1 && /sbin/modprobe $i;done

ip_vs_dh

ip_vs_ftp

ip_vs

ip_vs_lblc

ip_vs_lblcr

ip_vs_lc

ip_vs_nq

ip_vs_pe_sip

ip_vs_rr

ip_vs_sed

ip_vs_sh

ip_vs_wlc

ip_vs_wrr

- ⑤ 使用 proxy.sh 脚本启动 proxy 服务

[root@node02 /opt]#cd /opt/

[root@node02 /opt]#chmod +x proxy.sh

[root@node02 /opt]#./proxy.sh 192.168.8.20

Created symlink from /etc/systemd/system/multi-user.target.wants/kube-proxy.service to /usr/lib/systemd/system/kube-proxy.service.

- ⑥ 查看服务状态

[root@node02 /opt]#systemctl status kube-proxy.service

● kube-proxy.service - Kubernetes Proxy

Loaded: loaded (/usr/lib/systemd/system/kube-proxy.service; enabled; vendor preset: disabled)

Active: active (running) since 三 2021-12-15 19:08:58 CST; 43s ago

Main PID: 57887 (kube-proxy)

Memory: 7.3M

CGroup: /system.slice/kube-proxy.service

‣ 57887 /opt/kubernetes/bin/kube-proxy --logtostderr=true --v=4 --hostname-override=192.168.8.20 --cluster-cidr=172.17.0.0/16 ...

12月 15 19:09:31 node02 kube-proxy[57887]: I1215 19:09:31.689363 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:32 node02 kube-proxy[57887]: I1215 19:09:32.094108 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:33 node02 kube-proxy[57887]: I1215 19:09:33.693641 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:34 node02 kube-proxy[57887]: I1215 19:09:34.099024 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:35 node02 kube-proxy[57887]: I1215 19:09:35.698316 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:36 node02 kube-proxy[57887]: I1215 19:09:36.103917 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:37 node02 kube-proxy[57887]: I1215 19:09:37.701588 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:38 node02 kube-proxy[57887]: I1215 19:09:38.109119 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:39 node02 kube-proxy[57887]: I1215 19:09:39.706130 57887 config.go:141] Calling handler.OnEndpointsUpdate

12月 15 19:09:40 node02 kube-proxy[57887]: I1215 19:09:40.114049 57887 config.go:141] Calling handler.OnEndpointsUpdate

方法二

- ① 在 node01 节点操作

把现成的 /opt/kubernetes 目录和 Kubelet、kube-proxy 的 service 服务管理文件复制到其他节点

scp -r /opt/kubernetes/ root:192.168.8.20:/opt/

scp /usr/lib/systemd/system/{kubelet,kube-proxy}.service root@192.168.8.20:/usr/lib/systemd/system/

- ② 在 node02 节点操作

#首先删除复制过来的证书,node02可自行申请证书

cd /opt/kubernetes/ssl/

em -rf *

#修改配置文件 kubelet、kubelet.config、kube-proxy 的相关 IP 地址配置为当前节点的 IP 地址

#加载 ipvs 模块

modeprobe ip_vs

#启动 kubelet 和 kube-proxy 服务并设置开机自启

systemctl enable --now kubelet.service

systemctl enable --now kube-proxy.service

- ③ 在 master01 操作

#查看 CSR 申请

kubectl get csr

#通过 CSR 申请

kubectl certificate approve [node-csr-......]

7. K8S 单节点测试

master01

[root@master01 opt]# kubectl create deployment nginx-test --image=nginx:1.14

deployment.apps/nginx-test created

[root@master01 opt]# kubectl get pod #等待镜像拉取

NAME READY STATUS RESTARTS AGE

nginx-test-7dc4f9dcc9-vs2p6 0/1 ContainerCreating 0 5s

[root@master01 opt]# kubectl get pod #容器启动成功

NAME READY STATUS RESTARTS AGE

nginx-test-7dc4f9dcc9-vs2p6 1/1 Running 0 45s

查看 pod 详情

[root@master01 ~]#kubectl describe pod nginx-test-7dc4f9dcc9-f5xmb

Name: nginx-test-7dc4f9dcc9-f5xmb

Namespace: default

Priority: 0

PriorityClassName: <none>

Node: 192.168.8.19/192.168.8.19

Start Time: Wed, 15 Dec 2021 19:17:19 +0800

Labels: app=nginx-test

pod-template-hash=7dc4f9dcc9

Annotations: <none>

Status: Running

IP: 172.17.57.3

Controlled By: ReplicaSet/nginx-test-7dc4f9dcc9

Containers:

nginx:

Container ID: docker://cde0a4a13f0bff9ca90d2d4da5d018799862c64d51112c698d46e8285709dff5

Image: nginx:1.14

Image ID: docker-pullable://nginx@sha256:f7988fb6c02e0ce69257d9bd9cf37ae20a60f1df7563c3a2a6abe24160306b8d

Port: <none>

Host Port: <none>

State: Running

Started: Wed, 15 Dec 2021 19:19:43 +0800

Ready: True

Restart Count: 0

Environment: <none>

Mounts:

/var/run/secrets/kubernetes.io/serviceaccount from default-token-sbn7g (ro)

Conditions:

Type Status

Initialized True

Ready True

ContainersReady True

PodScheduled True

Volumes:

default-token-sbn7g:

Type: Secret (a volume populated by a Secret)

SecretName: default-token-sbn7g

Optional: false

QoS Class: BestEffort

Node-Selectors: <none>

Tolerations: node.kubernetes.io/not-ready:NoExecute for 300s

node.kubernetes.io/unreachable:NoExecute for 300s

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal Scheduled 5m43s default-scheduler Successfully assigned default/nginx-test-7dc4f9dcc9-f5xmb to 192.168.8.19

Normal Pulling 5m41s kubelet, 192.168.8.19 pulling image "nginx:1.14"

Normal Pulled 3m20s kubelet, 192.168.8.19 Successfully pulled image "nginx:1.14"

Normal Created 3m20s kubelet, 192.168.8.19 Created container

Normal Started 3m19s kubelet, 192.168.8.19 Started container

查看 pod 额外信息(包括 IP)

[root@master01 ~]#kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE

nginx-test-7dc4f9dcc9-f5xmb 1/1 Running 0 7m40s 172.17.57.3 192.168.8.19 <none>

使用任意 node 节点访问 pod 测试

[root@node01 ~]#curl 172.17.57.3

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

<style>

body {

width: 35em;

margin: 0 auto;

font-family: Tahoma, Verdana, Arial, sans-serif;

}

</style>

</head>

<body>

<h1>Welcome to nginx!</h1>

<p>If you see this page, the nginx web server is successfully installed and

working. Further configuration is required.</p>

<p>For online documentation and support please refer to

<a href="http://nginx.org/">nginx.org</a>.<br/>

Commercial support is available at

<a href="http://nginx.com/">nginx.com</a>.</p>

<p><em>Thank you for using nginx.</em></p>

</body>

</html>

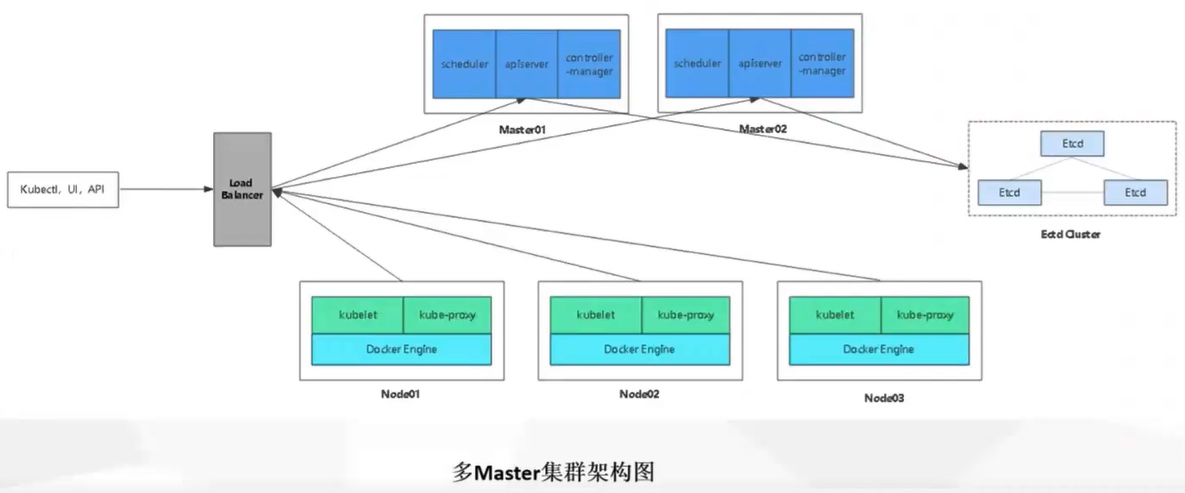

二、多 Master 节点二进制部署

基于上面单节点基础上搭建

| 服务器 | 主机名 | IP地址 | 主要组件/说明 |

|---|---|---|---|

| master01 节点 + etcd01 节点 | master01 | 192.168.8.18 | kube-apiserver kube-controller-manager kube-schedular etcd |

| mastert02 节点 | master02 | 192.168.8.17 | kube-apiserver kube-controller-manager kube-schedular |

| node01 节点 + etcd02 节点 | node01 | 192.168.8.19 | kubelet kube-proxy docker flannel |

| node02 节点 + etcd03 节点 | node02 | 192.168.8.20 | kubelet kube-proxy docker flannel |

| nginx01节点 | nginx01 | 192.168.8.15 | keepalived 负载均衡(主) |

| nginx02节点 | nginx02 | 192.168.8.16 | keepalived 负载均衡(备) |

1. 环境部署

1.1 master02 节点

hostnamectl set-hostname master02

su

cat >> /etc/hosts << EOF

192.168.8.18 master01

192.168.8.17 master02

192.168.8.19 node01

192.168.8.20 node02

192.168.8.15 nginx01

192.168.8.16 nginx02

EOF

systemctl stop firewalld && systemctl disable firewalld

setenforce 0

swapoff -a

sed -ri 's/.*swap.*/#&/' /etc/fstab

vim /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

sysctl --system

yum install -y ntpdate.x86_64

ntpdate time.windows.com

1.2 nginx 节点

192.168.8.15 nginx01

192.168.8.16 nginx02

hostnamectl set-hostname nginx01

su

systemctl stop firewalld && systemctl disable firewalld

setenforce 0

cat >> /etc/hosts << EOF

192.168.8.18 master01

192.168.8.17 master02

192.168.8.19 node01

192.168.8.20 node02

192.168.8.15 nginx01

192.168.8.16 nginx02

EOF

2. Master02 部署

2.1 拷贝文件

从 master01 节点上拷贝证书文件、各 master 组件的配置文件和服务管理文件到 master02 节点。

在 master01 节点操作

[root@master01 ~]# scp -r /opt/etcd/ root@192.168.8.17:/opt/

[root@master01 ~]# scp -r /opt/kubernetes/ root@192.168.8.17:/opt/

[root@master01 ~]# cd /usr/lib/systemd/system

[root@master01 /usr/lib/systemd/system]# scp kube-apiserver.service kube-controller-manager.service kube-scheduler.service root@192.168.8.17:`pwd`

2.2 修改配置文件

在 master02 节点上操作

[root@master02 ~]# vim /opt/kubernetes/cfg/kube-apiserver

KUBE_APISERVER_OPTS="--logtostderr=true \

--v=4 \

--etcd-servers=https://192.168.8.18:2379,https://192.168.8.19:2379,https://192.168.8.20:2379 \

--bind-address=192.168.8.17 \ #监听地址修改为 master02 主机 IP

--secure-port=6443 \

--advertise-address=192.168.8.17 \ #广告地址修改为 master02 主机 IP

--allow-privileged=true \

--service-cluster-ip-range=10.0.0.0/24 \

--enable-admission-plugins=NamespaceLifecycle,LimitRanger,ServiceAccount,ResourceQuota,NodeRestriction \

--authorization-mode=RBAC,Node \

--kubelet-https=true \

--enable-bootstrap-token-auth \

--token-auth-file=/opt/kubernetes/cfg/token.csv \

--service-node-port-range=30000-50000 \

--tls-cert-file=/opt/kubernetes/ssl/apiserver.pem \

--tls-private-key-file=/opt/kubernetes/ssl/apiserver-key.pem \

--client-ca-file=/opt/kubernetes/ssl/ca.pem \

--service-account-key-file=/opt/kubernetes/ssl/ca-key.pem \

--etcd-cafile=/opt/etcd/ssl/ca.pem \

--etcd-certfile=/opt/etcd/ssl/server.pem \

--etcd-keyfile=/opt/etcd/ssl/server-key.pem"

2.3 启动服务并查看节点状态信息

#启动服务并设置开机自启

[root@master02 ~]# systemctl enable --now kube-apiserver.service

[root@master02 ~]# systemctl enable --now kube-controller-manager.service

[root@master02 ~]# systemctl enable --now kube-scheduler.service

#查看状态

[root@master02 ~]# systemctl status kube-apiserver.service

[root@master02 ~]# systemctl status kube-controller-manager.service

[root@master02 ~]# systemctl status kube-scheduler.service

#查看 node 节点状态

[root@master02 ~]#ln -s /opt/kubernetes/bin/* /usr/local/bin/

[root@master02 ~]#kubectl get nodes

NAME STATUS ROLES AGE VERSION

192.168.8.19 Ready <none> 146m v1.12.3

192.168.8.20 Ready <none> 125m v1.12.3

[root@master02 ~]#kubectl get nodes -o wide

NAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME

192.168.8.19 Ready <none> 146m v1.12.3 192.168.8.19 <none> CentOS Linux 7 (Core) 3.10.0-693.el7.x86_64 docker://20.10.12

192.168.8.20 Ready <none> 125m v1.12.3 192.168.8.20 <none> CentOS Linux 7 (Core) 3.10.0-693.el7.x86_64 docker://20.10.12

#选项解析

-o wide:额外输出信息,对于 Pod,将输出 Pod 所在的 Node 名。

此时在 master02 节点查看到的 node 节点状态仅是从 etcd 查询到的信息,

而此时 node 节点实际上并未与 master02 节点建立通信连接,

因此需要使用一个 VIP 把 node 节点与 master02 节点关联起来。

3. 部署负载均衡

配置 load balancer 集群双机热备负载均衡(nginx 实现负载均衡,keepalived 实现双机热备)

3.1 下载 nginx

配置 nginx 的官方在线 yum 源,配置本地 nginx 的 yum 源

以 nginx01 为例

[root@nginx01 ~]# cat > /etc/yum.repos.d/nginx.repo << 'EOF'

[nginx]

name=nginx repo

baseurl=http://nginx.org/packages/centos/7/$basearch/

gpgcheck=0

EOF

yum install -y nginx

3.2 修改 nginx 配置文件

配置四层反向代理负载均衡,指定 k8s 集群 2 台 master 的节点 ip 和 6443端口

以 nginx01 为例

[root@nginx01 ~]# vim /etc/nginx/nginx.conf

......

events {

worker_connections 1024;

}

stream {

log_format main '$remote_addr $upstream_addr - [$time_local] $status $upstream_bytes_sent';

access_log /var/log/nginx/k8s-access.log main;

upstream k8s-apiservers {

server 192.168.8.18:6443;

server 192.168.8.17:6443;

}

server {

listen 6443;

proxy_pass k8s-apiservers;

}

}

http {

......

[root@nginx01 /etc/nginx]# nginx -t

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

3.3 启动 nginx 并查看

[root@nginx01 /etc/nginx]#systemctl enable --now nginx

[root@nginx01 /etc/nginx]#systemctl enable --now nginx

[root@nginx01 /etc/nginx]#netstat -natp | grep nginx

4. 部署 keepalived 服务

nginx 主机,以 nginx01 为例

4.1 下载 keepalived

node1 节点和 node2

yum install -y keepalived

4.2 修改配置文件

node1 节点

[root@nginx01 ~]# vim /etc/keepalived/keepalived.conf

##10行,修改

smtp_server 127.0.0.1

##12行,修改,nginx01节点的为LVS_MASTER,nginx02节点的为LVS_BACKUP

router_id LVS_MASTER

##13-16行,删除

}

##14行,插入一个周期性执行的脚本

vrrp_script check_nginx {

##16行,指定检查nginx存活的脚本路径

script "/etc/nginx/check_nginx.sh"

}

##20行,修改,nginx01节点的为MASTER,nginx02节点的为BACKUP

state MASTER

##21行,修改,指定网卡名称ens33

interface ens33

##22行,指定vrid,两个节点要保持一致

virtual_router_id 51

##23行,nginx01节点的为100,nginx02节点的为90

priority 100

##30行,修改,指定VIP

virtual_ipaddress {

192.168.8.150/24

}

##32行,添加,指定vrrp_script配置的脚本

track_script {

check_nginx

}

}

##删除剩余无用配置

#nginx01 配置文件

! Configuration File for keepalived

global_defs {

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 127.0.0.1

smtp_connect_timeout 30

router_id NGINX_MASTER

}

vrrp_script check_nginx {

script "/etc/nginx/check_nginx.sh"

}

vrrp_instance VI_1 {

state MASTER

interface ens33

virtual_router_id 51

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.8.150/24

}

track_script {

check_nginx

}

}

node2 节点

[root@nginx02 /etc/nginx]#vim /etc/keepalived/keepalived.conf

! Configuration File for keepalived

global_defs {

notification_email {

acassen@firewall.loc

failover@firewall.loc

sysadmin@firewall.loc

}

notification_email_from Alexandre.Cassen@firewall.loc

smtp_server 127.0.0.1

smtp_connect_timeout 30

router_id NGINX_BACKUP

}

vrrp_script check_nginx {

script "/etc/nginx/check_nginx.sh"

}

vrrp_instance VI_1 {

state BACKUP

interface ens33

virtual_router_id 51

priority 90

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

192.168.8.150/24

}

track_script {

check_nginx

}

}

4.3 创建 nginx 状态检测脚本

[root@nginx01 ~]# vim /etc/nginx/check_nginx.sh

#!/bin/bash

#egrep -cv "grep|$$"用于过滤掉包含grep或者$$表示的当前shell进程ID

count=$(ps -ef | grep nginx | egrep -cv "grep|$$")

if [ "$count" -eq 0 ];then

systemctl stop keepalived

fi

[root@nginx01 ~]# chmod +x /etc/nginx/check_nginx.sh

[root@nginx01 ~]# scp /etc/nginx/check_nginx.sh root@192.168.8.16:/etc/nginx/check_nginx.sh

4.4 启动 keepalived 服务

一定要先启动了 nginx 服务,再启动 keepalived 服务

[root@nginx01 ~]# systemctl enable --now keepalived.service

[root@nginx01 ~]# systemctl status keepalived.service

4.5 在 nginx01 中查看 VIP

[root@nginx01 ~]#ip a

4.6 修改 node 节点对接 IP

node01 192.168.8.19

node02 192.168.8.20

- ① 修改 node 节点上的 bootstrap.kubeconfig、kubelet.kubeconfig 和 kube-proxy.kubeconfig 配置文件中的 server 为 VIP

[root@node01 ~]# cd /opt/kubernetes/cfg/

[root@node01 cfg]# vim bootstrap.kubeconfig

##5行,修改IP为VIP

server: https://192.168.8.150:6443

[root@node01 cfg]# vim kubelet.kubeconfig

##5行,修改IP为VIP

server: https://192.168.8.150:6443

[root@node01 cfg]# vim kube-proxy.kubeconfig

##5行,修改IP为VIP

server: https://192.168.8.150:6443

- ② 重启 kubelet 和 kube-proxy 服务

[root@node01 cfg]# systemctl restart kubelet.service

[root@node01 cfg]# systemctl restart kube-proxy.service

4.7 在 nginx01 查看 nginx 和 node、master 节点的连接状态

[root@nginx01 ~]#netstat -natp | grep nginx

tcp 0 0 0.0.0.0:6443 0.0.0.0:* LISTEN 41275/nginx: master

tcp 0 0 0.0.0.0:80 0.0.0.0:* LISTEN 41275/nginx: master

本地 nginx 监听端口为 6443 和 80,6443 负责负载均衡代理,80 负责 web 展示服务。

VIP 的 6443 端口分别与 nginx01/nginx02 相连接。

master01/master02 的 6443 端口分别与 nginx01 相连接。

5. 验证使用 msater02 创建 pod

- 查看 pod、node 列表

[root@master02 ~]#kubectl get node

NAME STATUS ROLES AGE VERSION

192.168.8.19 Ready <none> 15h v1.12.3

192.168.8.20 Ready <none> 14h v1.12.3

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 29m

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 29m

- 创建 pod

[root@master02 ~]#kubectl create deploy nginx-master03-test --image=nginx

deployment.apps/nginx-master03-test created

#等待pod的创建,可通过 "kubectl describe pod nginx-master03-test" 查看创建过程

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 31m

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 31m

nginx-master03-test-6fd66d6f5c-w57sq 1/1 Running 0 36s

- 查看使用 node

[root@master02 ~]#kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE

nginx-dbddb74b8-mghs2 1/1 Running 0 34m 172.17.73.16 192.168.8.20 <none>

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 34m 172.17.73.7 192.168.8.20 <none>

nginx-master03-test-6fd66d6f5c-w57sq 1/1 Running 0 4m22s 172.17.57.3 192.168.8.19 <none>

成功使用 master02 创建 pod,并且通过 nginx 完成负载均衡

6. 删除 Pod

6.1 查看 k8s 全部资源

[root@master02 ~]#kubectl get all

6.2 删除 pod

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 40m

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 40m

nginx-master03-test-6fd66d6f5c-w57sq 1/1 Running 0 10m

[root@master02 ~]#kubectl delete pod nginx-master03-test-6fd66d6f5c-w57sq

pod "nginx-master03-test-6fd66d6f5c-w57sq" deleted

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 41m

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 41m

nginx-master03-test-6fd66d6f5c-nbjgb 1/1 Running 0 17s

由于 deployment 创建的 replicaset 管理着 pod 的数量,该 pod 被删除后,deployment 会再次拉取一个新的 pod,实现了 pod 的自愈功能;

因此想要彻底删除 pod,需要删除该 pod 所属 deployment,可通过kubectl get deploy获取 deployment 列表。

6.3 delete 删除 deployment

[root@master02 ~]#kubectl get deploy

NAME DESIRED CURRENT UP-TO-DATE AVAILABLE AGE

nginx 1 1 1 1 9h

nginx-master02-test 1 1 1 1 9h

nginx-master03-test 1 1 1 1 14m

[root@master02 ~]#kubectl delete deploy nginx-master03-test

deployment.extensions "nginx-master03-test" deleted

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 46m

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 46m

nginx-master03-test-6fd66d6f5c-nbjgb 0/1 Terminating 0 5m10s

deployment 被删除后,replicaset 与 pod 被一并删除

6.4 delete 删除 replicaset

replicaset 被删除后,deployment 会重新创建一个 replicaset,保证 pod 的自愈机制不受影响

[root@master02 ~]#kubectl get rs

NAME DESIRED CURRENT READY AGE

nginx-dbddb74b8 1 1 1 50m

nginx-master02-test-79fc886b76 1 1 1 50m

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 50m

nginx-master02-test-79fc886b76-z6p72 1/1 Running 0 50m

[root@master02 ~]#kubectl delete rs nginx-master02-test-79fc886b76

replicaset.extensions "nginx-master02-test-79fc886b76" deleted

[root@master02 ~]#kubectl get pod

NAME READY STATUS RESTARTS AGE

nginx-dbddb74b8-mghs2 1/1 Running 0 51m

nginx-master02-test-79fc886b76-tr5kw 1/1 Running 0 14s

[root@master02 ~]#kubectl get rs

NAME DESIRED CURRENT READY AGE

nginx-dbddb74b8 1 1 1 51m

nginx-master02-test-79fc886b76 1 1 1 44s

[root@master02 ~]#kubectl get all

NAME READY STATUS RESTARTS AGE

pod/nginx-dbddb74b8-mghs2 1/1 Running 0 51m

pod/nginx-master02-test-79fc886b76-tr5kw 1/1 Running 0 60s

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

service/kubernetes ClusterIP 10.0.0.1 <none> 443/TCP 16h

NAME DESIRED CURRENT UP-TO-DATE AVAILABLE AGE

deployment.apps/nginx 1 1 1 1 9h

deployment.apps/nginx-master02-test 1 1 1 1 9h

NAME DESIRED CURRENT READY AGE

replicaset.apps/nginx-dbddb74b8 1 1 1 51m

replicaset.apps/nginx-master02-test-79fc886b76 1 1 1 60s

[root@master02 ~]#kubectl describe deploy nginx

Name: nginx

Namespace: default

CreationTimestamp: Thu, 16 Dec 2021 00:44:05 +0800

Labels: run=nginx

Annotations: deployment.kubernetes.io/revision: 1

Selector: run=nginx

Replicas: 1 desired | 1 updated | 1 total | 1 available | 0 unavailable

StrategyType: RollingUpdate

MinReadySeconds: 0

RollingUpdateStrategy: 25% max unavailable, 25% max surge

Pod Template:

Labels: run=nginx

Containers:

nginx:

Image: nginx

Port: <none>

Host Port: <none>

Environment: <none>

Mounts: <none>

Volumes: <none>

Conditions:

Type Status Reason

---- ------ ------

Progressing True NewReplicaSetAvailable

Available True MinimumReplicasAvailable

OldReplicaSets: <none>

NewReplicaSet: nginx-dbddb74b8 (1/1 replicas created)

Events:

Type Reason Age From Message

---- ------ ---- ---- -------

Normal ScalingReplicaSet 9h deployment-controller Scaled up replica set nginx-dbddb74b8 to 1

Normal ScalingReplicaSet 59m deployment-controller Scaled up replica set nginx-dbddb74b8 to 1

7. 权限管理

7.1 查看 pod 日志

[root@master02 ~]#kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE

nginx-dbddb74b8-mghs2 1/1 Running 0 61m 172.17.73.16 192.168.8.20 <none>

nginx-master02-test-79fc886b76-tr5kw 1/1 Running 0 10m 172.17.57.3 192.168.8.19 <none>

[root@master02 ~]#kubectl logs nginx-master02-test-79fc886b76-tr5kw

7.2 绑定管理员角色

[root@master02 ~]#kubectl create clusterrolebinding cluster-system-anonymous --clusterrole=cluster-admin --user=system:anonymous

7.3 添加日志内容

- 查看所在 node

[root@master02 ~]#kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE

nginx-dbddb74b8-mghs2 1/1 Running 0 65m 172.17.73.16 192.168.8.20 <none>

nginx-master02-test-79fc886b76-tr5kw 1/1 Running 0 14m 172.17.57.3 192.168.8.19 <none>

- 使用 node01 访问 172.17.57.3

[root@node01 ~]#curl 172.17.57.3

<!DOCTYPE html>

<html>

<head>

<title>Welcome to nginx!</title>

<style>

html { color-scheme: light dark; }

body { width: 35em; margin: 0 auto;

font-family: Tahoma, Verdana, Arial, sans-serif; }

</style>

</head>

<body>

<h1>Welcome to nginx!</h1>

<p>If you see this page, the nginx web server is successfully installed and

working. Further configuration is required.</p>

<p>For online documentation and support please refer to

<a href="http://nginx.org/">nginx.org</a>.<br/>

Commercial support is available at

<a href="http://nginx.com/">nginx.com</a>.</p>

<p><em>Thank you for using nginx.</em></p>

</body>

</html>

7.4 重新查看 node 日志

[root@master02 ~]#kubectl logs nginx-master02-test-79fc886b76-tr5kw

250

250

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?