跟着李沐学AI【08 线性回归+基础优化算法】

本小节主要介绍了线性回归以及梯度算法。

线性回归: 对n维输入的加权和加偏差,使用平方损失来衡量预测值与真实值之间的差异。

梯度算法: 沿着反梯度方向不断迭代更新参数,而小批量随机梯度下降是深度学习默认的求解算法,其中批量大小与学习率是最重要的两个超参数。

下面记录实现线性回归时遇到的问题。

一、线性回归从零开始

(1) 导入一些包

%matplotlib inline

import random

import torch

from d2l import torch as d2l

刚开始导入这个包的时候会报错为:[WinError 1455] 页面文件太小,无法完成操作。 Error loading “E:\anaconda3\envs\pytorch\lib\site-packages\torch\lib\cudnn_cnn_train64_8.dll” or one of its dependencies.

可能是因为模型有点大而系统分配的内存比较小,需要手动调制(改变代码所在的盘块的分页文件大小)

解决步骤为:电脑右键->高级系统设置->高级->设置->高级->程序->更改->取消自动管理所有驱动器的分页文件大小->自定义代码所在盘块的分页文件大小,我改为10000MB,然后重启电脑就好了。

(2)构造数据集

根据带有噪声的线性模型构造一个人造数据集,使用线性模型参数 w = [2,-3.4]T 、 b = 4.2以及噪声项生成数据集和标签

def synthetic_data(w,b,num_examples): #人造数据集

X = torch.normal(0,1,(num_examples,len(w))) #1是标准差

y = torch.matmul(X,w) + b

y += torch.normal(0,0.01,y.shape) #均值为0,方差为0.01噪声项

return X, y.reshape((-1,1)) # -1表示行数由pytorch推断,1表示1列

true_w = torch.tensor([2,-3.4])

true_b = 4.2

features, labels = synthetic_data(true_w,true_b,1000)

y = Xw + b +噪声项

(3)显示feature和label

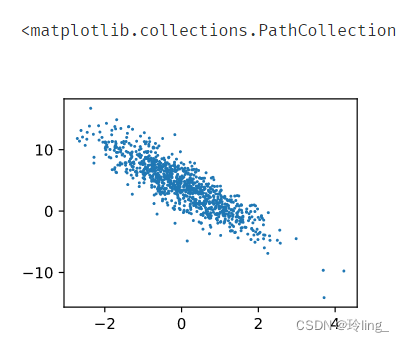

d2l.set_figsize()

d2l.plt.scatter(features[:,1].detach().numpy(), #detach分离出数值,不再含有梯度

labels.detach().numpy(),1)

画出feature和label:

(4)定义一个data_iter函数

def data_iter(batch_size,features,labels):

num_examples = len(features)

indices = list(range(num_examples)) #将样本数量转为列表list

# 这些样本是随记读取的没有特定的顺序

random.shuffle(indices) #将下标打乱,可以随机的访问样本

for i in range(0,num_examples,batch_size): #从0到num_examples,每次跨越batch_size的大小

batch_indices = torch.tensor( #随机挑取样本

indices[i:min(i+batch_size,num_examples)])

yield features[batch_indices],labels[batch_indices] #返回迭代器

batch_size = 10

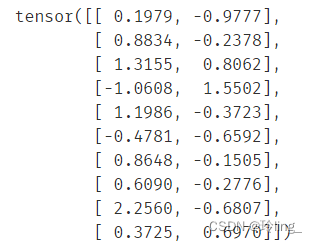

for X,y in data_iter(batch_size,features,labels):

print(X,'\n',y)

break

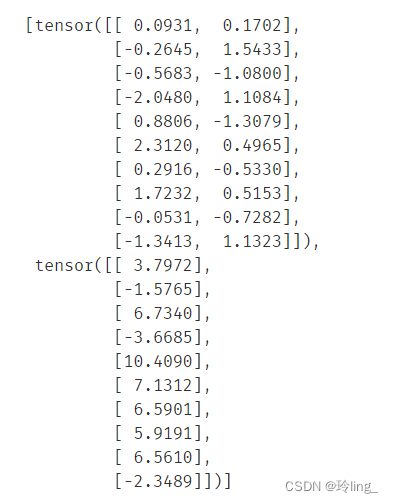

给样本编号并打乱后生成小批量,大小为batch_size。

打印出X 102的tensor,及y 101的向量如下所示:

(5)定义模型

# 定义初始化模型参数

w = torch.normal(0,0.01,size=(2,1),requires_grad=True) #长为2的向量随机初始化为正态分布,并计算梯度

b = torch.zeros(1,requires_grad=True) #设置偏差为0

# 定义模型

def linreg(X,w,b):

"""线性回归模型"""

return torch.matmul(X,w) + b #矩阵X乘向量w再加上偏差b

构造模型为 y =(X,w) + b

(6)定义损失函数并优化算法

#定义损失函数

def squared_loss(y_hat,y): #y_hat是预测值,y是真实值

"""均方损失 """

#由于真实值y可能是行向量或列向量,因此要对y重新改型为y_hat的shape

return (y_hat - y.reshape(y_hat.shape))**2 / 2 #这里没求和也没有求均值

#定义优化算法

def sgd(params,lr,batch_size):

"""小批量随机梯度下降"""

with torch.no_grad(): #不需要进行梯度计算

for param in params:

param -= lr * param.grad / batch_size #在损失函数中未求均值,故在这里除去batch_size来求均值

param.grad.zero_() #将梯度设为0,下次计算就不会与这次相关

(7)训练

"""定义超参数"""

lr = 0.03 #学习率

num_epochs = 3 #数据整体扫三遍

net = linreg #线性模型

loss = squared_loss #均方损失

for epoch in range(num_epochs): #扫三遍

for X,y in data_iter(batch_size,features,labels):

l = loss(net(X ,w ,b),y) # 将X,w,b放在线性模型中做预测后与真实结果y做损失

#损失l是批量大小的向量

#并以此计算关于[w,b]的梯度

l.sum().backward() #对损失求和算梯度

sgd([w,b],lr,batch_size) #使用sgd优化算法进行参数的梯度更新

with torch.no_grad(): #评价,不需要计算梯度

train_l = loss(net(features,w,b),labels) #将整个特征向量放入线性模型中做预测并和标签做损失

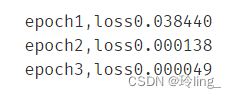

print(f'epoch{epoch+1},loss{float(train_l.mean()):f}')

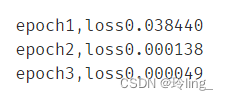

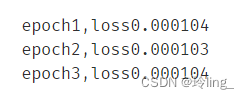

进行三遍训练以后的差别越来越小:

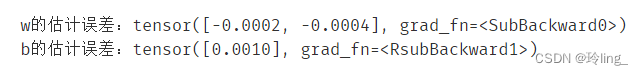

(8)比较真实参数和通过训练学到的参数来评估训练的成功程度

(9)总结

对于梯度下降来说有两个重要的超参数分别是批量大小和学习率,学习率太小或太大都会导致误差变大

- 当学习率为0.03时,损失值为

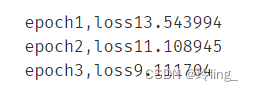

- 当学习率为0.001时,损失率会增大为

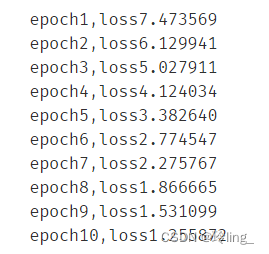

但是可以通过增加训练的次数减少损失,比如将次数增长为10

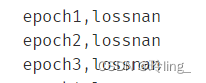

其结果虽然减小了但依然比学习率为0.03时要大不少 - 当学习率增加至10时,损失值会变为nan,即超出运算范围

二、 线性回归的简洁实现

(1)通过深度学习框架来简洁实现线性回归模型生成数据集

import numpy as np

import torch

from torch.utils import data #从torch的utils中引用data模组

from d2l import torch as d2l

true_w = torch.tensor([2,-3.4])

true_b = 4.2

features,labels = d2l.synthetic_data(true_w,true_b,1000) #通过人工生成函数产生features和labels

这里比第一节多了从torch里引用data模组

(2)调用框架现用的API读取数据

def load_array(data_arrays,batch_size,is_train=True):

"""构造一个PyTorch数据迭代器"""

dataset = data.TensorDataset(*data_arrays)

return data.DataLoader(dataset,batch_size,shuffle=is_train) #DataLoader每次随机挑选样本

batch_size = 10

#将features和labels做成list,传至data中的TensorDataset里,得到一个数据集

data_iter = load_array((features,labels),batch_size)

next(iter(data_iter))

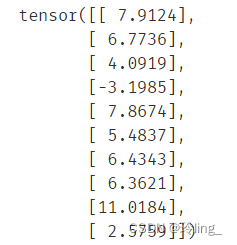

生成X与b如下所示,与上面的结果差不多的

(3)使用框架的预定义好的层

from torch import nn #神经网络

net = nn.Sequential(nn.Linear(2,1)) #list of layers

net[0].weight.data.normal_(0,0.01) #使用正态分布来替换数据的值

net[0].bias.data.fill_(0) #偏差设为0

#计算均方误差使用的是MSELoss类,也称为平方L2范数

loss = nn.MSELoss()

#实例化SGD实例

trainer = torch.optim.SGD(net.parameters(),lr=0.03)

(4)训练过程

num_epochs = 3

for epoch in range(num_epochs): #扫描三遍

for X,y in data_iter:

l = loss(net(X),y) #net本身带有模型参数,这边不需要再带有w和b

trainer.zero_grad()

l.backward() #pytorch已经进行了求和,不需要再sum

trainer.step() #进行模型更新

l = loss(net(features),labels) #扫描结束对所有的特征矩阵与标签进行损失

print(f'epoch{epoch+1},loss{l:f}') #注意这里是字母l不是数字1

最后得出的结果为~

本文详细介绍了线性回归的基本概念,包括其数学原理和使用梯度算法进行参数更新的过程。作者还展示了如何在PyTorch中实现线性回归模型,包括数据处理、模型定义、损失函数和优化算法的选择,以及对不同学习率下损失值的影响分析。

本文详细介绍了线性回归的基本概念,包括其数学原理和使用梯度算法进行参数更新的过程。作者还展示了如何在PyTorch中实现线性回归模型,包括数据处理、模型定义、损失函数和优化算法的选择,以及对不同学习率下损失值的影响分析。

3074

3074

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?