Python语言拥有丰富的第三方库,使得Python成为了最流行的爬虫语言之一。而Python的爬虫框架更是让Python爬虫开发更加高效。在这篇文章中,我们将探讨5个最常见的Python爬虫框架,并分析它们的优缺点,帮助你更好地选择合适的框架。

1. Scrapy

Scrapy是Python爬虫领域最著名的框架之一。它是一个快速、高效、可扩展的爬虫框架。Scrapy自带了强大的Selector和异步处理机制,能够快速高效地爬取大量数据。

优点

-

Scrapy是一个非常快速和高效的爬虫框架,能够快速地爬取大量的数据。

-

Scrapy内置的Selector提供了强大的数据解析功能,支持XPath和CSS选择器。

-

Scrapy有一个强大的异步处理机制,可以同时处理多个请求,从而加速爬取过程。

-

Scrapy支持多种数据存储方式,包括CSV、JSON、XML、SQLite和MySQL等。

缺点

-

Scrapy的学习曲线比较陡峭,需要一定的Python基础。

-

Scrapy的定制化程度比较高,需要一定的技术水平才能进行修改和扩展。

-

Scrapy对于JavaScript渲染的网页支持不够完善,需要使用Selenium等工具来解决。

示例代码

import scrapy

class QuotesSpider(scrapy.Spider):

name = "quotes"

start_urls = [

'http://quotes.toscrape.com/page/1/',

'http://quotes.toscrape.com/page/2/',

]

def parse(self, response):

for quote in response.css('div.quote'):

yield {

'text': quote.css('span.text::text').get(),

'author': quote.css('span small::text').get(),

'tags': quote.css('div.tags a.tag::text').getall(),

}

next_page = response.css('li.next a::attr(href)').get()

if next_page is not None:

yield response.follow(next_page, self.parse)

2. BeautifulSoup

BeautifulSoup是Python最流行的HTML解析器之一。它可以解析HTML和XML文档,并提供了许多简单的方法来处理解析树。

优点

-

BeautifulSoup简单易用,对于初学者非常友好。

-

BeautifulSoup内置了多种解析器,支持多种格式的文档。

缺点

-

BeautifulSoup不是一个完整的爬虫框架,需要搭配其他库来实现爬虫功能。

-

BeautifulSoup不支持异步处理,因此不能高效地处理大量的数据。

-

BeautifulSoup的解析速度相对较慢。

示例代码

from bs4 import BeautifulSoup

import requests

url = 'http://quotes.toscrape.com/'

response = requests.get(url)

soup = BeautifulSoup(response.text, 'html.parser')

for quote in soup.find_all('div', class_='quote'):

print(quote.find('span', class_='text').text)

print(quote.find('small', class_='author').text)

tags = quote.find('div', class_='tags').find_all('a', class_='tag')

for tag in tags:

print(tag.text)

3. PyQuery

PyQuery是另一个流行的Python爬虫框架,它是jQuery的Python实现。它可以解析HTML和XML文档,并提供了类似于jQuery的API来处理解析树。

优点

-

PyQuery的API设计简单易用,可以快速地实现爬虫功能。

-

PyQuery支持链式调用,可以更加高效地处理数据。

-

PyQuery支持XPath和CSS选择器。

缺点

-

PyQuery不支持异步处理,因此不能高效地处理大量的数据。

-

PyQuery对于JavaScript渲染的网页支持不够完善,需要使用Selenium等工具来解决。

示例代码

from pyquery import PyQuery as pq

import requests

url = 'http://quotes.toscrape.com/'

response = requests.get(url)

doc = pq(response.text)

for quote in doc('div.quote').items():

print(quote('span.text').text())

print(quote('small.author').text())

tags = quote('div.tags a.tag')

for tag in tags:

print(pq(tag).text())

4. Requests-HTML

Requests-HTML是基于Requests和PyQuery的Python爬虫框架。它提供了类似于Requests的API,并使用PyQuery进行数据解析。

优点

-

Requests-HTML使用简单,API设计类似于Requests。

-

Requests-HTML使用PyQuery进行数据解析,可以方便地处理数据。

-

Requests-HTML支持JavaScript渲染的网页。

缺点

-

Requests-HTML不支持异步处理,因此不能高效地处理大量的数据。

示例代码

from requests_html import HTMLSession

url = 'http://quotes.toscrape.com/'

session = HTMLSession()

response = session.get(url)

for quote in response.html.find('div.quote'):

print(quote.find('span.text', first=True).text)

print(quote.find('small.author', first=True).text)

tags = quote.find('div.tags a.tag')

for tag in tags:

print(tag.text)

5. Selenium

Selenium是一个流行的自动化测试工具,也可以用于爬虫开发。它可以模拟用户行为,支持JavaScript渲染的网页。

优点

-

Selenium可以模拟用户行为,支持JavaScript渲染的网页,能够解决一些其他框架不能解决的问题。

-

Selenium支持异步处理,可以高效地处理大量的数据。

缺点

-

Selenium启动浏览器需要一定的时间,并且消耗系统资源。

-

Selenium需要安装浏览器驱动,有一定的技术门槛。

示例代码

from selenium import webdriver

url = 'http://quotes.toscrape.com/'

driver = webdriver.Chrome()

driver.get(url)

for quote in driver.find_elements_by_css_selector('div.quote'):

print(quote.find_element_by_css_selector('span.text').text)

print(quote.find_element_by_css_selector('small.author').text)

tags = quote.find_elements_by_css_selector('div.tags a.tag')

for tag in tags:

print(tag.text)

driver.quit()问题:有Selenium爬不了的网页吗?欢迎评论区讨论。

技术总结

本文介绍了5个常见的Python爬虫框架,并分析了它们的优缺点。每个框架都有其独特的特点,可以根据具体的需求选择合适的框架。需要注意的是,不同的框架适用的场景不同,选择框架时需要充分考虑数据的规模、爬虫的性能、网页的特性等因素。

Python经验分享

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

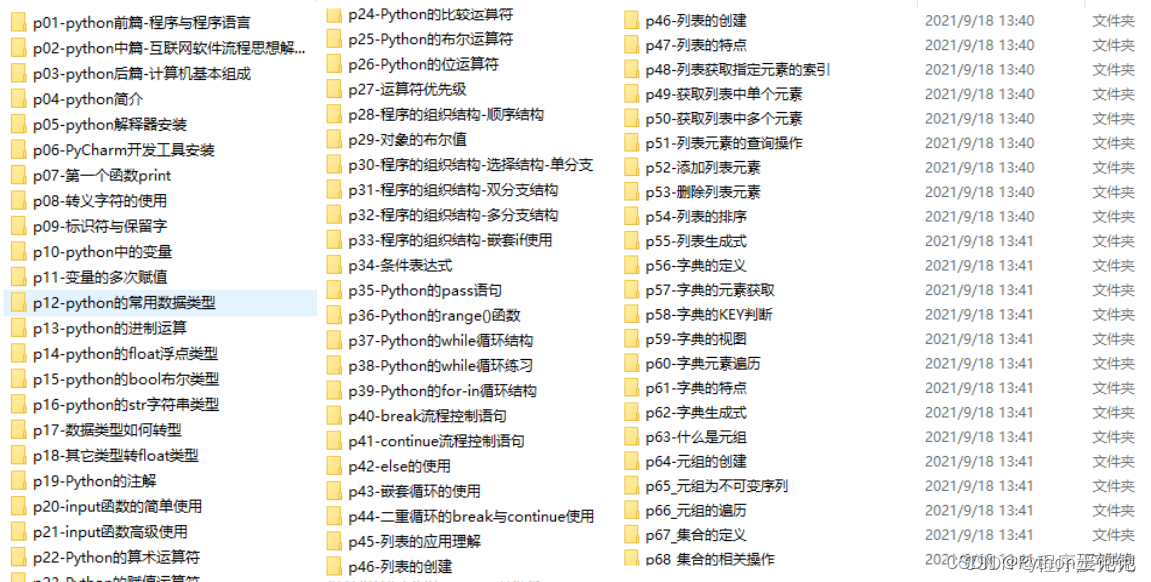

Python学习路线

这里把Python常用的技术点做了整理,有各个领域的知识点汇总,可以按照上面的知识点找对应的学习资源。

学习软件

Python常用的开发软件,会给大家节省很多时间。

学习视频

编程学习一定要多多看视频,书籍和视频结合起来学习才能事半功倍。

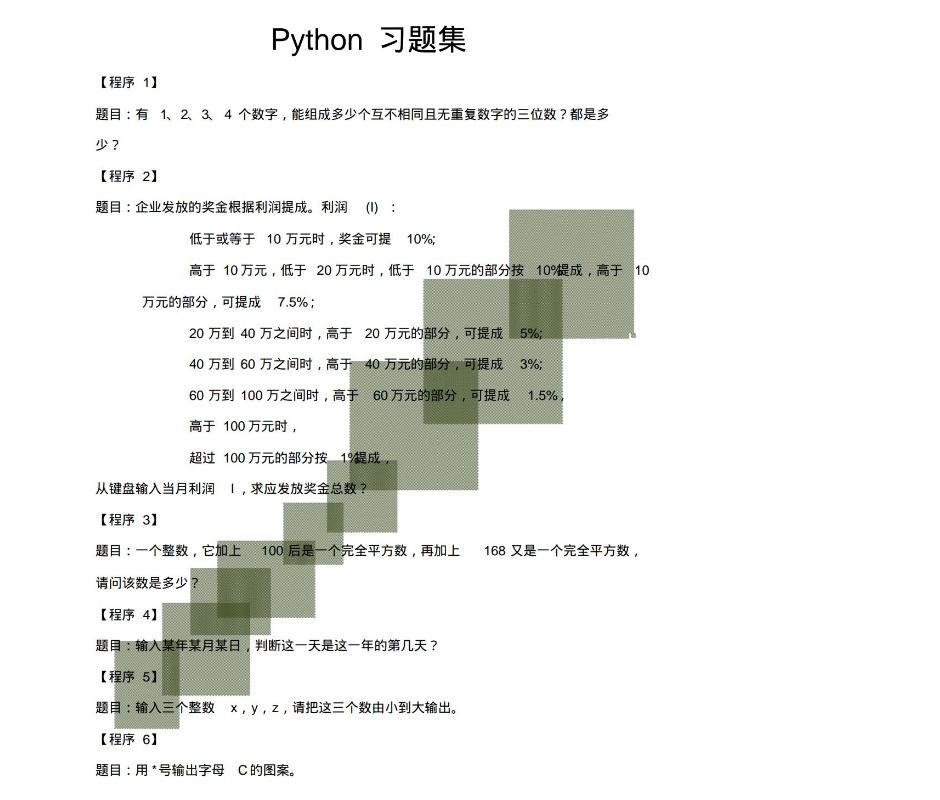

100道练习题

实战案例

光学理论是没用的,学习编程切忌纸上谈兵,一定要动手实操,将自己学到的知识运用到实际当中。

最后祝大家天天进步!!

上面这份完整版的Python全套学习资料已经上传至CSDN官方,朋友如果需要可以直接微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?