configuration.getVideoWidth(),

configuration.getVideoHeight());

//设置参数

format.setInteger(MediaFormat.KEY_COLOR_FORMAT,

MediaCodecInfo.CodecCapabilities.COLOR_FormatSurface);

format.setInteger(MediaFormat.KEY_BIT_RATE, C.VideoParams.BIT_RATE);

format.setInteger(MediaFormat.KEY_FRAME_RATE, C.VideoParams.SAMPLE_RATE);

format.setInteger(MediaFormat.KEY_I_FRAME_INTERVAL, C.VideoParams.I_FRAME_INTERVAL);

MediaCodec encoder = MediaCodec.createEncoderByType(C.VideoParams.MIME_TYPE);

encoder.configure(format, null, null, MediaCodec.CONFIGURE_FLAG_ENCODE);

inputSurface = encoder.createInputSurface();

复制代码

获取 inputSurface 之后,我们新建一个 EGLSurface,到这里编码器的初始化就完成了,当有新的内容时,通知编码器来刷新。之前我们获取了GLSurfaceView 的 GL 上下文,当收到新内容通知时,我们把 GL 环境切到编码器的线程,然后绘制,最后调用 swapBuffers 方法把绘制的内容填充到inputSurface 中,这就是所谓的离屏渲染(听着很高大上,后面讲解短视频后期制作时也会用到这个)。

这里不使用 EOS 纹理也是可以的,我们可以通过 Camera 的setPreviewCallback 方法监听相机的每一帧数据,然后将 YUV 数据转换成ARGB 数据,再转成纹理交给 OpenGL 渲染即可。

最后新建 MediaMuxer

muxer = new MediaMuxer(configuration.getFileName(),

MediaMuxer.OutputFormat.MUXER_OUTPUT_MPEG_4);

此部分内容参考 grafika 实现

视频变速

视频变速相对来说比较容易,在编码之后,我们从 MediaCodec 的缓冲区中获取本次编码内容的 ByteBuffer 和 BufferInfo ,前者是编码后的内容,后者是本次内容的信息,包括时间戳,大小等。我们通过改变视频的时间戳,就可以达到视频变速的要求。比如要加快视频的速度,那么只需要将视频的时间戳间隔缩小一定的倍数即可。放慢操作和这个相反,只需要把时间戳间隔放大一定的倍数即可。

音频录制

音频的录制我们需要使用到 AudioRecord 这个大杀器,大致流程图如下。

音频录制比较简单,参考官方文档即可。这里需要开启两条线程,因为目前使用的编码是同步模式,如果是在一条线程里处理数据,会导致麦克风的数据丢失。

关键代码如下:

初始化AudioRecord

指定单声道模式,采样率为 44100,每个采样点 16 比特

int bufferSize = AudioRecord.getMinBufferSize(

configuration.getSampleRate(), C.AudioParams.CHANNEL,

C.AudioParams.BITS_PER_SAMPLE);

recorder = new AudioRecord(

MediaRecorder.AudioSource.MIC, configuration.getSampleRate(),

C.AudioParams.CHANNEL, C.AudioParams.BITS_PER_SAMPLE, bufferSize);

复制代码

初始化MediaCodec

MediaFormat audioFormat = MediaFormat.createAudioFormat(C.AudioParams.MIME_TYPE,

C.AudioParams.SAMPLE_RATE, C.AudioParams.CHANNEL_COUNT);

audioFormat.setInteger(MediaFormat.KEY_AAC_PROFILE,

MediaCodecInfo.CodecProfileLevel.AACObjectLC);

audioFormat.setInteger(MediaFormat.KEY_CHANNEL_MASK, C.AudioParams.CHANNEL);

audioFormat.setInteger(MediaFormat.KEY_BIT_RATE, C.AudioParams.BIT_RATE);

audioFormat.setInteger(MediaFormat.KEY_CHANNEL_COUNT, C.AudioParams.CHANNEL_COUNT);

audioFormat.setInteger(MediaFormat.KEY_MAX_INPUT_SIZE, 1024 * 4);

encoder = MediaCodec.createEncoderByType(C.AudioParams.MIME_TYPE);

encoder.configure(audioFormat, null, null, MediaCodec.CONFIGURE_FLAG_ENCODE);

bufferInfo = new MediaCodec.BufferInfo();

mStream = new BufferedOutputStream(new FileOutputStream(configuration.getFileName()));

复制代码

音频编码

读取音频数据

byte[] buffer = new byte[configuration.getSamplePerFrame()];

int bytes = recorder.read(buffer, 0, buffer.length);

if (bytes > 0) {

encode(buffer, bytes);

}

复制代码

塞进MediaCodec缓冲区

private void onEncode(byte[] data, int length) {

final ByteBuffer[] inputBuffers = encoder.getInputBuffers();

while (true) {

final int inputBufferIndex = encoder.dequeueInputBuffer(BUFFER_TIME_OUT);

if (inputBufferIndex >= 0) {

final ByteBuffer inputBuffer = inputBuffers[inputBufferIndex];

inputBuffer.clear();

inputBuffer.position(0);

if (data != null) {

inputBuffer.put(data, 0, length);

}

if (length <= 0) {

encoder.queueInputBuffer(inputBufferIndex, 0, 0,

getTimeUs(), MediaCodec.BUFFER_FLAG_END_OF_STREAM);

break;

} else {

encoder.queueInputBuffer(inputBufferIndex, 0, length,

getTimeUs(), 0);

}

break;

}

}

}

复制代码

取出编码后的数据并写入文件

private void drain() {

bufferInfo = new MediaCodec.BufferInfo();

ByteBuffer[] encoderOutputBuffers = encoder.getOutputBuffers();

int encoderStatus = encoder.dequeueOutputBuffer(bufferInfo, C.BUFFER_TIME_OUT);

while (encoderStatus >= 0) {

ByteBuffer encodedData = encoderOutputBuffers[encoderStatus];

int outSize = bufferInfo.size;

encodedData.position(bufferInfo.offset);

encodedData.limit(bufferInfo.offset + bufferInfo.size);

byte[] data = new byte[outSize + 7];

addADTSHeader(data, outSize + 7);

encodedData.get(data, 7, outSize);

try {

mStream.write(data, 0, data.length);

} catch (IOException e) {

LogUtil.e(e);

}

if (duration >= configuration.getMaxDuration()) {

stop();

}

encoder.releaseOutputBuffer(encoderStatus, false);

encoderStatus = encoder.dequeueOutputBuffer(bufferInfo, C.BUFFER_TIME_OUT);

}

}

复制代码

aac文件对内容格式有要求,需要在每一帧的内容头部添加内容,代码如下:

private void addADTSHeader(byte[] packet, int length) {

int profile = 2; // AAC LC

int freqIdx = 4; // 44.1KHz

int chanCfg = 1; // CPE

// fill in A D T S data

packet[0] = (byte) 0xFF;

packet[1] = (byte) 0xF9;

packet[2] = (byte) (((profile - 1) << 6) + (freqIdx << 2) + (chanCfg >> 2));

packet[3] = (byte) (((chanCfg & 3) << 6) + (length >> 11));

packet[4] = (byte) ((length & 0x7FF) >> 3);

packet[5] = (byte) (((length & 7) << 5) + 0x1F);

packet[6] = (byte) 0xFC;

}

复制代码

音频变速

一开始调研短视频方案的时候,对于音频变速这方面,想了很多个方案:

- 音频和视频使用 MediaMuxer 合成,指定变速速率,在录制结束时使用ffmpeg 进行变速

- 视频和音频分开录制,视频实时变速录制,音频在录制结束时使用 ffmpeg 变速,然后再使用 ffmpeg 合并到视频中

- 音频和视频分开录制,音频实时变速,视频实时变速,录制完成后,使用ffmpeg 合成

最终我选择了第三个方案,前两个方案的死因如下:

- 效率差,ffmpeg 如果要对视频进行变速,效率很低,一个视频如果要放慢三倍,最久的时候要十几秒,并且因为使用的是软编,对 cpu 占用率比较高,会导致 UI 卡顿,

- 音频变速耗时比视频变速要少,但是对用户来说,还是可以感知的到的,所以这个方案也 pass。(主要是达不到抖音的效果)

第三个方案需要使用一个第三方库——SoundTouch,它可以改变音频的音调和速度。SoundTouch 由 C++ 实现,因此我们需要用 NDK 工具把它集成到工程当中。集成的方法参照官方文档即可。官方的例子中主要给出了处理 wav 文件的方法,接下来我介绍一下如何使用这个库实时处理 pcm 数据(通过实时处理PCM 数据,我们还可以弄个变声功能噢)。

SoundTouch 使用

新建类—— SoundTouch

public class SoundTouch {

private native final void setTempo(long handle, float tempo);

private native final void setPitchSemiTones(long handle, float pitch);

private native final void putBytes(long handle, byte[] input, int offset, int length);

private native final int getBytes(long handle, byte[] output, int length);

private native final static long newInstance();

private native final void deleteInstance(long handle);

private native final void flush(long handle);

private long handle = 0;

public SoundTouch() {

handle = newInstance();

}

public void putBytes(byte[] input) {

this.putBytes(handle, input, 0, input.length);

}

public int getBytes(byte[] output) {

return this.getBytes(handle, output, output.length);

}

public void close() {

deleteInstance(handle);

handle = 0;

}

public void flush() {

this.flush(handle);

}

public void setTempo(float tempo) {

setTempo(handle, tempo);

}

public void setPitchSemiTones(float pitch) {

setPitchSemiTones(handle, pitch);

}

static {

System.loadLibrary(“soundtouch”);

}

}

复制代码

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Android工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Android移动开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Android开发知识点,真正体系化!

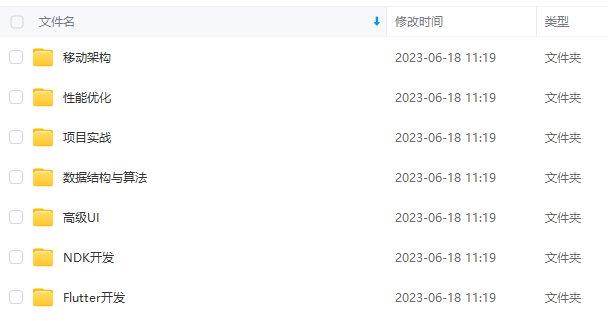

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip204888 (备注Android)

小福利:

在当下这个碎片化信息环境的时代,很多资源都可以在网络上找到,只取决于你愿不愿意找或是找的方法对不对了

很多朋友不是没有资料,大多都是有几十上百个G,但是杂乱无章,不知道怎么看从哪看起,甚至是看后就忘

如果大家觉得自己在网上找的资料非常杂乱、不成体系的话,我也分享一套给大家,比较系统,我平常自己也会经常研读。

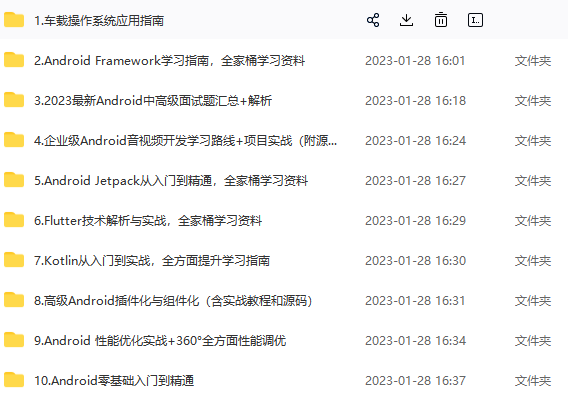

2021大厂最新Android面试真题解析

各个模块学习视频:如数据结构与算法

只有系统,有方向的学习,才能在段时间内迅速提高自己的技术。

这份体系学习笔记,适应人群:**第一,**学习知识比较碎片化,没有合理的学习路线与进阶方向。**第二,**开发几年,不知道如何进阶更进一步,比较迷茫。第三,到了合适的年纪,后续不知道该如何发展,转型管理,还是加强技术研究。如果你有需要,我这里恰好有为什么,不来领取!说不定能改变你现在的状态呢!点赞+评论即可获得!

只有系统,有方向的学习,才能在段时间内迅速提高自己的技术。

[外链图片转存中…(img-JqXsrh59-1711866868162)]

[外链图片转存中…(img-XaHOjEEA-1711866868162)]

这份体系学习笔记,适应人群:**第一,**学习知识比较碎片化,没有合理的学习路线与进阶方向。**第二,**开发几年,不知道如何进阶更进一步,比较迷茫。第三,到了合适的年纪,后续不知道该如何发展,转型管理,还是加强技术研究。如果你有需要,我这里恰好有为什么,不来领取!说不定能改变你现在的状态呢!点赞+评论即可获得!

514

514

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?