一.基本知识

矩阵的F范数:设矩阵则其F范数为:

描述的是两个矩阵之间的距离,它是向量的

范数的推广。

矩阵的迹:设矩阵,则A的迹为:tr(A)=

F范数等于的迹的平方根:

矩阵的迹满足:1.本身的迹与转置后的相等

2.交换律:假设,则有tr(AB)=tr(BA)

3.结合律:tr(ABC)=tr(CAB)=tr(BCA)

二.向量操作

判断向量的相关性,向量的点积,叉积,

三维向量的混合积:

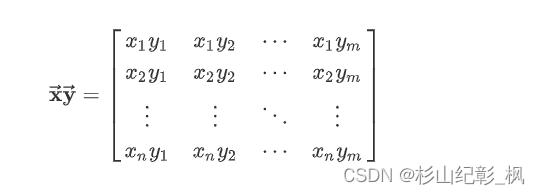

两个向量的并矢:给定两个向量则向量的并矢记作:

也记作

也记作或者

三.矩阵运算

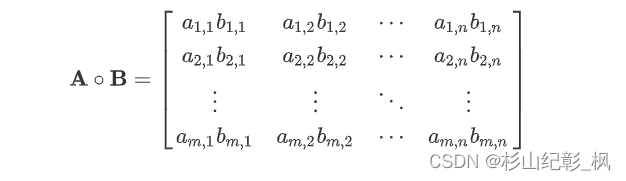

逐元素积(阿达马积Hadamard product)

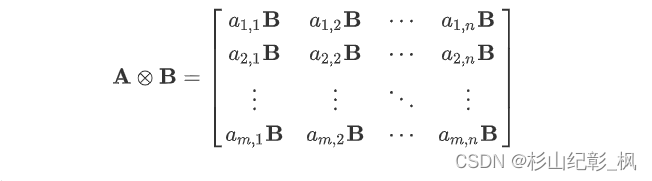

克罗内积(kronnecker product)

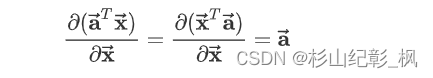

2.设,

,

,

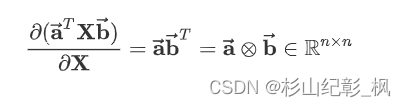

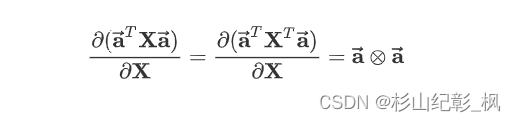

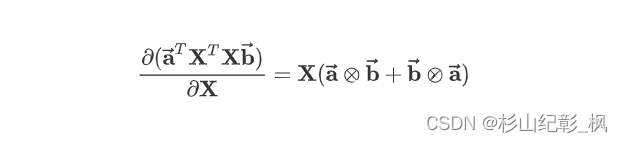

为n阶向量,A,B,C,X为n阶方阵,则有:

(1)按个人的经验理解主要出现在线性回归,CNN等神经网络中求解权重时用到。

(2)不难理解可以看作输入的是图片,求解网络每一层的权重时用到。

(3)不难看出与上个式子十分相似,不如说是一个特例。

(4)当两个向量相同时,求解方阵相乘,也是机器学习中的一个重要问题,可以运用到矩阵分解,深度学习中的梯度计算,特征提取和降维。

矩阵分解是机器学习中经典问题之一,通过矩阵相乘,可以将原始矩阵分解成由若干个小矩阵组成的乘积形式,常用的放法是奇异值分解(SVD),其中对SVD求解过程对矩阵求导可以运用。

深度学习中的梯度计算,求解梯度来更新模型权重当神经网络的输入输出相同时,有可能用到。

特征提取和降维,特征提取和降维是机器学习中的常用技术之一,将原始数据映射到低维度的特征空间中,减少计算复杂度和冗余信息,在特定情况下,可以使用。

补充:

因为提到特征选择与提取,就顺便说一下,这对模型的性能有着非常大的影响,通常情况下我们通过增加特征的维度来提高模型性能,对于复杂的问题,特征的维度很大,模型需要处理大量的原始特征和特征之间的相关关系,在提高模型性能之前,我们需要在特征空间中先升高维度,然后通过特征选择和提取技术来降低维度,同样的先升高维度,又降低维度的还有数据增强等技术手段。

特征选择和提取常见的手段还有,方差选择,相关性选择,主成分分析,独立成分分析,特征学习等方法。

3703

3703

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?