1.1.1 创建目录

./bin/hdfs dfs -mkdir -p /user/hadoop

作用:在HDFS中创建一个名为/user/hadoop的目录,并自动创建其父目录(如果不存在)。

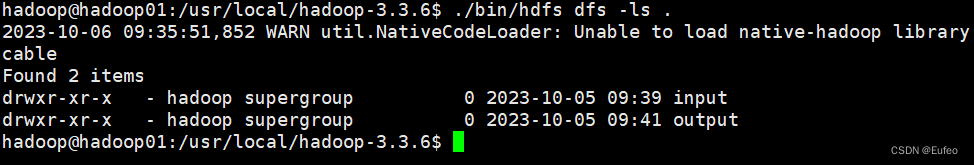

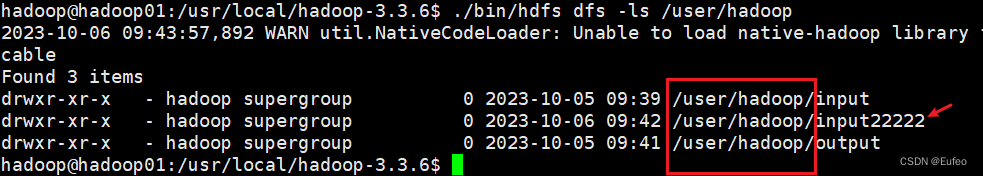

1.1.2 列出目录内容

./bin/hdfs dfs -ls .

作用:在HDFS中列出当前目录的内容。

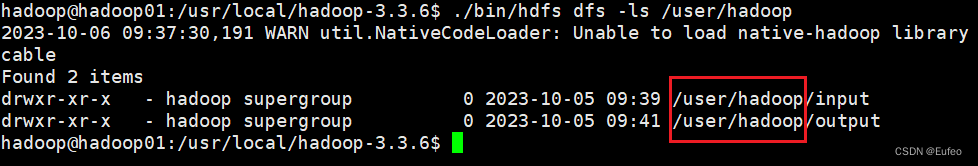

该命令中,“-ls”表示列出HDFS某个目录下的所有内容,“.”表示HDFS中的当前用户目录,也就是“/user/hadoop”目录,因此,上面的命令和下面的命令是等价的:

./bin/hdfs dfs -ls /user/hadoop

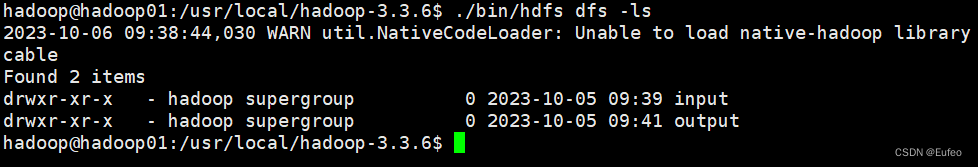

如果要列出HDFS上的所有目录,可以使用如下命令:

./bin/hdfs dfs -ls

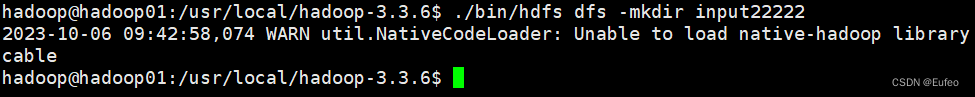

下面,可以使用如下命令创建一个input目录:

./bin/hdfs dfs -mkdir input22222

在创建个input目录时,采用了相对路径形式,实际上,这个input目录创建成功以后,它在HDFS中的完整路径是“/user/hadoop/input”。

如果要在HDFS的根目录下创建一个名称为input的目录,则需要使用如下命令:

./bin/hdfs dfs -mkdir /input33333

列出hdfs根目录下文件的命令:

./bin/hdfs dfs -ls /

1.1.3 删除目录

可以使用rm命令删除一个目录,比如,可以使用如下命令删除刚才在HDFS中创建的“/input33333”目录(不是“/user/hadoop/input22222”目录):

./bin/hdfs dfs -rm -r /input33333

上面命令中,“-r”参数表示如果删除“/input”目录及其子目录下的所有内容,如果要删除的一个目录包含了子目录,则必须使用“-r”参数,否则会执行失败。

1.2 文件操作

在实际应用中,经常需要从本地文件系统向HDFS中上传文件,或者把HDFS中的文件下载到本地文件系统中。

首先,使用vim编辑器,在本地Linux文件系统的“/home/hadoop/”目录下创建一个文件myLocalFile.txt,里面可以随意输入一些单词,比如,输入如下三行:

Hadoop

Spark

JavaWeb

1.2.1 本地上传文件到HDFS

然后,可以使用如下命令把本地文件系统的“/home/hadoop/myLocalFile.txt”上传到HDFS中的当前用户目录的input目录下,也就是上传到HDFS的“/user/hadoop/input/”目录下:

hdfs dfs -put /home/hadoop/myLocalFile.txt input22222 # 设置了PATH变量的话可以直接使用hdfs命令

hdfs dfs -ls input22222 # 查看文件是否上传成功

查看input22222文件夹中的内容:

hdfs dfs -ls input22222

查看HDFS中的myLocalFile.txt这个文件的内容:

hdfs dfs -cat input22222/myLocalFile.txt

如果没有设置PATH路径,使用如下命令

cd /usr/local/hadoop-3.3.6

./bin/ hdfs dfs -cat input22222/myLocalFile.txt

1.2.2 将文件从HDFS下载到本地主机

./bin/hdfs dfs -ls input22222

./bin/hdfs dfs -get input22222/myLocalFile.txt /home/hadoop/Downloads/

cd /home/hadoop/Downloads/

ls -l

cat myLocalFile.txt

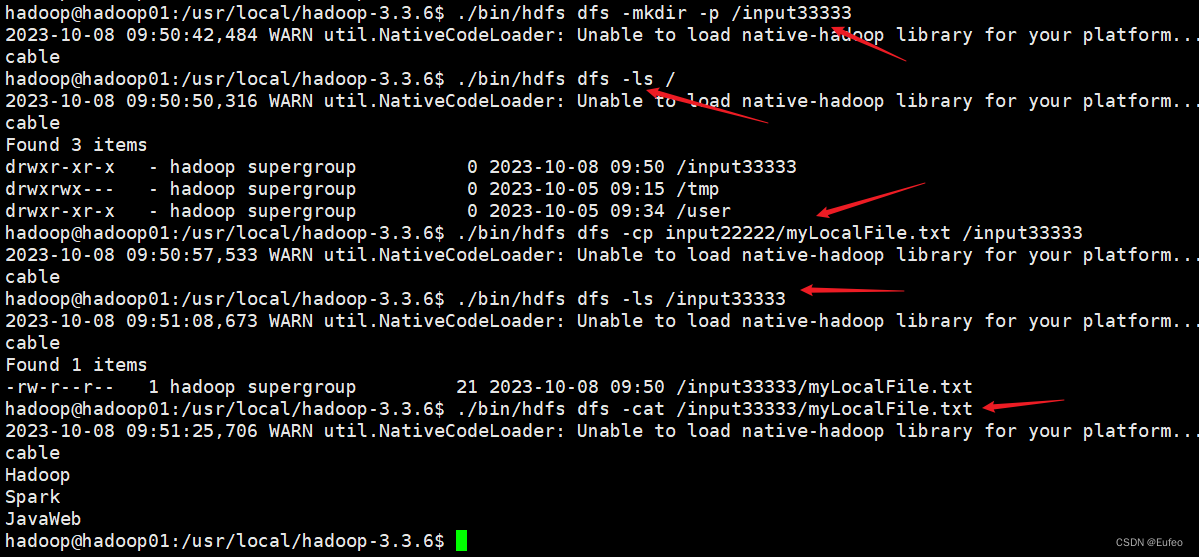

1.2.3 文件在HDFS中拷贝

了解一下如何把文件从HDFS中的一个目录拷贝到HDFS中的另外一个目录。比如,如果要把HDFS的“/user/hadoop/input22222/myLocalFile.txt”文件,拷贝到HDFS的另外一个目录“/input33333”中(注意,这个input33333目录位于HDFS根目录下),可以使用如下命令:

先在根目录下创建input33333文件夹:

./bin/hdfs dfs -mkdir -p /input33333

./bin/hdfs dfs -ls /

执行复制指令:

./bin/hdfs dfs -cp input22222/myLocalFile.txt /input33333

查看文件是否复制成功:

./bin/hdfs dfs -ls /input33333

./bin/hdfs dfs -cat /input33333/myLocalFile.txt

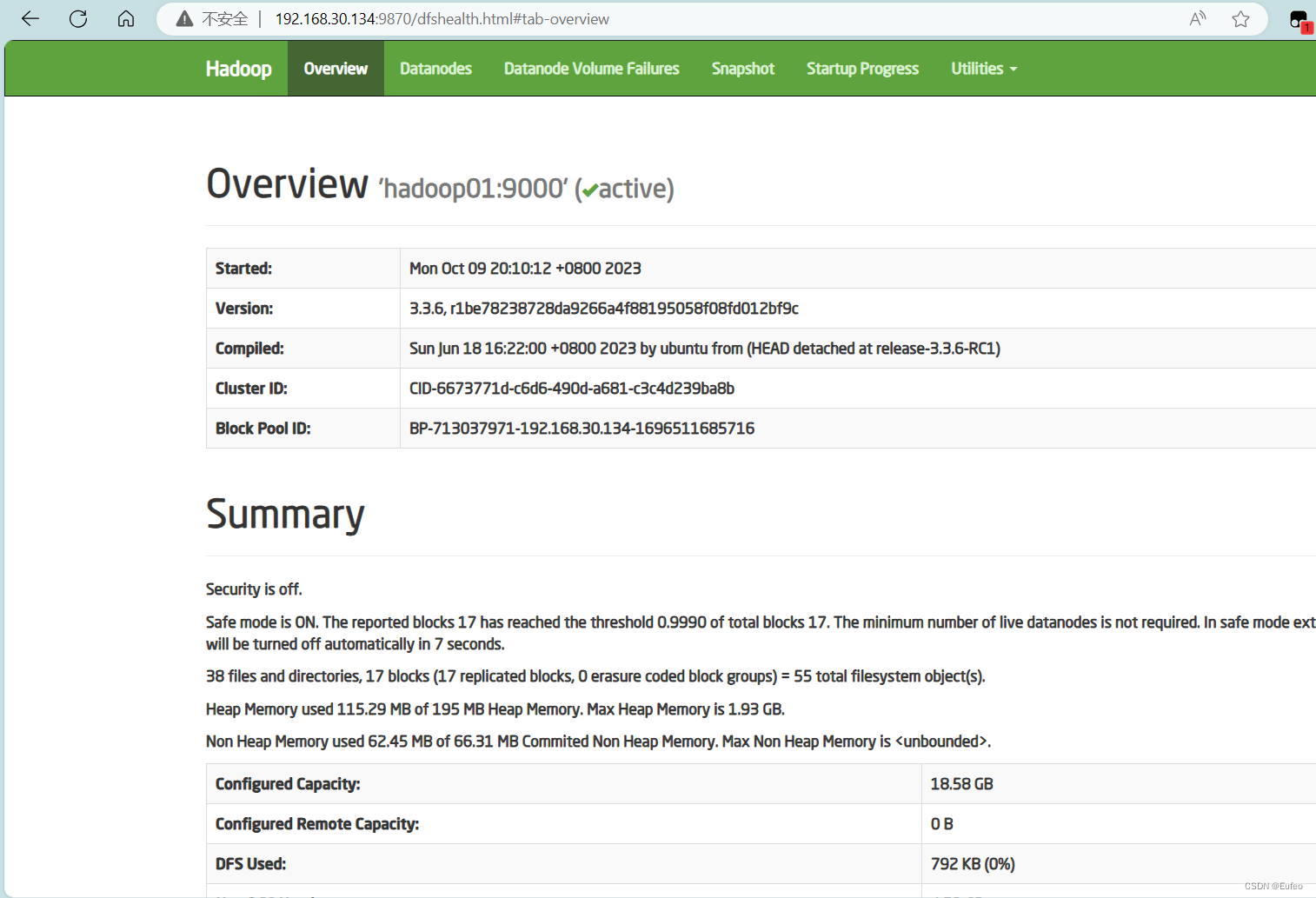

二、利用Web界面管理HDFS

在master节点上启动Hadoop(版本是Hadoop3.3.6)的前提下。可以使用:"IP地址:9870"的方式进入HDFS的Web界面即可看到HDFS的web管理界面。WEB界面的访问地址是http://localhost:9870。

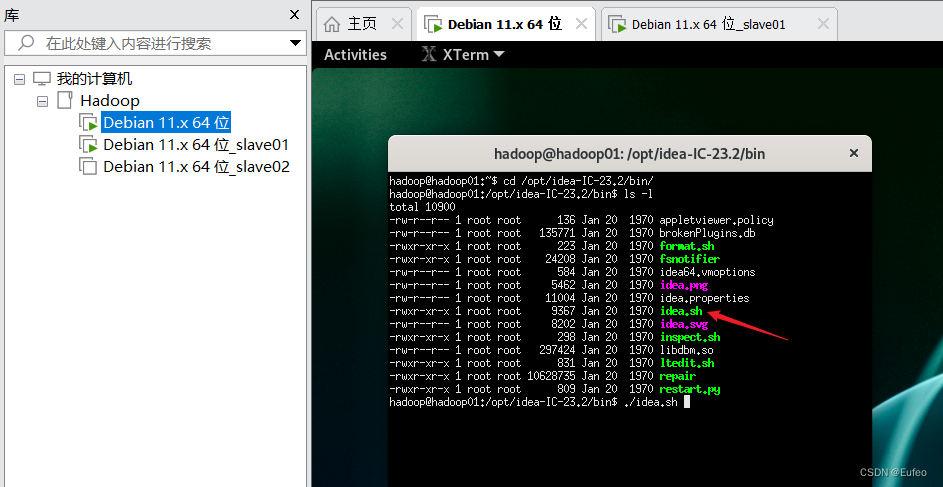

三、利用Java API与HDFS进行交互

Hadoop不同的文件系统之间通过调用Java API进行交互,上面介绍的Shell命令,本质上就是Java API的应用。下面提供了Hadoop官方的Hadoop API文档,想要深入学习Hadoop,可以访问如下网站,查看各个API的功能。

利用Java API进行交互,需要利用软件IDEA编写Java程序。

3.1 在Debian系统中安装IDEA软件

详细教程,可以参考此处。

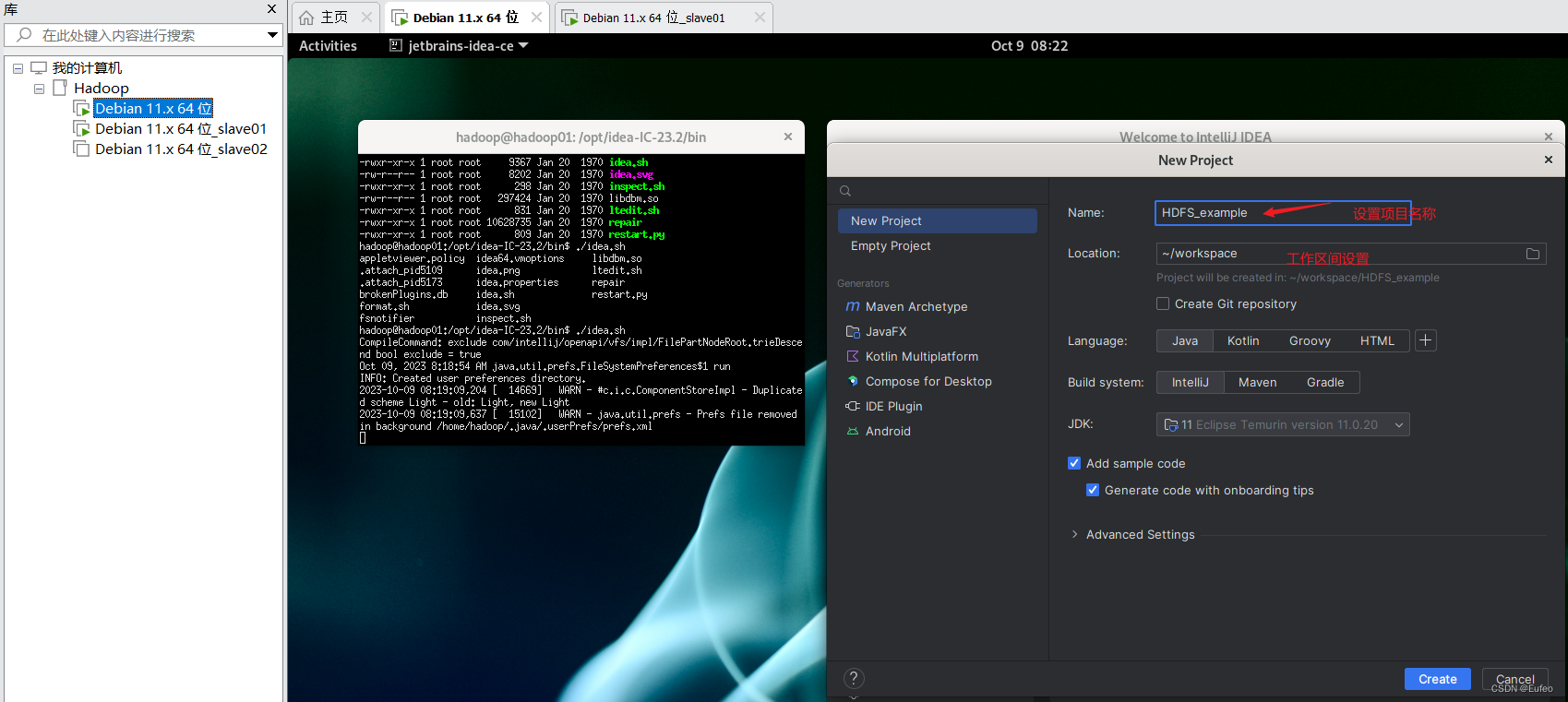

3.2 使用IDEA开发调试HDFS Java程序

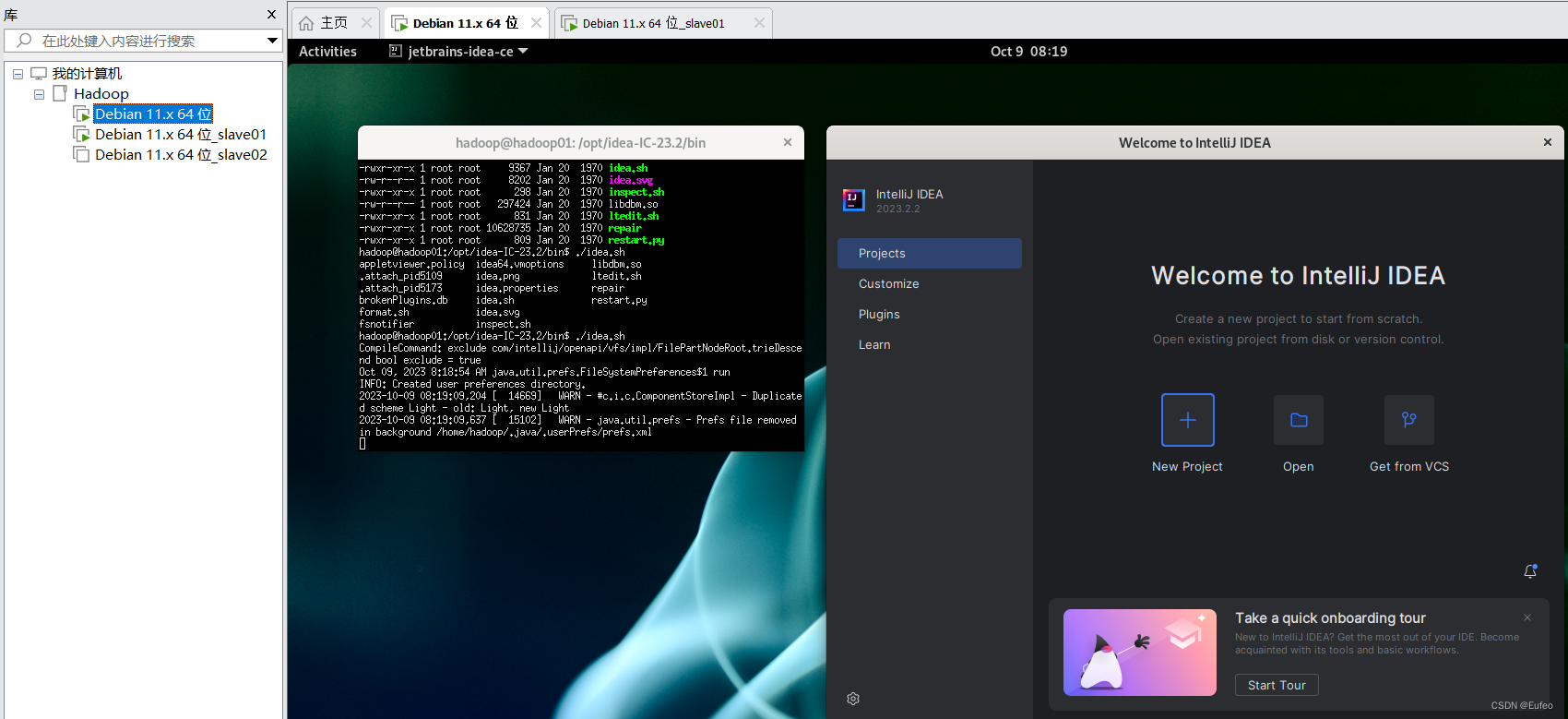

进入IDEA的安装目录,启动IDEA工具。

cd /opt/idea-IC-23.2/bin

ls -l

./bin/idea.sh

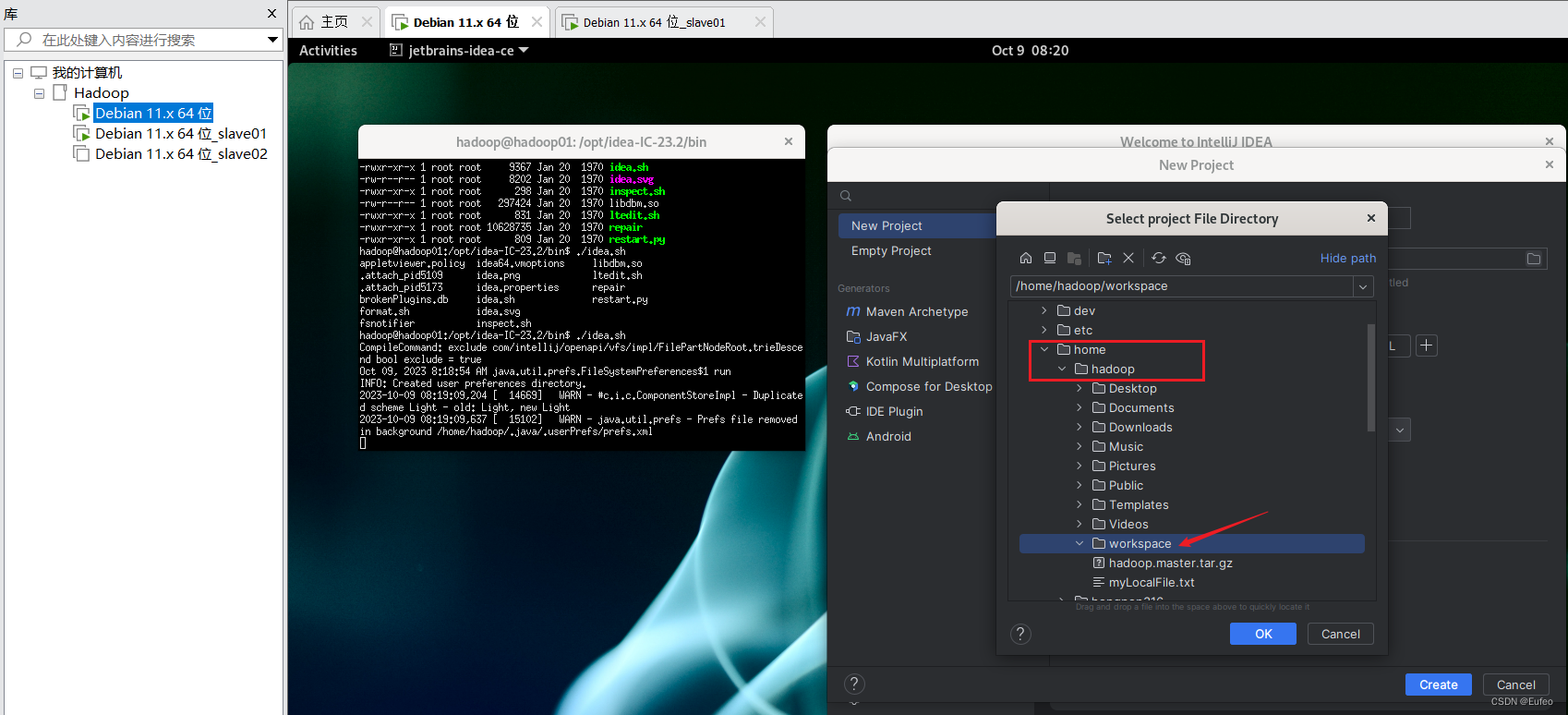

启动IDEA工具。当IDEA启动以后,会弹出如下图所示界面,提示设置工作空间(workspace)。

可以直接采用默认的设置“/home/hadoop/workspace”,点击“OK”按钮。可以看出,由于当前是采用hadoop用户登录了Linux系统,因此,默认的工作空间目录位于hadoop用户目录“/home/hadoop”下。

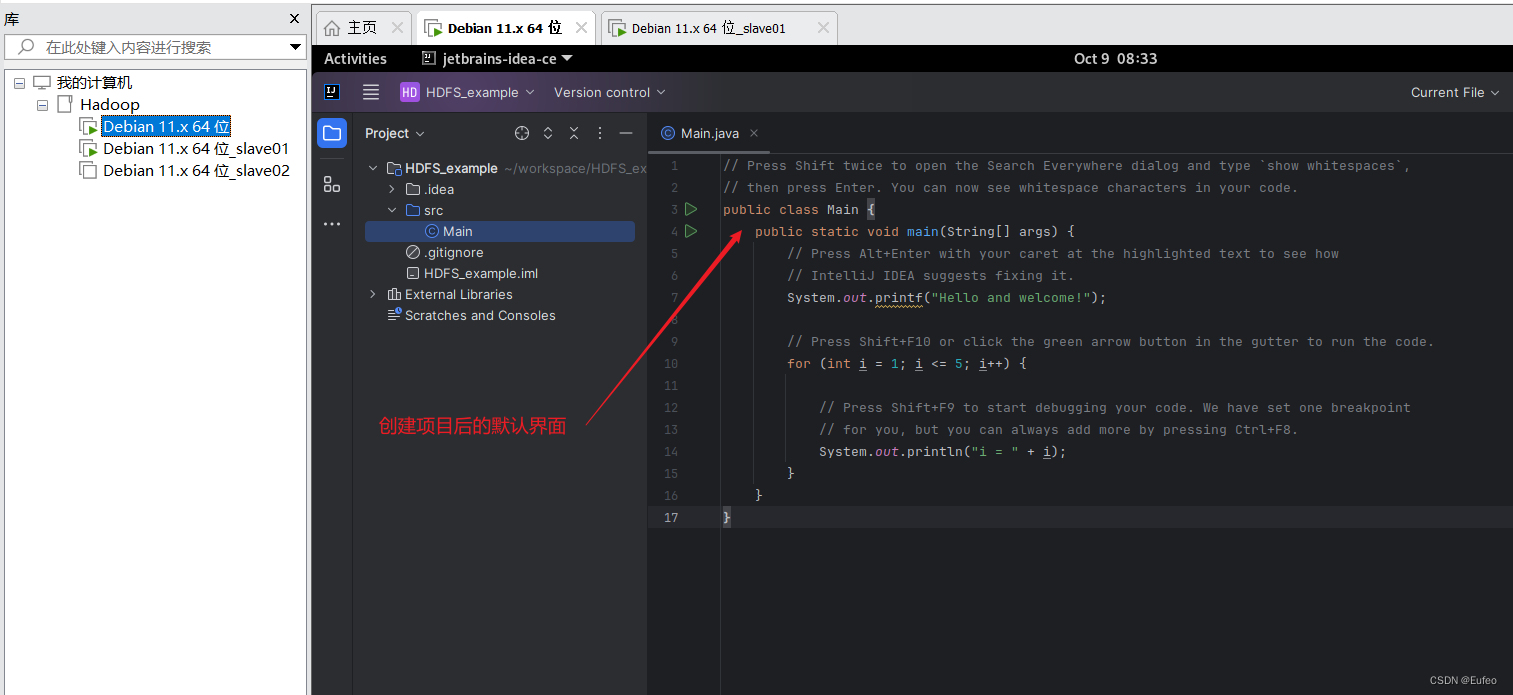

IDEA启动以后,会呈现如下图所示的界面。

3.3 为项目添加需要用到的JAR包

为了编写一个能够与HDFS交互的Java应用程序,一般需要向Java工程中添加以下JAR包:

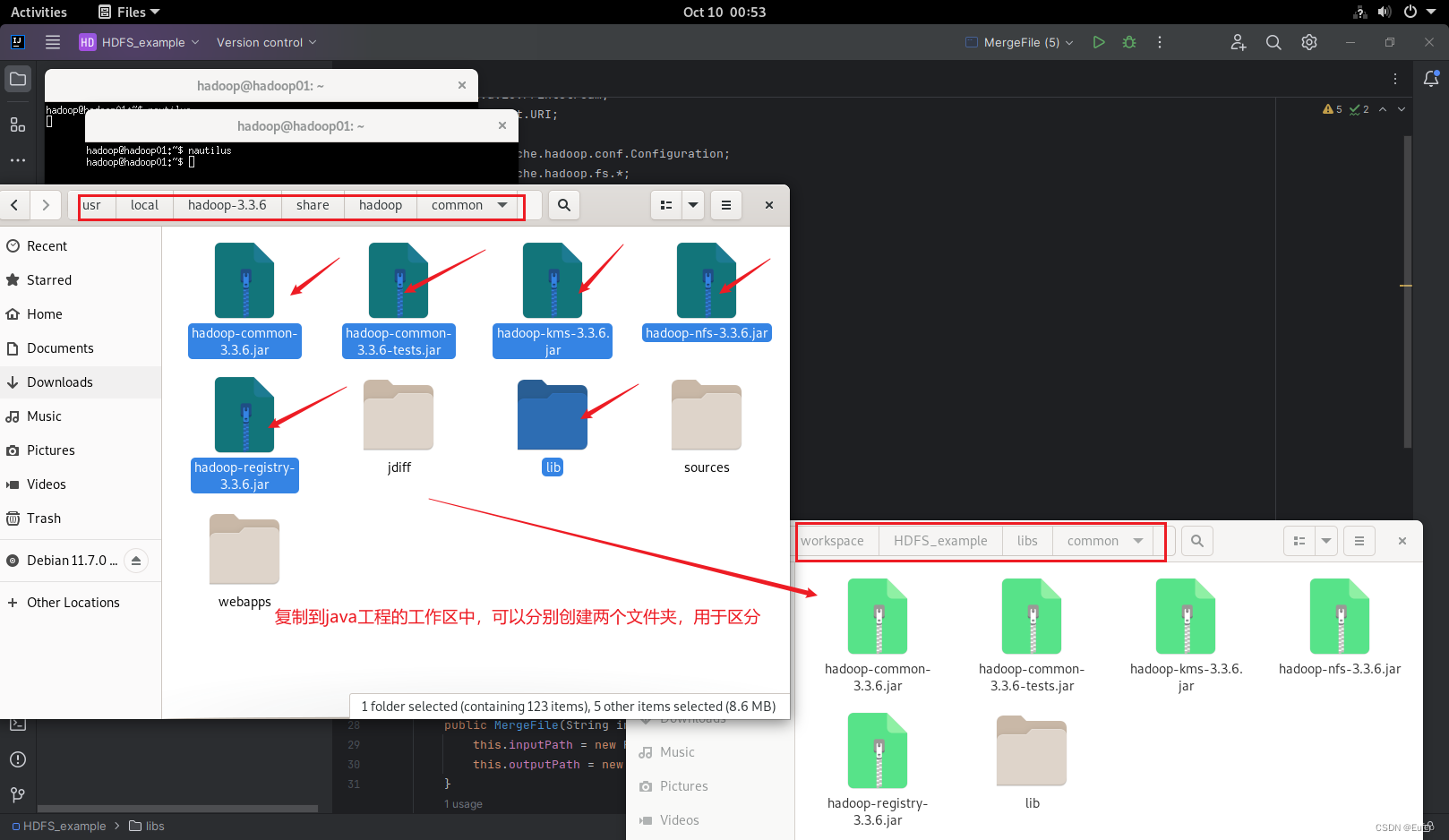

(1)“/usr/local/hadoop/share/hadoop-3.3.6**/common**”目录下的所有JAR包,包括hadoop-common-3.3.6.jar、hadoop-common-3.3.6-tests.jar、haoop-nfs-3.3.6.jar、haoop-kms-3.3.6.jar和hadoop-registry-3.3.6.jar,注意,不包括目录jdiff、lib、sources和webapps;

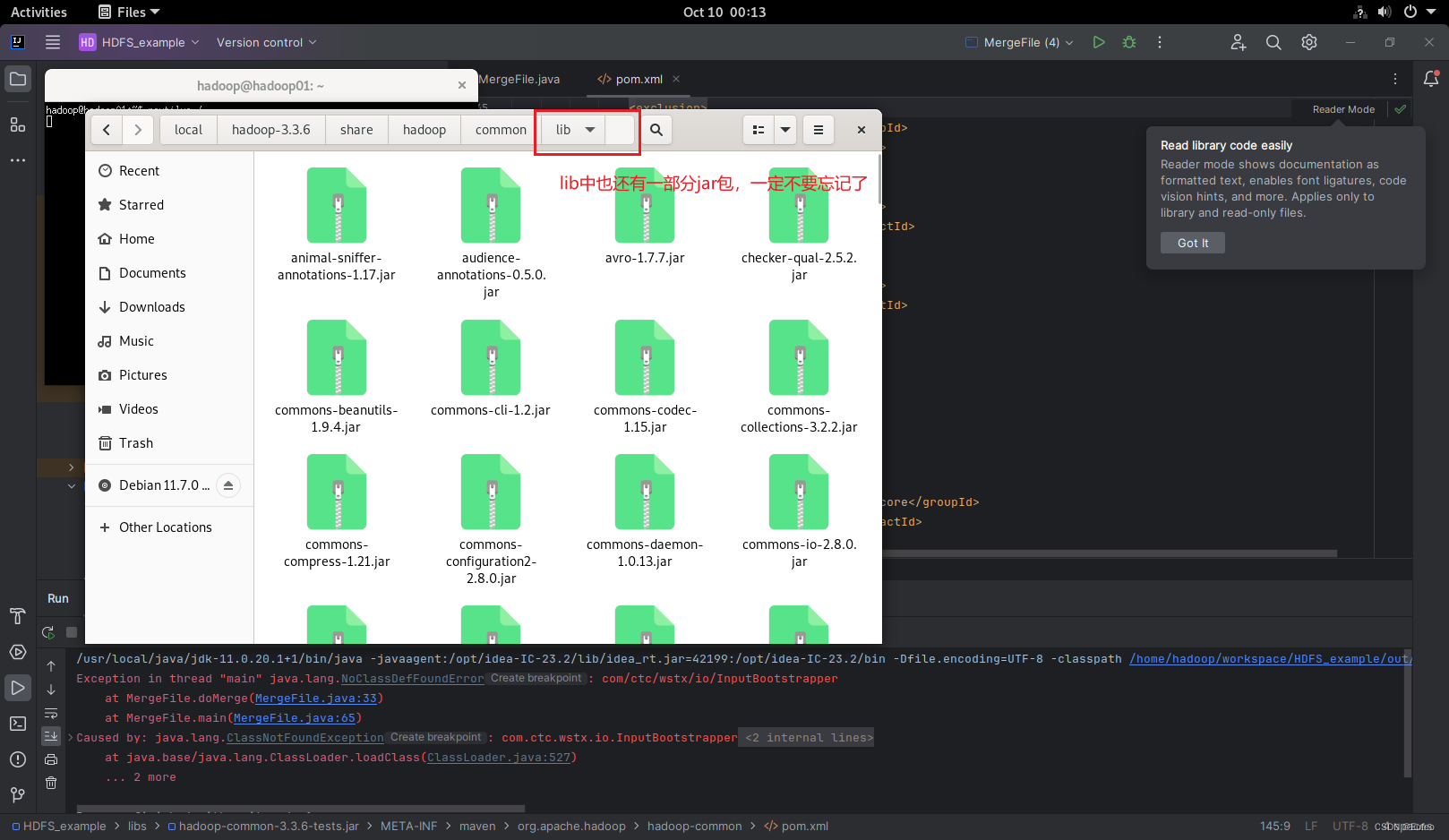

(2)“/usr/local/hadoop-3.3.6/share/hadoop**/common/lib**”目录下的所有JAR包;

(3)“/usr/local/hadoop-3.3.6/share/hadoop**/hdfs**”目录下的所有JAR包,注意,不包括目录jdiff、lib、sources和webapps;

(4)“/usr/local/hadoop-3.3.6/share/hadoop**/hdfs/lib**”目录下的所有JAR包。

第一步:创建libs文件夹。如果已经存在libs文件夹,则可以直接进行下一步。

第二步:将需要导入的jar包复制粘贴到libs文件夹中。

将jar复制到libs中,记住刚放入时的jar包状态,不可点击打开 。

例如:可以通过输入命令以下命令,然后进入 /usr/local/hadoop-3.3.6/share/hadoop/common 文件夹中查到需要导入到HDFS_example项目中的jar包:

nautilus /

包括lib和其他的jar包:

同样地,复制hdfs下的jar包和lib:

然后在IDEA中的Java工程中导入以上的包:

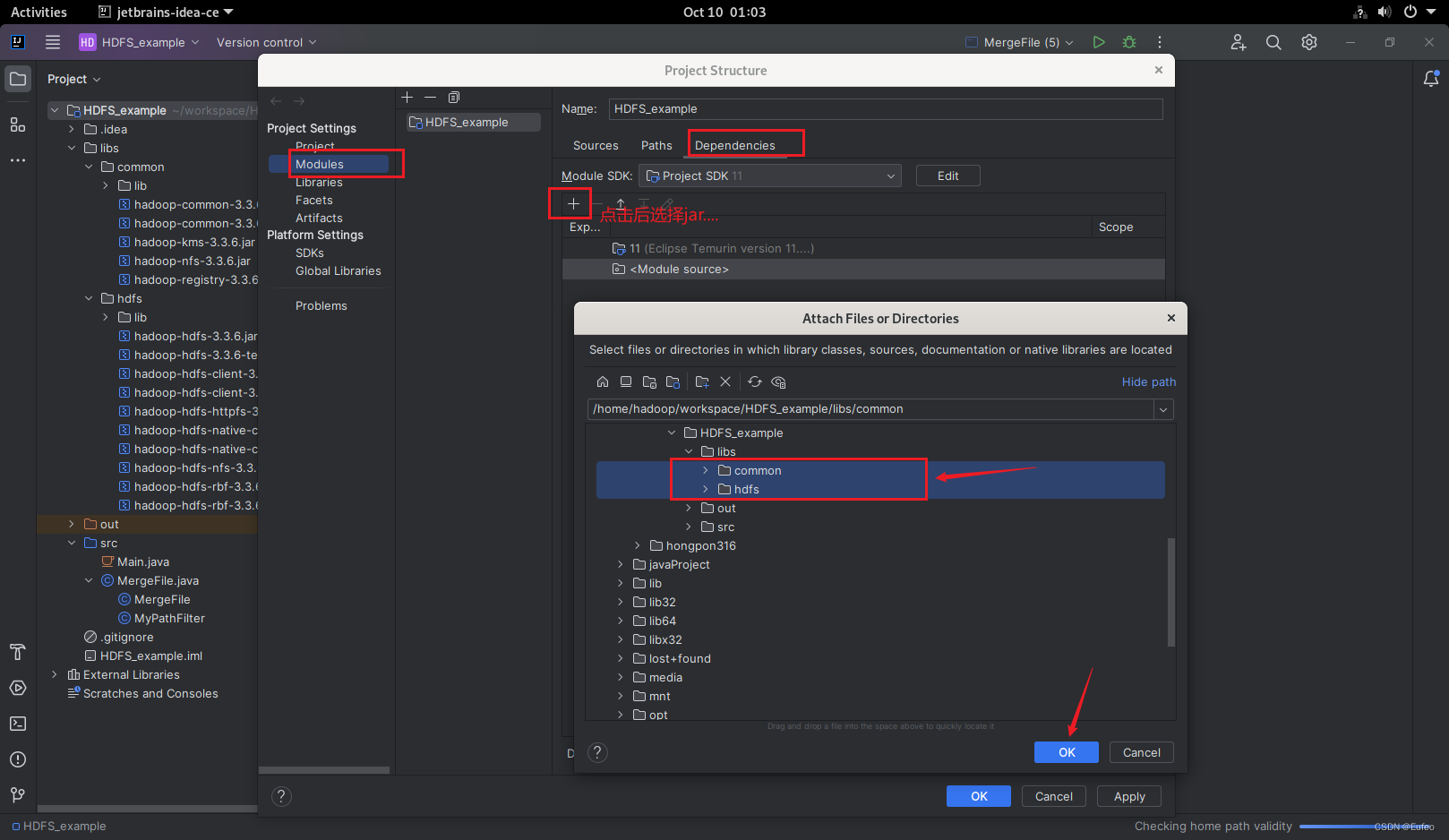

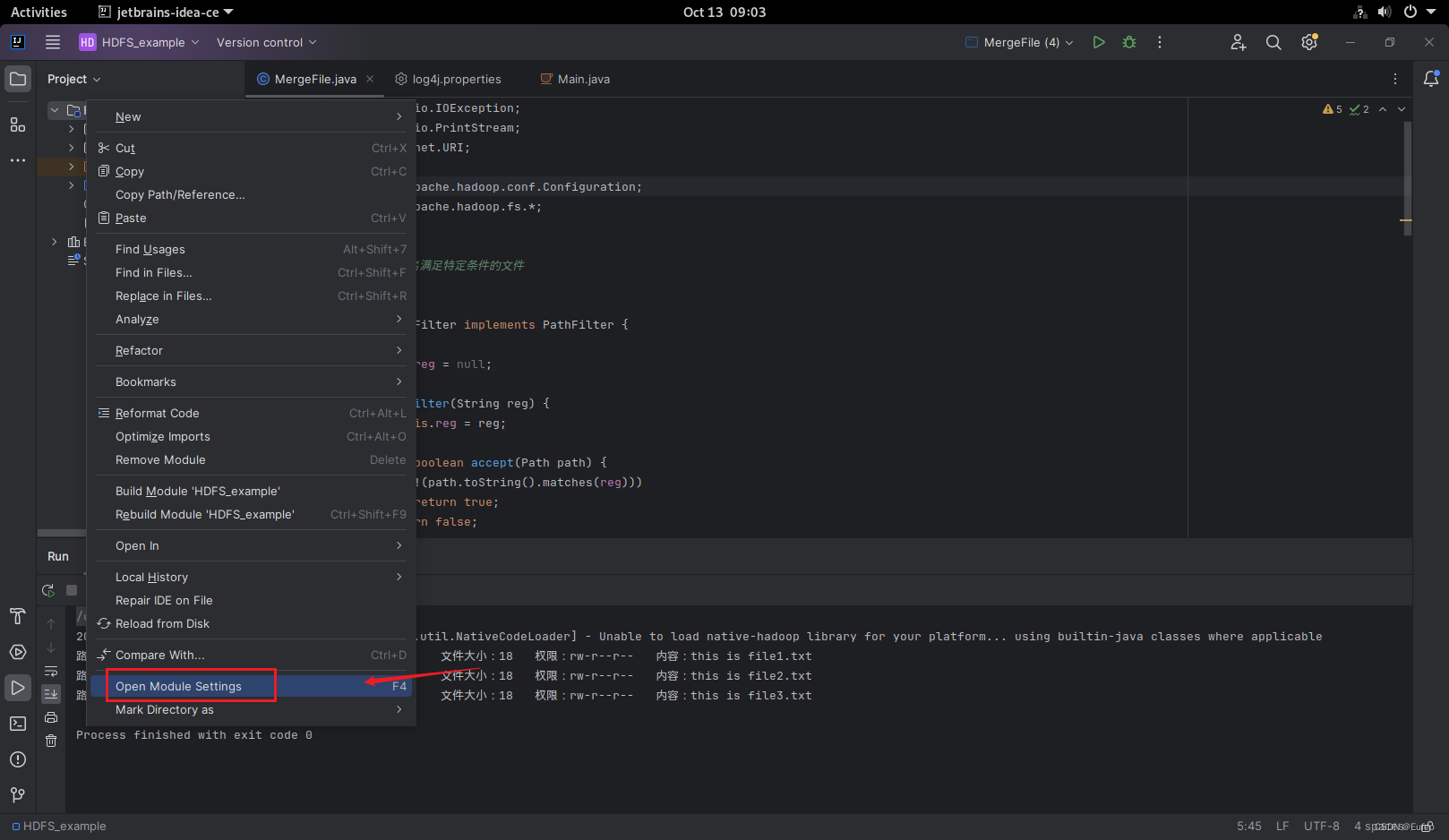

第三步:建立对libs文件夹的依赖。在IDEA中右键单击项目,选择’Open Module Settings”(或者"Project Structure"”),在弹出的窗口中选择’Modules”,然后选择“Dependencies”选项卡。

点击“+"按钮,选择"JARs or directories”,然后在弹出的窗口中选择刚才放置jar包的libs文件夹,然后点击OK(我在此处直接选择的是文件夹)。

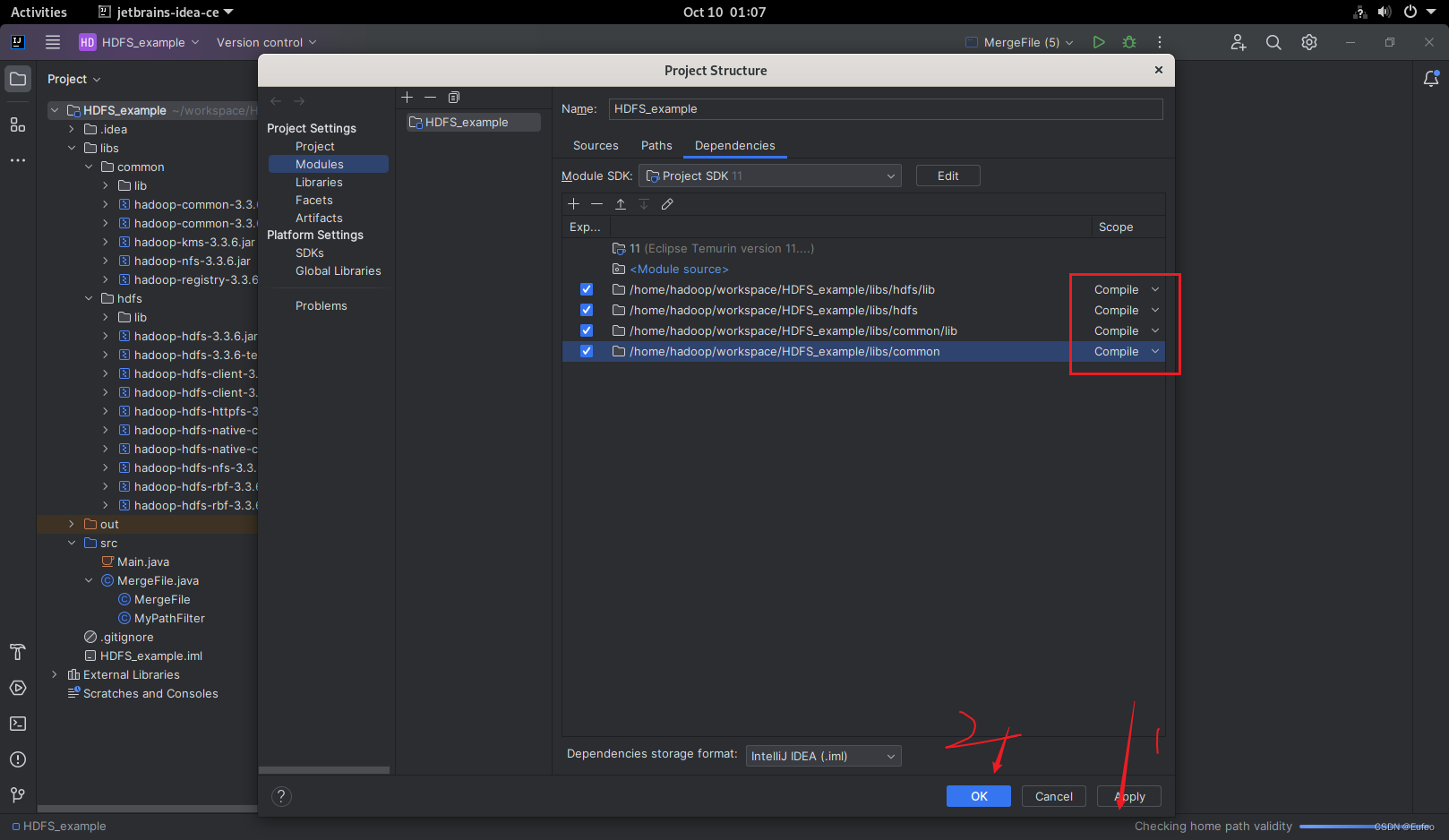

在此处选择“compile”:然后点击“apply”和“ok”:

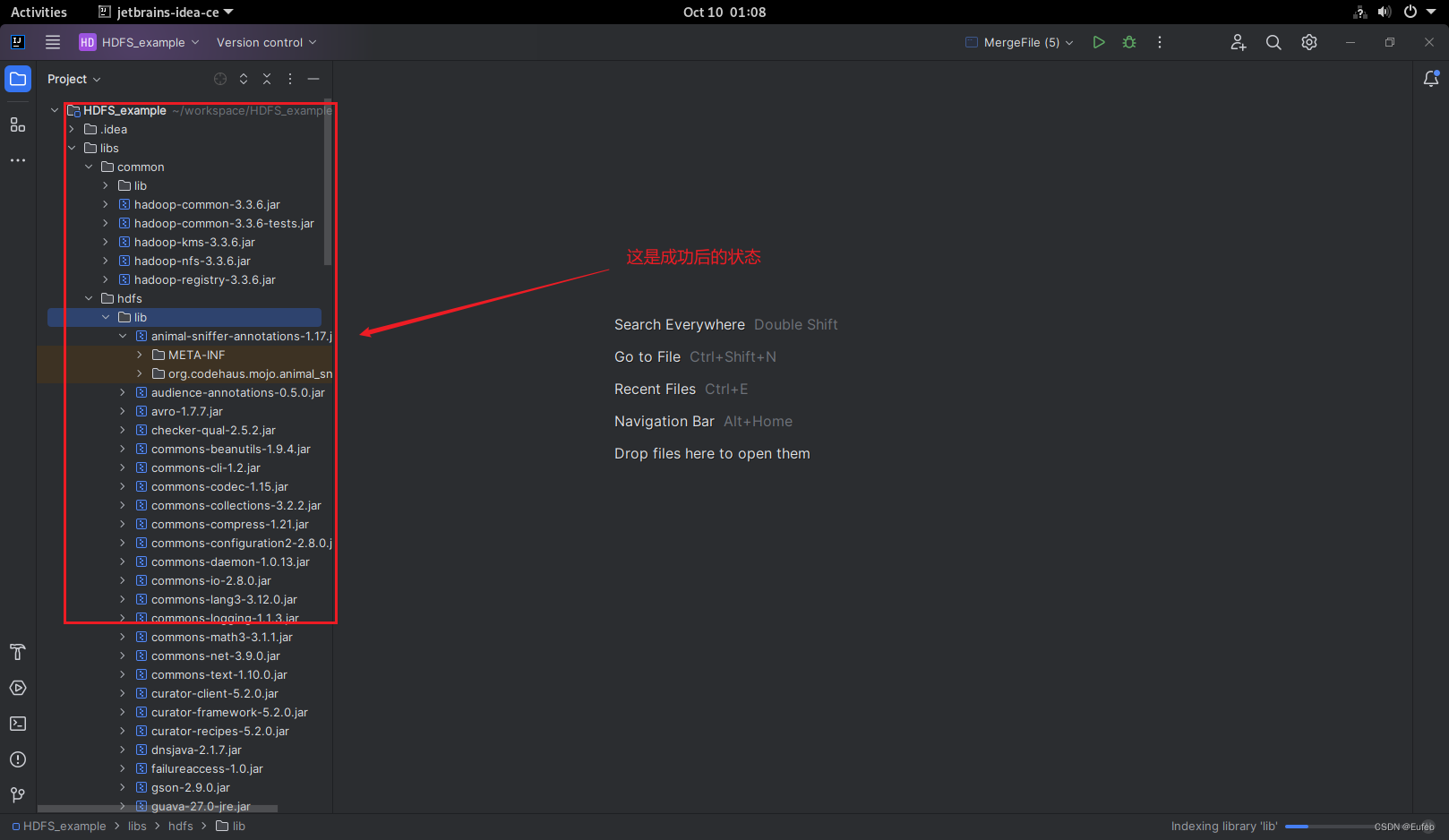

如果是这个状态表示导入成功:

这样,导入jar包的操作就完成了。现在你可以直接编写或运行代码了。如果需要进一步优化导包设置,可以根据IDEA的环境配置和插件进行相应的调整(如Maven)。

四、编写Java应用程序

4.1 新建MergeFile.java的文件

import java.io.IOException;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.*;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.io.SequenceFile;

import org.apache.hadoop.io.SequenceFile.Writer;

import org.apache.hadoop.io.compress.DefaultCodec;

/**

* 过滤掉文件名满足特定条件的文件

*/

class MyPathFilter implements PathFilter {

String reg = null;

MyPathFilter(String reg) {

this.reg = reg;

}

public boolean accept(Path path) {

if (!(path.toString().matches(reg)))

return true;

return false;

}

}

/***

* 利用XMLRecordReader和SequenceFile.Writer合并HDFS中的XML文件

*/

public class MergeFile {

Path inputPath = null; //待合并的文件所在的目录的路径

Path outputPath = null; //输出文件的路径

public MergeFile(String input, String output) {

this.inputPath = new Path(input);

this.outputPath = new Path(output);

}

public void doMerge() throws IOException {

Configuration conf = new Configuration();

conf.set("fs.defaultFS", "hdfs://localhost:9000");

conf.set("fs.hdfs.impl", "org.apache.hadoop.hdfs.DistributedFileSystem");

FileSystem fsSource = FileSystem.get(URI.create(inputPath.toString()), conf);

FileSystem fsDst = FileSystem.get(URI.create(outputPath.toString()), conf);

// 下面过滤掉输入目录中后缀为.abc的文件

FileStatus[] sourceStatus = fsSource.listStatus(inputPath, new MyPathFilter(".*\\.abc"));

// 创建SequenceFile.Writer来写入合并后的文件

SequenceFile.Writer writer = SequenceFile.createWriter(fsDst, conf, outputPath, Text.class, Text.class,

SequenceFile.CompressionType.BLOCK, new DefaultCodec());

// 下面读取过滤之后的每个文件的内容,并将每个文件的内容写入SequenceFile中

for (FileStatus status : sourceStatus) {

FSDataInputStream fsdis = fsSource.open(status.getPath());

byte[] data = new byte[(int) status.getLen()];

fsdis.readFully(data);

fsdis.close();

// 将文件路径作为key,文件内容作为value写入SequenceFile

writer.append(new Text(status.getPath().toString()), new Text(data));

}

writer.close();

}

public static void main(String[] args) throws IOException {

MergeFile merge = new MergeFile("hdfs://localhost:9000/user/hadoop/", "hdfs://localhost:9000/user/hadoop/merge.txt");

merge.doMerge();

}

}

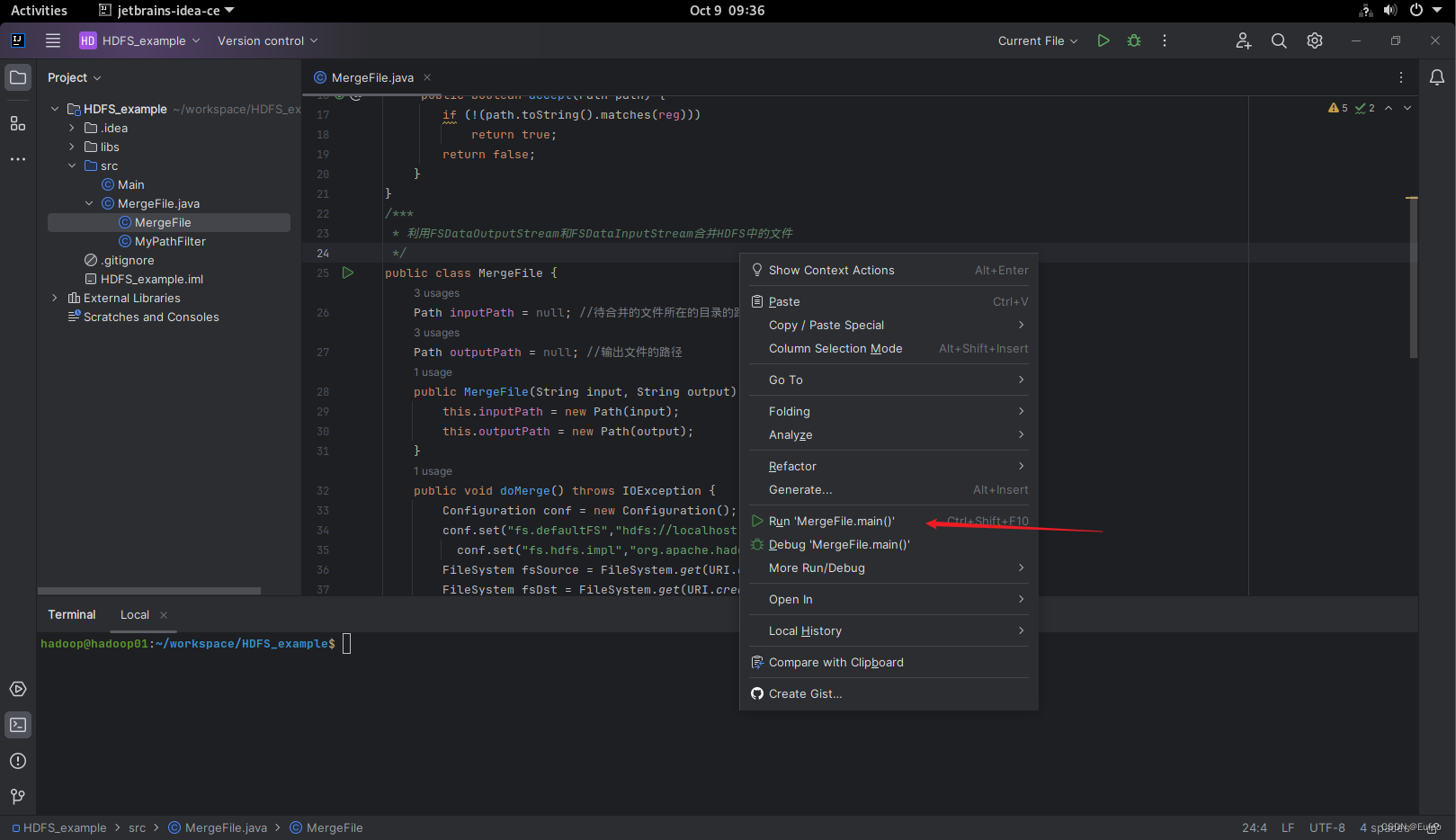

作用:使用FSDataOutputStream和FSDataInputStream来合并HDFS中的文件。它通过循环读取每个文件的内容,并将其写入输出文件中。

4.2 编译运行程序

在开始编译运行程序之前,请一定确保Hadoop已经启动运行,如果还没有启动,需要打开一个Linux终端,输入以下命令启动Hadoop:

cd /usr/local/hadoop-3.3.6/bin/

./bin/hdfs start-dfs.sh

也可通过 jps 命令查看是否已经启动:

然后,要确保HDFS的“/user/hadoop”目录下已经存在file1.txt、file2.txt、file3.txt、file4.abc和file5.abc,每个文件里面有内容。这里,假设文件内容如下:

file1.txt的内容是: this is file1.txt

file2.txt的内容是: this is file2.txt

file3.txt的内容是: this is file3.txt

file4.abc的内容是: this is file4.abc

file5.abc的内容是: this is file5.abc

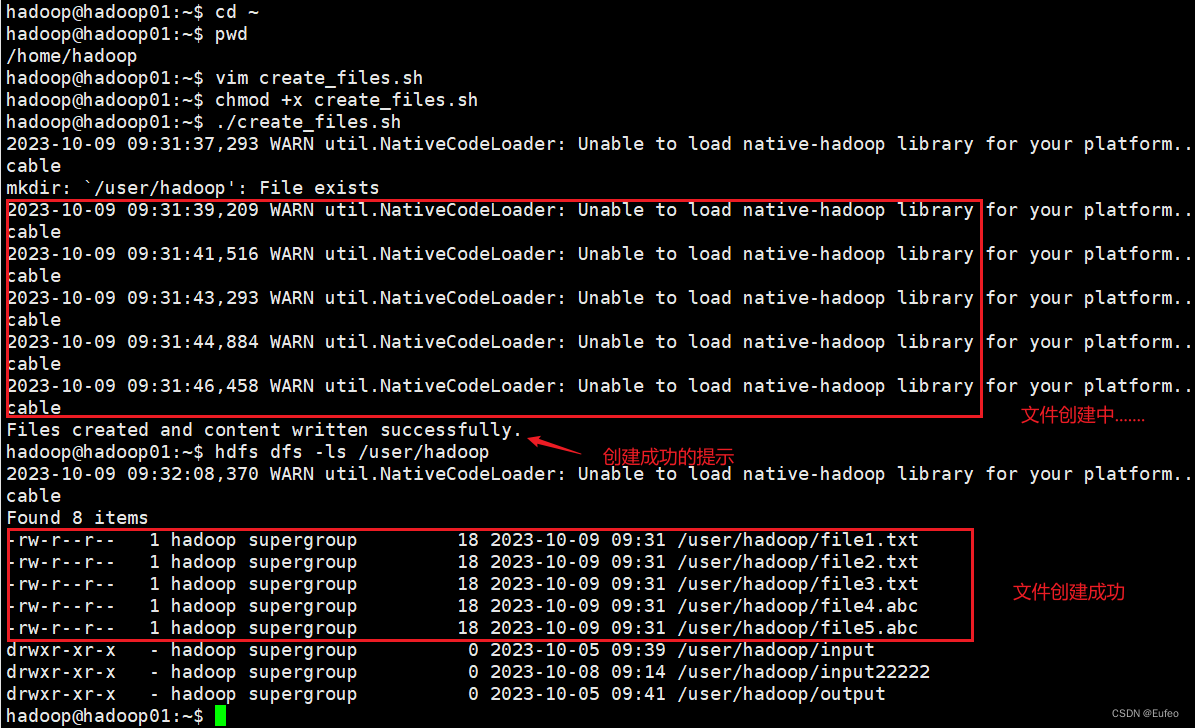

如果没有创建,可以使用一个脚本命令来快速创建:

cd ~

pwd # 显示当前的路径

vim create_files.sh # 编辑脚本

chmod +x create_files.sh # 修改脚本的权限

./create_files.sh # 执行脚本

hdfs dfs -ls /user/hadoop # 查看是否创建成功

#!/bin/bash

hdfs dfs -mkdir /user/hadoop

echo “this is file1.txt” | hdfs dfs -put - /user/hadoop/file1.txt

echo “this is file2.txt” | hdfs dfs -put - /user/hadoop/file2.txt

echo “this is file3.txt” | hdfs dfs -put - /user/hadoop/file3.txt

echo “this is file4.abc” | hdfs dfs -put - /user/hadoop/file4.abc

echo “this is file5.abc” | hdfs dfs -put - /user/hadoop/file5.abcecho “Files created and content written successfully.”

执行该代码:

执行该代码:

特别注意:在执行代码之前,请将/user/hadoop 下的 **文件夹(如input、input22222、output、input33333之类的,在之前操作过程中产生的文件)**全部删除干净。

hdfs dfs -ls # 查看/user/hadoop 目录下有哪些文件夹

hdfs dfs -rm -r 文件名 # 删除文件夹

可能出现的问题:

Exception in thread “main“ java.lang.NoClassDefFoundError:com/ctc/wstx/io/InputBootstrap,参考 Hadoop(4-1)")解决。

Exception in thread “main” java.net.ConnectException: Call From hadoop01/192.168.30.134 to localhost:9000 failed on connection exception: java.net.ConnectException: Connection refused; 参考 Hadoop(4-2)")解决。

log4j:WARN No appenders could be found for logger (org.apache.hadoop.util.Shell). ,参考 Hadoop(4-3)") 解决。

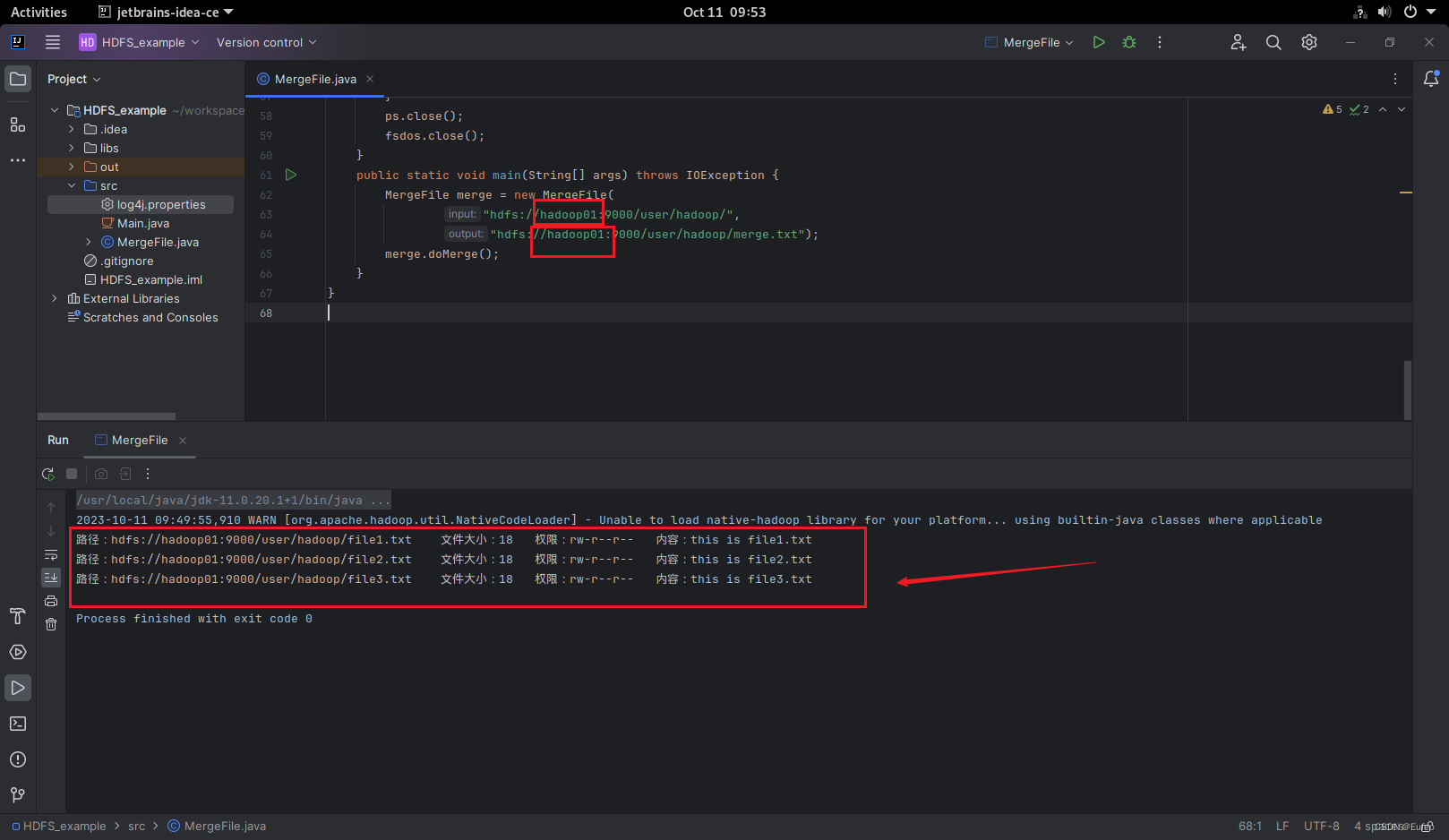

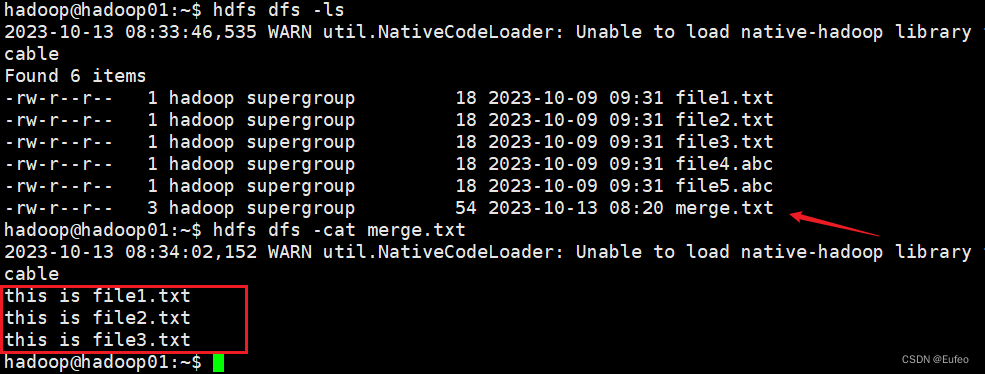

如果程序运行成功,这时,可以到HDFS中查看生成的merge.txt文件,比如,可以在Linux终端中执行如下命令:

hdfs dfs -ls

hdfs dfs -cat merge.txt

可以看到merge.txt中的如下结果:

可以看到merge.txt中的如下结果:

this is file1.txt

this is file2.txt

this is file3.txt

五. Java应用程序的部署

下面介绍如何把Java应用程序生成JAR包,部署到Hadoop平台上运行。首先,在Hadoop安装目录下新建一个名称为myapp的目录,用来存放我们自己编写的Hadoop应用程序,可以在Linux的终端中执行如下命令:

cd /usr/local/hadoop-3.3.6/

mkdir myapp

5.1 使用IDEA自带的打包工具打包JAR

在IDEA工作界面左侧的“Package Explorer”面板中,在工程名称“HDFS_example”上点击鼠标右键,在弹出的菜单中选择“Open Module Setting”,如下图所示。

为了做好运维面试路上的助攻手,特整理了上百道 【运维技术栈面试题集锦】 ,让你面试不慌心不跳,高薪offer怀里抱!

这次整理的面试题,小到shell、MySQL,大到K8s等云原生技术栈,不仅适合运维新人入行面试需要,还适用于想提升进阶跳槽加薪的运维朋友。

本份面试集锦涵盖了

- 174 道运维工程师面试题

- 128道k8s面试题

- 108道shell脚本面试题

- 200道Linux面试题

- 51道docker面试题

- 35道Jenkis面试题

- 78道MongoDB面试题

- 17道ansible面试题

- 60道dubbo面试题

- 53道kafka面试

- 18道mysql面试题

- 40道nginx面试题

- 77道redis面试题

- 28道zookeeper

总计 1000+ 道面试题, 内容 又全含金量又高

- 174道运维工程师面试题

1、什么是运维?

2、在工作中,运维人员经常需要跟运营人员打交道,请问运营人员是做什么工作的?

3、现在给你三百台服务器,你怎么对他们进行管理?

4、简述raid0 raid1raid5二种工作模式的工作原理及特点

5、LVS、Nginx、HAproxy有什么区别?工作中你怎么选择?

6、Squid、Varinsh和Nginx有什么区别,工作中你怎么选择?

7、Tomcat和Resin有什么区别,工作中你怎么选择?

8、什么是中间件?什么是jdk?

9、讲述一下Tomcat8005、8009、8080三个端口的含义?

10、什么叫CDN?

11、什么叫网站灰度发布?

12、简述DNS进行域名解析的过程?

13、RabbitMQ是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

**

- 53道kafka面试

- 18道mysql面试题

- 40道nginx面试题

- 77道redis面试题

- 28道zookeeper

总计 1000+ 道面试题, 内容 又全含金量又高

- 174道运维工程师面试题

1、什么是运维?

2、在工作中,运维人员经常需要跟运营人员打交道,请问运营人员是做什么工作的?

3、现在给你三百台服务器,你怎么对他们进行管理?

4、简述raid0 raid1raid5二种工作模式的工作原理及特点

5、LVS、Nginx、HAproxy有什么区别?工作中你怎么选择?

6、Squid、Varinsh和Nginx有什么区别,工作中你怎么选择?

7、Tomcat和Resin有什么区别,工作中你怎么选择?

8、什么是中间件?什么是jdk?

9、讲述一下Tomcat8005、8009、8080三个端口的含义?

10、什么叫CDN?

11、什么叫网站灰度发布?

12、简述DNS进行域名解析的过程?

13、RabbitMQ是什么东西?

14、讲一下Keepalived的工作原理?

15、讲述一下LVS三种模式的工作过程?

16、mysql的innodb如何定位锁问题,mysql如何减少主从复制延迟?

17、如何重置mysql root密码?

1866

1866

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?