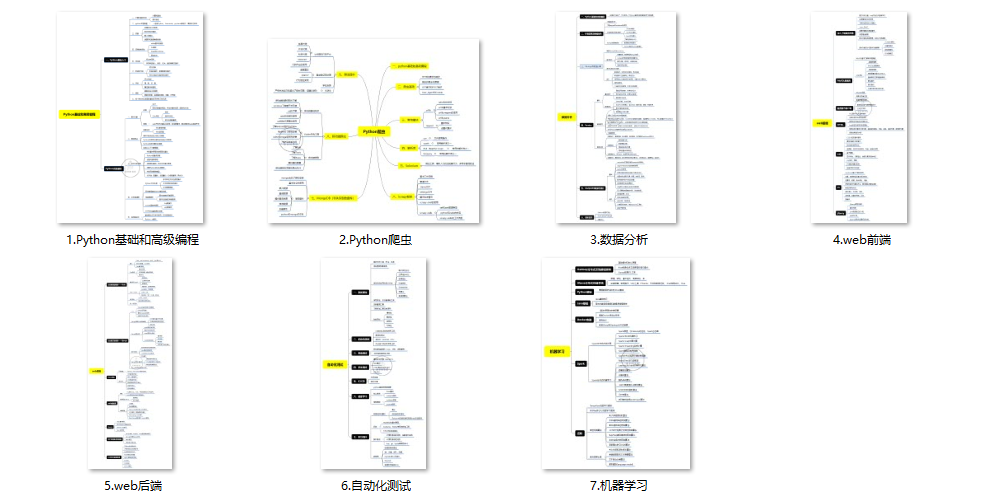

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1.发送请求,获取响应

def send_request(self,page):

print(“===正在抓取第{}页=”.format(page))

目标网页,添加headers参数

base_url = ‘https://www.kuaidaili.com/free/inha/{}/’.format(page)

headers = {‘User-Agent’: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36’}

发送请求:模拟浏览器发送请求,获取响应数据

response = requests.get(base_url,headers=headers)

data = response.content.decode()

time.sleep(1)

return data

这会就有小伙伴不明白了,你headers什么意思啊?

-

防止服务器把我们认出来是爬虫,所以模拟浏览器头部信息,向服务器发送消息

-

这个 “装” 肯定必须是要装的!!!

解析数据,将数据分组

从下图可以看出,我们需要的数据都在tr标签中:

所以分组取到tr标签下:

2.解析数据

def parse_data(self,data):

数据转换

html_data = etree.HTML(data)

分组数据

parse_list = html_data.xpath(‘//table[@class=“table table-bordered table-striped”]/tbody/tr’)

return parse_list

提取分组中我们需要的数据,IP,类型和端口号

parse_list = self.parse_data(data)

for tr in parse_list:

proxies_dict = {}

http_type = tr.xpath(‘./td[4]/text()’)

ip_num = tr.xpath(‘./td[1]/text()’)

port_num = tr.xpath(‘./td[2]/text()’)

http_type = ’ '.join(http_type)

ip_num = ’ '.join(ip_num)

port_num = ’ '.join(port_num)

proxies_dict[http_type] = ip_num + “:” + port_num

proxies_list.append(proxies_dict)

这里做了拼接,{'HTTP': '36.111.187.154:8888'}这种形式存入列表,方便我们使用!

检测IP的可用性,因为是免费的IP所以有一些可能用不了,有一些访问速度较慢,这里我们让拼接好的ip去访问某度

0.1秒能访问成功的保存在另一个列表中!

def check_ip(self,proxies_list):

headers = {‘User-Agent’: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36’}

can_use = []

for proxies in proxies_list:

try:

response = requests.get(‘https://www.baidu.com/’,headers=headers,proxies=proxies,timeout=0.1)

if response.status_code == 200:

can_use.append(proxies)

except Exception as e:

print(e)

return can_use

将访问速度不错的ip保存在文件中,方便我们调用

def save(self,can_use):

file = open(‘IP.txt’, ‘w’)

for i in range(len(can_use)):

s = str(can_use[i])+ ‘\n’

file.write(s)

file.close()

import requests

from lxml import etree

import time

class daili:

1.发送请求,获取响应

def send_request(self,page):

print(“===正在抓取第{}页=”.format(page))

目标网页,添加headers参数

base_url = ‘https://www.kuaidaili.com/free/inha/{}/’.format(page)

headers = {‘User-Agent’: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36’}

发送请求:模拟浏览器发送请求,获取响应数据

response = requests.get(base_url,headers=headers)

data = response.content.decode()

time.sleep(1)

return data

2.解析数据

def parse_data(self,data):

数据转换

html_data = etree.HTML(data)

分组数据

parse_list = html_data.xpath(‘//table[@class=“table table-bordered table-striped”]/tbody/tr’)

return parse_list

4.检测代理IP

def check_ip(self,proxies_list):

headers = {‘User-Agent’: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36’}

can_use = []

for proxies in proxies_list:

try:

response = requests.get(‘https://www.baidu.com/’,headers=headers,proxies=proxies,timeout=0.1)

if response.status_code == 200:

can_use.append(proxies)

except Exception as e:

print(e)

return can_use

5.保存到文件

def save(self,can_use):

file = open(‘IP.txt’, ‘w’)

for i in range(len(can_use)):

s = str(can_use[i])+ ‘\n’

file.write(s)

file.close()

实现主要逻辑

def run(self):

proxies_list = []

实现翻页,我这里只爬取了四页(可以修改5所在的数字)

for page in range(1,5):

data = self.send_request(page)

parse_list = self.parse_data(data)

3.获取数据

for tr in parse_list:

proxies_dict = {}

http_type = tr.xpath(‘./td[4]/text()’)

ip_num = tr.xpath(‘./td[1]/text()’)

port_num = tr.xpath(‘./td[2]/text()’)

http_type = ’ '.join(http_type)

ip_num = ’ '.join(ip_num)

port_num = ’ '.join(port_num)

proxies_dict[http_type] = ip_num + “:” + port_num

proxies_list.append(proxies_dict)

print(“获取到的代理IP数量:”,len(proxies_list))

最后

🍅 硬核资料:关注即可领取PPT模板、简历模板、行业经典书籍PDF。

🍅 技术互助:技术群大佬指点迷津,你的问题可能不是问题,求资源在群里喊一声。

🍅 面试题库:由技术群里的小伙伴们共同投稿,热乎的大厂面试真题,持续更新中。

🍅 知识体系:含编程语言、算法、大数据生态圈组件(Mysql、Hive、Spark、Flink)、数据仓库、Python、前端等等。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?