数据爬取:

最近几天朋友圈被大家的旅行足迹刷屏了,惊叹于那些把全国所有省基本走遍的朋友。与此同时,也萌生了写一篇旅行相关的内容,本次数据来源于一个对于爬虫十分友好的旅行攻略类网站:蚂蜂窝

PART1:获得城市编号

蚂蜂窝中的所有城市、景点以及其他的一些信息都有一个专属的5位数字编号,我们第一步要做的就是获取城市(直辖市+地级市)的编号,进行后续的进一步分析。

以上两个页面就是我们的城市编码来源,需要首先从目的地页面获得各省编码,之后进入各省城市列表获得编码。过程中需要Selenium进行动态数据爬取,部分代码如下:

def find_cat_url(url):

headers = {‘User-Agent’:‘Mozilla/5.0 (Windows NT 6.1; WOW64; rv:23.0) Gecko/20100101 Firefox/23.0’}

req=request.Request(url,headers=headers)

html=urlopen(req)

bsObj=BeautifulSoup(html.read(),“html.parser”)

bs = bsObj.find(‘div’,attrs={‘class’:‘hot-list clearfix’}).find_all(‘dt’)

cat_url = []

cat_name = []

for i in range(0,len(bs)):

for j in range(0,len(bs[i].find_all(‘a’))):

cat_url.append(bs[i].find_all(‘a’)[j].attrs[‘href’])

cat_name.append(bs[i].find_all(‘a’)[j].text)

cat_url = [‘http://www.mafengwo.cn’+cat_url[i] for i in range(0,len(cat_url))]

return cat_url

def find_city_url(url_list):

city_name_list = []

city_url_list = []

for i in range(0,len(url_list)):

driver = webdriver.Chrome()

driver.maximize_window()

url = url_list[i].replace(‘travel-scenic-spot/mafengwo’,‘mdd/citylist’)

driver.get(url)

while True:

try:

time.sleep(2)

bs = BeautifulSoup(driver.page_source,‘html.parser’)

url_set = bs.find_all(‘a’,attrs={‘data-type’:‘目的地’})

city_name_list = city_name_list +[url_set[i].text.replace(‘\n’,‘’).split()[0] for i in range(0,len(url_set))]

city_url_list = city_url_list+[url_set[i].attrs[‘data-id’] for i in range(0,len(url_set))]

js=“var q=document.documentElement.scrollTop=800”

driver.execute_script(js)

time.sleep(2)

driver.find_element_by_class_name(‘pg-next’).click()

except:

break

driver.close()

return city_name_list,city_url_list

url = ‘http://www.mafengwo.cn/mdd/’

url_list = find_cat_url(url)

city_name_list,city_url_list=find_city_url(url_list)

city = pd.DataFrame({‘city’:city_name_list,‘id’:city_url_list})

PART2:获得城市信息

城市数据分别从以下几个页面获取:

(a)小吃页面

(b)景点页面

(c)标签页面

我们将每个城市获取数据的过程封装成函数,每次传入之前获得的城市编码,部分代码如下:

def get_city_info(city_name,city_code):

this_city_base = get_city_base(city_name,city_code)

this_city_jd = get_city_jd(city_name,city_code)

this_city_jd[‘city_name’] = city_name

this_city_jd[‘total_city_yj’] = this_city_base[‘total_city_yj’]

try:

this_city_food = get_city_food(city_name,city_code)

this_city_food[‘city_name’] = city_name

this_city_food[‘total_city_yj’] = this_city_base[‘total_city_yj’]

except:

this_city_food=pd.DataFrame()

return this_city_base,this_city_food,this_city_jd

def get_city_base(city_name,city_code):

url = ‘http://www.mafengwo.cn/xc/’+str(city_code)+‘/’

bsObj = get_static_url_content(url)

node = bsObj.find(‘div’,{‘class’:‘m-tags’}).find(‘div’,{‘class’:‘bd’}).find_all(‘a’)

tag = [node[i].text.split()[0] for i in range(0,len(node))]

tag_node = bsObj.find(‘div’,{‘class’:‘m-tags’}).find(‘div’,{‘class’:‘bd’}).find_all(‘em’)

tag_count = [int(k.text) for k in tag_node]

par = [k.attrs[‘href’][1:3] for k in node]

tag_all_count = sum([int(tag_count[i]) for i in range(0,len(tag_count))])

tag_jd_count = sum([int(tag_count[i]) for i in range(0,len(tag_count)) if par[i]==‘jd’])

tag_cy_count = sum([int(tag_count[i]) for i in range(0,len(tag_count)) if par[i]==‘cy’])

tag_gw_yl_count = sum([int(tag_count[i]) for i in range(0,len(tag_count)) if par[i] in [‘gw’,‘yl’]])

url = ‘http://www.mafengwo.cn/yj/’+str(city_code)+'/2-0-1.html ’

bsObj = get_static_url_content(url)

total_city_yj = int(bsObj.find(‘span’,{‘class’:‘count’}).find_all(‘span’)[1].text)

return {‘city_name’:city_name,‘tag_all_count’:tag_all_count,‘tag_jd_count’:tag_jd_count,

‘tag_cy_count’:tag_cy_count,‘tag_gw_yl_count’:tag_gw_yl_count,

‘total_city_yj’:total_city_yj}

def get_city_food(city_name,city_code):

url = ‘http://www.mafengwo.cn/cy/’+str(city_code)+‘/gonglve.html’

bsObj = get_static_url_content(url)

food=[k.text for k in bsObj.find(‘ol’,{‘class’:‘list-rank’}).find_all(‘h3’)]

food_count=[int(k.text) for k in bsObj.find(‘ol’,{‘class’:‘list-rank’}).find_all(‘span’,{‘class’:‘trend’})]

return pd.DataFrame({‘food’:food[0:len(food_count)],‘food_count’:food_count})

def get_city_jd(city_name,city_code):

url = ‘http://www.mafengwo.cn/jd/’+str(city_code)+‘/gonglve.html’

bsObj = get_static_url_content(url)

node=bsObj.find(‘div’,{‘class’:‘row-top5’}).find_all(‘h3’)

jd = [k.text.split(‘\n’)[2] for k in node]

node=bsObj.find_all(‘span’,{‘class’:‘rev-total’})

jd_count=[int(k.text.replace(’ 条点评’,‘’)) for k in node]

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

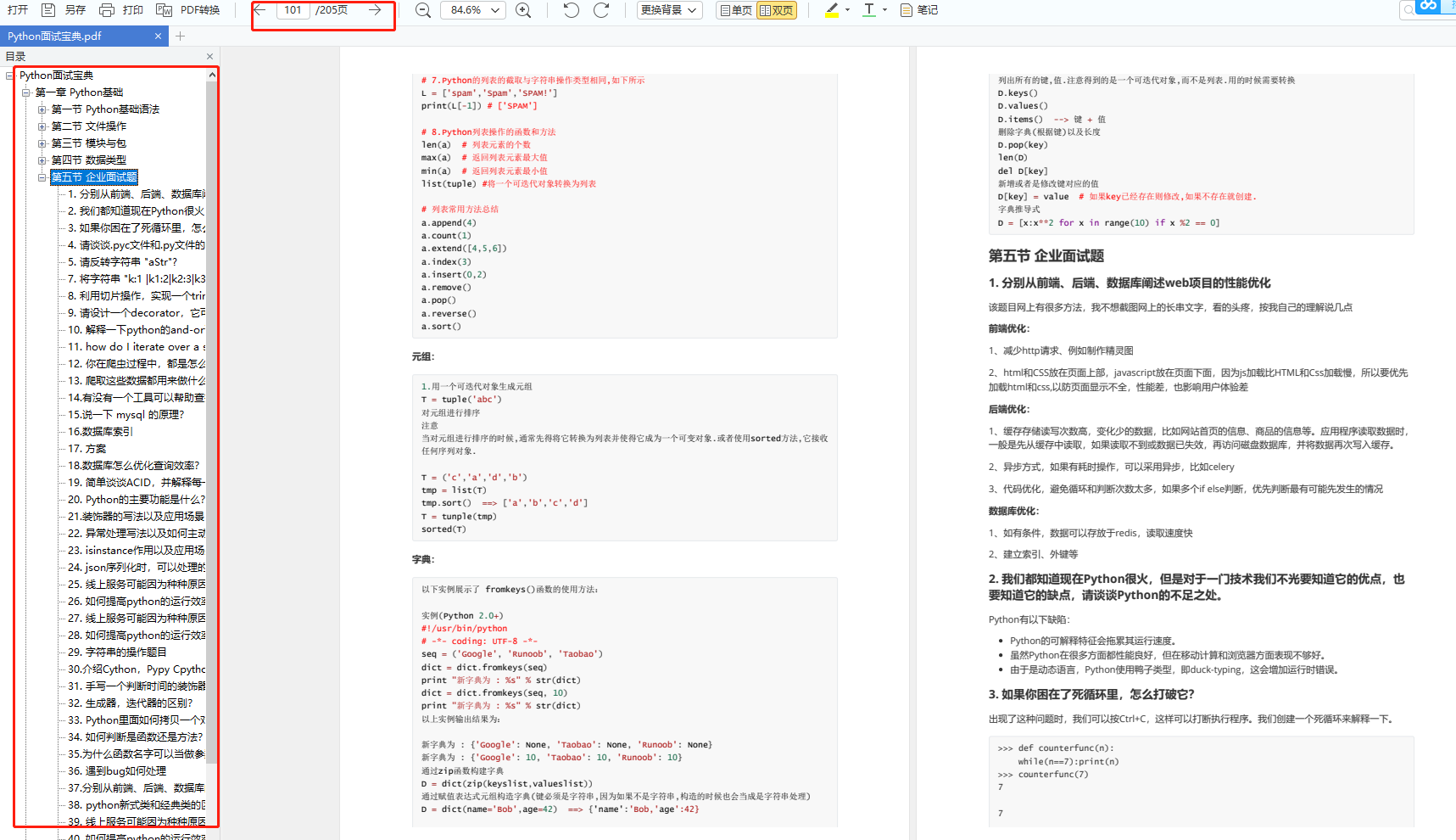

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

五、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?