先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Python全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Python知识点,真正体系化!

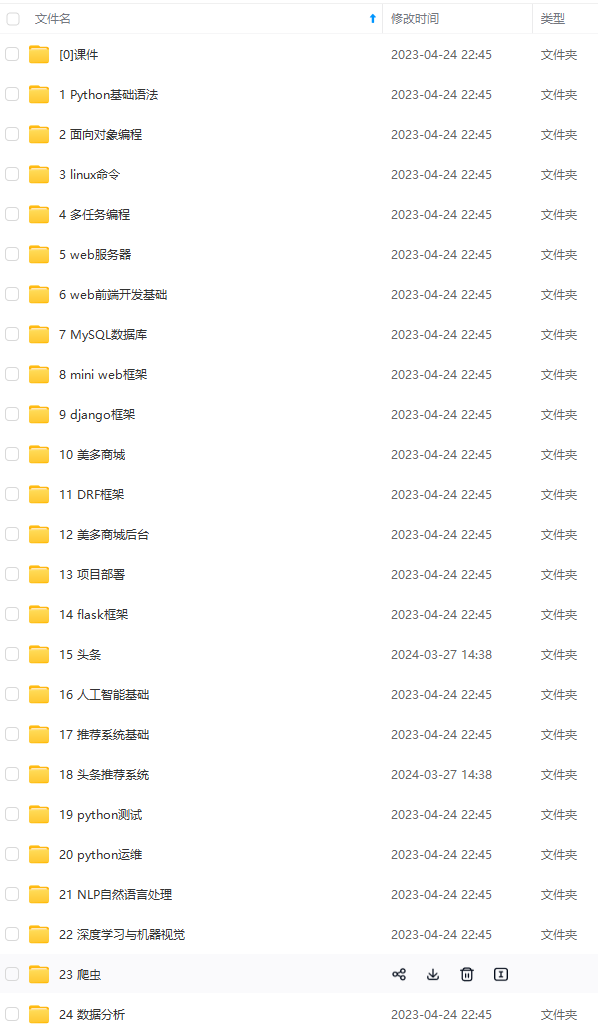

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024c (备注Python)

正文

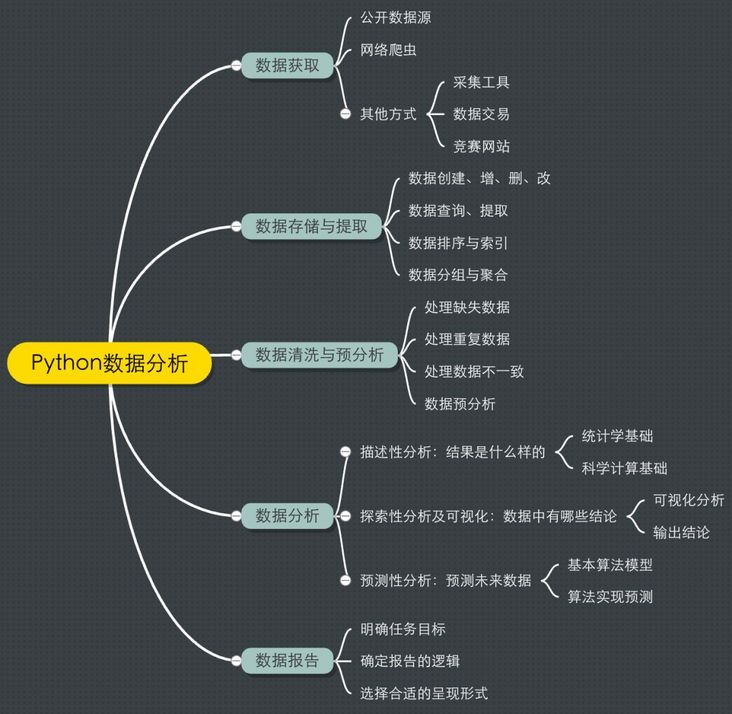

一般大致可以按“数据获取-数据存储与提取-数据预处理-数据建模与分析-数据报告”这样的步骤来实施一个数据分析项目。

按照这个流程,每个部分需要掌握的细分知识点如下:

高效的学习路径是什么?就是按这样的顺序循序渐进,你会知道每个部分需要完成的目标是什么,需要学习哪些知识点,哪些知识是暂时不必要的。

然后每学习一个部分,你就能够有一些实际的成果输出,有正向的反馈和成就感,你才会愿意花更多的时间投入进去。以解决问题为目标,效率自然不会低。

接下来我们分别从每一个部分展开,讲讲具体应该学什么、怎么学,以及各个部分主要的知识点进行结构化地展示,并有针对性地推荐学习资源。Python学习扣QUN:⑧⑤⑤-④零⑧-⑧⑨③从零基础开始到Python各领域的项目实战教程、开发工具与电子书籍。与你分享企业当下对于python人才需求及学好python的高效技巧,不停更新最新教程!

如何获取数据

我们分析的数据一般有内部数据和外部数据两种。

内部数据是在我们的业务运转中产生,比如常见的用户数据、产品数据、销售数据、内容数据等等。

内部的数据相对来说更加完善、规整,我们经常要做的工作汇报、产品优化等分析数据一般来源于此。

可以找公司的技术人员索要,或者自己去数据库提取。

当然,很多时候,我们需要利用外部的数据。

比如进行市场调研,竞品分析,或者输出报告的时候,外部数据的分析是必不可少的,这也可以帮助我们得出更多的结论。

1. 公开数据源

UCI:加州大学欧文分校开放的经典数据集,真的很经典,被很多机器学习实验室采用。

http://archive.ics.uci.edu/ml…

国家数据:数据来源于中国国家统计局,包含了我国经济民生等多个方面的数据。

http://data.stats.gov.cn/inde…

CEIC:超过128个国家的经济数据,能够精确查找GDP、CPI、进出口以及国际利率等深度数据。

https://www.ceicdata.com/zh-hans

中国统计信息网:国家统计局的官方网站,汇集了海量的全国各级政府各年度的国民经济和社会发展统计信息。

http://www.tjcn.org/

政务数据网站:现在各个省都在很大程度上地开放政务数据,比如北京、上海、广东、贵州等等,都有专门的数据开放网站,搜索比如“北京政务数据开放”。

2. 网络爬虫

基于互联网爬取的数据,你可以对某个行业、某种人群进行分析。比如:

职位数据:拉勾、猎聘、51job、智联

金融数据:IT桔子、雪球网

房产数据:链家、安居客、58同城

零售数据:淘宝、京东、亚马逊

社交数据、微博、知乎、Twitter

影视数据:豆瓣、时光网、猫眼

……

在爬虫之前你需要先了解一些 Python 的基础知识:元素(列表、字典、元组等)、变量、循环、函数(菜鸟教程就很好)……

以及如何用成熟的 **Python 库(urllib、BeautifulSoup、requests、scrapy)实现网页爬虫。

掌握基础的爬虫之后,你还需要一些高级技巧。

比如正则表达式、模拟用户登录、使用代理、设置爬取频率、使用cookie等等,来应对不同网站的反爬虫限制。

爬虫可以说是最为灵活、有效的数据获取方式,但学习成本相对来说也要高一些。

开始建议先利用公开数据进行分析,后续有更多的数据需求,再上手爬虫。

那个时候你已经掌握了Python基础,爬虫上手也会更轻松。

3. 其他数据获取方式

如果你暂时不会爬虫,但又有采集数据的需求,可以尝试各种采集软件,不需要编程知识也可以轻松爬取信息,比如火车头、八爪鱼等。

很多数据竞赛网站也会公开不错的数据集,比如国外的Kaggle,国内的DataCastle、天池。

这些数据都是真实的业务数据,且规模通常不小,可以经常去搜集和整理。

数据存储与提取

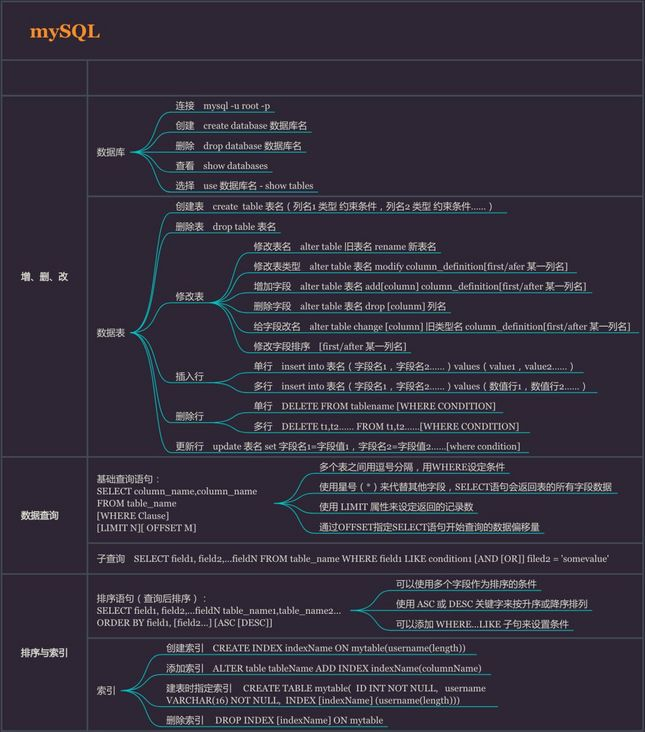

数据库这个技能放在这里,是因为这是数据分析师的必备技能。

大多数的企业,都会要求你有操作、管理数据库的基本技能,进行数据的提取和基本分析。

SQL作为最经典的关系型数据库语言,为海量数据的存储与管理提供可能。

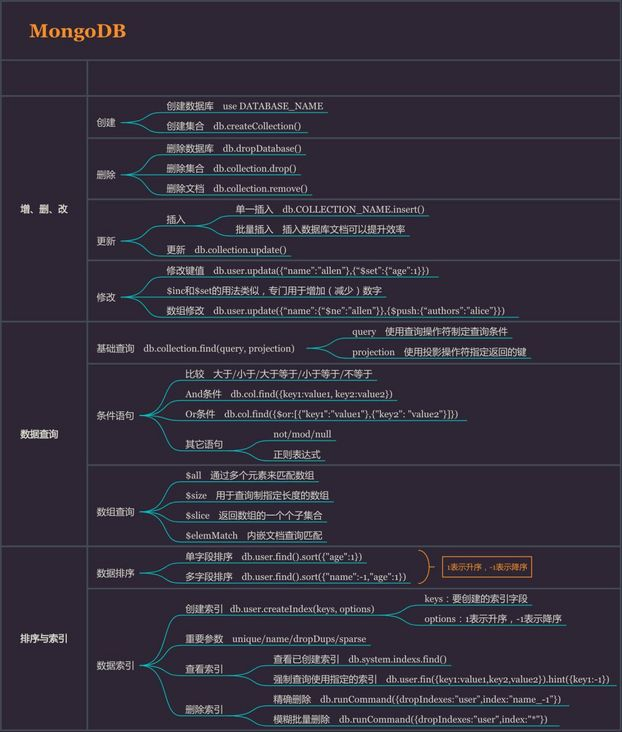

MongoDB则是新崛起的非关系型数据库,掌握一种即可。

初学建议SQL。你需要掌握以下技能:

1.查询/提取特定情况下的数据:企业数据库里的数据一定是巨量而繁复的,你需要提取你想要的那一部分。

比如你可以根据你的需要提取2017年所有的销售数据、提取今年销量最大的50件商品的数据、提取上海、广东地区用户的消费数据……

2.数据库的增、删、改:这些是数据库最基本的操作,但只要用简单的命令就能够实现。

3.数据的分组聚合、建立多个表之间的联系:这个部分是数据库的进阶操作,多个表之间的关联。

在你处理多维度、多个数据集的时候非常有用,这也让你可以去处理更复杂的数据。

数据库听起来很可怕,但其实满足数据分析的那部分技能不要太简单。

当然,还是建议你找一个数据集来实际操作一下,哪怕是最基础的查询、提取等操作。

△ mySQL知识框架

△ MongoDB知识框架

数据清洗及预分析

很多时候我们拿到的数据是不干净的,数据的重复、缺失、异常值等等。

这时候就需要进行数据的清洗,把这些影响分析的数据处理好,才能获得更加精确地分析结果。

比如空气质量的数据,其中有很多天的数据由于设备的原因是没有监测到的,有一些数据是记录重复的,还有一些数据是设备故障时监测无效的。

比如用户行为数据,有很多无效的操作对分析没有意义,就需要进行删除。

- 选择:数据访问(标签、特定值、布尔索引等)

- 缺失值处理:对缺失数据行进行删除或填充

- 重复值处理:重复值的判断与删除

- 空格和异常值处理:清楚不必要的空格和极端、异常数据

- 相关操作:描述性统计、Apply、图形绘制等

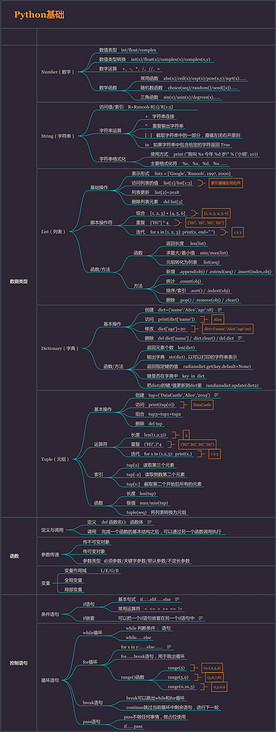

从数据处理开始,就需要介入编程知识了,但不必把Python的教程完全啃一遍,只需要掌握数据分析必备的那部分即可。

- 基本的数据类型:比如字符串、列表、字典、元组,不同的数据类型如何创建、进行增、删、改等操作,以及其中常用的函数及方法;

- Python函数:学习如何去创建自己的函数,实现更丰富的定制化程序,知道在使用中如何调用;

- 控制语句:主要是条件语句和循环语句,利用不同的语句对流程进行控制,这是实现程序的自动化的基础。

△ Python基础知识框架

另外,Python中两个非常重要的库Numpy和Pandas也是需要掌握的,我们的很多数据处理及分析方法就源于其中。

如果把Python比作是我们的房子,为我们提供基础的框架,那么Numpy和Pandas就是房子里的家具和电器,为我们入住提供各种功能。

当然,即便只是这两个库,官方文档的内容也是非常多的,建议先掌握最常用的一些方法,这样你可以解决大部分的实际问题,若后续遇到问题可以有针对性地去查询文档。

Numpy

- 数组创建:从已有的数组创建、从数值范围创建

- 数组切片:通过切片进行选择

- 数组操作:元素增删、数组维度修改、数组的分割及连接

- Numpy函数:字符串函数、数学函数、统计函数

推荐Numpy文档:

Nump快速入门 http://h5ip.cn/ypHr

Numpy中文文档 https://www.numpy.org.cn/

△ Numpy知识框架

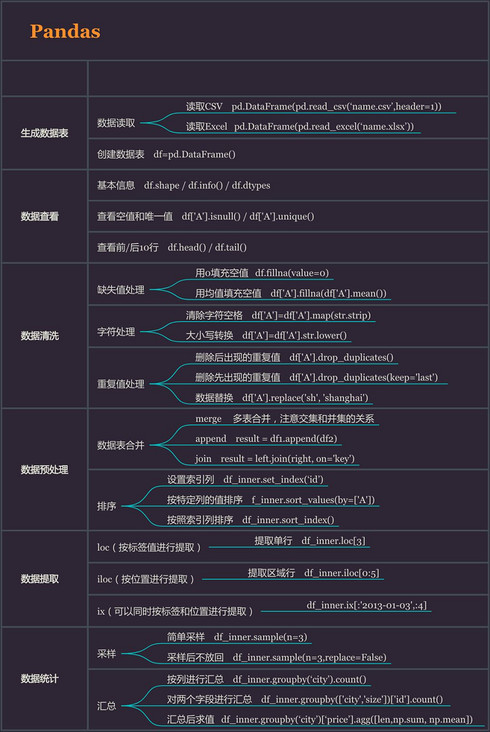

Pandas

- 数据准备:数据读取、创建数据表

- 数据查看:查看数据基本信息、查找空值和唯一值

- 数据清洗:缺失值处理、重复值处理、字符处理

- 数据提取:按标签值进行提取、按位置进行提取

- 数据统计:采样、汇总、基本的统计量计算

推荐Pandas文档:

十分钟入门Pandas* http://t.cn/EVTGis7

Pandas中文文档 https://www.pypandas.cn/

△ Pandas知识框架

数据分析及建模

如果你有一些了解的话,就知道目前市面上其实有很多 Python 数据分析的书籍,但每一本都很厚,学习阻力非常大。

如果没有整体的认识,往往不知道为什么要学习这些操作,这在数据分析中到底起什么样的作用。

为了得出普遍意义上的结论(或者从一般的数据分析项目来看),我们通常要进行三种类型的数据分析:描述性分析、探索性分析以及预测性分析。

描述性分析主要是有目的去描述数据,这就要借助统计学的知识,比如基本的统计量、总体样本、各种分布等等。

通过这些信息,我们可以获得对数据的初步感知,也能够得到很多简单观察得不到的结论。

所以其实描述性的分析主要需要两个部分的知识,其一是统计学的基础,其二是实现描述性的工具,用上述 Numpy 和 Pandas 的知识即可实现。

探索性分析通常需要借助可视化的手段,利用图形化的方式,更进一步地去观看数据的分布规律,发现数据里的知识,得到更深入的结论。

所谓“探索”,事实上有很多结论我们是无法提前预知的,图形则弥补了观察数据和简单统计的不足。

Python中的Seaborn和Matplotlib库都提供了强大的可视化功能。

相对于Matplotlib,Seaborn更加简单易于理解,画基本的图形也就是几行代码的事情,更推荐初学使用。

如后续需要定制化图形,可进一步了解Matplotlib。

预测性的数据分析主要用于预测未来的数据,比如根据历史销售数据预测未来某段时间的销售情况,比如通过用户数据预测未来用户的行为……

预测性分析稍难,越深入会涉及更多数据挖掘、机器学习的知识,所以可以只做做基本了解(或者等有需求的时候再学习)。

比如基本的回归、分类算法,以及如何用Python的scikit-learn库去实现,至于机器学习相关的算法选择、模型调优则不必深入(除非你游刃有余)。

推荐数据分析资料:

书籍《深入浅出统计学》《商务与经济统计学》

最后

🍅 硬核资料:关注即可领取PPT模板、简历模板、行业经典书籍PDF。

🍅 技术互助:技术群大佬指点迷津,你的问题可能不是问题,求资源在群里喊一声。

🍅 面试题库:由技术群里的小伙伴们共同投稿,热乎的大厂面试真题,持续更新中。

🍅 知识体系:含编程语言、算法、大数据生态圈组件(Mysql、Hive、Spark、Flink)、数据仓库、Python、前端等等。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

技术群里的小伙伴们共同投稿,热乎的大厂面试真题,持续更新中。

🍅 知识体系:含编程语言、算法、大数据生态圈组件(Mysql、Hive、Spark、Flink)、数据仓库、Python、前端等等。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

[外链图片转存中…(img-mFOgCDUo-1713613072964)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?