先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Python全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Python知识点,真正体系化!

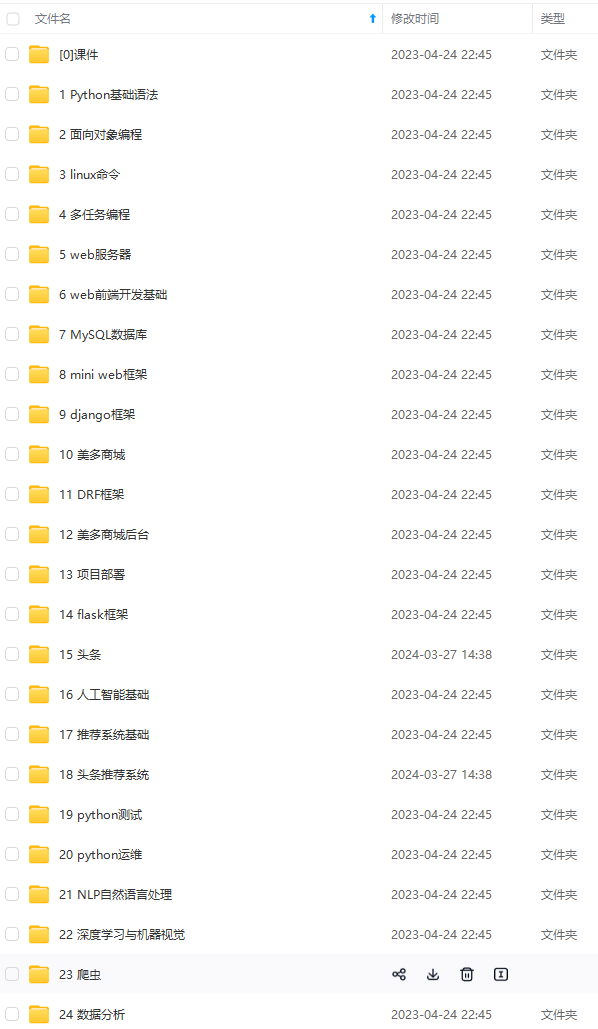

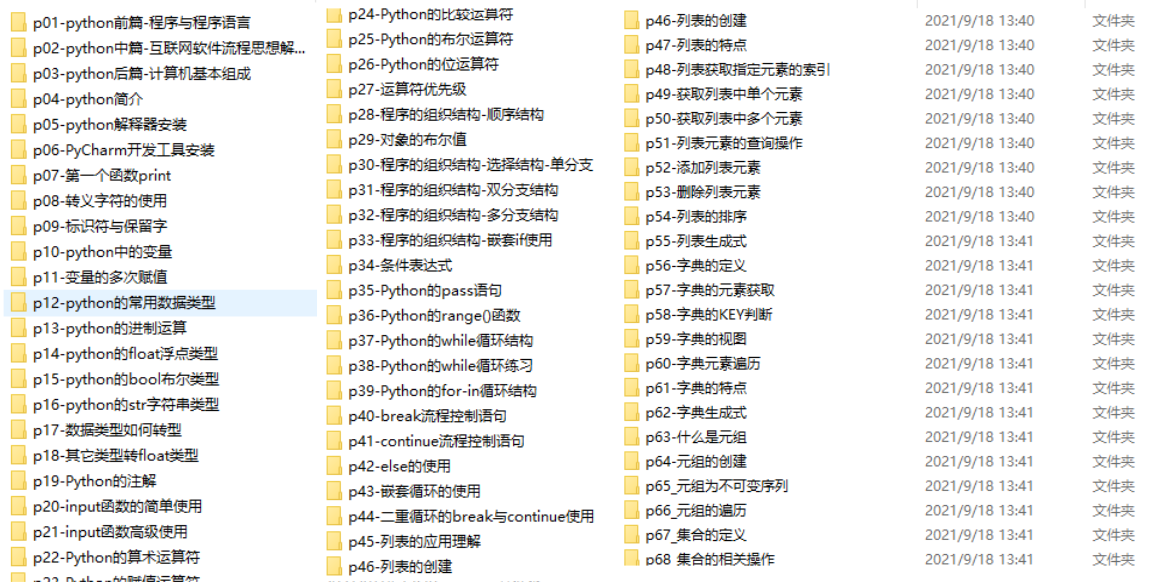

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024c (备注Python)

正文

for i in range(self.n_iterations):

…

Forward Pass

…

HIDDEN LAYER

hidden_input = X.dot(self.W) + self.w0

hidden_output = self.hidden_activation(hidden_input)

OUTPUT LAYER

output_layer_input = hidden_output.dot(self.V) + self.v0

y_pred = self.output_activation(output_layer_input)

…

Backward Pass

…

OUTPUT LAYER

Grad. w.r.t input of output layer

grad_wrt_out_l_input = self.loss.gradient(y, y_pred) * self.output_activation.gradient(output_layer_input)

grad_v = hidden_output.T.dot(grad_wrt_out_l_input)

grad_v0 = np.sum(grad_wrt_out_l_input, axis=0, keepdims=True)

HIDDEN LAYER

Grad. w.r.t input of hidden layer

grad_wrt_hidden_l_input = grad_wrt_out_l_input.dot(self.V.T) * self.hidden_activation.gradient(hidden_input)

grad_w = X.T.dot(grad_wrt_hidden_l_input)

grad_w0 = np.sum(grad_wrt_hidden_l_input, axis=0, keepdims=True)

Update weights (by gradient descent)

Move against the gradient to minimize loss

self.V -= self.learning_rate * grad_v

self.v0 -= self.learning_rate * grad_v0

self.W -= self.learning_rate * grad_w

self.w0 -= self.learning_rate * grad_w0

Use the trained model to predict labels of X

def predict(self, X):

Forward pass:

hidden_input = X.dot(self.W) + self.w0

hidden_output = self.hidden_activation(hidden_input)

output_layer_input = hidden_output.dot(self.V) + self.v0

y_pred = self.output_activation(output_layer_input)

return y_pred

def main():

data = datasets.load_digits()

X = normalize(data.data)

y = data.target

Convert the nominal y values to binary

y = to_categorical(y)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.4, seed=1)

MLP

clf = MultilayerPerceptron(n_hidden=16,

n_iterations=1000,

learning_rate=0.01)

clf.fit(X_train, y_train)

y_pred = np.argmax(clf.predict(X_test), axis=1)

y_test = np.argmax(y_test, axis=1)

accuracy = accuracy_score(y_test, y_pred)

print (“Accuracy:”, accuracy)

Reduce dimension to two using PCA and plot the results

Plot().plot_in_2d(X_test, y_pred, title=“Multilayer Perceptron”, accuracy=accuracy, legend_labels=np.unique(y))

if name == “main”:

现在能在网上找到很多很多的学习资源,有免费的也有收费的,当我拿到1套比较全的学习资源之前,我并没着急去看第1节,我而是去审视这套资源是否值得学习,有时候也会去问一些学长的意见,如果可以之后,我会对这套学习资源做1个学习计划,我的学习计划主要包括规划图和学习进度表。

分享给大家这份我薅到的免费视频资料,质量还不错,大家可以跟着学习

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注python)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

朋友,可以添加V获取:vip1024c (备注python)**

[外链图片转存中…(img-BOt4WbiW-1713329604200)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?