(安装好idea,java,scala,spark,hive,mysql)

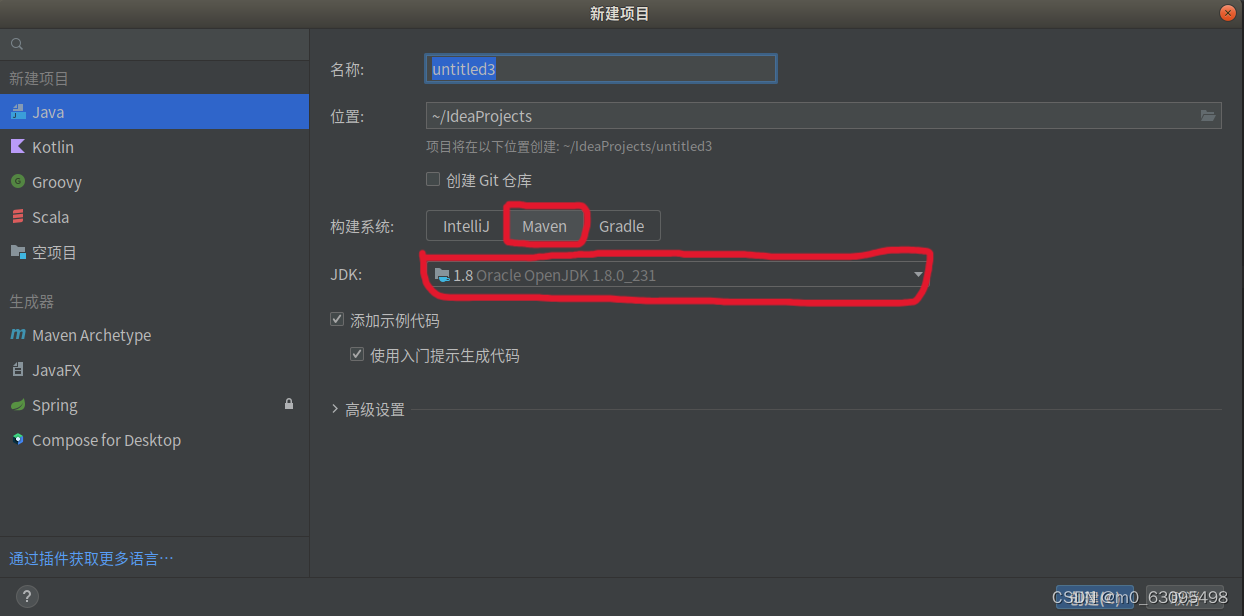

1.打开IDEA,文件->新建->项目->选择Maven

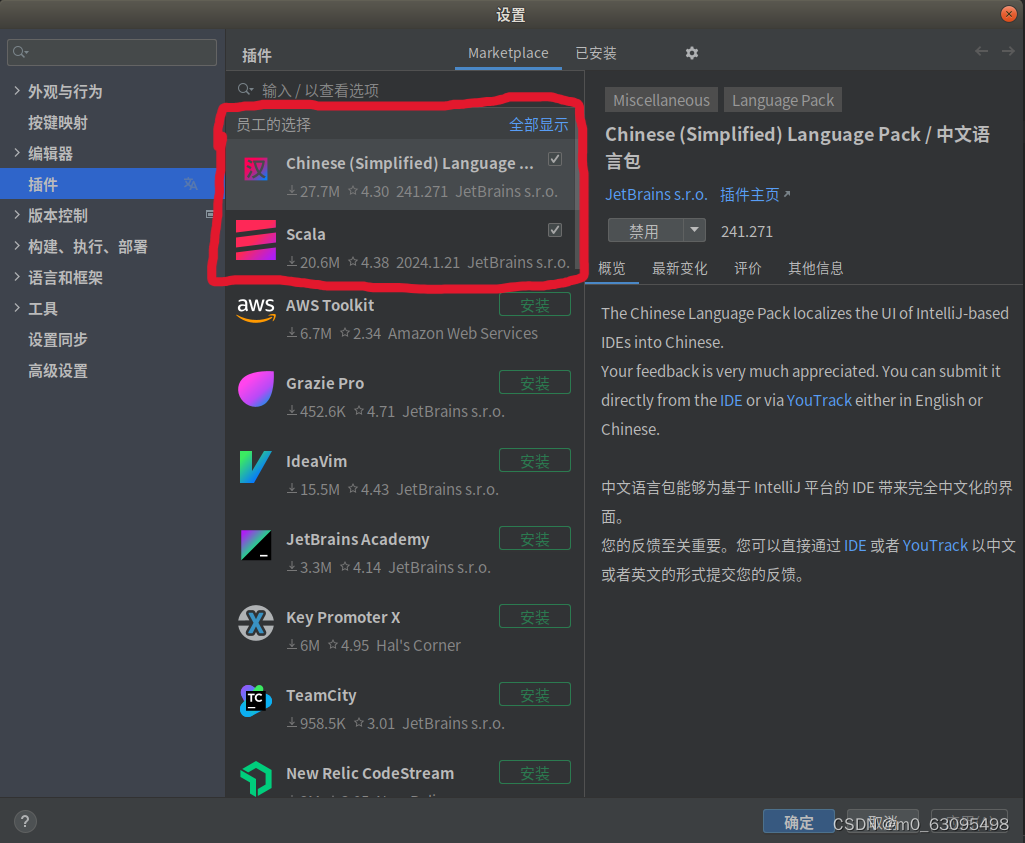

2.在IDEA中,文件->设置->插件->下载Scala插件

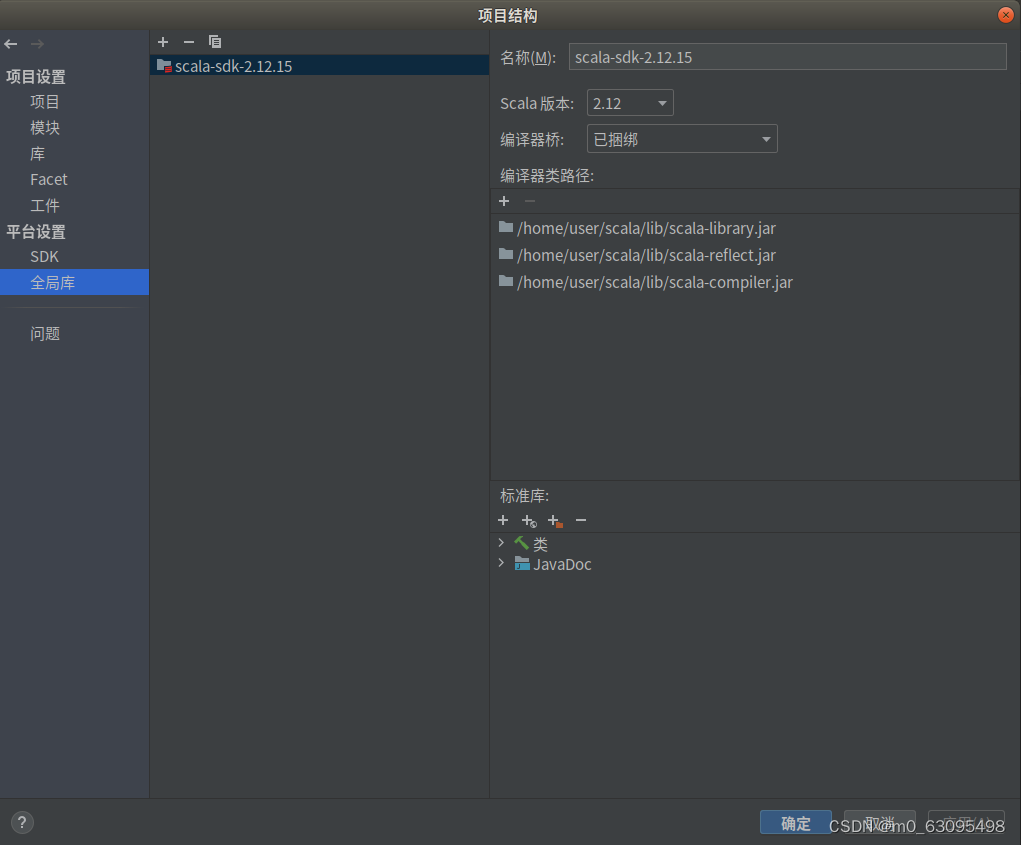

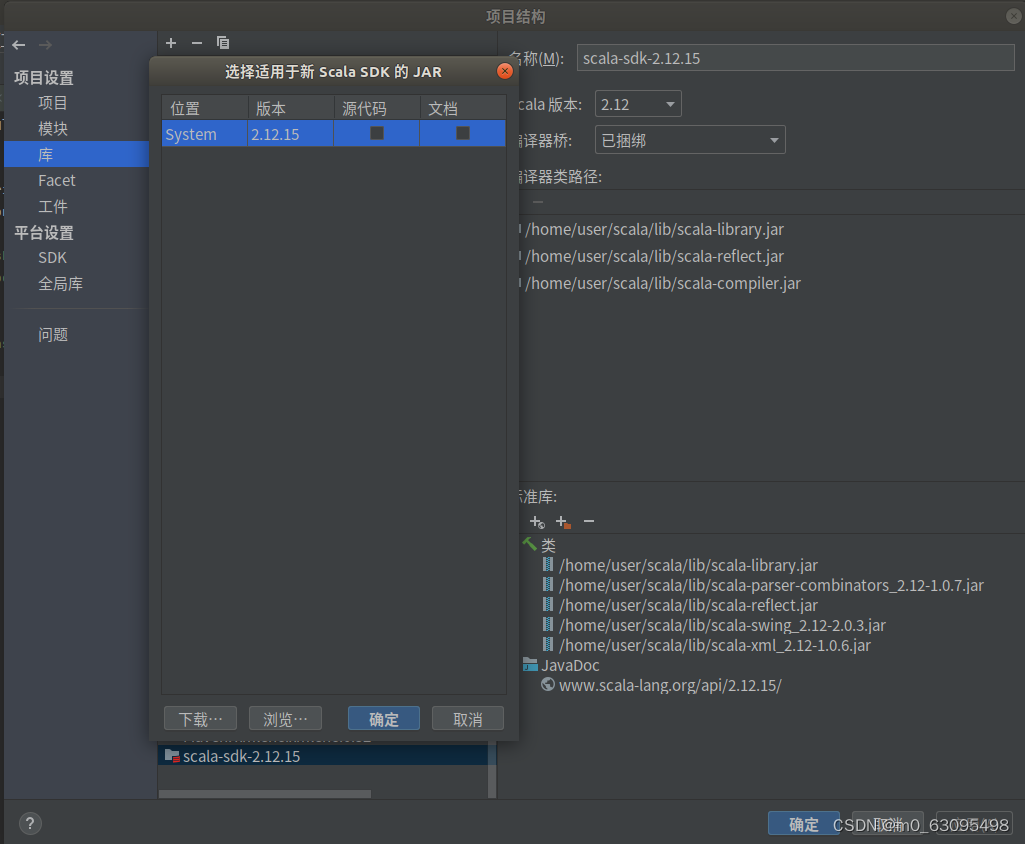

3.文件->项目结构->全局库

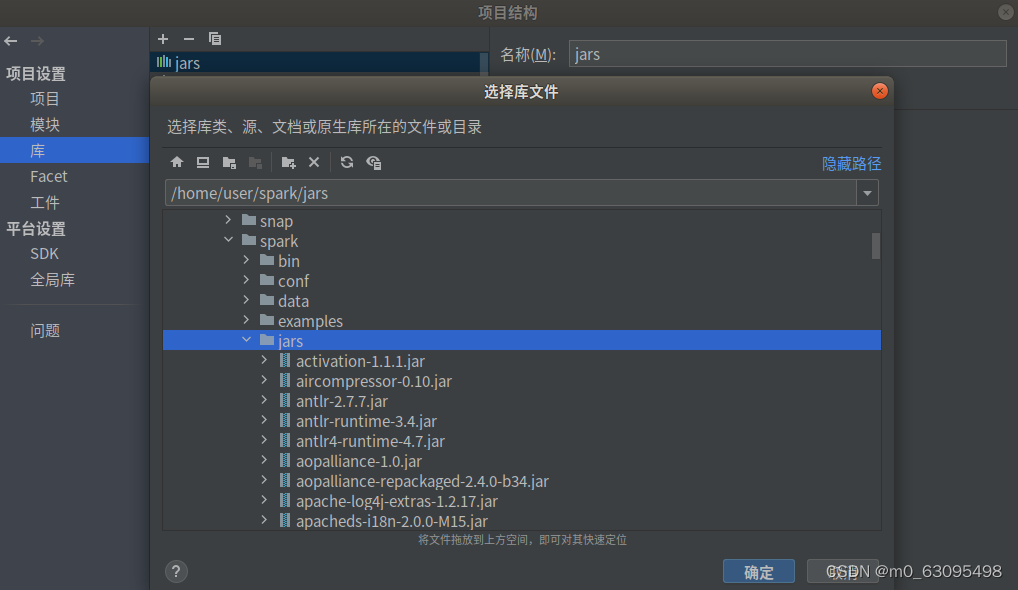

4.在项目库中导入spark安装目录jar包

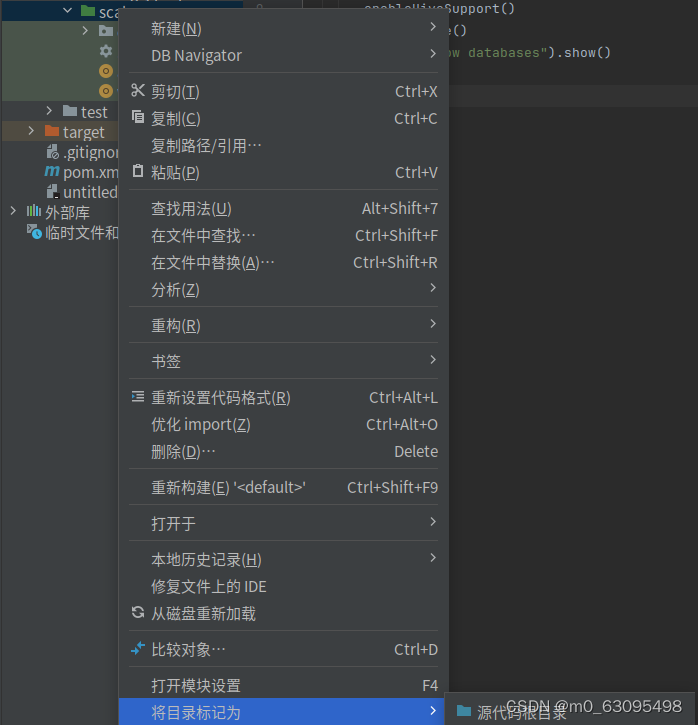

5.把main目录下的java文件夹改名为scala,并右键->将目录标记为->源代码根目录

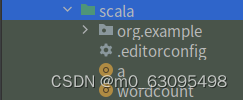

6.右键scala,新建->scala类->object->命名wordcount

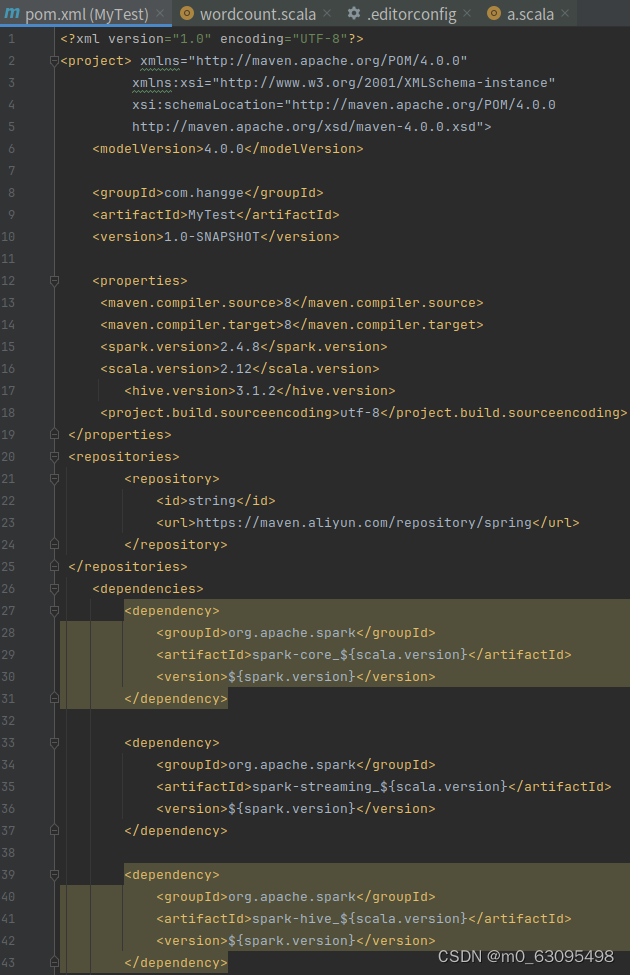

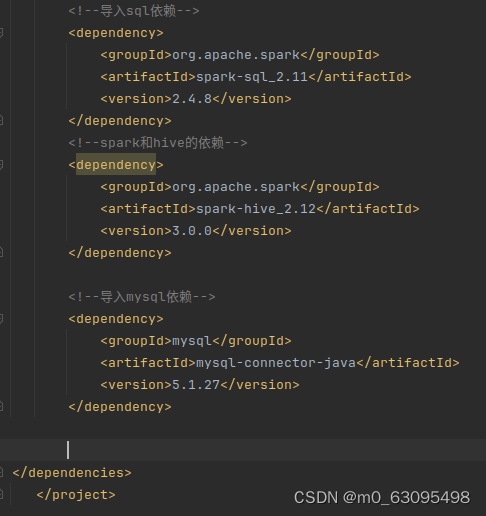

7.删除pom.xml原有内容添加以下内容:(输入自己对应的版本号)

8.点击load maven change按钮,下载依赖文件。

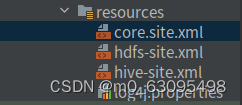

9.在resources文件夹下拷贝Hadoop配置文件下的core-site.xml和hdfs-site.xml文件以及hive配置文件下的hive-site.xml文件,并创建资源包命名为log4j.properties

10.登录mysql输入:

mysql -u root -p

grant all privileges on *.* to root@'localhost' identified by 'passwd';

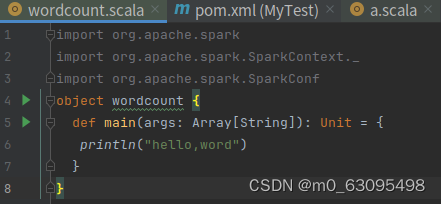

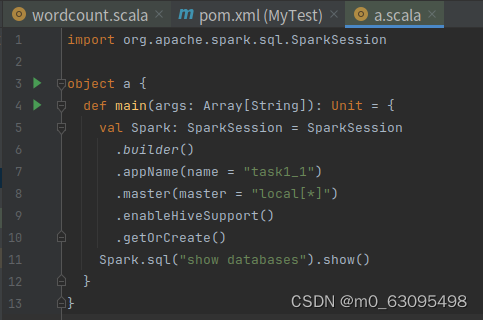

grant all privileges on *.* to root@'%' identified by 'passwd';

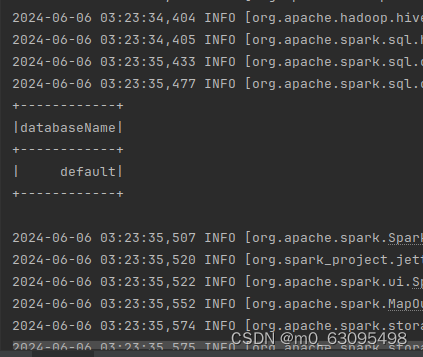

flush privileges;

select user,host from mysql.user where user='root';

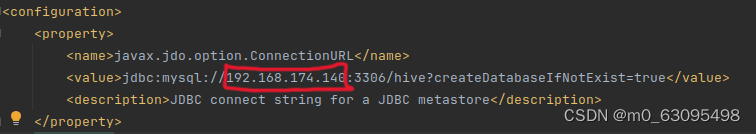

(将IP地址改为linux环境中对应的ip)

11.开启hadoop集群:start-all.sh

开启spark集群:cd /home/user/spark/sbin

./start-all.sh

12.hive开启metastore服务:hive --service metastore

13.输入代码测试spark是否导入成功

14. 输入代码测试spark是否可以访问hive数据库

1595

1595

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?