大部分爬虫都是按“发送请求——获得页面——解析页面——抽取并储存内容”这样的流程来进行,这其实也是模拟了我们使用浏览器获取网页信息的过程。

简单来说,我们向服务器发送请求后,会得到返回的页面,通过解析页面之后,我们可以抽取我们想要的那部分信息,并存储在指定的文档或数据库中。

在这部分你可以简单了解 HTTP 协议及网页基础知识,比如 POST\GET、HTML、CSS、JS,简单了解即可,不需要系统学习。

2.学习 Python 包并实现基本的爬虫过程

Python中爬虫相关的包很多:urllib、requests、bs4、scrapy、pyspider 等,建议你从requests+Xpath 开始,requests 负责连接网站,返回网页,Xpath 用于解析网页,便于抽取数据。

如果你用过 BeautifulSoup,会发现 Xpath 要省事不少,一层一层检查元素代码的工作,全都省略了。掌握之后,你会发现爬虫的基本套路都差不多,一般的静态网站根本不在话下,小猪、豆瓣、糗事百科、腾讯新闻等基本上都可以上手了。

来看一个爬取豆瓣短评的例子:

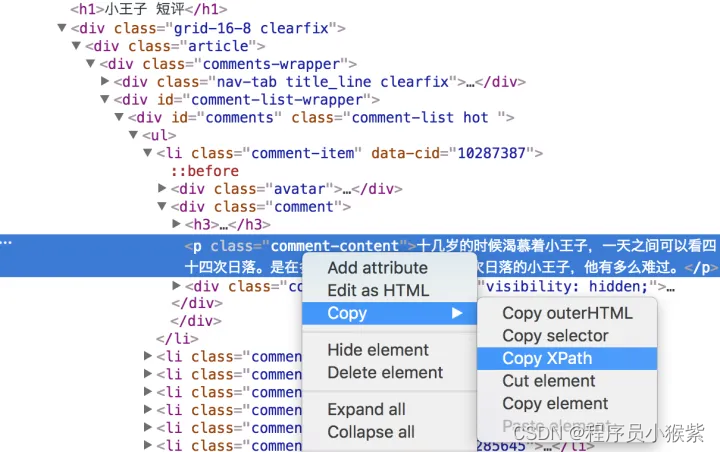

选中第一条短评,右键-“检查”,即可查看源代码

我们通过定位,得到了第一条短评的XPath信息:

//*[@id="comments"]/ul/li[1]/div[2]/p

但是通常我们会想爬取很多条短评,那么我们会想获取很多这样的XPath信息:

//*[@id="comments"]/ul/li[1]/div[2]/p

//*[@id="comments"]/ul/li[2]/div[2]/p

//*[@id="comments"]/ul/li[3]/div[2]/p

………………………………

观察1、2、2条短评的XPath信息,你会发现规律,只有

- 后面的序号不一样,恰好与短评的序号相对应。那如果我们想爬取这个页面所有的短评信息,那么不要这个序号就好了呀。

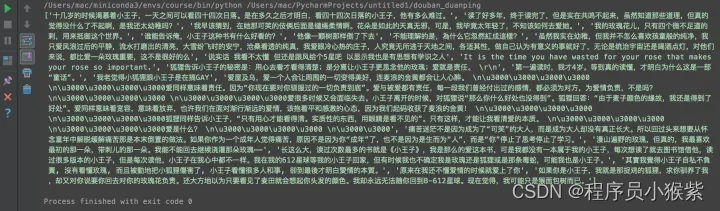

- 通过XPath信息,我们就可以用简单的代码将其爬取下来了:

import requests

from lxml import etree

#我们邀抓取的页面链接

url='https://book.douban.com/subject/1084336/comments/'

#用requests库的get方法下载网页

r=requests.get(url).text

#解析网页并且定位短评

s=etree.HTML(r)

file=s.xpath('//*[@id="comments"]/ul/li/div[2]/p/text()')

#打印抓取的信息

print(file)

爬取的该页面所有的短评信息

当然如果你需要爬取异步加载的网站,可以学习浏览器抓包分析真实请求或者学习Selenium来实现自动化,这样,知乎、时光网、猫途鹰这些动态的网站也基本没问题了。

这个过程中你还需要了解一些Python的基础知识:

文件读写操作:用来读取参数、保存爬下来的内容

list(列表)、dict(字典):用来序列化爬取的数据

条件判断(if/else):解决爬虫中的判断是否执行

循环和迭代(for ……while):用来循环爬虫步骤

3.了解非结构化数据的存储

爬回来的数据可以直接用文档形式存在本地,也可以存入数据库中。

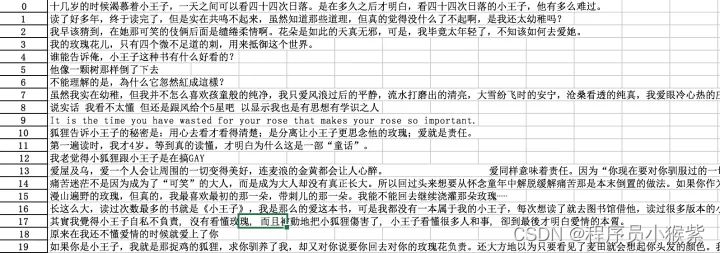

开始数据量不大的时候,你可以直接通过 Python 的语法或 pandas 的方法将数据存为text、csv这样的文件。还是延续上面的例子:

用Python的基础语言实现存储:

with open('pinglun.text','w',encoding='utf-8') as f:

for i in file:

print(i)

f.write(i)

用pandas的语言来存储:

#import pandas as pd

#df = pd.DataFrame(file)

#df.to_excel('pinglun.xlsx')

这两段代码都可将爬下来的短评信息存储起来,把代码贴在爬取代码后面即可。

存储的该页的短评数据

当然你可能发现爬回来的数据并不是干净的,可能会有缺失、错误等等,你还需要对数据进行清洗,可以学习 pandas 包的基本用法来做数据的预处理,得到更干净的数据。以下知识点掌握就好:

+ 缺失值处理:对缺失数据行进行删除或填充

+ 重复值处理:重复值的判断与删除

+ 空格和异常值处理:清楚不必要的空格和极端、异常数据

+ 分组:数据划分、分别执行函数、数据重组### 4.掌握各种技巧,应对特殊网站的反爬措施

爬取一个页面的的数据是没问题了,但是我们通常是想爬取多个页面啊。

这个时候就要看看在翻页的时候url是如何变化了,还是以短评的页面为例,我们来看多个页面的url有什么不同:

https://book.douban.com/subject/1084336/comments/

https://book.douban.com/subject/1084336/comments/hot?p=2

https://book.douban.com/subject/1084336/comments/hot?p=3

https://book.douban.com/subject/1084336/comments/hot?p=4

……………………

通过前四个页面,我们就能够发现规律了,不同的页面,只是在最后标记了页面的序号。我们以爬取5个页面为例,写一个循环更新页面地址就好了。

for a in range(5):

url="http://book.douban.com/subject/1084336/comments/hot?p={}".format(a)

当然,爬虫过程中也会经历一些绝望啊,比如被网站封IP、比如各种奇怪的验证码、userAgent访问限制、各种动态加载等等。

遇到这些反爬虫的手段,当然还需要一些高级的技巧来应对,常规的比如访问频率控制、使用代理IP池、抓包、验证码的OCR处理等等。

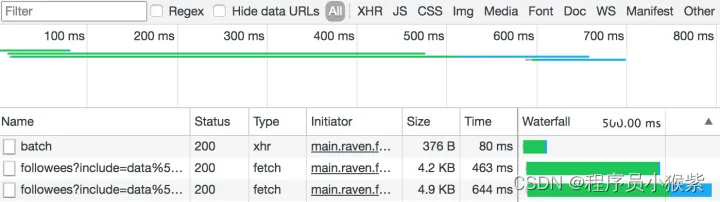

比如我们经常发现有的网站翻页后url并不变化,这通常就是异步加载。我们用开发者工具取分析网页加载信息,通常能够得到意外的收获。

通过开发者工具分析加载的信息

比如很多时候如果我们发现网页不能通过代码访问,可以尝试加入userAgent 信息。

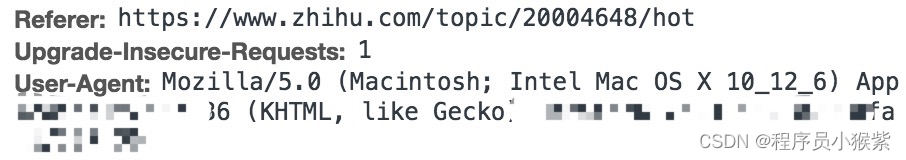

浏览器中的userAgent信息

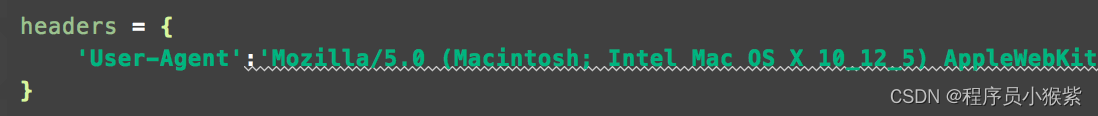

在代码中加入userAgent信息

往往网站在高效开发和反爬虫之间会偏向前者,这也为爬虫提供了空间,掌握这些应对反爬虫的技巧,绝大部分的网站已经难不到你了。

5.学习爬虫框架,搭建工程化的爬虫

掌握前面的技术一般量级的数据和代码基本没有问题了,但是在遇到非常复杂的情况,可能仍然会力不从心,这个时候,强大的 scrapy 框架就非常有用了。

scrapy 是一个功能非常强大的爬虫框架,它不仅能便捷地构建request,还有强大的 selector 能够方便地解析 response,然而它最让人惊喜的还是它超高的性能,让你可以将爬虫工程化、模块化。

学会 scrapy,你可以自己去搭建一些爬虫框架,你就基本具备爬虫工程师的思维了。

6.学习数据库基础,应对大规模数据存储

爬回来的数据量小的时候,你可以用文档的形式来存储,一旦数据量大了,这就有点行不通了。所以掌握一种数据库是必须的,学习目前比较主流的 MongoDB 就OK。

MongoDB 可以方便你去存储一些非结构化的数据,比如各种评论的文本,图片的链接等等。你也可以利用PyMongo,更方便地在Python中操作MongoDB。

因为这里要用到的数据库知识其实非常简单,主要是数据如何入库、如何进行提取,在需要的时候再学习就行。

7.分布式爬虫,实现大规模并发采集

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?