习题4-2 试设计一个前馈神经网络来解决XOR问题,要求该前馈神经网络具有两个隐藏神经元和一个输出神经元,并使用ReLU作为激活函数。

XOR问题描述:异或是对两个运算元的一种逻辑分析类型,当两两数值相同时为否,而数值不同时为真。

XOR输入为2个神经元,输出为一个神经元,此题要求隐藏神经元为2个,故需要两层全连接层。

- 数据集:输入为两位二进制,共四种情况,输出为一个二进制表示的数,要么为0,要么为1

- 网络模型:用pytorch搭建两层全连接层神经网络

- 训练:计算网络输出,计算损失函数,反向传播,参数更新

- 求权重和偏置

- 测试

模型:

import torch.nn as nn

import torch.nn.functional as F

# 异或门模块由两个全连接层构成

class XORModule(nn.Module):

def __init__(self):

super(XORModule, self).__init__()

self.fc1 = nn.Linear(2, 2)

self.fc2 = nn.Linear(2, 1)

self.relu = nn.ReLU()

def forward(self, x):

x = x.view(-1, 2)

x = self.relu((self.fc1(x)))

x = self.fc2(x)

return x

训练:

import torch

import torchvision

import torch.nn as nn

from XORModule import XORModule

import torch.optim as optim

# 输入和输出数据

input_x = torch.Tensor([[0, 0], [0, 1], [1, 0], [1, 1]])

input_x1 = input_x.float()

real_y = torch.Tensor([[0], [1], [1], [0]])

real_y1 = real_y.float()

# 设置损失函数和参数优化函数

net = XORModule()

loss_function = nn.MSELoss(reduction='mean') # 用交叉熵损失函数会出现维度错误

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9) # 用Adam优化参数选不好会出现计算值超出0-1的范围

# 进行训练

for epoch in range(10000):

out_y = net(input_x1)

loss = loss_function(out_y, real_y1) # 计算损失函数

# print('啦啦啦')

optimizer.zero_grad() # 对梯度清零,避免造成累加

loss.backward() # 反向传播

optimizer.step() # 参数更新

输出权重和偏置:

# 打印计算的权值和偏置

print('w1 = ', net.fc1.weight.detach().numpy())

print('b1 = ', net.fc1.bias.detach().numpy())

print('w2 = ', net.fc2.weight.detach().numpy())

print('b2 = ', net.fc2.bias.detach().numpy())

测试:

input_test = input_x1

out_test = net(input_test)

print('input_x', input_test.detach().numpy())

print('out_y', out_test.detach().numpy())

执行结果:

权重和偏置:

w1 = [ [ -0.67580664 0.21008837 ]

[ 0.5939609 0.2033555]]

b1 = [ -0. 42359048 0.24312215 ]

w2 = [ [-6.7291844e-01 -9.5814212e-06] ]

b2 = [0.5000076]

测试:

input_ _X [[0. 0.]

[0. 1. ]

[1. 0.]

[1. 1.]]

out_ y [[0.5000053 ]

[0.50000334]

[0.4999996 ]

[o.49999765]]

习题4-3 试举例说明“死亡ReLU问题”,并提出解决办法。

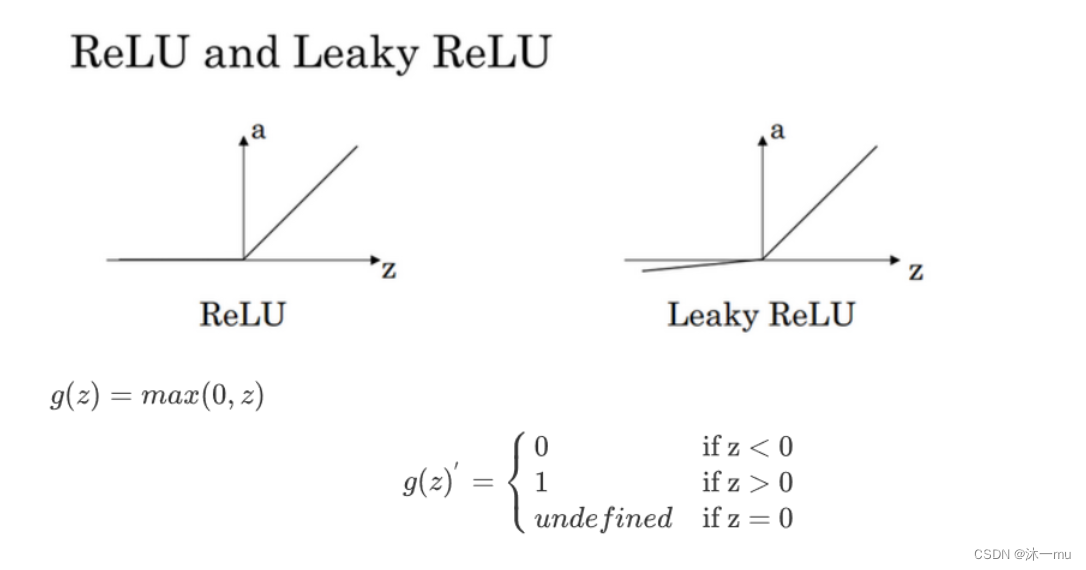

ReLU函数图像:

死亡ReLU就是神经元死亡了,无法更新参数,使得网络无法继续训练。

也就分为两类:分别是经过激活之后值都变为0,另一种就是饱死。也就是梯度消失和梯度爆炸。

解决方法:

1、减小学习率

2、.使用ELU、PReLU、LeakyRelu等激活函数代替 Relu

ELU、PReLU、LeakyRelu都是让Relu在自变量小于0时函数值也是一个小于0的值,从而让w小于令0在后期有机会更新为正值。

习题4-7 为什么神经网络模型的结构化风险函数中不对偏置b进行正则化。

正则化的目的就是要防止过拟合,过拟合会导致模型的泛化能力太差,也就是通用能力会差。

举个非常感性的例子,如果我们搬了一块非常平整大理石瓷砖,我们暂时想把这片瓷砖放在另一片瓷砖上,但是如果直接放在上边,那么这两片瓷砖就会贴合的非常好,如果想再次拿起来上边这一片瓷砖就非常的不容易,所以我们在瓷砖与瓷砖的边缘之间放上一根树枝之类的物体,为的就是让瓷砖与瓷砖之间有间隔、有缝隙,这样我们就可以把手指扣进去更加使得上劲的把上边的瓷砖搬走了…

首先模型公式为

这里的W对于函数影响是比较大的,这个偏置 b 对于函数来说只是进行一个向左或向右的平移,并且 b 对输入的改变是不敏感的,无论输入变大还是变小, b 对结果的贡献只是一个偏置,因此其对过拟合没有帮助。

而对参数进行正则化的目的是为了防止过拟合,过拟合一般表现为模型对于输入的微小改变产生了输出的较大差异,这主要是由于有些参数w过大的关系,通过对||w||进行惩罚,可以缓解这种问题。

并且查阅后发现,对前置b进行正则化容易造成欠拟合。

习题4-8 为什么用反向传播算法进行参数学习时要采用随机参数初始化的方法而不是直接令W=0,b=0?

反向传播就是要将神经网络的输出误差,一级一级地传播到输入。在计算过程中,计算每一个w 对总的损失函数的影响,即损失函数对每个w的偏导。根据w的误差的影响,再乘以步长,就可以更新整个神经网络的权重。当一次反向传播完成之后,网络的参数模型就可以得到更新。更新一轮之后,接着输入下一个样本,算出误差后又可以更新一轮,再输入一个样本,又来更新一轮,通过不断地输入新的样本迭代地更新模型参数,就可以缩小计算值与真实值之间的误差,最终完成神经网络的训练。

假设将所有的参数都初始化为0,即W=0,b=0(或者相同的值),那么神经网络中的每个单元都会输出相同的激活值,同样也会有相同的误差值,这就会导致代价函数对各个参数的偏导数也相同,最终使用优化算法在增新参数后,所有的参数仍然相等,这样相当于隐层只有1个神经元,造成参数对称问题。

习题4-9 梯度消失问题是否可以通过增加学习率来缓解?

梯度消失问题是在早期的BP网络中比较常见的问题。这种问题的发生会让训练很难进行下去,看到的现象就是训练不再收敛——Loss过早地不再下降,而精确度也过早地不再提高

梯度消失问题是由于激活函数为类似于sigmoid与tanh,其值太大或太小时导数都趋于0;并且在深层神经网络中,误差反向传播时,传播到前几层时梯度信息也会很小。问题是可否通过增大学习率来增大梯度,以至于梯度信息可以在更新时变大。

答案是不行的,增大学习率带来的缺陷会比梯度消失问题更加严重,学习率变大时,很容易使得参数跳过最优值点,然后梯度方向改变,导致参数优化时无法收敛。

123

123

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?