复习日

仔细回顾一下之前21天的内容,没跟上进度的同学补一下进度。

作业:

自行学习参考如何使用kaggle平台,写下使用注意点,并对下述比赛提交代码

训练数据预处理:

import pandas as pd # 用于数据处理和分析,可处理表格数据。

import numpy as np # 用于数值计算,提供了高效的数组操作。

import matplotlib.pyplot as plt # 用于绘制各种类型的图表

import seaborn as sns # 基于matplotlib的高级绘图库,能绘制更美观的统计图形。

import warnings

from sklearn.model_selection import train_test_split

warnings.filterwarnings("ignore")

plt.rcParams['font.sans-serif'] = ['SimHei'] # Windows系统常用黑体字体

plt.rcParams['axes.unicode_minus'] = False # 正常显示负号

data = pd.read_csv('./day22/train.csv')

print(data.info())

print(data.isnull().sum())

for i in data.columns:

if data[i].isnull().sum() > 0:

if pd.api.types.is_numeric_dtype(data[i]):

median_val = data[i].median()

data[i].fillna(median_val, inplace=True)

print(f"用中位数 {median_val} 填补列:{i}")

else:

# 由于众数可能有好几个,需要取其中一个

zhongshu = data[i].mode()[0]

# zhongshu = data_csv[i].mode().iloc[0] # 更规范

data[i].fillna(zhongshu, inplace=True)

print(f"用众数{zhongshu} 填补列:{i}")

data = data.drop(columns=['Name','Ticket', 'Cabin'])

print(data.info())

print(data.isnull().sum())

data = pd.get_dummies(data, columns=['Embarked'])

data2 = pd.read_csv('./day22/train.csv') # 重新读取数据,用来做列名对比

list_final = [] # 新建一个空列表,用于存放独热编码后新增的特征名

for i in data.columns:

if i not in data2.columns:

list_final.append(i) # 这里打印出来的就是独热编码后的特征名

for i in list_final:

data[i] = data[i].astype(int) # 这里的i就是独热编码后的特征名

sex_mapping = {

'male': 1,

'female': 0,

}

data['Sex'] = data['Sex'].map(sex_mapping)

print(data.info())

print(data.isnull().sum())用随机森林模型进行训练和验证

from sklearn.model_selection import train_test_split

X = data.drop(['Survived'], axis=1) # 特征,axis=1表示按列删除

y = data['Survived'] # 标签0否,1存活

# 按照8:2划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42) # 80%训练集,20%测试集

print(X_train.shape, X_test.shape, y_train.shape, y_test.shape) # (1382, 6) (346, 6) (1382,) (346,)

import numpy as np # 引入 numpy 用于计算平均值等

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import StratifiedKFold, cross_validate # 引入分层 K 折和交叉验证工具

from sklearn.metrics import make_scorer, accuracy_score, precision_score, recall_score, f1_score, confusion_matrix, classification_report

import time

import warnings

warnings.filterwarnings("ignore")

warnings.filterwarnings("ignore") # 忽略所有警告信息

# --- 1. 默认参数的随机森林 ---

# 评估基准模型,这里确实不需要验证集

print("--- 1. 默认参数随机森林 (训练集 -> 测试集) ---")

import time # 这里介绍一个新的库,time库,主要用于时间相关的操作,因为调参需要很长时间,记录下会帮助后人知道大概的时长

start_time = time.time() # 记录开始时间

rf_model = RandomForestClassifier(random_state=42)

rf_model.fit(X_train, y_train) # 在训练集上训练

rf_pred = rf_model.predict(X_test) # 在测试集上预测

end_time = time.time() # 记录结束时间

print(f"训练与预测耗时: {end_time - start_time:.4f} 秒")

print("\n默认随机森林 在测试集上的分类报告:")

print(classification_report(y_test, rf_pred))

print("默认随机森林 在测试集上的混淆矩阵:")

print(confusion_matrix(y_test, rf_pred))

from imblearn.over_sampling import SMOTE

smote = SMOTE(random_state=42)

X_train_smote, y_train_smote = smote.fit_resample(X_train, y_train)

print("SMOTE过采样后训练集的形状:", X_train_smote.shape, y_train_smote.shape)

# --- 2. 带权重的随机森林 + 交叉验证 (在训练集上进行CV) ---

print("--- 2. 带权重随机森林 + 交叉验证 (在训练集上进行) ---")

# 确定少数类标签 (非常重要!)

# 假设是二分类问题,我们需要知道哪个是少数类标签才能正确解读 recall, precision, f1

# 例如,如果标签是 0 和 1,可以这样查看:

counts = np.bincount(y_train)

minority_label = np.argmin(counts) # 找到计数最少的类别的标签

majority_label = np.argmax(counts)

print(f"训练集中各类别数量: {counts}")

print(f"少数类标签: {minority_label}, 多数类标签: {majority_label}")

# !!下面的 scorer 将使用这个 minority_label !!

# 定义带权重的模型

rf_model_weighted = RandomForestClassifier(

random_state=42,

class_weight='balanced' # 关键:自动根据类别频率调整权重

# class_weight={minority_label: 10, majority_label: 1} # 或者可以手动设置权重字典

)

# 设置交叉验证策略 (使用 StratifiedKFold 保证每折类别比例相似)

cv_strategy = StratifiedKFold(n_splits=5, shuffle=True, random_state=42) # 5折交叉验证

# 定义用于交叉验证的评估指标

# 特别关注少数类的指标,使用 make_scorer 指定 pos_label

# 注意:如果你的少数类标签不是 1,需要修改 pos_label

scoring = {

'accuracy': 'accuracy',

'precision_minority': make_scorer(precision_score, average='macro', zero_division=0),

'recall_minority': make_scorer(recall_score, average='macro'),

'f1_minority': make_scorer(f1_score, average='macro')

}

print(f"开始进行 {cv_strategy.get_n_splits()} 折交叉验证...")

start_time_cv = time.time()

# 执行交叉验证 (在 X_train, y_train 上进行)

# cross_validate 会自动完成训练和评估过程

cv_results = cross_validate(

estimator=rf_model_weighted,

X=X_train_smote,

y=y_train_smote,

cv=cv_strategy,

scoring=scoring,

n_jobs=-1, # 使用所有可用的 CPU 核心

return_train_score=False # 通常我们更关心测试折的得分

)

end_time_cv = time.time()

print(f"交叉验证耗时: {end_time_cv - start_time_cv:.4f} 秒")

# 打印交叉验证结果的平均值

print("\n带权重随机森林 交叉验证平均性能 (基于训练集划分):")

for metric_name, scores in cv_results.items():

if metric_name.startswith('test_'): # 我们关心的是在验证折上的表现

# 提取指标名称(去掉 'test_' 前缀)

clean_metric_name = metric_name.split('test_')[1]

print(f" 平均 {clean_metric_name}: {np.mean(scores):.4f} (+/- {np.std(scores):.4f})")

print("-" * 50)

# --- 3. 使用权重训练最终模型,并在测试集上评估 ---

print("--- 3. 训练最终的带权重模型 (整个训练集) 并在测试集上评估 ---")

start_time_final = time.time()

# 使用与交叉验证中相同的设置来训练最终模型

rf_model_weighted_final = RandomForestClassifier(

random_state=42,

class_weight='balanced'

)

rf_model_weighted_final.fit(X_train_smote, y_train_smote) # 在整个训练集上训练

rf_pred_weighted = rf_model_weighted_final.predict(X_test) # 在测试集上预测

end_time_final = time.time()

print(f"最终带权重模型训练与预测耗时: {end_time_final - start_time_final:.4f} 秒")

print("\n带权重随机森林 在测试集上的分类报告:")

# 确保 classification_report 也关注少数类 (可以通过 target_names 参数指定标签名称)

# 或者直接查看报告中少数类标签对应的行

print(classification_report(y_test, rf_pred_weighted)) # , target_names=[f'Class {majority_label}', f'Class {minority_label}'] 如果需要指定名称

print("带权重随机森林 在测试集上的混淆矩阵:")

print(confusion_matrix(y_test, rf_pred_weighted))

print("-" * 50)

# 对比总结 (简单示例)

print("性能对比 (测试集上的少数类召回率 Recall):")

recall_default = recall_score(y_test, rf_pred, average='macro')

recall_weighted = recall_score(y_test, rf_pred_weighted, average='macro')

print(f" 默认模型: {recall_default:.4f}")

print(f" 带权重模型: {recall_weighted:.4f}")导入测试集并对数据进行预处理

test_data = pd.read_csv('./day22/test.csv')

for i in test_data.columns:

if test_data[i].isnull().sum() > 0:

if pd.api.types.is_numeric_dtype(test_data[i]):

median_val = test_data[i].median()

test_data[i].fillna(median_val, inplace=True)

print(f"用中位数 {median_val} 填补列:{i}")

else:

# 由于众数可能有好几个,需要取其中一个

zhongshu = test_data[i].mode()[0]

# zhongshu = data_csv[i].mode().iloc[0] # 更规范

test_data[i].fillna(zhongshu, inplace=True)

print(f"用众数{zhongshu} 填补列:{i}")

test_data = test_data.drop(columns=['Name','Ticket', 'Cabin'])

test_data = pd.get_dummies(test_data, columns=['Embarked'])

data2 = pd.read_csv('./day22/test.csv') # 重新读取数据,用来做列名对比

list_final = [] # 新建一个空列表,用于存放独热编码后新增的特征名

for i in test_data.columns:

if i not in data2.columns:

list_final.append(i) # 这里打印出来的就是独热编码后的特征名

for i in list_final:

test_data[i] = test_data[i].astype(int) # 这里的i就是独热编码后的特征名

sex_mapping = {

'male': 1,

'female': 0,

}

test_data['Sex'] = test_data['Sex'].map(sex_mapping)

print(test_data.info())

print(test_data.isnull().sum())用训练好的模型进行预测

rf_pred_weighted = rf_model_weighted_final.predict(test_data) # 在测试集上预测

output = pd.DataFrame({

'PassengerId': test_data['PassengerId'],

'Survived': rf_pred_weighted

})

# 保存为 CSV 文件

output.to_csv('titanic_predictions.csv', index=False)

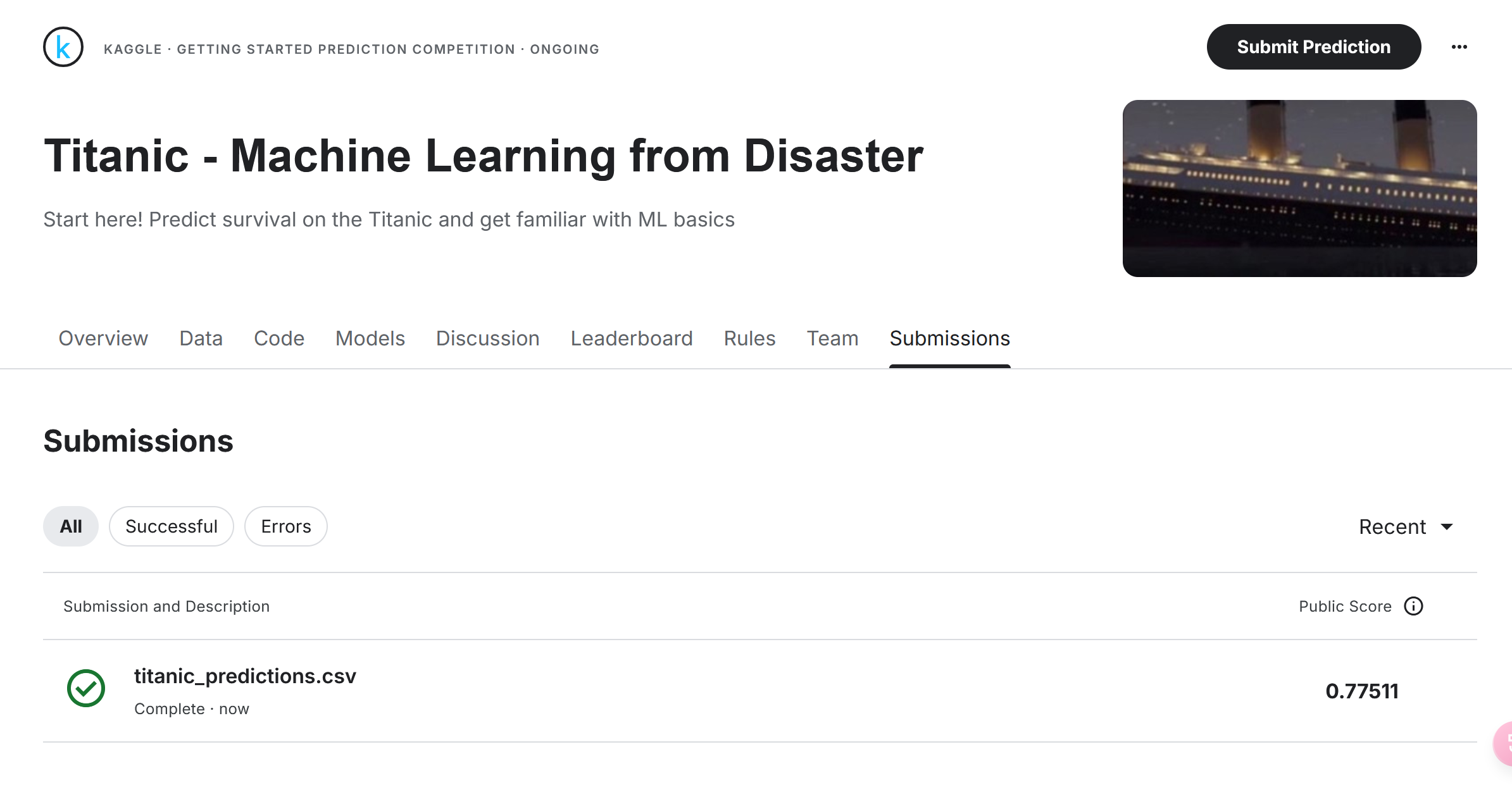

提交结果图

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?