今天给大家介绍发表于Nature Communications 2024的论文:

A molecular video-derived foundation model for scientific drug discovery

01 前言

药物发现是一个复杂而耗时的过程,涉及潜在药物靶点的识别、化合物的设计和合成,以及化合物疗效和安全性的测试。在传统的药物发现中,药物化学家和药理学家根据知识和经验选择和优化候选化合物,并通过筛选细胞或动物模型进行验证。利用计算和人工智能技术辅助药物开发的计算药物发现为加快这一过程提供了一种有前景的方法。通过利用大型生物和化学信息数据集,这些计算方法,如基础模型,可以快速识别新的药物靶点,设计候选分子,并评估这些候选分子的疗效和特性,这大大减少了传统药物发现和开发的时间和成本。传统方法使用手工制作的指纹作为分子表示,如物理化学指纹和基于药效团的指纹。受领域知识的限制,这些传统的表示方法是主观的、不可变的,缺乏足够的泛化能力。随着深度学习和自监督学习的兴起,自动分子表征学习方法可以通过在大规模分子数据集上进行预训练,从分子序列、分子图和图像中提取表征。这些方法在药物发现的各种任务中显示出显著的性能改进。基于计算机视觉中视频表示学习和自监督学习的最新进展,基于自监督视频的预训练模型为进一步提高药物发现的性能提供了令人信服的机会。在这项研究中,作者提出了一种用于分子表征学习的基于分子视频的基础模型(称为VideoMol)。具体来说,VideoMol利用动态意识和物理化学意识,以无监督的方式从大量分子3D动态视频中学习分子表示。作者实施了一个自我监督的预训练框架,从1.2亿帧200万个分子视频中捕获化合物的物理化学信息,这些视频在人类蛋白质组中具有不同的生物活性。作者证明VideoMol在药物发现任务中优于现有的最先进方法,包括药物靶点和多分子特性预测。

02 方法

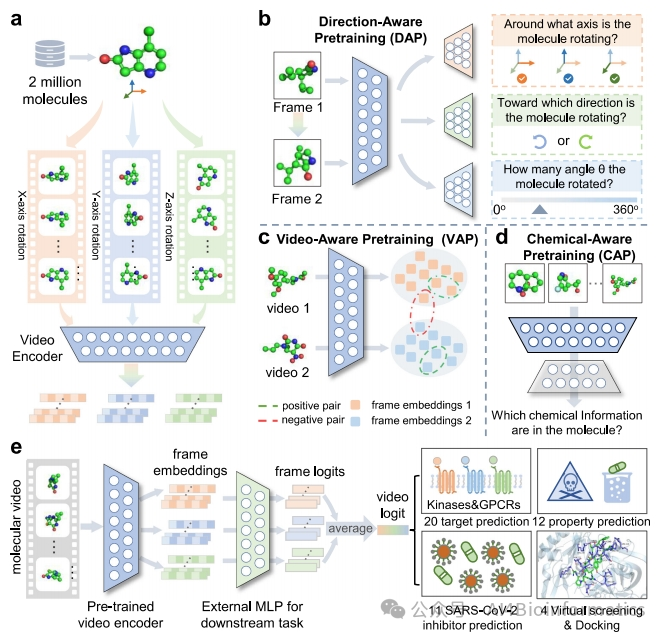

首先,作者生成了200万个药物样和生物活性分子的构象,并为每个3D分子渲染了60帧的动态视频(总共1.2亿帧)。然后,作者将分子3D视频输入视频编码器以提取潜在特征(图1a),并实施三种预训练策略,通过考虑视频和分子物理化学信息的变化来优化潜在表示(图1b-d)。最后,作者在下游任务(预测分子靶标和特性)上微调预训练的视频编码器,以进一步提高模型性能(图1e)。VideoMol通过使用Grad CAM(梯度加权类激活映射)来可视化分子视频对热图预测结果的贡献,从而实现了良好的可解释性。

图1 VideoMol基础模型总体框架

2.1 分子构象生成

在预训练时,作者直接使用PCQM4Mv2数据库中提供的构象信息。然而,在微调过程中,下游任务中的分子不包含相应的构象信息,因此作者通过多阶段生成方法获得分子构象。作者首先从分子中去除氢原子,并在RDKit中使用MMFFOptimizeMole()与MMFF94(Merk分子力场)和最大迭代次数iter=5000在预定的坐标系中生成构象。然后,作者判断生成的构象是否已经收敛。如果构象不收敛,作者将最大迭代次数增加iter=iter×2,并重复此过程10次,直到收敛。最后,如果RDKit未能生成构象,或者构象在10次尝试后仍未收敛,作者直接使用2D构象。

2.2 VideoMol预训练策略

预训练旨在提高模型专注于分子视频中关键信息的能力,从而实现更有意义的特征提取。在本文中,为了从不同角度获取分子视频中的信息,作者考虑了三个预训练任务(图1b-d):视频感知预训练、方向感知预训练和化学制品预训练。具体来说,视频感知预训练使模型能够区分不同的分子视频,例如这两帧是否来自同一视频。方向感知预训练使模型能够区分每帧之间的关系,例如两帧之间的差异角度。化学意识预训练有助于模型挖掘视频中的理化相关信息。

识别视频之间的差异对于模型学习分子之间的判别信息非常重要,因为视频只描述了一个分子。同时,视频中的不同帧描述了3D空间中分子的不同视图,这导致从同一视频中提取不同帧时模型的表示不稳定。因此,作者提出了一种基于视频的预训练任务,称为视频感知预训练(VAP),来模拟视频帧间的相似性和视频帧内的相异性,即来自同一视频的帧应该靠得很近,而来自不同视频的帧则应该相距很远。具体来说,作者的方法使用对比学习来训练分子视频表征,将正对潜在向量与负对进行对比。

将连续旋转物体的两个快照关联起来对人类来说是微不足道的,这得益于人类基于先验知识推理和想象物体3D结构的能力。例如,当人类只观察到有限的未遮挡局部区域时,他们可以很容易地将遮挡区域联系起来。因此,为了使模型具备这种能力,作者提出了方向感知预训练(DAP),它由三个预测任务组成:i)轴,ii)旋转,iii)角度预测。

2.3 预训练过程

为了预训练VideoMol,作者从PCQM4Mv2(一个关于量子化学的公共访问数据库,详见补充部分a.1)中采样200万个未标记的分子及其相应的构象,并生成60帧的分子视频。作者随机抽取90%的分子视频进行训练,剩下的10%在训练前阶段进行评估。VideoMol的预训练包括三个重要组成部分,分别是视频编码器选择、数据增强和预训练过程。在视频编码器选择中,受计算机视觉中视觉变换器(ViT)的惊人性能的鼓舞,作者使用12层ViT作为VideoMol的视频编码器。对于视频中的每一帧,视频编码器将其分割成16×16的块作为输入,并提取384维特征。

03 实验

3.1 VideoMol在多种药物发现任务中的性能

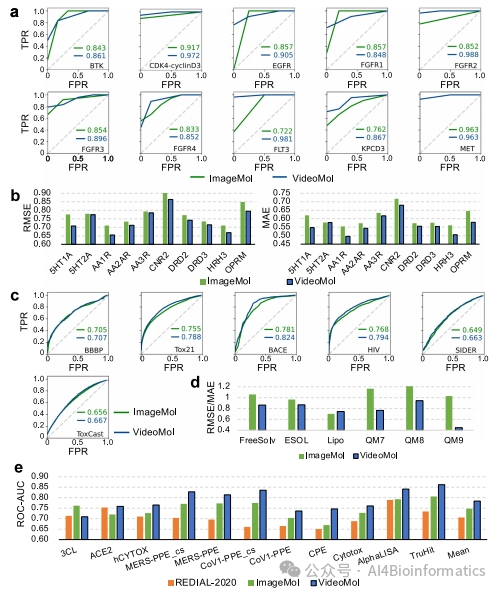

作者首先使用三种最先进的分子表示学习方法在10个化合物激酶(分类任务)和10个配体GPCR(回归任务)结合活性预测数据集上评估了VideoMol的性能,这些数据集具有平衡的支架分裂。对于10个化合物激酶相互作用数据集,VideoMol在BTK(AUC=0.861±0.023)、CDK4cyclinD3(AUC=0.972±0.039)、EGFR(AUC=0.905±0.017)、FGFR1(AUC=0.848±0.027)。特别是,VideoMol的表现优于ImageMol和MolCLR的最先进方法,平均改进率分别为6.7%和20.1%。对于10个配体GPCR结合数据集,VideoMol在所有数据集上都取得了最佳结果,均方根误差(RMSE)的平均性能提高了4.5%,范围在0.60%至8.8%之间,平均绝对误差(MAE)提高了5.9%,最大值为11.4%(图2b)。VideoMol在RMSE上的平均性能提高了4.5%和10.2%,在ImageMol和MolCLR的MAE上分别提高了6.2%和12.0%。

图2 VideoMol框架在多种药物发现任务中的性能

3.2 通过VideoMol发现配体-受体相互作用

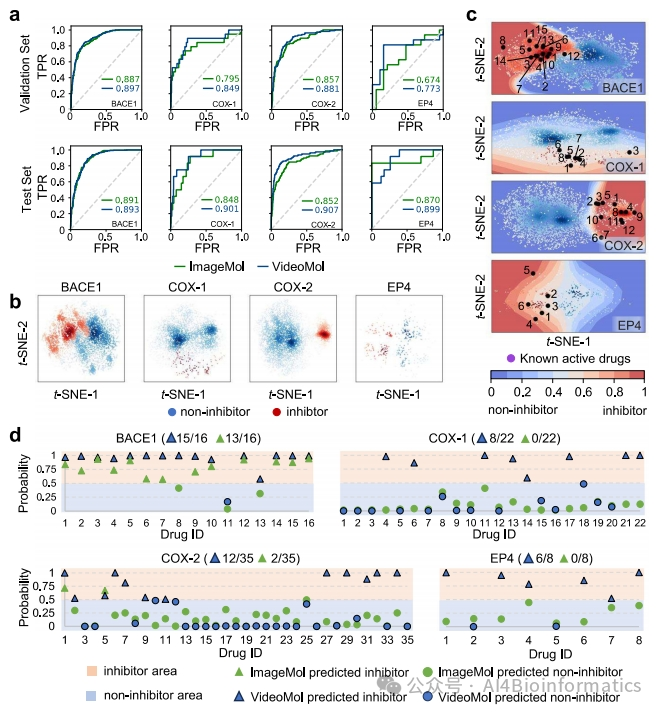

作者通过VideoMol鉴定4个众所周知的人类靶点的新型配体-受体相互作用:β分泌酶1(BACE1)、环氧化酶1(COX-1)、COX-2和前列腺素E受体4(EP4),以评估该模型的普遍性。作者从ChEMBL数据库中收集了这4个目标的训练数据,并以8:1:1的随机比例评估了VideoMol在这些目标上的性能。使用ROC-AUC度量评估,作者发现VideoMol在验证集(BACE1=0.897,COX-1=0.849,COX-2=0.881和EP4=0.773)和测试集(BACE1=0.893,COX-1=0.901,COX-2=0.907和EP4=0.899)上都取得了很高的性能,优于ImageMol,验证集中的平均改善率为6.4%,测试集中的平均改进率为4.1%(图3a)。

图3 通过VideoMol发现配体-受体相互作用

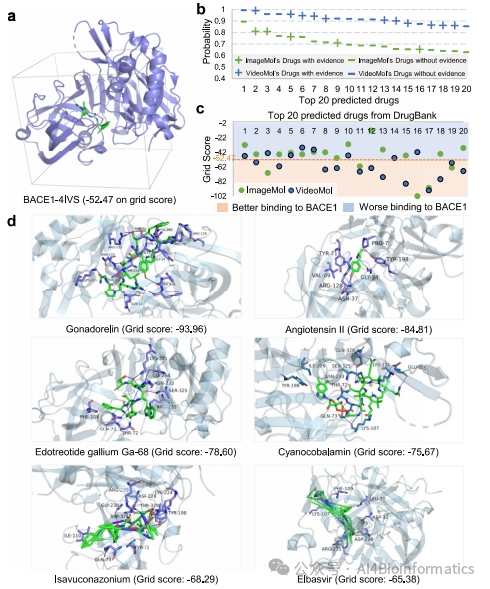

3.3 通过VideoMol从现有药物中发现BACE1抑制剂

BACE1(β位点淀粉样前体蛋白切割酶1)是阿尔茨海默病(AD)的关键药物靶点,迄今为止,AD缺乏有效的小分子治疗。接下来,作者使用VideoMol从DrugBank数据库的2500种批准药物中特异性靶向BACE1,筛选潜在的抑制剂。作者从PDB(蛋白质数据库)数据库下载了已知的BACE1(PDB ID:4IVS)的X射线晶体结构,其中含有带有吲哚酰基胍核心结构(配体ID:VSI)的共结晶抑制剂。作者通过Dock6.105评估了配体和受体(PDB ID:4IVS,图4a)之间的网格得分(结合能力的度量,值越小表示得分越高)。作者从已发表的文献中收集了VideoMol和ImageMol预测的前20种药物的实验证据。作者发现VideoMol预测的20种药物中有11种被验证为AD的潜在治疗方法(成功率55%),高于ImageMol的5种药物(成功率25%)。(图4b)。这些反映了VideoMol可以学习更多的3D信息和化学信息,以确保预测的高置信度。

图4 VideoMol预测药物对人β分泌酶1(BACE1)的计算验证

04 结论

作者提出了一种基于自我监督视频处理的预训练框架VideoMol,它通过利用动态意识和物理化学意识来学习分子表征。作者展示了VideoMol在各种药物发现任务中的高性能,包括预测分子靶点谱(如GPCR、激酶、严重急性呼吸系统综合征冠状病毒2型)和分子特性(如药理学、生物物理学、物理和量子化学)。作者评估了VideoMol对ChEMBL的4个常见靶点(BACE1、COX-1、COX-2和EP4)的有效性,还验证了VideoMol在虚拟筛选4个靶点(BACE1、COX-1、COX-2和EP4)方面的高精度,这与正在进行的临床和实验数据一致。VideoMol是一种新型的分子表征学习框架,与之前基于序列、图形和图像的分子表征学方法有显著不同。VideoMol将分子视为动态视频,并以视频处理的方式学习分子表示,这意味着大量的视频表示学习技术可用于学习分子表示。与之前的ImageMol相比,VideoMol有几个实质性的升级,包括:(1)分子视觉表示的内容从2D像素信息升级到3D像素信息;(2) 分子预训练从基于图像的学习升级为基于视频的学习;(3) 所包含的指纹信息从之前的1个指纹(MACCS密钥)升级为21个指纹。由于VideoMol涉及图像表示学习、视频表示学习和多视图表示学习等研究领域,因此它具有更大的研究潜力,并激励更多的研究人员提高性能。

大模型&AI产品经理如何学习

求大家的点赞和收藏,我花2万买的大模型学习资料免费共享给你们,来看看有哪些东西。

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

因篇幅有限,仅展示部分资料,需要点击下方图片前往获取

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集***

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?