文章目录

一、提出任务

- 分组求Top是大数据领域常见的需求,主要是根据数据某一列分组,然后将分组后的每一组数据按照指定的列进行排序,最后取每一组的前N行数据。

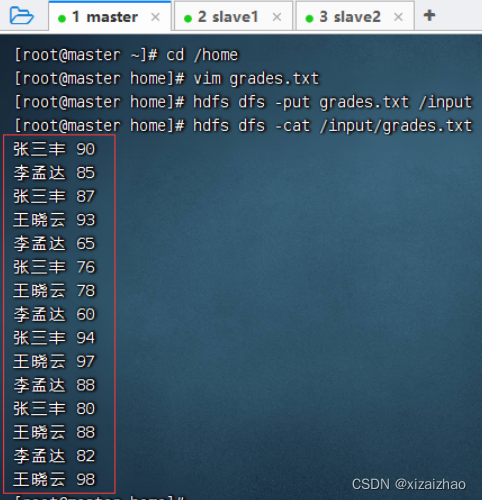

- 有一组学生成绩数据

张三丰 90

李孟达 85

王小云 93

张三丰 87

王小云 77

李孟达 95

李孟达 99

王小云 90

张三丰 89

李孟达 87

张三丰 80

王小云 97

张三丰 80

李孟达 94

王小云 95

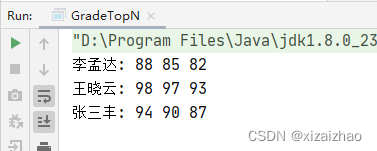

- 同学一个学生有多门成绩,献需要计算每个学生分数最高的前3个成绩期望输出的结果如下所示:

张三丰 90 89 87

李孟达 99 95 94

王小云 97 95 93

-

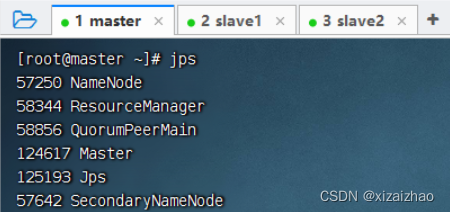

预备工作:启动集群的HDFS与Spark

-

将成绩文件 - grades.txt上传到HDFS上/input目录

-

**实现思路:**使用Spark RDD的groupByKey()算子可以对(key,

value)形式的RDD按照key进行分组,key相同的元素的value将聚合到一起,形成(key,

value-list),将value-list中的元素降序排列取前N个即可。

二、完成任务

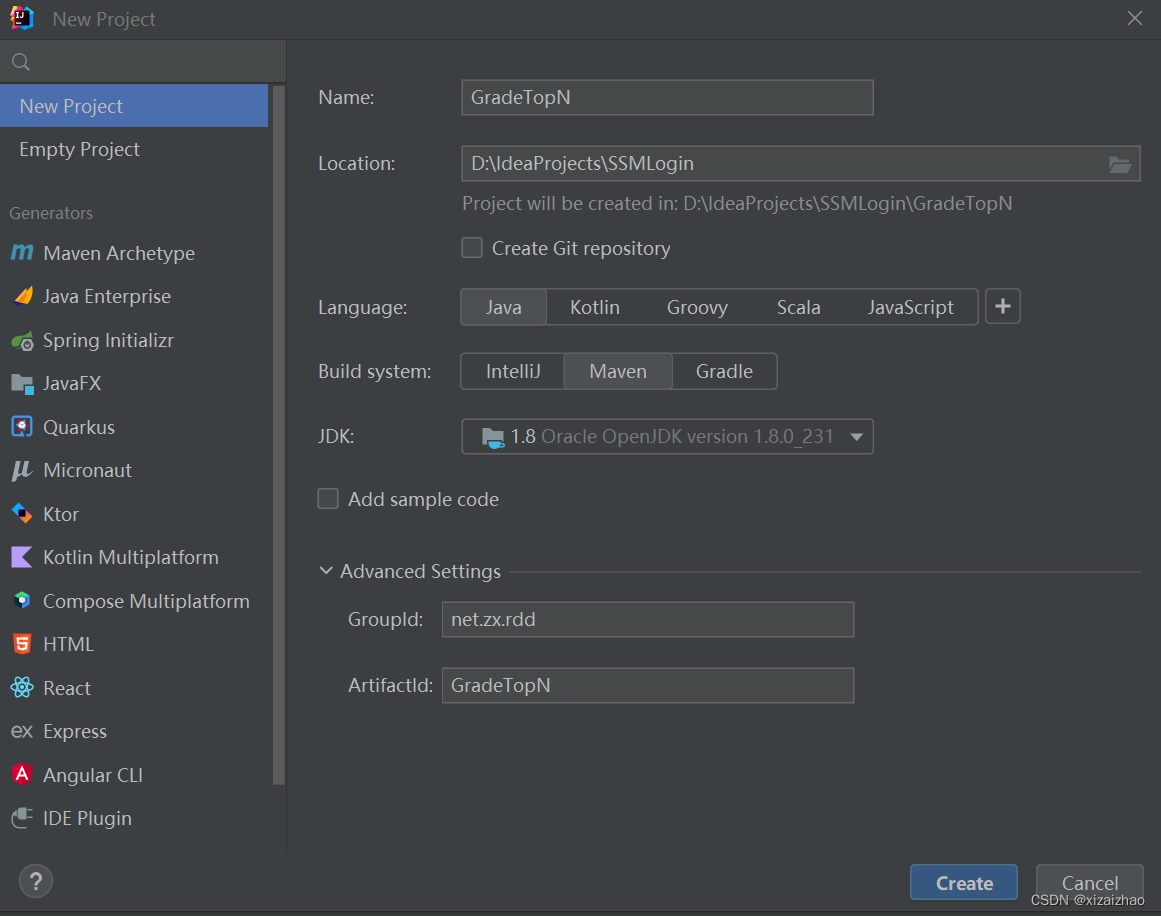

(一)新建Maven项目

-

设置项目信息(项目名、保存位置、组编号、项目编号)

-

单击【Cancel】按钮

-

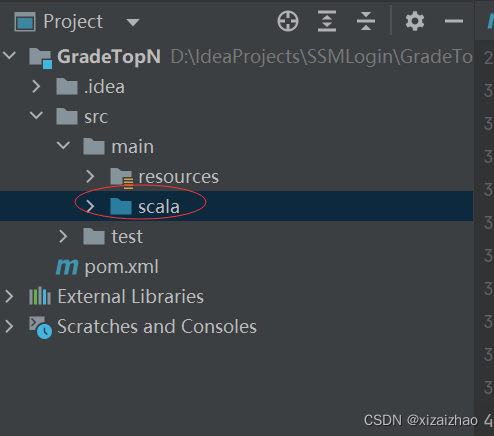

将java目录改变成scala目录

(二)添加相关依赖和构建插件

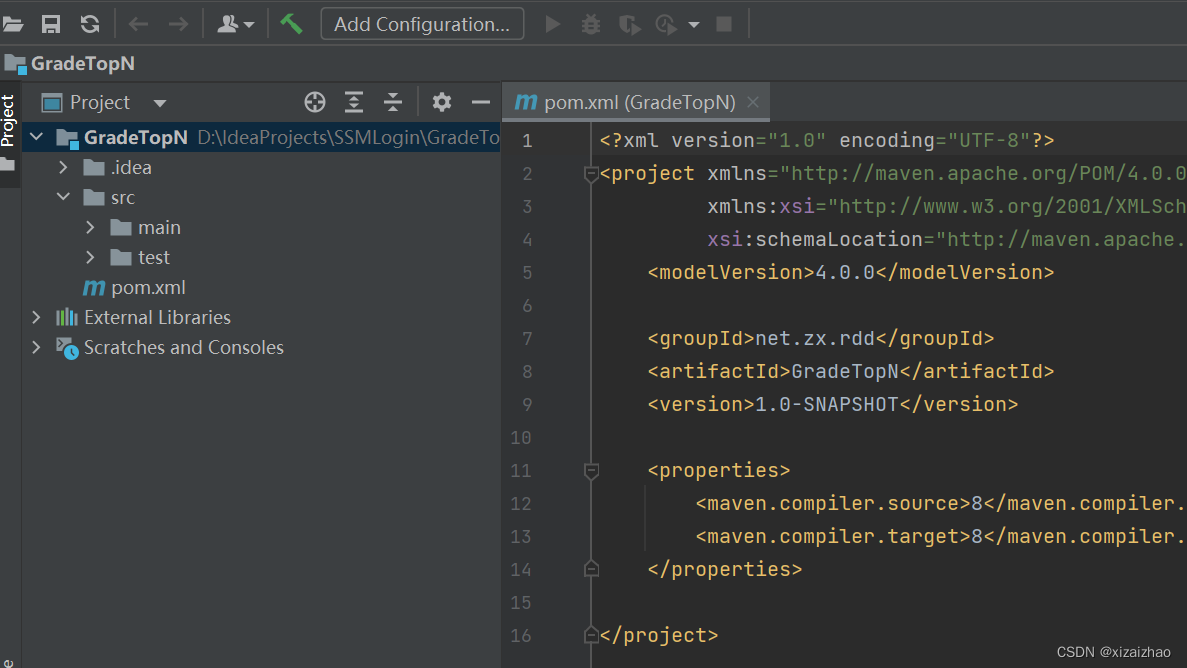

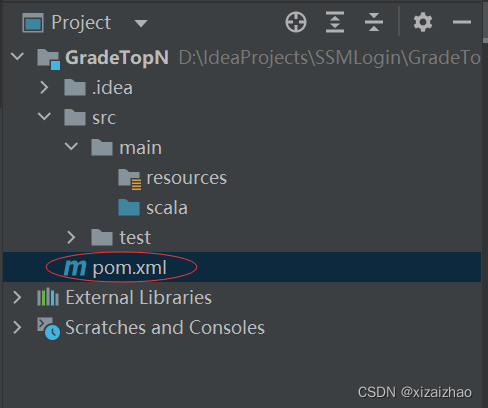

- 在pom.xml文件里添加依赖与Maven构建插件

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0

http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>net.zx.rdd</groupId>

<artifactId>GradeTopN</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>2.11.12</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.11</artifactId>

<version>2.1.1</version>

</dependency>

</dependencies>

<build>

<sourceDirectory>src/main/scala</sourceDirectory>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-assembly-plugin</artifactId>

<version>3.3.0</version>

<configuration>

<descriptorRefs>

<descriptorRef>jar-with-dependencies</descriptorRef>

</descriptorRefs>

</configuration>

<executions>

<execution>

<id>make-assembly</id>

<phase>package</phase>

<goals>

<goal>single</goal>

</goals>

</execution>

</executions>

</plugin>

<plugin>

<groupId>net.alchim31.maven</groupId>

<artifactId>scala-maven-plugin</artifactId>

<version>3.3.2</version>

<executions>

<execution>

<id>scala-compile-first</id>

<phase>process-resources</phase>

<goals>

<goal>add-source</goal>

<goal>compile</goal>

</goals>

</execution>

<execution>

<id>scala-test-compile</id>

<phase>process-test-resources</phase>

<goals>

<goal>testCompile</goal>

</goals>

</execution>

</executions>

</plugin>

</plugins>

</build>

</project>

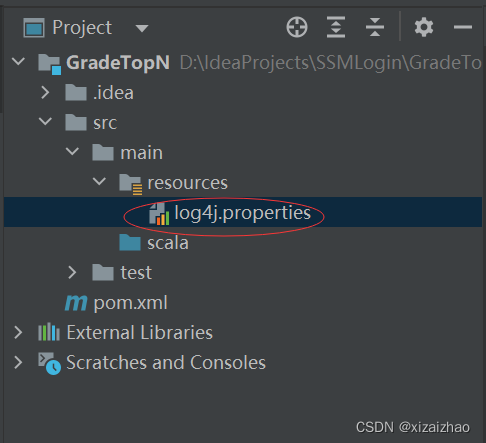

(三)创建日志属性文件

- 在资源文件夹里创建日指数型文件 - log4j.properties

log4j.rootLogger=ERROR, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/spark.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

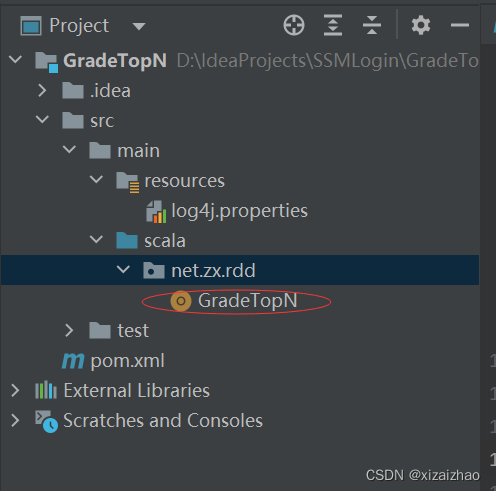

(四)创建分组排行榜单例对象

- 在net.huawei.rdd包里创建GradeTopN单例对象

(五)本地运行程序,查看结果

- 在控制台上查看输出结果

(六)交互式操作查看中间结果

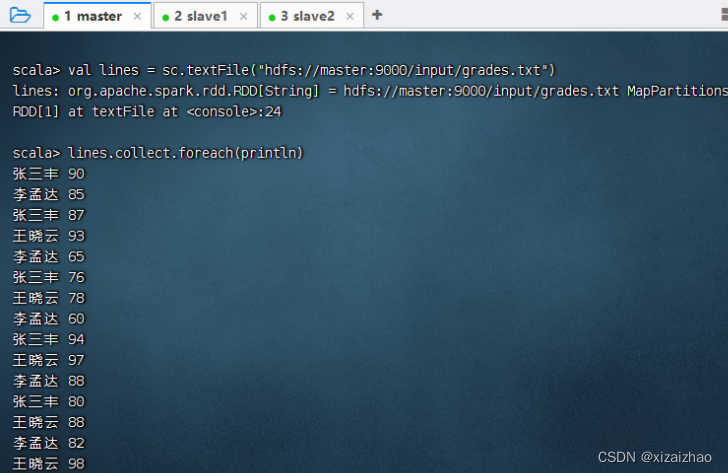

1.读取成绩文件得到RDD

- 执行命令:val lines = sc.textFile(“hdfs://master:9000/input/grades.txt”)

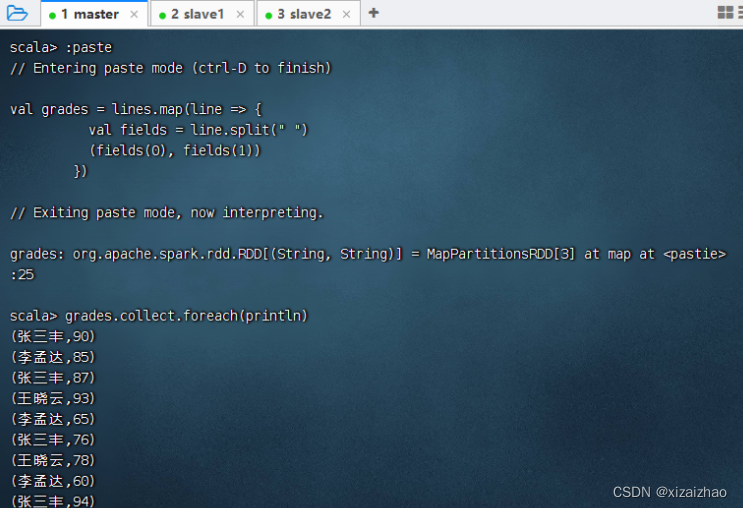

2.利用映射算子生成二元组构成的RDD

val grades = lines.map(line => {

val fields = line.split(" ")

(fields(0), fields(1))

})

- 执行上述代码

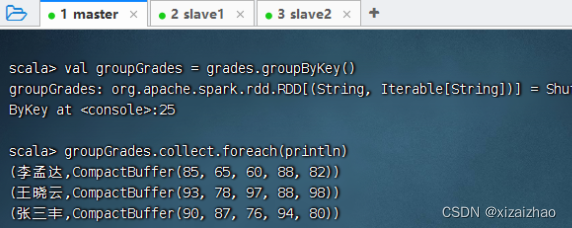

3.按键分组得到新的二元组构成的RDD

- 执行命令:val groupGrades = grades.groupByKey()

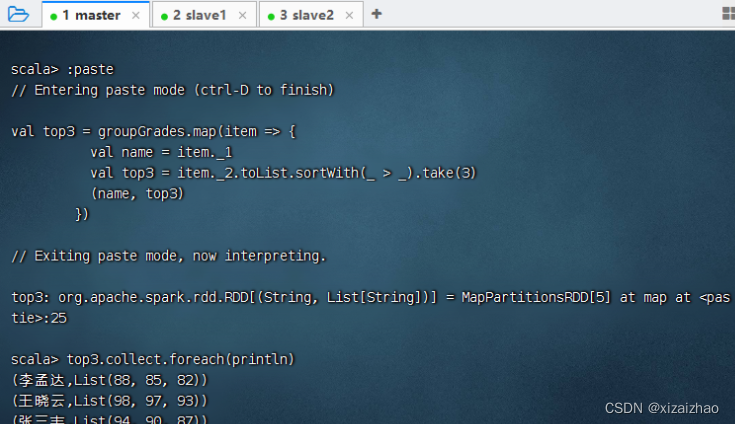

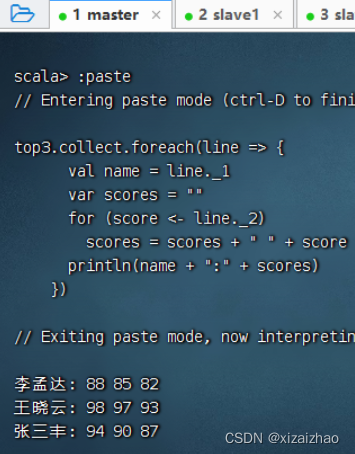

4.按值排序,取前三

val top3 = groupGrades.map(item => {

val name = item._1

val top3 = item._2.toList.sortWith(_ > _).take(3)

(name, top3)

})

320

320

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?