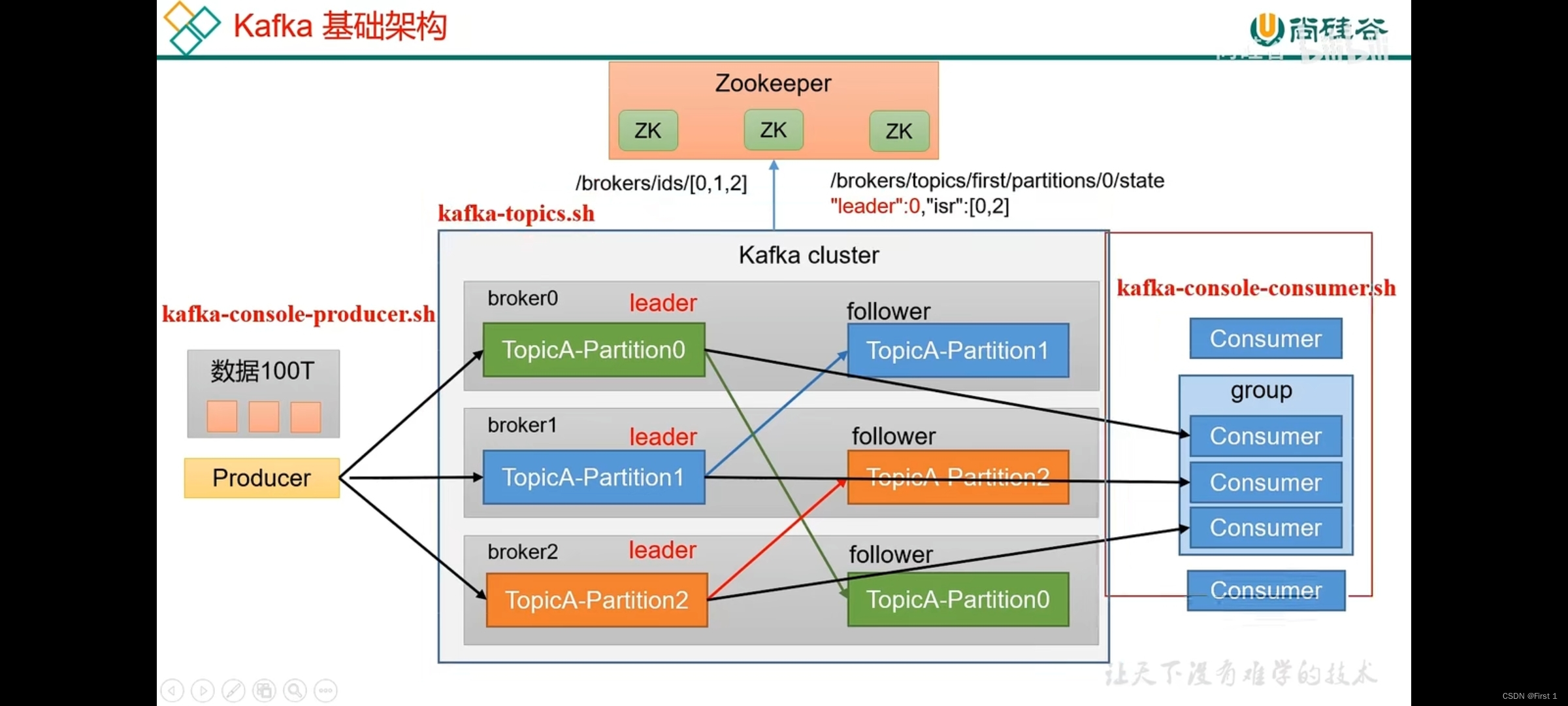

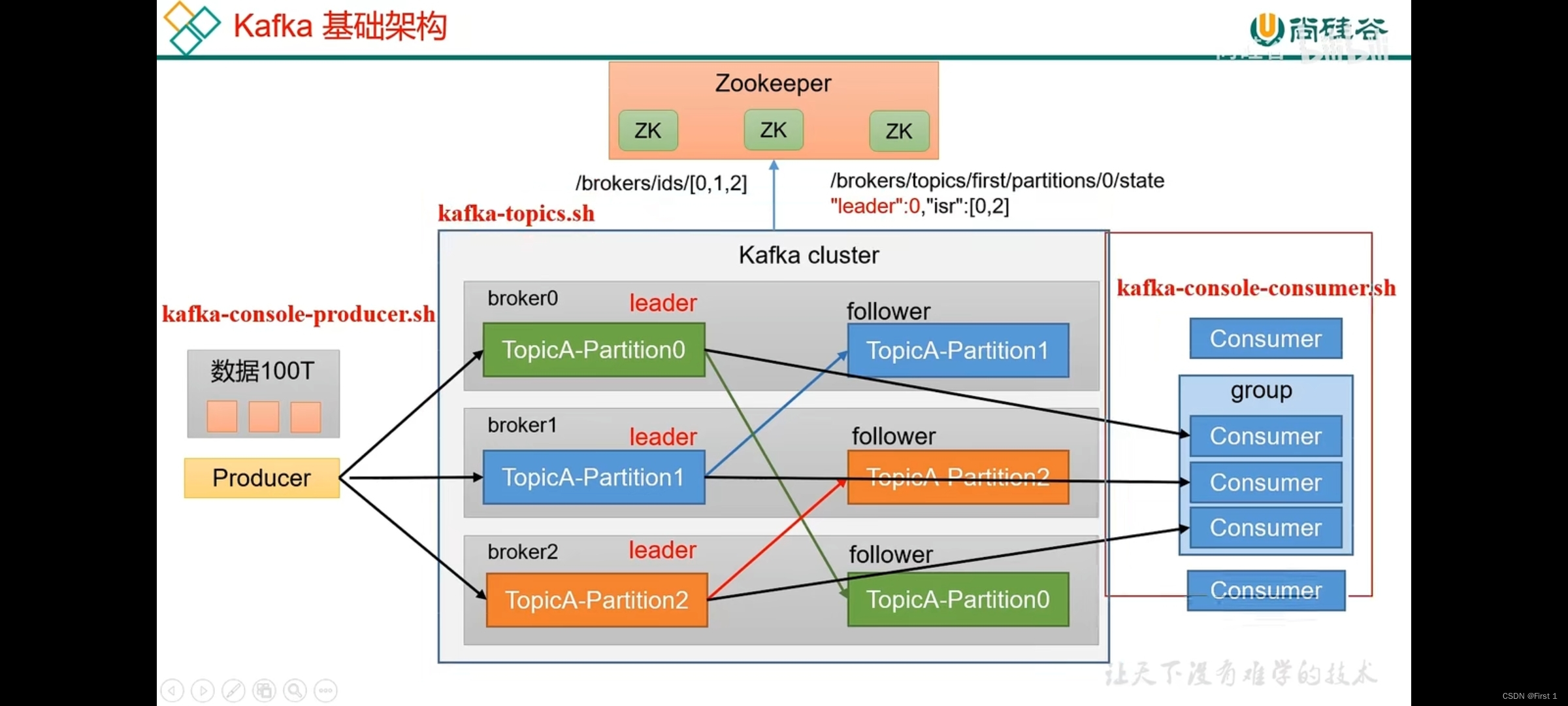

1.kafka相当于一个容器工具,所有的信息都在里面,在kafka中有不同的topic也就是主题,然后把这些分成不同的片,就有docker出现。然后消息就相当于数据库中的一条条数据,然后有消息生产者和消息消费者

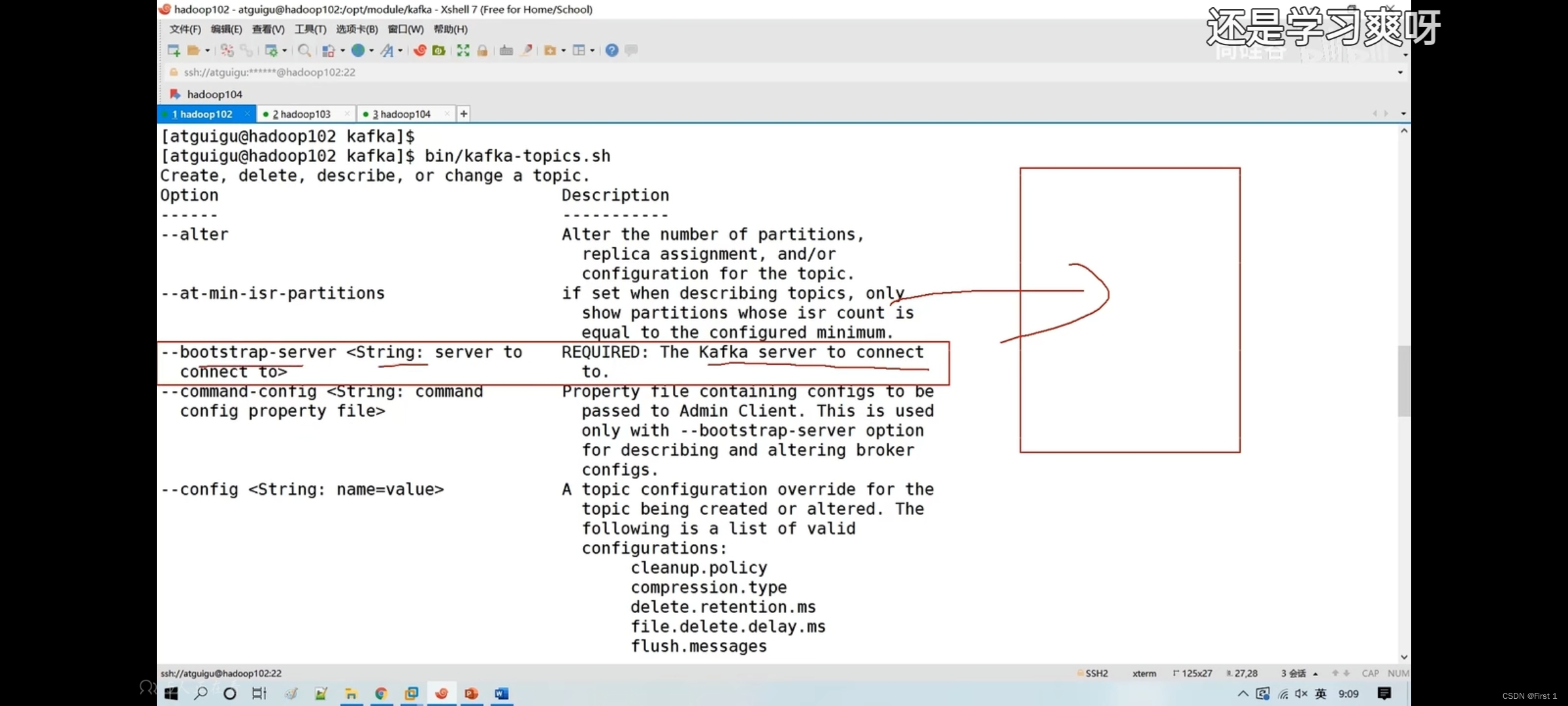

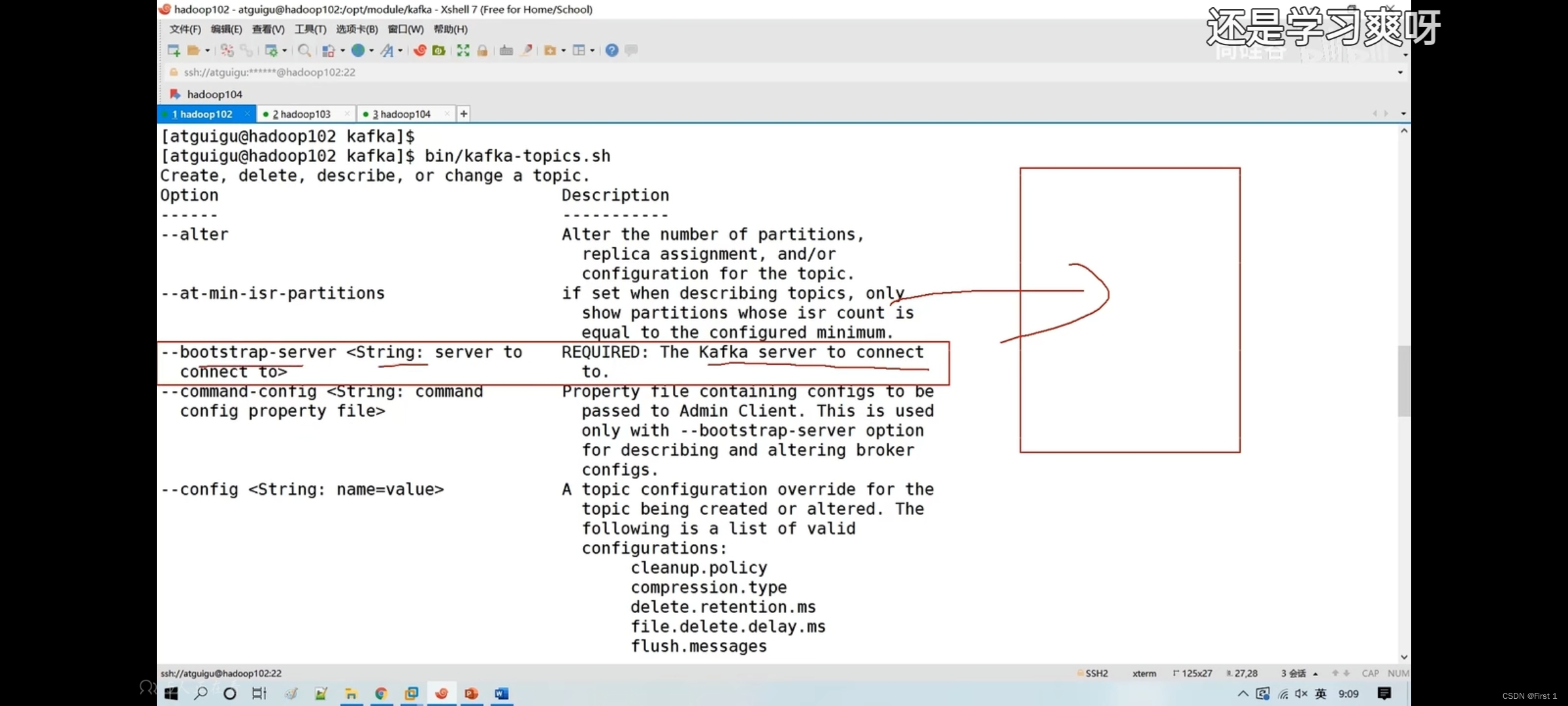

2.所有我们需要建端口号和kafka收集hive中的数据,hive连接sql数据库,需要初始化hive

3.kafka消费数据要上传到HDFS中

1.kafka相当于一个容器工具,所有的信息都在里面,在kafka中有不同的topic也就是主题,然后把这些分成不同的片,就有docker出现。然后消息就相当于数据库中的一条条数据,然后有消息生产者和消息消费者

2.所有我们需要建端口号和kafka收集hive中的数据,hive连接sql数据库,需要初始化hive

3.kafka消费数据要上传到HDFS中

209

209

2556

2556

1354

1354

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?