Hbase的伪分布式部署

实验要求:在Centos7系统完成JDK、Hadoop环境搭建和Hbase的伪分布式部署,并通过Web UI监控HBase运行状态

小编这里给大家把需要的软件上传到百度网盘,有需要自取哦!!!

链接:https://pan.baidu.com/s/1gEwcHtC7hbWO9BwVrfy_lA?pwd=9jqu

提取码:9jqu

HBse的伪分布式快速上手

一、关闭防火墙

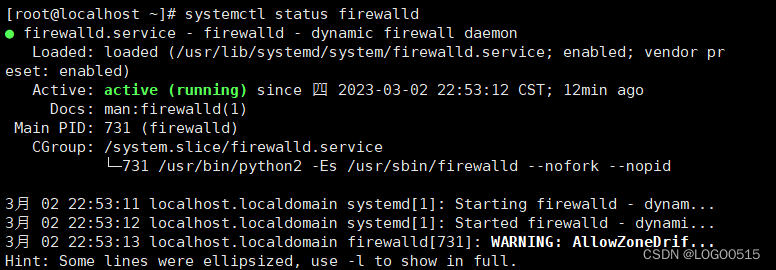

1.1 查看防火墙状态

systemctl status firewalld

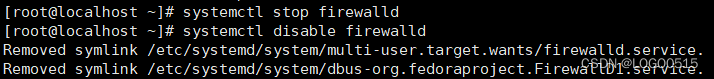

1.2 关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

二、关闭selinux

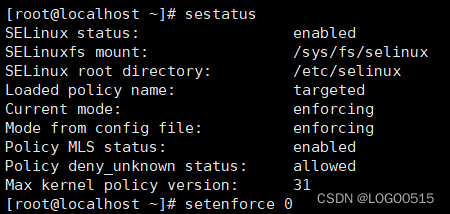

2.1 查看selinux状态的命令

sestatus

2.2 临时关闭selinux,不用重启机器,命令如下:

setenforce 0

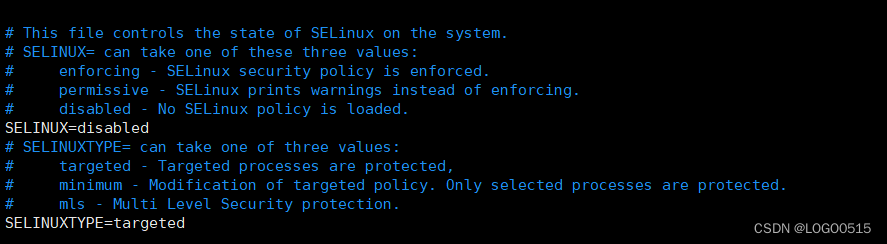

2.3 还可以在配置文件中永久关闭,修改完后需要重启机器生效。

打开配置文件:

vim /etc/sysconfig/selinux

2.4 修改文件,将selinux文件中需要修改的元素SELINUX设置为禁用:

SELINUX=disabled

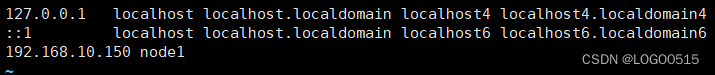

三、修改主机名为node1,并配置主机名和IP地址的映射

3.1 运行一下命令修改主机名:

hostnamectl set-hostname node1

3.2 下面配制主机名与IP地址的映射。

3.2.1 打开配置文件:

vim /etc/hosts

3.2.2 在文件中添加以下配制:

主机IP地址 node1

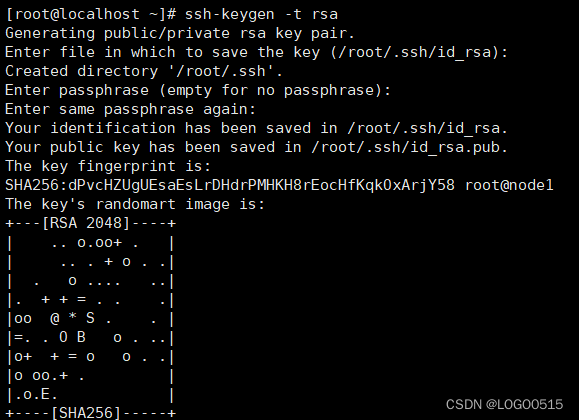

四、配制SSH 免密码登录

4.1免密码登录本机,执行以下命令产生秘钥,位于/root/.ssh目录:

ssh-keygen-t rsa

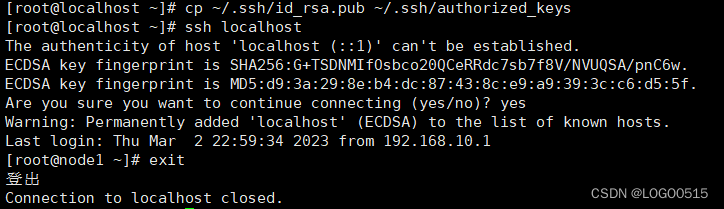

4.2 执行以下命令,创建秘钥文件authorized_keys:

cp ~/.ssh/id_rsa.pub ~/.ssh/authorized_keys

4.3 下面进行验证

4.3.1 执行以下命令登录主机:

ssh localhost

4.3.2 执行以下命令退出连接:

exit

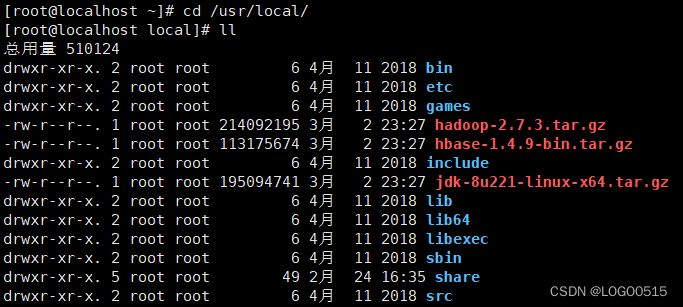

五、安装及配置JDK1.8

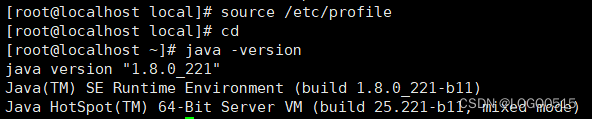

5.1 检查JDK是否已安装:

java -version

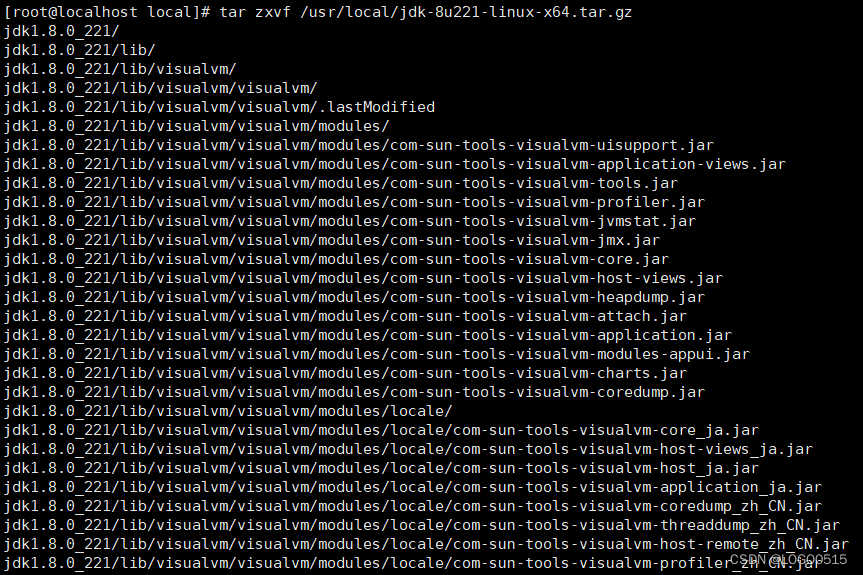

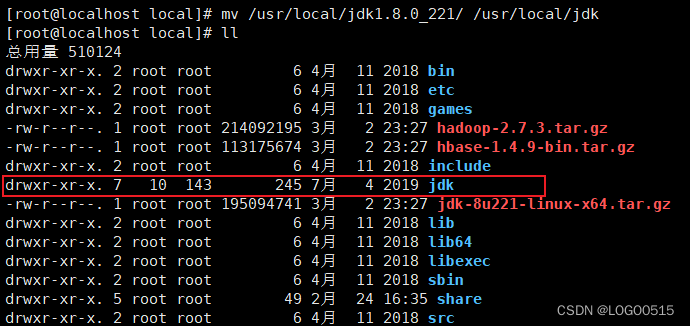

5.2 如果未安装,则将下载好的jdk安装包放到系统的/usr/local目录下,然后解压安装包:

tar zxvf /usr/local/jdk-8u112-linux-x64.tar.gz #解压

mv /usr/local/jdk1.8.0_112 /usr/local/jdk #更改文件目录名

5.3 设置环境变量:

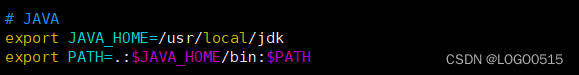

vim /etc/profile

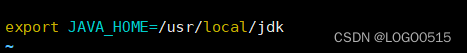

```bash

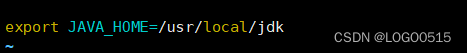

export JAVA_HOME=/usr/local/jdk

export PATH=.$JAVA_HOME/bin:$PATH

5.4 执行以下命令,是设置立即生效

source /etc/profile

六、安装及配置 Hadoop

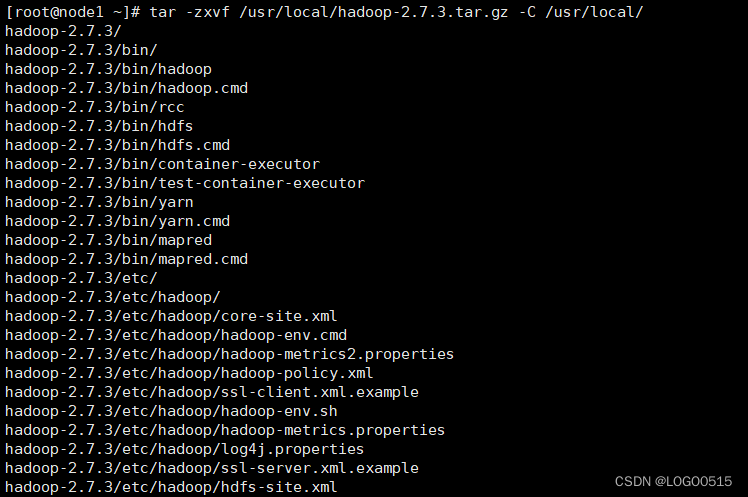

6.1 进入Hadoop的存放目录,解压Hadoop:

tar zxvf hadoop-2.7.3.tar.gz #解压

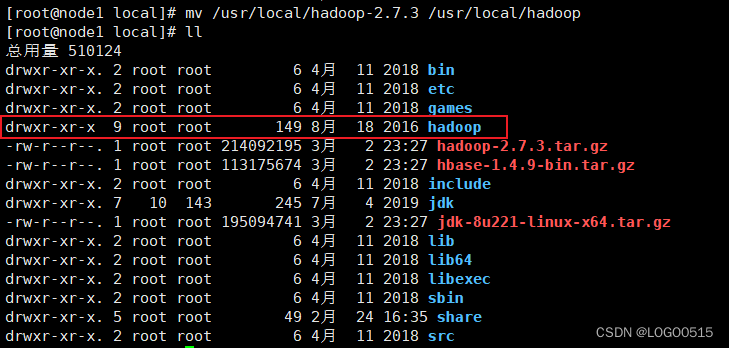

mv hadoop-2.7.3 hadoop #更改文件目录名

6.2 设置环境变量:

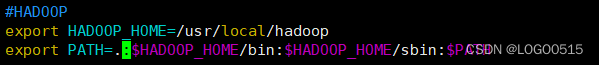

vim /etc/profile

export HADOOP_HOME=/usr/local/hadoop

export PATH=.:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

6.3 执行以下命令,使设置立即生效:

source /etc/profile

6.4 修改./etc/hadoop/hadoop-env.sh文件,配置JDK的路径:

export JAVA_HOME=/usr/local/jdk

6.5 修改yarn-env.sh文件,配置JDK的路径:

export JAVA_HOME=/usr/local/jdk

七、 修改Hadoop配置文件

7.1 进入/usr/local/hadoop/etc/hadoop目录:

cd /usr/local/hadoop/etc/hadoop

7.2修改配置文件

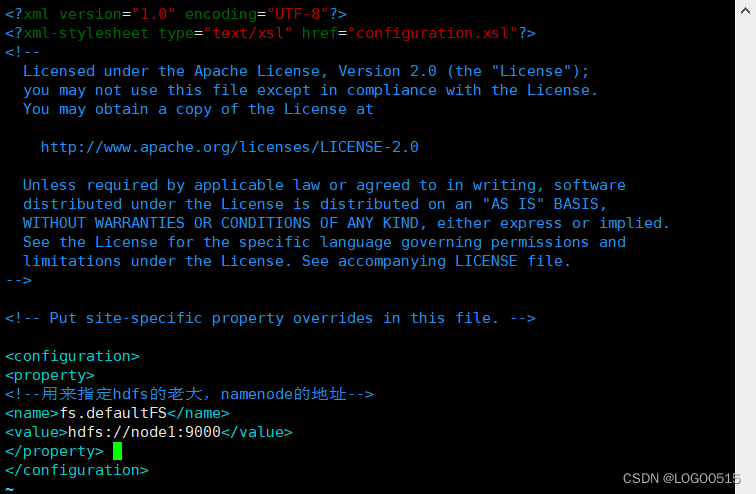

7.2.1 vim core-site.xml core-site.xml 设置HDFS的节点和端口号:

<configuration>

<property>

<!--用来指定hdfs的老大,namenode的地址-->

<name>fs.defaultFS</name>

<value>hdfs://node1:9000</value>

</property>

</configuration>

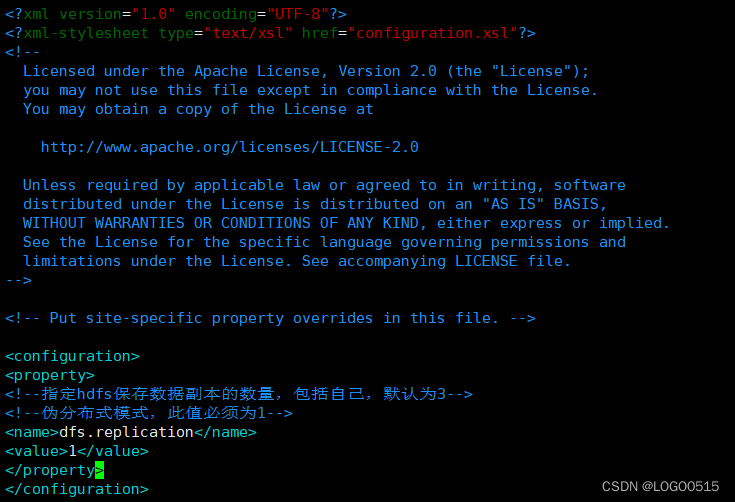

7.2.2vim hdfs-site.xml hdfs-site.xml 设置文件系统数据块副本数:

<configuration>

<property>

<!--指定hdfs保存数据副本的数量,包括自己,默认为3-->

<!--伪分布式模式,此值必须为1-->

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

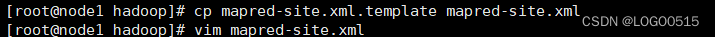

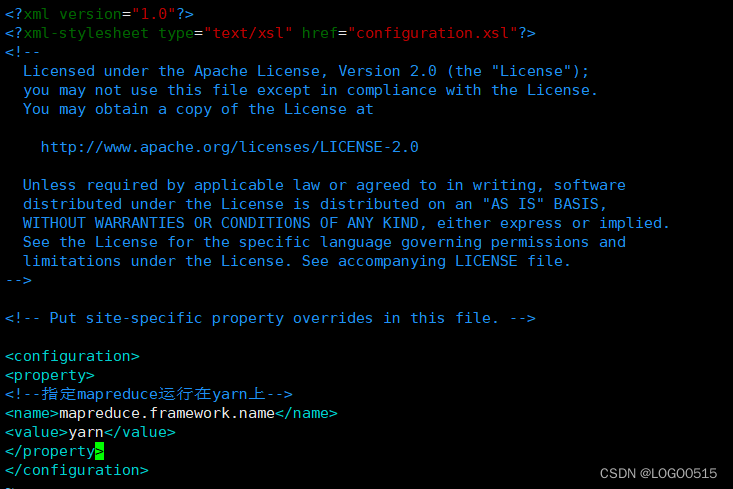

7.2.3vim mapred-site.xml mapred-site.xml 设置MapReduce的框架为Yarn:

cp mapred-site.xml.template mapred-site.xml

vim mapred-site.xml

<configuration>

<property>

<!--指定mapreduce运行在yarn上-->

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

7.2.4vim yarn-site.xml yarn-site.xml 设置NodeManager上运行的任务类型为MapReduce Shuffle任务:

<configuration>

<property>

<!--指定yarn的老大resourcemanager的地址-->

<name>yarn.resourcemanager.hostname</name>

<value>node1</value>

</property>

<property>

<!--NodeManager获取数据的方式-->

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

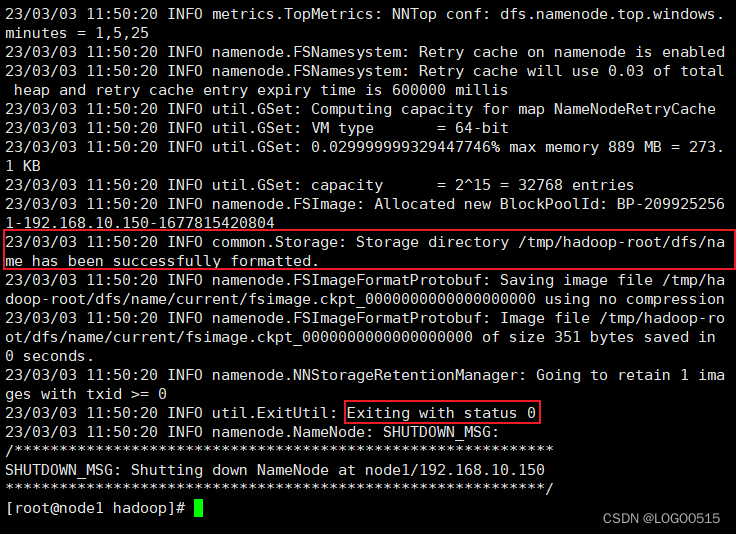

八、格式化并启动Hadoop

8.1 格式化Hadoop文件系统

hadoop namenode -format

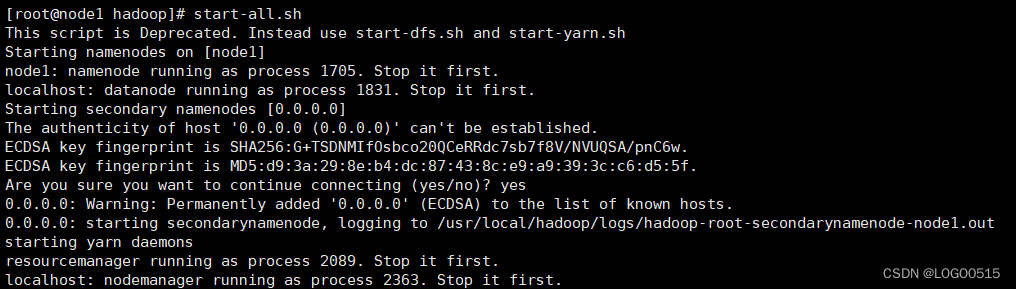

8.2 启动所有进程

start-all.sh

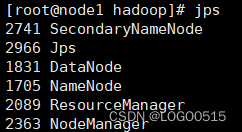

8.3 测试

jps

九、部署HBase伪分布式

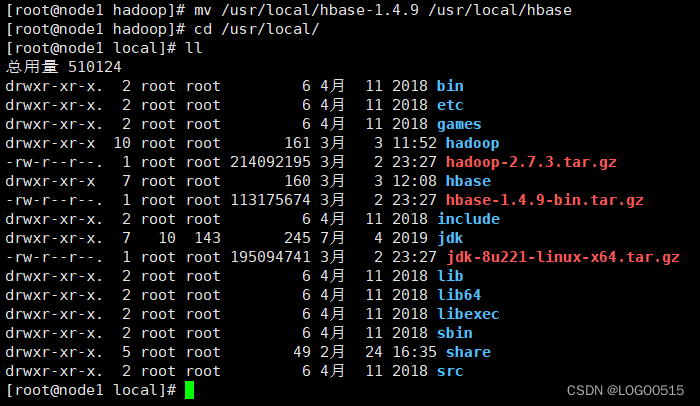

9.1 解压安装包

tar -zxvf /usr/local/hbase-1.4.9-bin.tar.gz -C /usr/local/

mv /usr/local/hbase

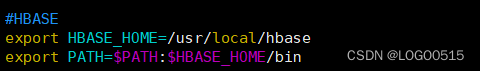

9.2 配置环境变量

vim /etc/profile

export HBASE_HOME=/usr/local/hbase

export PATH=$PATH:$HBASE_HOME/bin

9.3 修改配置文件

9.3.1 进入/usr/local/hbase/conf目录:

cd /usr/local/hbase/conf

9.3.2 hbase-env.sh 配置:

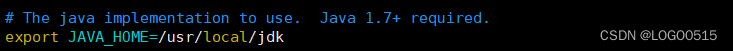

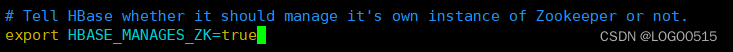

vim hbase-env.sh

export JAVA_HOME=/usr/local/jdk

export HBASE_MANAGES_ZK=true

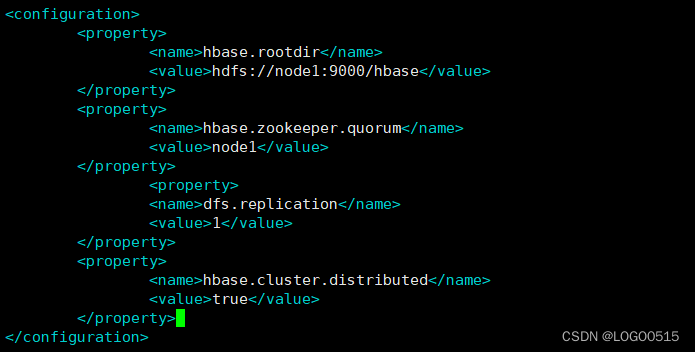

9.3.3 hbase-site.xml 配置:

vim hbase-site.xml

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://node1:9000/hbase</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>node1</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

</configuration>

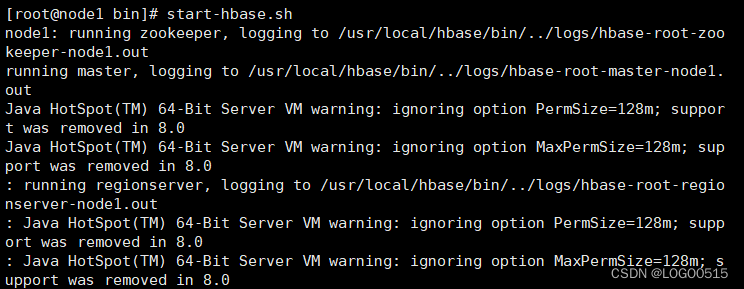

9.4 启动HBase

cd /usr/local/hbase/bin

start-hbase.sh

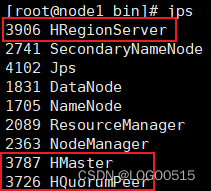

9.5 JPS查看进程

jps

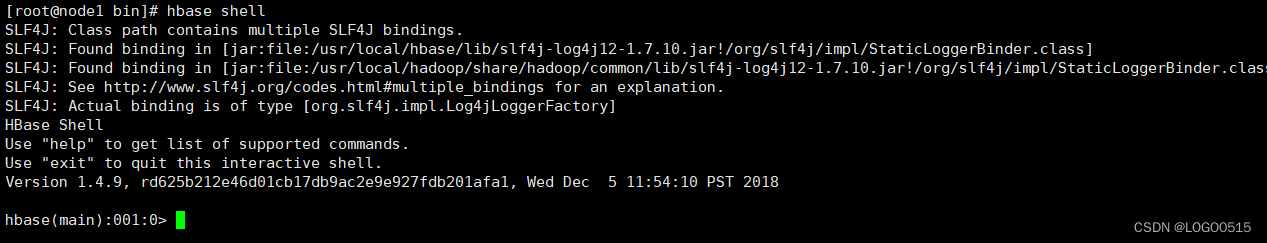

9.6 HBase Shell 登录

hbase shell

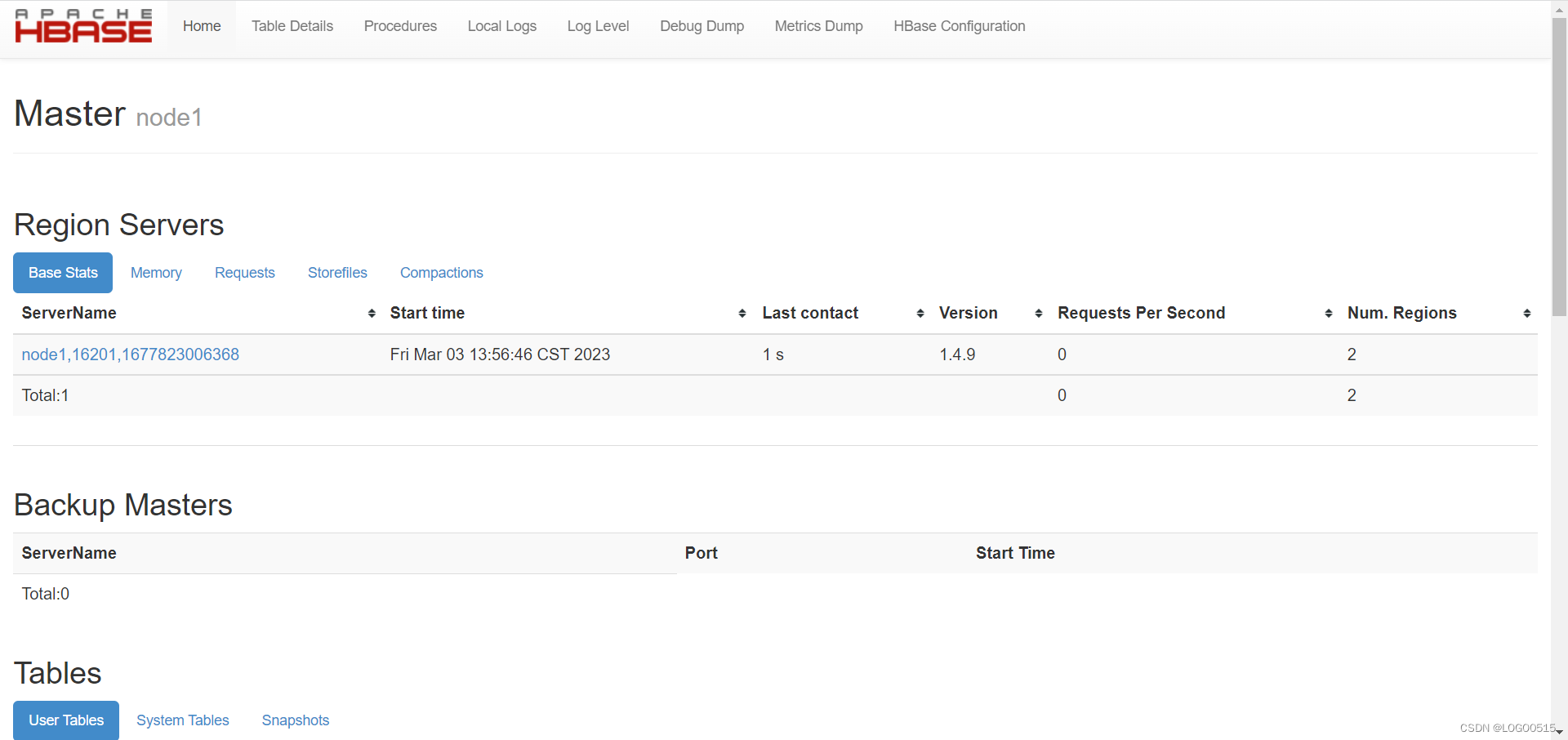

9.7 Web UI 登录

浏览器搜索 192.168.10.150【HMaster所在主机IP】:16010

http://192.168.10.150:16010/

2217

2217

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?