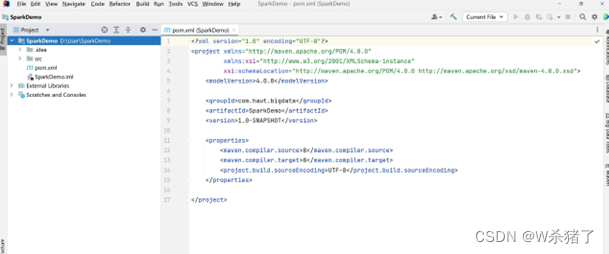

1.IDEA创建新项目

2.选择Maven

3.创建出新项目

4.打开Project Structure

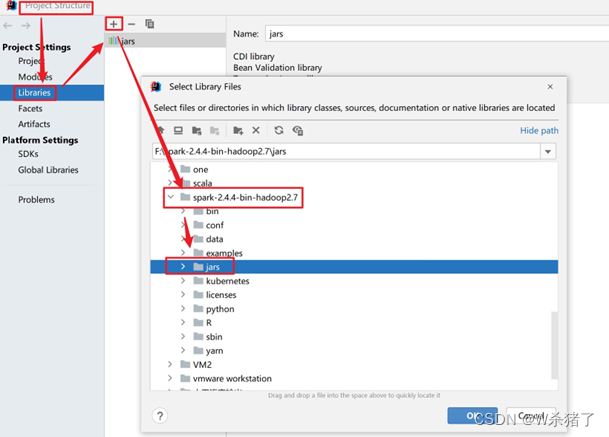

5.添加scala2.11.12

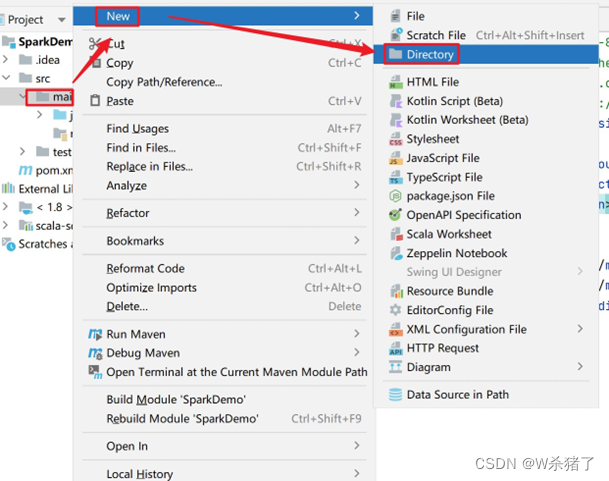

6.新建spark-core目录并设置Sources Root

7.解压spark到本地,导入spark的jar包

8.开启集群及Spark

start-all.sh启动集群,进入到Spark的sbin目录下,通过./start-master.sh及./start-slaves.sh启动Spark,输入jps查看是否正常

9.编写如下代码:

import org.apache.spark.{SparkConf, SparkContext} object test { def main(args: Array[String]): Unit = { //Application//Spark 框架 //TODO 建立和 Spark 框架的连接 //JDBC:Connction val Conf = new SparkConf().setAppName("test") .setMaster("spark://master:7077") .setIfMissing("spark.driver.host", "172.32.181.163")//IP为本机电脑IP val sc = new SparkContext(Conf) val rdd = sc.textFile("hdfs://master:9000/hadooptest/input/yarn-site.xml") println("行数:" + rdd.count()) //关闭连接 sc.stop() } }

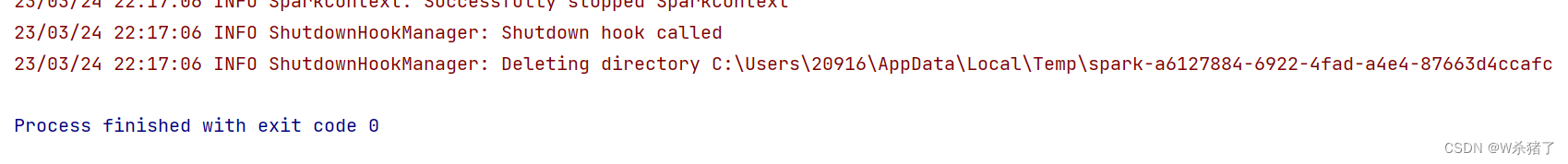

10.运行程序即可!

以上就是本次的全部分享了!

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?