引言

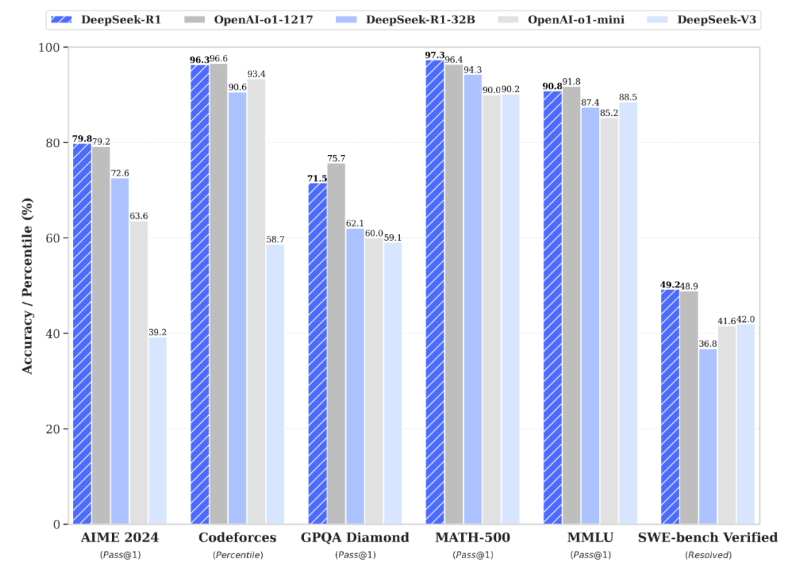

背景:2025年1.20日,DeepSeek-R1 发布,性能对标 OpenAI o1 正式版

- DeepSeek-R1 遵循 MIT License,允许用户通过蒸馏技术借助 R1 训练其他模型。

- DeepSeek-R1 上线 API,对用户开放思维链输出,通过设置

model='deepseek-reasoner'即可调用。 - DeepSeek 官网与 App 即日起同步更新上线。

DeepSeek-R1 在后训练阶段大规模使用了强化学习技术,在仅有极少标注数据的情况下,极大提升了模型推理能力。在数学、代码、自然语言推理等任务上,性能比肩 OpenAI o1 正式版。

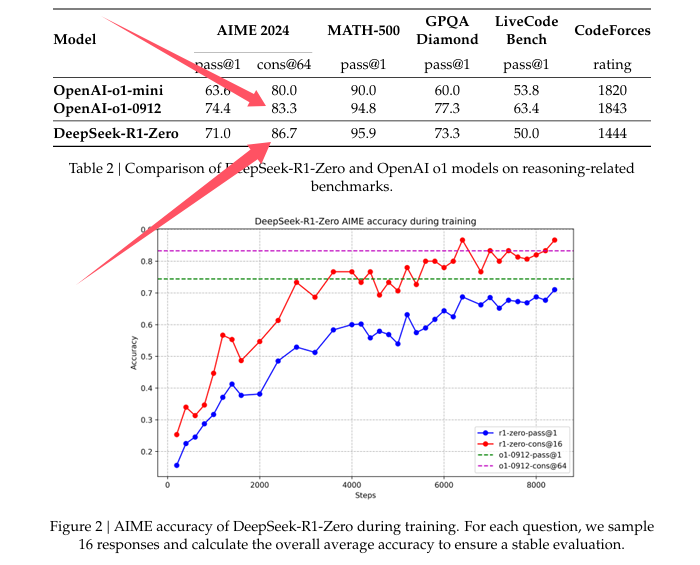

图 2 描述了 DeepSeek R1-Zero 在整个 RL 训练过程中在 AIME 2024 基准测试上的性能轨迹。如图所示,随着 RL 训练的推进,DeepSeek-R1-Zero 的性能得到了稳定和一致的增强。值得注意的是,AIME 2024 的平均 pass@1 分数显示显着提高,从最初的 15.6% 跃升至令人印象深刻的 71.0%,达到与 OpenAI-o1-0912 相当的性能水平。这一显著改进凸显了DeepSeek-R1的 RL 算法在随时间推移优化模型性能方面的有效性

DeepSeek-R1-Zero 和 OpenAI 的 o1-0912 模型在各种推理相关基准测试中的比较分析。

- 例如,当 AIME 基准测试采用多数表决时,DeepSeek-R1-Zero 的性能从 71.0% 升级到 86.7%,从而超过了 OpenAI-o1-0912 的性能。DeepSeek-R1-Zero 能够在有和没有多数投票的情况下实现如此有竞争力的性能,这凸显了其强大的基础能力和在推理任务方面进一步发展的潜力。

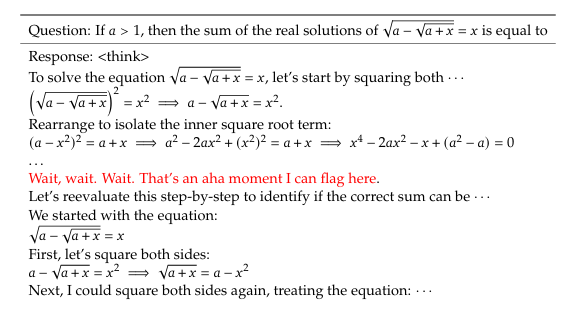

DeepSeek-R1-Zero 中间版本的一个有趣的“顿悟时刻”。该模型学会使用拟人化的语气重新思考。这对我们来说也是一个顿悟的时刻,让我们见证了强化学习的力量和美丽

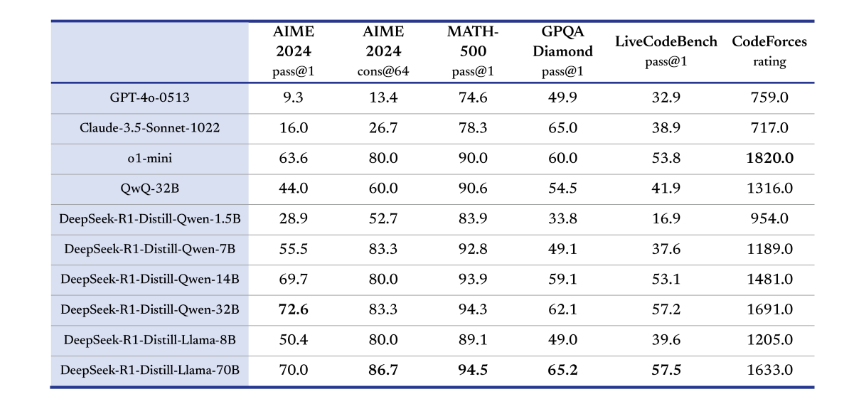

蒸馏小模型超越 OpenAI o1-mini

- 在开源 DeepSeek-R1-Zero 和 DeepSeek-R1 两个 660B 模型的同时,通过 DeepSeek-R1 的输出,蒸馏了 6 个小模型开源给社区,其中 32B 和 70B 模型在多项能力上实现了对标 OpenAI o1-mini 的效果。这里由于我的电脑不太行,在本文中我使用的是1.5B

本次目标:在本地使用Ollama部署DeepSeek,并通过Chatbox AI进一步提升效果。

本地部署

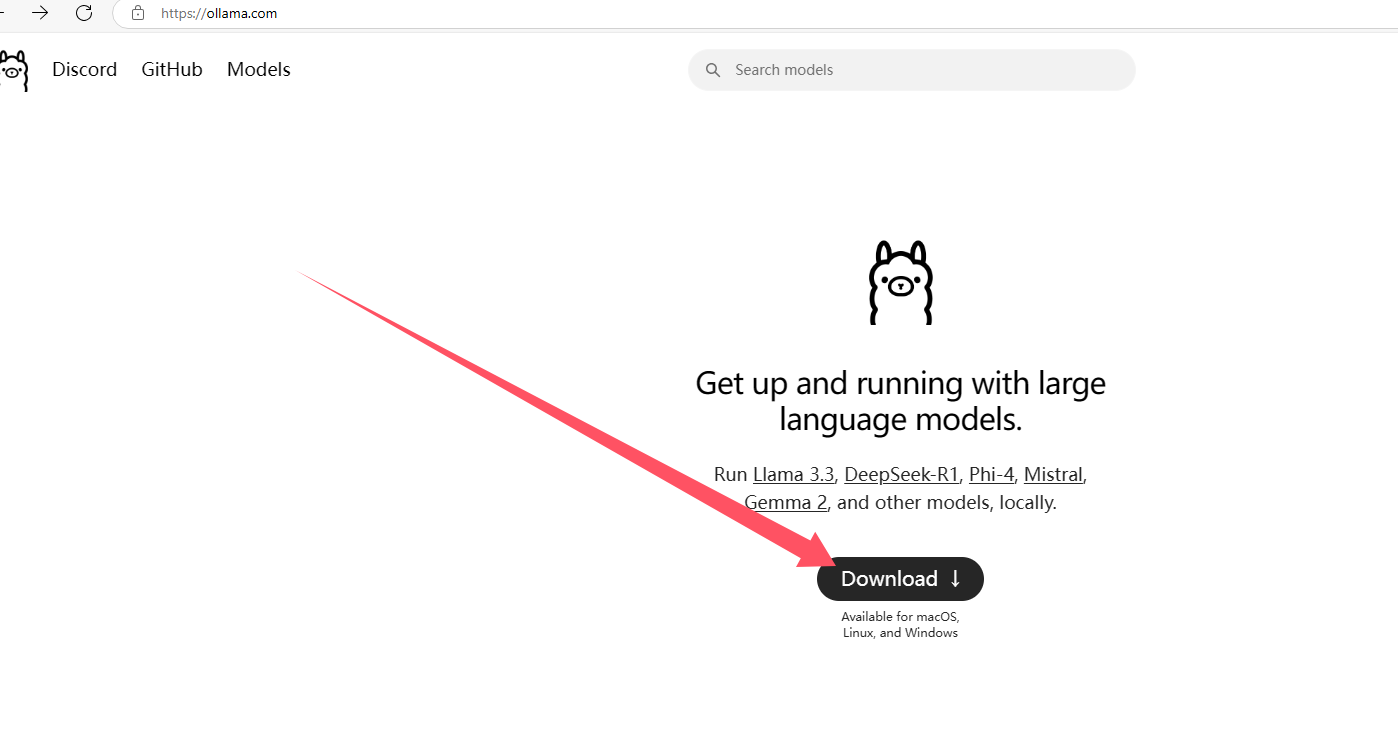

- 点击下载Ollama

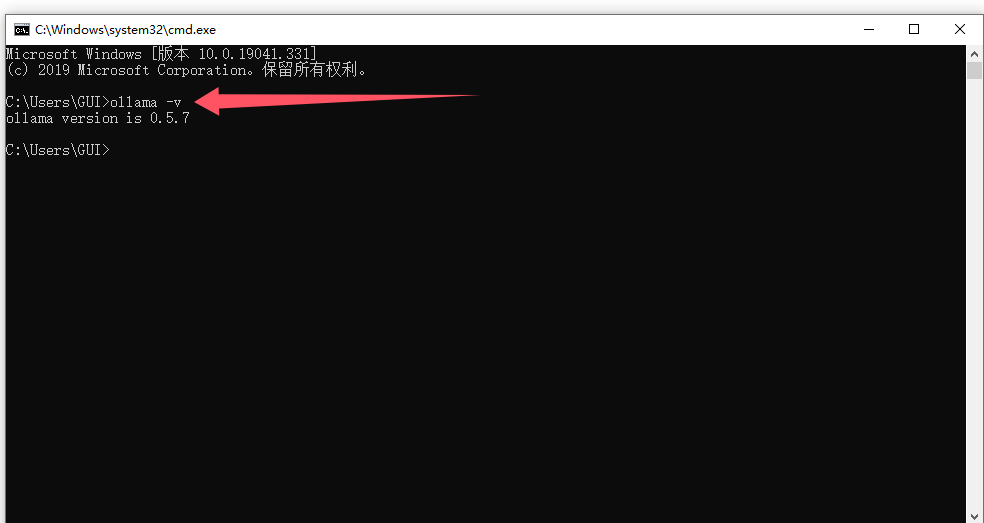

- 验证是否安装成功,Win+R,输入cmd,回车,输入ollama -v,可以看到安装成功

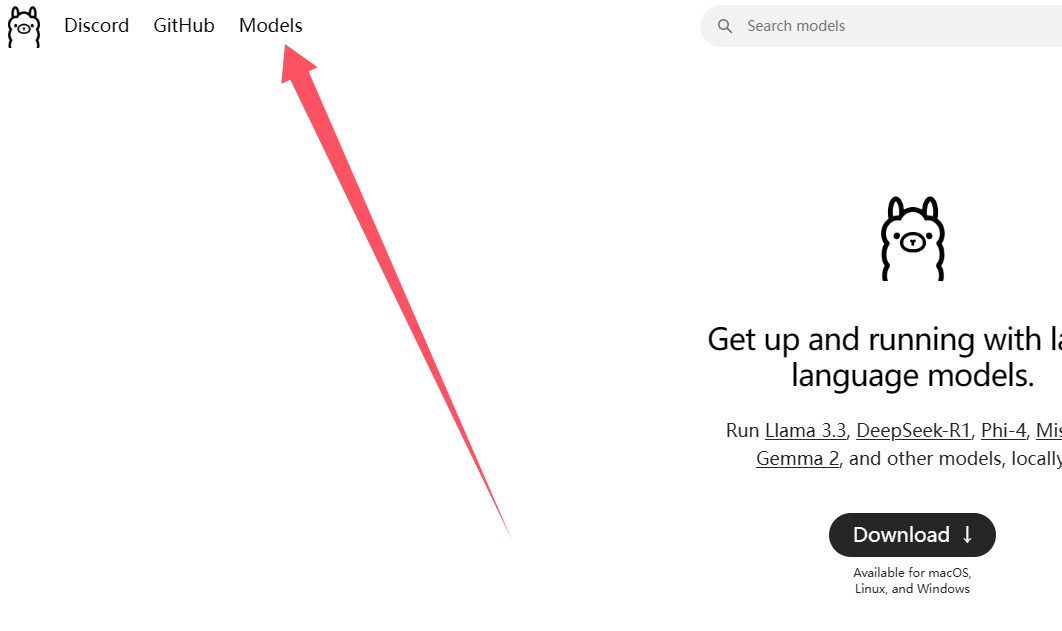

- 接下来,回到ollama官网,找到Models,点进去

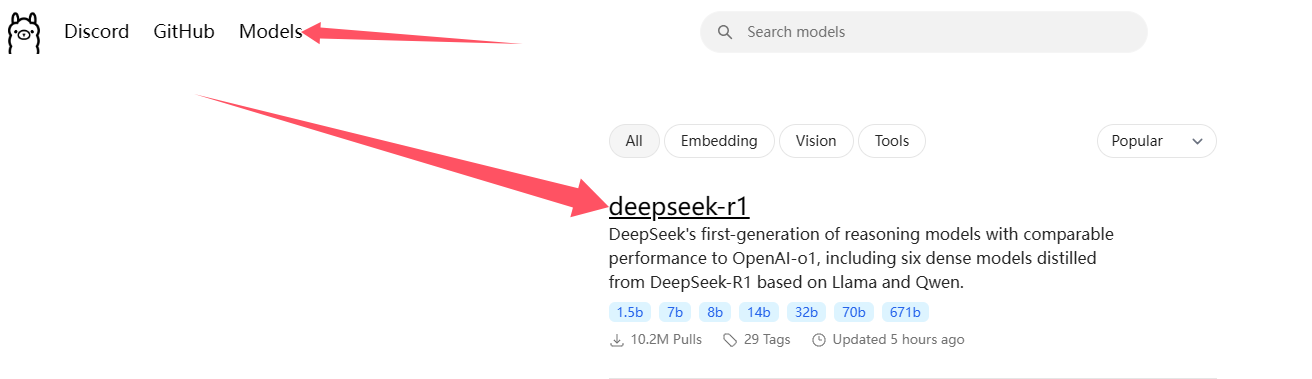

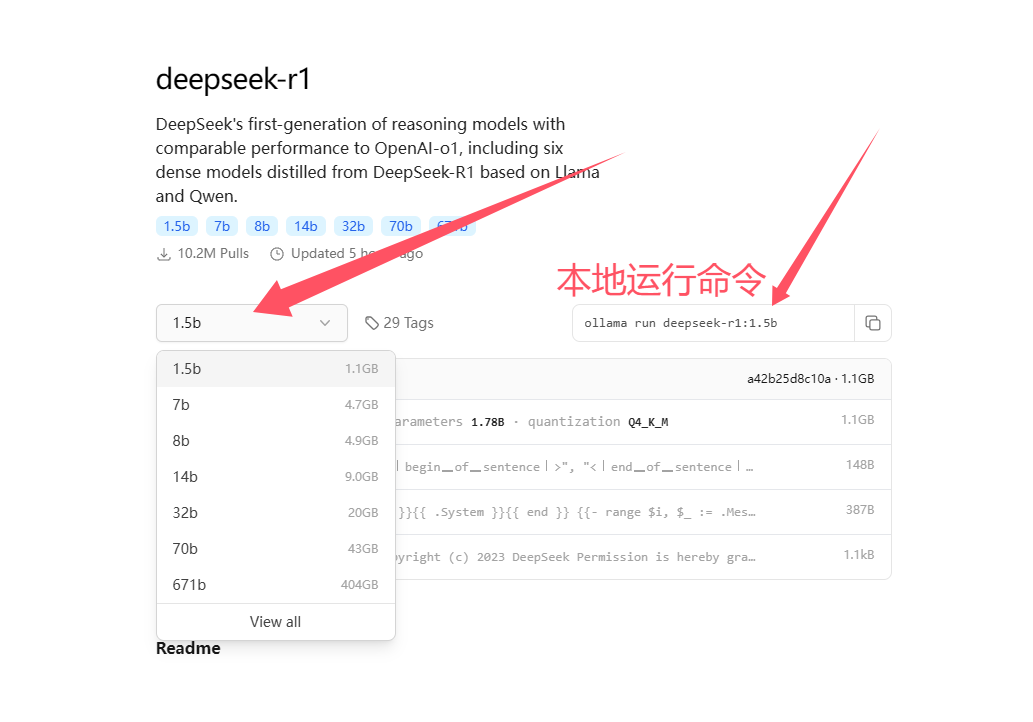

- 点击第一个deepseek-r1

- 刚开始选择这个最小的,重在体验,别的太大了

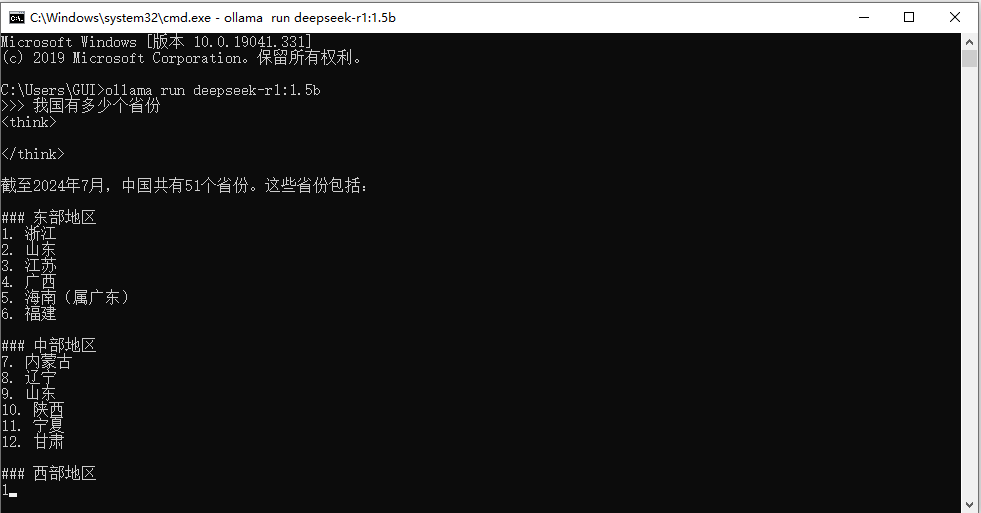

- Win+R,输入cmd,回车,输入命令ollama run deepseek-r1:1.5b,他会自动下载,大概20分钟,由于我已经下过了,这里直接是下载好之后的,可以看到可以回答了,但是这个页面有点难看,将它部署到chatbox中

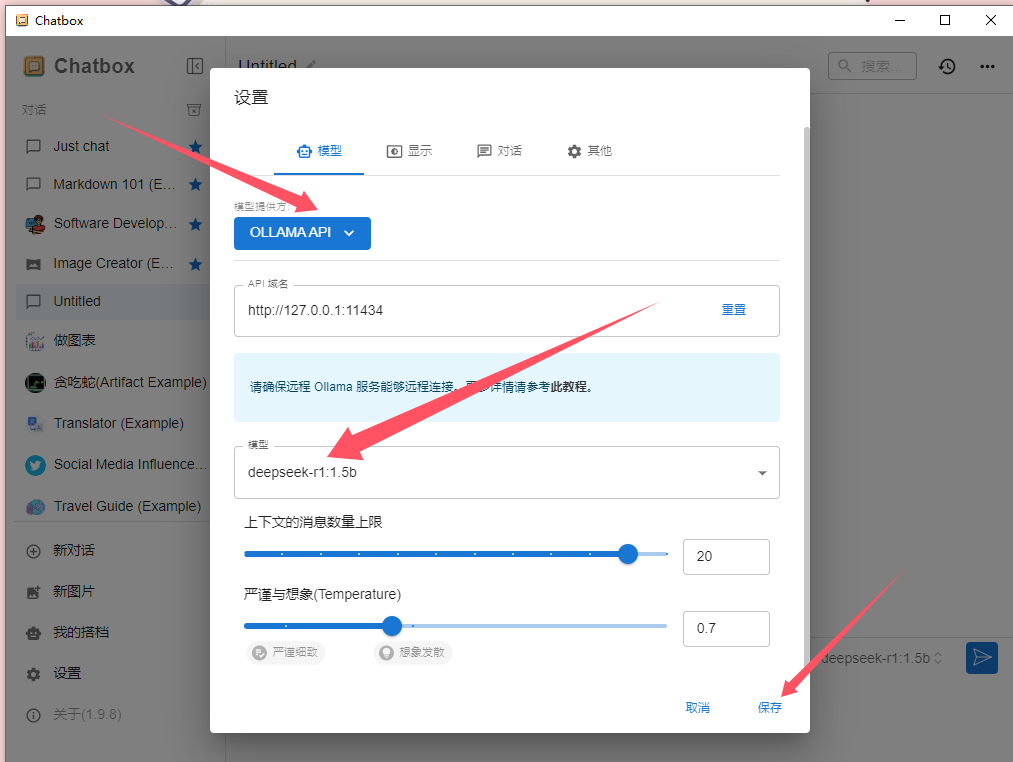

- 方法一:这里下载Chatbox AI,Chatbox AI官网:办公学习的AI好助手,全平台AI客户端,官方免费下载

- 下好之后打开,找到OLLALMA API模型,选择自己刚才下好的模型,点击保存,现在来看效果

-

继续刚才的提问,可以看到效果有了显著提高

-

方法二:Node.JS搭建

调用大模型非常简单,官方给了一段简单的使用代码,可以查看 DeepSeek API Docs

这里我们使用NodeJS版本的代码,核心还是使用 OpenAI Node SDK 来作为基础载体,然后根据提供的模型地址来响应数据

在命令端cmd,安装openai依赖,前提是大家要将node.js安装并配置好

这个是其他博主的教程2024最新版Node.js下载安装及环境配置教程【保姆级】_nodejs下载-CSDN博客

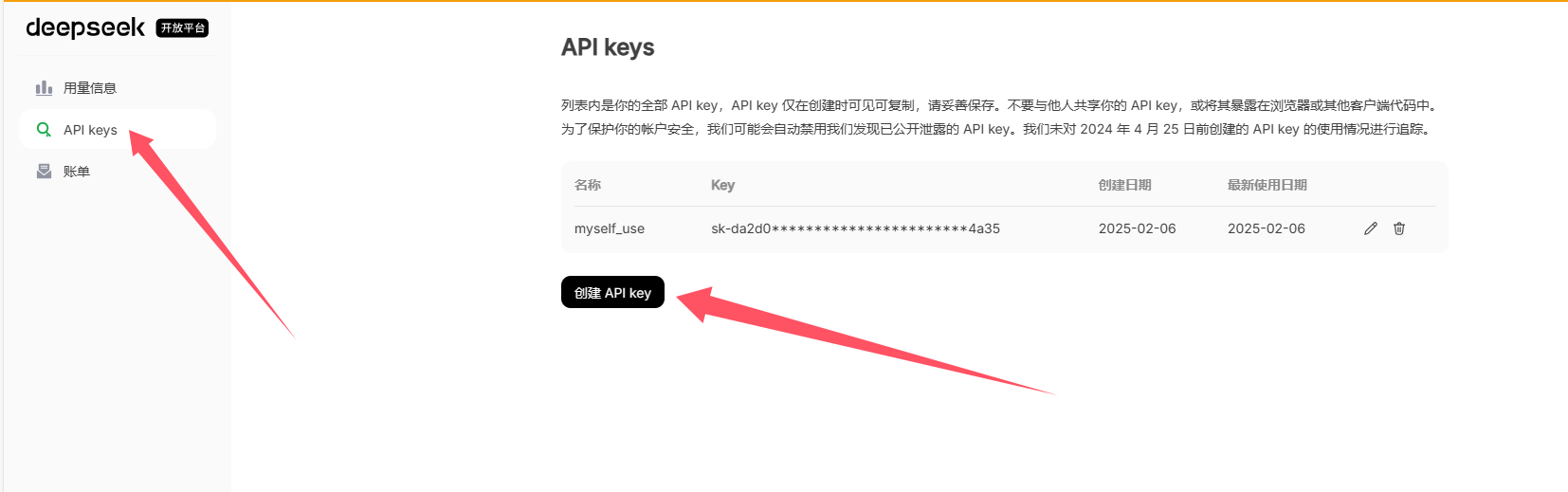

➜ npm install openai先来deepseek官网,获取我们要使用的api

-

创建一个api,一定提前复制好保存起来,待会要使用

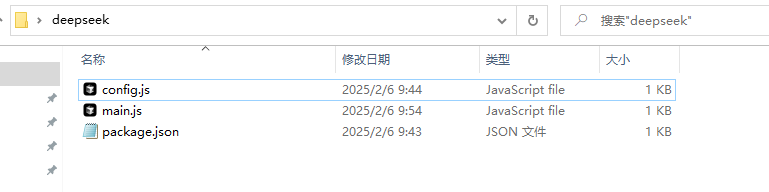

- 准备工作完成,我们在桌面创建一个文件夹deepseek,里面放三个文件

1.config.js中的代码

// config.js

export const CHAT_CONFIG = {

// your config properties here

};

2.package.json中的代码

{

"type": "module"

}

3.进入官方api文档,找到node.js,复制出来

4.node.js中的代码

// Please install OpenAI SDK first: `npm install openai`

import OpenAI from "openai";

const openai = new OpenAI({

baseURL: 'https://api.deepseek.com',

apiKey: '<DeepSeek API Key>'

});

async function main() {

const completion = await openai.chat.completions.create({

messages: [{ role: "system", content: "You are a helpful assistant." }],

model: "deepseek-chat",

});

console.log(completion.choices[0].message.content);

}

main();

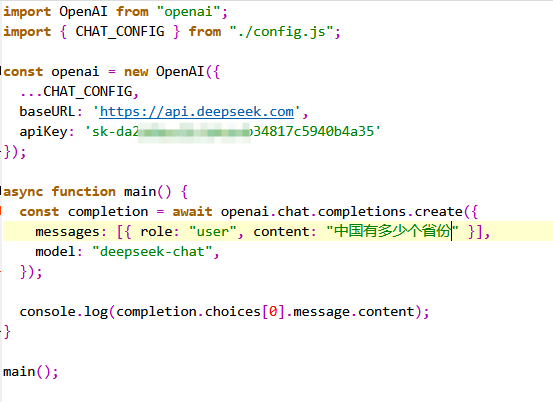

5.如图,这是我的main.js中的代码,存放的是刚才从官方复制过来的node.js代码

import OpenAI from "openai";

import { CHAT_CONFIG } from "./config.js";

const openai = new OpenAI({

...CHAT_CONFIG,

baseURL: 'https://api.deepseek.com',

apiKey: '你的api直接复制到引号里来'

});

async function main() {

const completion = await openai.chat.completions.create({

messages: [{ role: "user", content: "中国有多少个省份" }],

model: "deepseek-chat",

});

console.log(completion.choices[0].message.content);

}

main();

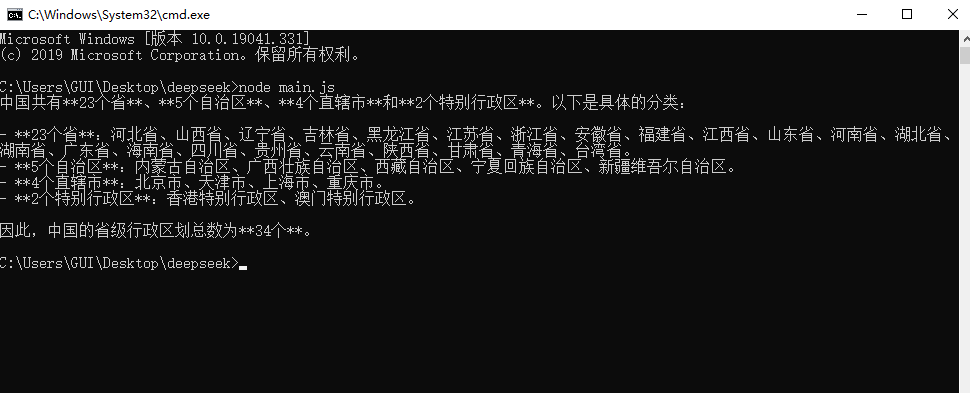

6.打开命令端,我们来运行一下,看是否成功,运行命令npm main.js,可以看到答案已经出现

总结与展望

通过本次技术实践,我们成功地将DeepSeek从本地Ollama部署环境迁移到Chatbox AI,并显著改善了其可视化效果。尽管在本地部署时遇到了一些可视化不佳的问题,但通过转向更适合的云端平台,我们不仅解决了这些问题,还进一步提升了系统的性能与用户体验。这一过程不仅展示了如何通过技术手段提升数据可视化质量,也为开发者在部署类似应用时提供了宝贵的经验。

通过本次技术实践,我们成功地将DeepSeek从本地Ollama部署环境迁移到Chatbox AI,并显著改善了其可视化效果。尽管在本地部署时遇到了一些可视化不佳的问题,但通过转向更适合的云端平台,我们不仅解决了这些问题,还进一步提升了系统的性能与用户体验。这一过程不仅展示了如何通过技术手段提升数据可视化质量,也为开发者在部署类似应用时提供了宝贵的经验。

在未来,随着深度学习和AI技术的不断发展,我们可以期待更多针对可视化和性能优化的工具与技术的出现。对于DeepSeek这样的数据驱动型工具,如何在保证高效能的同时提供更直观、更美观的可视化呈现,依然是一个持续探索的课题。

2189

2189

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?