有一个5000万的用户文件(user_id,name,age),

– 一个2亿记录的用户看电影的记录文件(user_id,url),

– 根据年龄段观看电影的次数进行排序?

数据准备

CREATE TABLE test_sql.test4user

(user_id string,name string,age int);

CREATE TABLE test_sql.test4log (user_id string,url string);

INSERT INTO TABLE test_sql.test4user VALUES('001','u1',10);

INSERT INTO TABLE test_sql.test4user VALUES('002','u2',15); INSERT INTO TABLE test_sql.test4user VALUES('003','u3',15); INSERT INTO TABLE test_sql.test4user VALUES('004','u4',20); INSERT INTO TABLE test_sql.test4user VALUES('005','u5',25); INSERT INTO TABLE test_sql.test4user VALUES('006','u6',35); INSERT INTO TABLE test_sql.test4user VALUES('007','u7',40); INSERT INTO TABLE test_sql.test4user VALUES('008','u8',45); INSERT INTO TABLE test_sql.test4user VALUES('009','u9',50); INSERT INTO TABLE test_sql.test4user VALUES('0010','u10',65);

INSERT INTO TABLE test_sql.test4log VALUES('001','url1'); INSERT INTO TABLE test_sql.test4log VALUES('002','url1'); INSERT INTO TABLE test_sql.test4log VALUES('003','url2'); INSERT INTO TABLE test_sql.test4log VALUES('004','url3'); INSERT INTO TABLE test_sql.test4log VALUES('005','url3'); INSERT INTO TABLE test_sql.test4log VALUES('006','url1'); INSERT INTO TABLE test_sql.test4log VALUES('007','url5'); INSERT INTO TABLE test_sql.test4log VALUES('008','url7'); INSERT INTO TABLE test_sql.test4log VALUES('009','url5'); INSERT INTO TABLE test_sql.test4log VALUES('0010','url1');

思路分析

– 首先需要对用户文件和看电影记录文件进行连接,通过user_id将两个文件关联起来。

– 将年龄按照年龄段分组,例如:18-24,25-34等。

– 对每个年龄段统计用户看电影的次数。

– 将统计结果按照电影观看次数从高到低进行排序。

答案获取

建议你先动脑思考,动手写一写再对照看下答案,如果实在不懂可以点击下方卡片,回复:大厂sql 即可。

参考答案适用HQL,SparkSQL,FlinkSQL,即大数据组件,其他SQL需自行修改。

加技术群讨论

点击下方卡片关注 联系我进群

或者直接私信我进群

文末SQL小技巧

提高SQL功底的思路。

1、造数据。因为有数据支撑,会方便我们根据数据结果去不断调整SQL的写法。

造数据语法既可以create table再insert into,也可以用下面的create temporary view xx as values语句,更简单。

其中create temporary view xx as values语句,SparkSQL语法支持,hive不支持。

2、先将结果表画出来,包括结果字段名有哪些,数据量也画几条。这是分析他要什么。

从源表到结果表,一路可能要走多个步骤,其实就是可能需要多个子查询,过程多就用with as来重构提高可读性。

3、要由简单过度到复杂,不要一下子就写一个很复杂的。

先写简单的select * from table…,每个中间步骤都执行打印结果,看是否符合预期, 根据中间结果,进一步调整修饰SQL语句,再执行,直到接近结果表。

4、数据量要小,工具要快,如果用hive,就设置set hive.exec.mode.local.auto=true;如果是SparkSQL,就设置合适的shuffle并行度,set spark.sql.shuffle.partitions=4;

后记

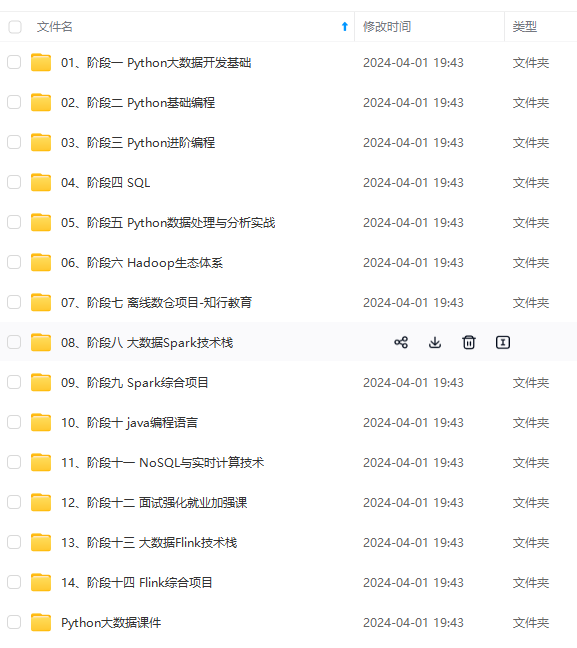

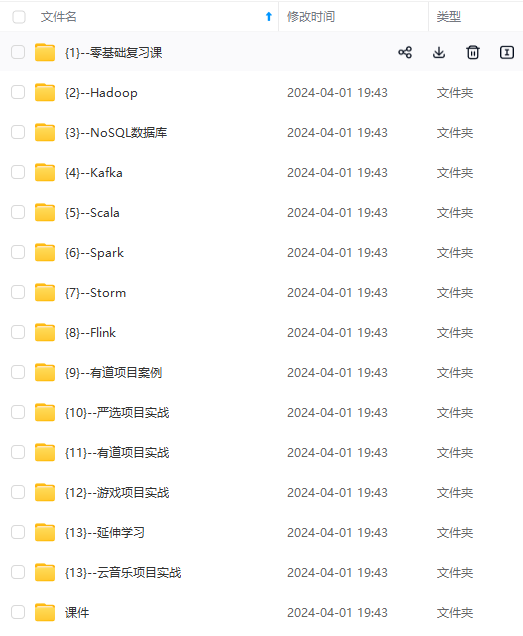

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

225

225

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?